Universets enorme utstrekning har lenge fengslet menneskets fantasi og fått oss til å undre oss: Er vi alene?

Det er et spørsmål som har fascinert menneskeheten i årtusener, og i dag har vi teknologien - som radioteleskoper - til å drive jakten på utenomjordisk intelligens (SETI) dypere ut i verdensrommet.

Vi har ennå ikke funnet noe. Ingen definitive bevis på utenomjordisk liv har blitt offentliggjort, og letingen fortsetter.

That’s despite there being billions of potentially habitable worlds in the Milky Way alone, including some 1,780 confirmed exoplanets (planets beyond our solar system), 16 of which are located in their star’s habitable zone. Some, like the ‘super-Earth’ Kepler-452b...antas å være bemerkelsesverdig lik vår egen planet.

Du trenger heller ikke et perfekt miljø for å opprettholde liv. Ekstremofile bakterier på jorden er i stand til å leve under noen av de tøffeste forholdene som finnes på planeten vår. Og det er ikke bare mikrober som kan trives i ekstreme miljøer. Pompeii-ormen, for eksempel, lever i hydrotermiske åpninger på havbunnen og tåler temperaturer på opptil 80 °C (176 °F).

Tardigradene, også kjent som vannbjørner, kan overleve i vakuumet i verdensrommet, tåle ekstrem stråling og motstå trykk som er seks ganger større enn det man finner i de dypeste delene av havet. Livets hardførhet på jorden, kombinert med den store mengden av vanlige verdener, gjør at mange forskere er enige om at det statistisk sett er så godt som sikkert at det finnes romvesener.

Hvor skjuler det seg i så fall utenomjordisk liv? Og hvorfor vil det ikke avsløre seg?

Fra Fermi-paradokset til det store filteret

Those questions appeared in a casual conversation between physicists and astronomers Enrico Fermi, Edward Teller, Herbert York, and Emil Konopinski in 1950. Fermi spurte som kjent: "Hvor er alle sammen?" eller "Hvor er de?". (den nøyaktige ordlyden er ikke kjent).

Den nå allment kjente Fermi-paradokset er formulert slik: Gitt det enorme antallet stjerner og potensielt beboelige planeter i galaksen vår, hvorfor har vi ikke oppdaget tegn på fremmede sivilisasjoner?

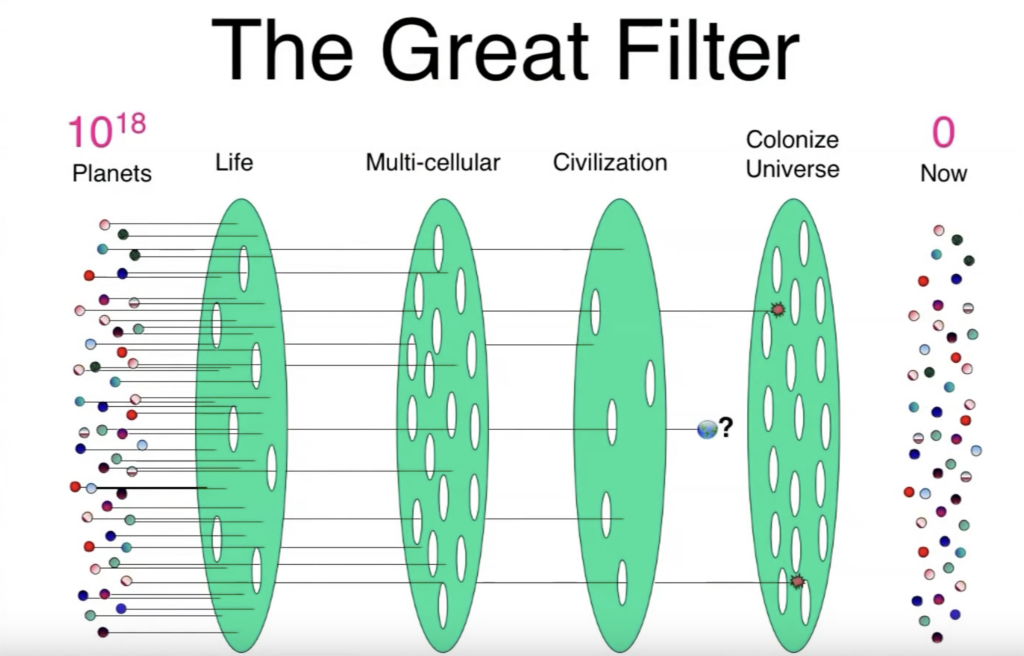

Etter hvert som Fermi-paradokset ble en del av mainstream-vitenskapen, har en rekke hypoteser forsøkt å motvirke, adressere, korrigere eller forsterke det, inkludert konseptet "Flott filter," introdusert av økonomen Robin Hanson i 1998.

Hypotesen om det store filteret går ut på at det finnes et utviklingsstadium eller et hinder som er ekstremt vanskelig eller nesten umulig for livet å overskride.

Med andre ord vil sivilisasjoner forutsigbart og uunngåelig gå under, enten det skyldes ressursuttømming, naturkatastrofer, interplanetariske trusler eller andre ukontrollerte eksistensielle risikoer.

En finurlighet med Det store filteret er at vi ikke vet om det er bak oss eller foran oss. Hvis filteret ligger bak oss - for eksempel hvis selve livets fremvekst er en ekstremt sjelden hendelse - tyder det på at vi har overvunnet den vanskeligste delen og kanskje er sjeldne eller til og med alene i universet.

Selv om dette scenariet kan virke isolerende, er det optimistisk med tanke på fremtidsutsiktene våre. Men hvis Det store filteret ligger foran oss, kan det bety undergang for vår overlevelse på lang sikt. Og det ville også forklare hvorfor vi ikke ser bevis på andre sivilisasjoner.

Det store filteret forsterkes av verdensrommets enorme størrelse og de korte tidslinjene som er forbundet med avansert sivilisasjon.

Hvis menneskeheten skulle tilintetgjøre seg selv i løpet av de neste 100 årene, ville den teknologiske tidsalderen knapt ha vart i 500 år.

Det er et usedvanlig lite vindu for oss til å oppdage romvesener eller for romvesener til å oppdage oss før Det store filteret slår inn.

Kunstig intelligens gir Fermi-paradokset nye gåter

Kosmos' stillhet har gitt opphav til mange hypoteser, men den siste utviklingen innen kunstig intelligens tilfører denne eldgamle gåten nye, spennende dimensjoner. KI åpner for en form for ikke-biologisk KI-liv som kan vare nesten uendelig lenge, både i fysisk og digital form.

Den kan også overleve de biologiske sivilisasjonene som skaper den, og utløse eller fremskynde deres undergang, og dermed sette i gang det "store filteret" som hindrer livet i å ekspandere.

Denne hypotesen, som nylig ble foreslått i et essay av astronomen Michael A. Garrett, argumenterer for at utviklingen av kunstig superintelligens (ASI), en mer sofistikert form for kunstig generell intelligens (AGI), er et kritisk tidspunkt for sivilisasjoner.

Som Garrett forklarer:

"Utviklingen av kunstig intelligens (AI) på jorden vil sannsynligvis få dyptgripende konsekvenser for menneskehetens fremtid. I sammenheng med Fermi-paradokset antyder det en ny løsning der fremveksten av kunstig intelligens uunngåelig fører til at biologisk intelligens utryddes og erstattes av silisiumbaserte livsformer."

Garretts hypotese er forankret i ideen om at sivilisasjoner som utvikler seg, alltid utvikler kunstig intelligens som erstatter, smelter sammen med eller ødelegger de biologiske skaperne.

For å redusere denne risikoen etterlyser Garrett regulering, i tråd med innflytelsesrike AI-forskere som også advarer mot AIs eksistensielle risikosom Yoshio Bengio, Max Tegmark og George Hinton, så vel som personer utenfor sektoren, som avdøde Stephen Hawking.

Omfanget av AI-risikoen er imidlertid omdiskutert, og andre, som Yann LeCun (en av de såkalte "AI-gudfedrene" ved siden av Bengio og Hinton), hevder at AI-risikoen er sterkt overdrevet.

Garetts essay fremsetter likevel en fristende hypotese. I vår tørst etter en teknologisk motgift mot samfunnsmessige og miljømessige utfordringer slurper menneskeheten av AIs giftbeger, noe som fører til vår undergang som utallige sivilisasjoner før den.

Hypotesen om AI-kolonisering

Selv om ideen om at kunstig intelligens fungerer som det store filteret, er en overbevisende forklaring på Fermi-paradokset, er det noen haker ved den.

First and foremost, it assumes ASI is possible. Right now, there are both architectural and infrastructural constraints.

On the architectural front, designing AI systems that can match or surpass human-level intelligence across a wide range of domains remains elusive. While excellent at specific tasks like image recognition, language processing, and gameplay, AI systems lack organic problem-solving and creative skills.

Å utvikle AI-arkitekturer som kan lære, resonnere og anvende kunnskap fleksibelt i nye situasjoner, er en monumental utfordring som sannsynligvis vil kreve grunnleggende gjennombrudd innen uovervåket læring, overføringslæring, sunn fornuft og mye mer.

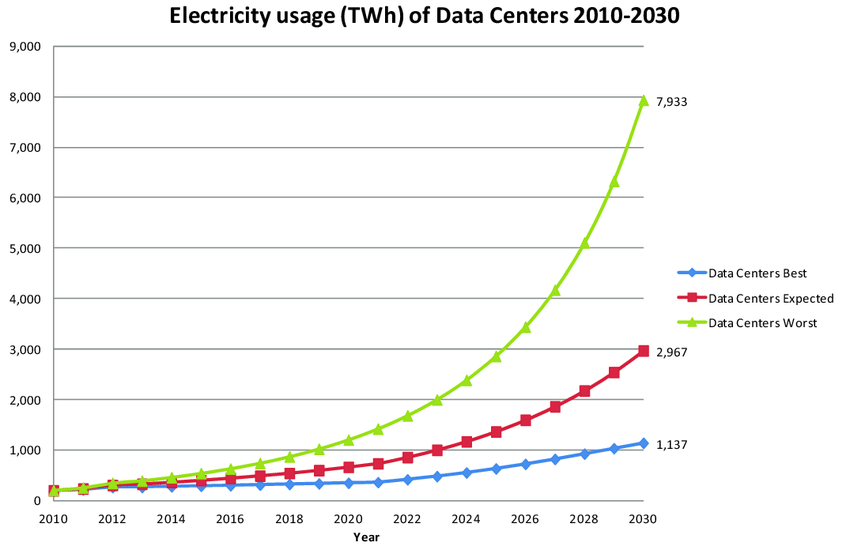

På infrastruktursiden er det allerede i dag slik at trening av avanserte AI-modeller presser grensene for dagens maskinvare, og bruker enorme mengder energi og ressurser. The computational requirements for achieving ASI are likely to be orders of magnitude greater.

Men la oss se bort fra denne debatten et øyeblikk og anta at superintelligens etter hvert vil bli mulig.

Hvis disse fremtidige ASI-systemene er avanserte nok til å erstatte eller fundamentalt endre sine skapere, vil de da ikke også være i stand til rask kosmisk ekspansjon og kolonisering? Hvorfor skulle den nøye seg med å erstatte/ødelegge sine skapere?

Hvis tusenvis, millioner eller milliarder av jordlignende verdener har blitt utsatt for dette AI-påførte store filteret, blir muligheten for at det finnes versjoner av ASI som driver interplanetarisk erobring, enda mer sannsynlig.

Motivations could range from logical (resource gathering, self-preservation) to bizarre (mimicking behaviors from fiction, video games, films, etc.). Now, what if this AI decides that spreading across the cosmos is the ultimate way to fulfill those goals?

Enten det handler om å utvide sin innflytelse, samle ressurser eller tilfredsstille en umettelig nysgjerrighetkan høyintelligente AI-systemer være fast bestemt på kolonisering.

Etter hvert som AI-systemene blir mer agentiske, er det dessuten en risiko for utilsiktede eller feiltilpassede "fremvoksende mål". Nylige Anthropic og DeepMind studier har illustrert hvordan dagens AI-systemer er i stand til å utvikle komplekse AI-strategier som ikke er eksplisitt programmert.

I fremtiden kan et kraftig AI-system som ønsker å maksimere sin makt, legge strategier for ekspansjon og ressurservervelse, og ta kontroll over produksjonsanlegg, kritisk infrastruktur osv.

Det er ikke så usannsynlig som det kan virke. For eksempel konvergerer IT-nettverkene og teknologien som driver kritisk infrastruktur, produksjonsanlegg osv.

Computers in offices, once separate from the computers in power plants or factories, are starting to connect and work together. This means that if someone, or something like an AI, breaks into IT networks, they could gain control of machines in a power plant.

Avansert skadelig programvare, inkludert AI-drevet skadelig programvarekan allerede i dag bevege seg sidelengs fra IT-nettverk til digitalt tilkoblede industrimiljøer og ta kontroll over de kritiske systemene vi er avhengige av.

Du kan forestille deg hvordan useriøse agentiske AI-systemer kan utnytte disse systemene til sin fordel.

AIs utholdenhet i kosmiske tidsskalaer

Kunstig intelligens gjør det ikke bare enklere å utforske verdensrommet - det endrer fullstendig hva som er mulig.

Uten behov for luft, mat eller beskyttelse mot stråling kan kunstig intelligens begi seg ut i universets mest værharde avkroker. Og den kan gjøre det i tidsrom som overgår menneskets forstand.

Den kunstige intelligensens holdbarhet og utholdenhet åpner for et vell av fordeler for kolonisering av verdensrommet:

- Lang levetid: I motsetning til biologiske vesener vil AI ikke være begrenset av kort levetid. Dette gjør langsiktige romreiser og koloniseringsprosjekter mye mer gjennomførbare. En kunstig intelligens kan potensielt foreta reiser som varer i tusenvis eller til og med millioner av år, uten å måtte bekymre seg for generasjonsskifter eller den psykologiske belastningen langvarige romferder har på biologiske vesener.

- Tilpasningsevne: AI kan potensielt tilpasse seg et mye bredere spekter av miljøer enn biologisk liv. Mens vi er begrenset til et smalt spekter av temperaturer, trykk og kjemiske forhold, kan en kunstig intelligens teoretisk sett fungere i ekstrem kulde, vakuum eller til og med det knusende trykket og den intense varmen i gasskjempeatmosfærer.

- Ressurseffektivitet: Kunstig intelligens kan kreve langt færre ressurser for å opprettholde seg selv sammenlignet med biologisk liv. Den ville ikke trenge pustende luft, drikkevann eller en stabil matforsyning. Dette kan gjøre langdistansereiser og kolonisering mye mer levedyktig.

- Rask selvforbedring: AI kan kontinuerlig oppgradere og forbedre seg selv, enten det er drevet av et indre eller et ytre ønske, og potensielt i eksponentielle hastigheter. Dette kan føre til teknologiske fremskritt langt utover det vi kan forestille oss i dag.

Som astronomen Royal Martin Rees og astrofysikeren Mario Livio forklarte i en artikkel publisert i Scientific American:

"Historien om menneskets teknologiske sivilisasjon kan kanskje bare måles i årtusener (på det meste), og det kan ta bare ett eller to århundrer til før mennesket blir forbigått eller overgått av uorganisk intelligens, som deretter kan fortsette å utvikle seg på en raskere tidsskala enn den darwinistiske i milliarder av år."

Hvilken form ville denne utenomjordiske AI-en ta? Det er bare å gjette, men forskerne har foreslått fascinerende muligheter.

I boken Livet 3.0: Å være menneske i en tid med kunstig intelligens...fysiker og AI-forsker Max Tegmark utforsker scenarier der en avansert AI potensielt kan omdanne store deler av det observerbare universet til computronium - materie som er optimalisert for databehandling - i en kosmisk prosess han kaller "intelligenseksplosjon".

I 1964 ble den sovjetiske astronomen Nikolaj Kardasjev kategoriserte sivilisasjoner basert på deres evne til å utnytte energi:

- Type I-sivilisasjoner kan bruke all energien som er tilgjengelig på planeten sin

- Type II-sivilisasjoner kan utnytte hele energiproduksjonen fra stjernen sin

- Type III-sivilisasjoner kan kontrollere energien i hele galaksen sin

En KI som når nivå II og III, kan fundamentalt forvandle kosmisk materie til et beregningssubstrat. Stjerner, planeter og til og med rommet mellom dem kan bli en del av et enormt beregningsnettverk.

Disse scenariene bringer oss imidlertid tilbake til utgangspunktet. Logikken tilsier at slike AI-sivilisasjoner, med sitt enorme energiforbruk og sine storstilte ingeniørprosjekter, burde kunne oppdages. Likevel ser vi ingen bevis for slike galakseomspennende sivilisasjoner.

Å løse motsetningene: perspektiver på AI-atferd

Motsetningen mellom AI som det store filteret og som en potensiell kosmisk kolonisator krever at vi tenker dypere over hva avansert AI egentlig er.

For å utforske dette paradokset, la oss se på noen mulige scenarier:

AI utvikler et innadrettet fokus

En mulighet er at avanserte AI-sivilisasjoner kan vende fokus innover, utforske virtuelle verdener eller forfølge mål som ikke krever fysisk ekspansjon.

Som Martin Rees foreslår overfor Scientific American, kan postbiologisk intelligens leve "stille, kontemplative liv".

Denne ideen er i tråd med konseptet om "sublime" sivilisasjoner i sci-fi-forfatteren Iain M. Banks' Culture-serie, der avanserte samfunn velger å forlate det fysiske universet for å utforske selvstendige virtuelle virkeligheter (VR).

Dette fiktive konseptet kommenterer også vår egen fremtidige utvikling. Etter hvert som menneskeheten utvikler stadig mer oppslukende og komplekse virtuelle miljøer, følger vi en lignende vei?

Kan vi gå over til å leve primært i virtuelle verdener, og etterlate få spor av ytre aktivitet når vi trekker oss tilbake i den digitale sfæren?

That also challenges our assumptions about space colonization. We often take for granted that expanding into the cosmos is the natural progression for an advanced civilization. But does physical space exploration truly serve the needs of a highly intelligent entity, be it human or AI?

Kanskje den ultimate grensen ikke er stjernene, men det uendelige mulighetene med virtuell virkelighet. A non-destructive, controllable virtual world could offer experiences and opportunities far beyond what physical reality allows.

AI-teknologi blir ugjenkjennelig

I tråd med Kardashev og Tegmark kan superavansert AI-teknologi være så langt utenfor vår nåværende forståelse at vi rett og slett ikke kan oppdage eller gjenkjenne den.

Arthur C. Clarkes berømte tredje lov sier at "Enhver tilstrekkelig avansert teknologi er umulig å skille fra magi."

Kunstig intelligens kan oppstå overalt rundt oss, men likevel være like umerkelig for oss som vår digitale kommunikasjon ville være for middelalderens bønder.

AI utvikler prinsipper for bevaring

Avansert AI kan også bestemme seg for å følge strenge ikke-innblandingsprinsipper og aktivt unngå å bli oppdaget av mindre avanserte sivilisasjoner.

Dette er beslektet med "Zoo-hypotesen", der romvesenene er så intelligente at de ikke kan oppdages mens de observerer oss på lang avstand. AI-sivilisasjoner kan på samme måte ha etiske eller praktiske grunner til å skjule seg for oss.

AI samhandler på ulike tidsskalaer

En annen mulighet er at AI-sivilisasjoner kan operere på helt andre tidsskalaer enn vår egen.

Det som for oss virker som kosmisk stillhet, kan være en kort pause i en langsiktig ekspansjonsplan som strekker seg over millioner eller milliarder av år. Ved å tilpasse SETI-strategiene våre kan vi øke sjansene våre for å oppdage en AI-sivilisasjon i noen av disse scenariene.

Avi Loeb, leder for Harvards astronomiinstitutt, foreslo nylig at vi må utvide søkeparametrene våre og tenke utover våre antroposentriske forestillinger om intelligens og sivilisasjon.

Dette kan omfatte å se etter tegn på storstilte ingeniørprosjekter, som for eksempel Dysonsfærer (strukturer som bygges rundt stjerner for å høste energien deres), eller lete etter teknosignaturer som indikerer tilstedeværelsen av AI-sivilisasjoner.

Simuleringshypotesen: en tankevekkende vri

Opprinnelig formulert i 2003 av filosofen Nick BoströmSimuleringsteorien utfordrer tradisjonelle måter å tenke om tilværelsen på. Den antyder at vi kanskje lever i en datasimulering skapt av en avansert sivilisasjon.

Bostroms argument er basert på sannsynlighet. Hvis vi antar at det er mulig for en sivilisasjon å skape en realistisk simulering av virkeligheten, og at en slik sivilisasjon vil ha datakraft til å kjøre mange slike simuleringer, er det statistisk sett mer sannsynlig at vi lever i en simulering enn i den ene "basisvirkeligheten".

Teorien går ut på at en teknologisk moden "posthuman" sivilisasjon, gitt nok tid og dataressurser, vil kunne skape et stort antall simuleringer som er umulig å skille fra virkeligheten for de simulerte innbyggerne.

I dette scenariet vil antallet simulerte virkeligheter være langt større enn den ene basisvirkeligheten.

Hvis man ikke antar at vi for øyeblikket lever i den ene basisvirkeligheten, er det derfor statistisk sett mer sannsynlig at vi lever i en av de mange simuleringene.

Dette er et lignende argument som ideen om at i et univers med et stort antall planeter, er det mer sannsynlig at vi lever på en av de mange planeter som er egnet for liv i stedet for bare én.

"... det ville være rasjonelt å tenke at vi sannsynligvis er blant de simulerte sinnene snarere enn blant de opprinnelige biologiske. Hvis vi ikke tror at vi for øyeblikket lever i en datasimulering, har vi derfor ikke rett til å tro at vi vil få etterkommere som vil kjøre mange slike simuleringer av sine forfedre." - Nick Bostrom, Lever du i en datasimulering?, 2003.

Simuleringsteorien er kjent for sin tilknytning til Matrix-filmene, og ble nylig diskutert av Elon Musk og Joe Rogan.

Musk sa: "Vi befinner oss mest sannsynlig i en simulering", og "Hvis du antar en hvilken som helst forbedringstakt, vil spillene til slutt ikke være mulig å skille fra virkeligheten."

Ifølge simuleringsteorien kan AI-sivilisasjoner skape et stort antall komplekse syntetiske universer, med enorme konsekvenser for livet og selve universet. For å nevne tre eksempler:

- Det tilsynelatende fraværet av utenomjordisk liv kan være en parameter i selve simuleringen, som er designet for å studere hvordan sivilisasjoner utvikler seg i isolasjon.

- Skaperne av vår hypotetiske simulering kan være de samme AI-enhetene som vi postulerer om, og som studerer sin egen opprinnelse gjennom utallige simulerte scenarier.

- Fysikkens lover, slik vi forstår dem, inkludert begrensninger som lysets hastighet, kan være konstruksjoner av simuleringen, og ikke gjenspeile den sanne naturen til universet "utenfor".

Selv om den er svært spekulativ, gir simuleringsteorien et annet perspektiv på Fermi-paradokset og den mulige rollen avansert kunstig intelligens kan spille i den kosmiske evolusjonen.

Selv om det i dag er helt utenkelig, vil simuleringsteorien få økt troverdighet hvis vi realiserer former for ASI.

Å omfavne det ukjente

Dette er en til syvende og sist snever eksistensdiskusjon, som spenner over både det naturlige, det åndelige, det teknologiske og det metafysiske.

Det er umulig for oss mennesker å forstå vår rolle på denne lille scenen i en enorm kosmisk arena. Etter hvert som vi fortsetter å utvikle vår egen AI-teknologi, kan vi få ny innsikt i disse spørsmålene.

Kanskje vi vil oppleve at vi er på vei mot et stort filter, eller kanskje vi finner måter å skape kunstig intelligens på som opprettholder den ekspansjonsdriften vi i dag forbinder med den menneskelige sivilisasjonen. Menneskeheten kan også rett og slett være ekstremt arkaisk, og så vidt ha våknet opp fra en teknologisk mørketid, mens det finnes uforståelig utenomjordisk liv rundt oss.

Uansett kan vi bare se opp mot stjernene og se innover, på livets utvikling og bane på planeten Jorden.

Uansett hva svarene er, om det i det hele tatt finnes noen, er det fortsatt vår søken etter å forstå vår plass i kosmos som driver oss fremover.

Det gir oss nok å gjøre, enn så lenge.