Tesla er satt til å slå på bryteren på sin nye $300M superdatamaskin på mandag i et løft for sitt fulle selvkjøringsprogram (FSD).

Tilnærmingen Tesla tar med sin selvkjørende teknologi kommer til å kreve mye datakraft.

Elon Musk gjorde en live demo av Teslas FSD V12 for noen dager tilbake, og selv om det fungerte veldig bra, var det noen få feil. Systemet er fortsatt i betaversjon og er en ambisiøs versjon av selvkjørende kjøretøy, fordi det utelukkende baserer seg på kameraer uten hjelp fra radar- eller lidarsensorer.

I en tweet sa Musk: "Det som også er overveldende, er at inferensberegningskraften som trengs for 8 kameraer som kjører ved 36FPS, bare er omtrent 100W på den Tesla-designede AI-datamaskinen. Denne lille mengden kraft er nok til å oppnå overmenneskelig kjøring!"

Det gjelder kanskje datakraften som kreves i kjøretøyet, men det er bare mulig når den kunstige intelligensen har fått skikkelig opplæring.

Musk forklarte behovet for Teslas datainvestering ved å si at "å nå overmenneskelig kjøring med AI krever milliarder av dollar per år i treningsberegning og datalagring, samt et stort antall kjørte kilometer."

Og det er her Teslas nye superdatamaskin kommer inn i bildet. Datamaskinen består av 10 000 Nvidia H100 Compute GPU-er. Det gjør den til en av de kraftigste superdatamaskinene i verden.

Tesla har for øyeblikket 4 millioner biler på veien som kan legges til i treningsdatasettet, og det forventes 10 millioner i løpet av få år. Det er mye video å gå gjennom.

Tim Zaman, en av Teslas AI Engineering-ledere, sa: "På grunn av videotrening i den virkelige verden kan vi ha de største treningsdatasettene i verden, med en hot tier-cache-kapasitet på over 200 PB - mye mer enn LLM-er."

Teslas nye datamaskin vil levere 340 FP64 PFLOPS for teknisk databehandling og 39,58 INT8 ExaFLOPS for AI-applikasjoner.

Hvis disse tallene ikke sier deg så mye, er de bedre enn Leonardo, som er nummer fire på listen over verdens beste superdatamaskiner.

Nvidia klarer ikke å henge med

Nvidias H100 GPU-er utfører AI-trening opptil 9 ganger raskere enn A100-prosessorene Tesla har brukt frem til nå. Og det er fortsatt ikke tilstrekkelig for Teslas behov.

Så hvorfor kjøper de ikke bare flere GPU-er? Fordi Nvidia ikke har kapasitet til å levere dem raskt nok.

Men Tesla venter ikke på at Nvidia skal øke produksjonen. De siste årene har de bygget sin egen superdatamaskin, Dojo, basert på brikker Tesla har designet selv.

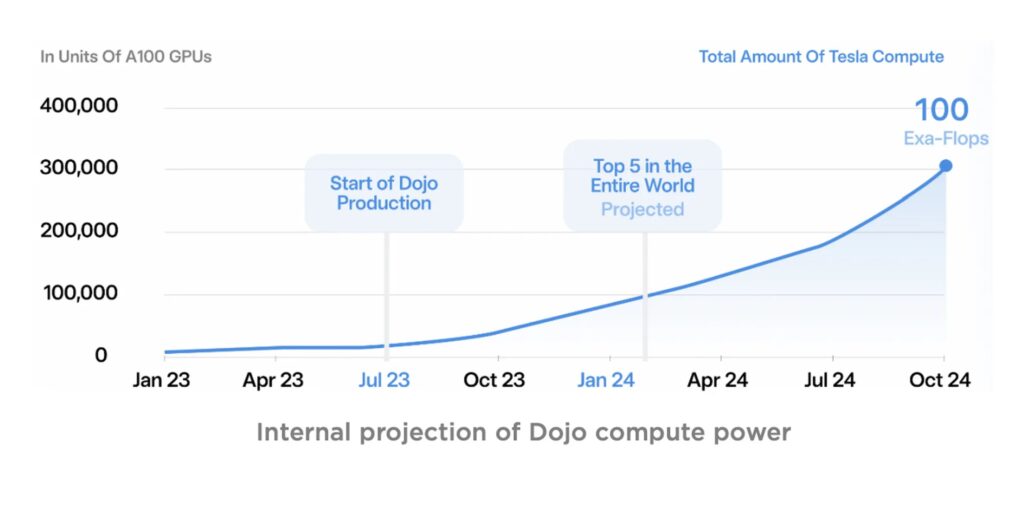

Dojo forventes å komme i drift mot slutten av 2024 og vil være enda kraftigere enn Teslas Nvidia-klynge.

Kilde: Tesla

Det må være en tøff jobb å være produksjonssjef hos Nvidia for tiden, med den umettelige etterspørselen etter Nvidias GPU-er.

Interessant nok ble Musk sitert på å si: "Ærlig talt ... hvis de (NVIDIA) kunne levere oss nok GPU-er, trenger vi kanskje ikke Dojo."

Vi har en tendens til å tenke på Tesla som et elbilselskap, men i økende grad ser det ut til at det faktisk er et selskap som driver med superdatabehandling av kunstig intelligens.

Det blir interessant å se hvordan den eksponentielle økningen i datakraft driver Musks ambisjoner med både Tesla og xAI-prosjektet hans.