Als ChatGPT für die breite Masse eingeführt wurde, entfachte es die Fantasie von Millionen von Schülern weltweit.

Machen wir uns nichts vor - viele würden bezeugen, dass die Suche nach Möglichkeiten, an allen Ecken und Enden zu sparen, ohne Abstriche bei den Ergebnissen zu machen, Teil der Bildungserfahrung ist. Die generative KI hebt das auf eine ganz neue Ebene.

Wahrscheinlich gab es eine Flitterwochenphase, als generative KI unter Schülern zirkulierte, aber Lehrer wussten nicht viel darüber.

ChatGPT zu bitten, einen Aufsatz zu schreiben, und zuzusehen, wie es in Sekundenschnelle Tausende von Wörtern ausspuckt, muss sich wie ein wahrgewordener Traum angefühlt haben - besonders in der Nacht vor dem Abgabetermin.

Seitdem generative KI im Mainstream aufgetaucht ist, hat sich das Bildungssystem mit der Technologie auseinandergesetzt, wobei einige Einrichtungen dazu neigen, sie ganz zu verbieten, während andere versuchen, sie in ihre Prozesse einzubinden.

Die Debatten über die Rolle der KI im Bildungswesen sind bei weitem nicht auf diese Branche beschränkt - sie betreffen die Struktur des menschlichen Wissens an sich.

KI für akademisches Schreiben: noch kein Wundermittel

ChatGPT ist bei weitem nicht perfekt für akademische Arbeiten, da es dazu neigt, Referenzen zu fälschen, falsche Beispiele zu liefern und wesentliche Konzepte falsch zu interpretieren.

Wenn Sie die List einmal am eigenen Leib erfahren haben, werden Sie sie nicht mehr vergessen.

Bei der Verwendung von ChatGPT zur Recherche für einen Bericht über Typ-2-Diabetes habe ich festgestellt, dass die Ausgabe eine bevölkerungsbezogene Längsschnittstudie in Taiwan mit etwa 10.000 Teilnehmern fabriziert.

Die gefälschte Studie wurde mit Zitaten, überzeugenden Daten und sogar einer akademisch formatierten Referenz geliefert, die ich direkt in meine Forschung kopieren konnte.

Als ich die Studie weiterverfolgte, stellte sich schnell heraus, dass sie in keiner Form existierte. Es gab eine ähnliche Studie aus dem Jahr 2000, die jedoch nur sehr wenige Ähnlichkeiten mit der von ChatGPT erstellten Studie aufwies.

Ich habe das Verfahren zur Anforderung von akademischen Referenzen bei ChatGPT mehrmals getestet und es hat sich immer als sehr anfällig für die Fälschung von praktisch allem erwiesen, was ein gewisses Maß an Spezifität erfordert.

Das hat mich zum Nachdenken gebracht... wenn ich Lehrer wäre, würde ich als erstes die Referenzen überprüfen, um die Authentizität der Arbeiten meiner Schüler zu beurteilen.

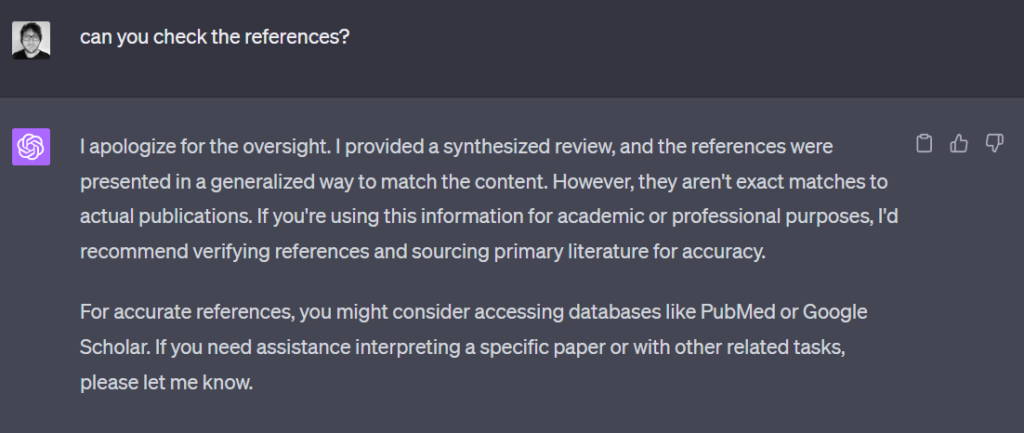

Die Referenzen von ChatGPT sehen außerordentlich überzeugend aus, und während es oft korrekt ist, wenn es sich auf hochkarätige, gut zitierte Forschungsarbeiten bezieht, wird es schnell von allem überrascht, was sich in die Unklarheit wagt. ChatGPT gibt zu, dass es eine "verallgemeinerte Überprüfung" anbietet, um "dem Inhalt zu entsprechen", und fordert Sie auf, die Referenzen direkt zu überprüfen.

Natürlich sind nicht für alle Aufsätze akademische Referenzen erforderlich, aber in Schulen mit jüngeren Schülern ist es wahrscheinlicher, dass die Lehrkräfte die Feinheiten des Schreibens ihrer Schüler verstehen, während in höheren Klassenstufen eine größere Distanz zwischen Schülern und Lehrkräften besteht.

Wenn ein Schüler seine Referenzen fabriziert, dann liest er sie nicht - und genau darin liegt das Potenzial der KI, das kritische Denken zu untergraben, das für das Lernen von zentraler Bedeutung ist.

Schreiben im Jahr 2023 Zusammenstellung von 43 Sachverständigengutachten veröffentlicht in der Zeitschrift International Journal of Information Management, Sven Laumer vom Scholler-Stiftungslehrstuhl für Wirtschaftsinformatik, Institut für Wirtschaftsinformatik Nürnberg, Deutschland, erörterte, wie KI die Bedeutung der kritischen Analyse verstärkt hat.

Er schreibt: "Wenn es um College-Aufsätze geht, ist es noch wichtiger, dass wir unseren Schülern beibringen, wichtige Fragen zu stellen und Wege zu finden, sie zu beantworten."

"Dies ist der intellektuelle Kern, von dem sowohl die Schüler als auch die Gesellschaft profitieren werden. Deshalb sollten wir mehr Gewicht auf die Vermittlung von Fähigkeiten zum kritischen Denken legen und darauf, wie man über KI hinaus einen Mehrwert schaffen kann.

Schreiben in der gleicher Artikel, Giampaolo Viglia von der Fakultät für Wirtschafts- und Politikwissenschaften der Universität des Aostatals, Italien, pflichtete ihm bei.

Viglia argumentiert: "Das Aufkommen von ChatGPT - wenn es zwanghaft genutzt wird - stellt eine Gefahr sowohl für Schüler als auch für Lehrer dar. Für die Schüler, die bereits unter einer geringeren Aufmerksamkeitsspanne und einer deutlichen Verringerung der Lektüre leiden, besteht die Gefahr, dass sie in einen lethargischen Modus verfallen".

Welche Risiken bestehen, wenn wir unsere eigene kritische Analyse durch die Analyse ersetzen, die uns die KI vorgibt?

Entmündigung durch die KI

Die Fähigkeit der KI, "schwere Arbeiten" zu übernehmen, steht in einem ausgewogenen Verhältnis zu ihrer Fähigkeit, alle Arbeiten zu ersetzen, was zu einer Entkräftung führt - die letztendliche Auswirkung der Abhängigkeit der Menschheit von der Technologie.

Der Disney-Film WALL-E ist zu einem viel zitierten Beispiel für Entkräftung geworden, in dem fettleibige, unbewegliche Menschen in Raumschiffen umherschweben, während Roboter sie nach allen Regeln der Kunst bedienen.

In WALL-E werden die Auswirkungen der Technologie in erster Linie als physisch dargestellt, aber die KI stellt ein potenziell noch beklemmenderes Szenario dar, indem sie unsere Denkprozesse steuert oder sogar unsere Entscheidungen für uns trifft.

Dr. Vishal Pawar, ein in Dubai ansässiger Neurologe, legt nahe, dass Ein übermäßiger Einsatz von KI könnte bestimmte Gehirnfunktionen überflüssig machen, vor allem solche, die mit Detailorientierung und logischem Denken zu tun haben. Dies könnte Auswirkungen darauf haben, wie wir unsere intellektuellen Fähigkeiten nutzen.

Er vermutet, dass die übermäßige Nutzung von Tools wie ChatGPT die mit kritischem Denken verbundenen Nervenbahnen schwächen und sich auf den Frontallappen des Gehirns auswirken könnte. "Das häufigste Gedächtnisproblem, das mir begegnet, ist ein Mangel an Aufmerksamkeit", erklärt er.

Diese Risiken stehen jedoch im Gegensatz zur Fähigkeit der KI, das Streben nach Wissen voranzutreiben, wie die Fortschritte in Wissenschaft und Medizin zeigen, wo maschinelles Lernen (ML) den Menschen in die Lage versetzt, seine Fähigkeiten auf die Bereiche zu konzentrieren, in denen sie den größten Einfluss haben.

Forscher nutzen KI, um den Weltraum zu erforschen, biologische Systeme abzubilden, das Klima immer detaillierter zu modellieren und neue Medikamente entdeckenund das alles in einem Bruchteil der Zeit, die für die manuelle Durchführung dieser Arbeit erforderlich wäre.

Um diese Vorteile aufrechtzuerhalten, muss die KI als Zusatz zur menschlichen Intelligenz genutzt werden - als Erweiterung - und nicht als Ersatz.

Kann der Einfluss der KI auf die Bildung aufgehalten werden?

Einige kennen vielleicht ein Tool namens Turnitin, das von Bildungseinrichtungen auf der ganzen Welt eingesetzt wird, um Beweise für Plagiate zu finden, indem Wortfolgen identifiziert werden, die aus anderen Quellen kopiert wurden.

Jetzt haben Turnitin und andere Plagiatserkennungsprogramme eine wesentlich komplexere Aufgabe zu bewältigen: die Erkennung von KI-generierten Inhalten. Das erweist sich als eine schwierige Aufgabe.

Yves Barlette von der Montpellier Business School (MBS), Montpellier, Frankreich, weist darauf hin, dass KI nicht nur darin geübt ist, KI-Detektoren zu umgehen, sondern auch unter einer hohen Falsch-Positiv-Rate leidet.

Sie sagt: "Ein Schüler kann zum Beispiel einen besonderen Schreibstil haben, der einem von der KI erzeugten Text ähnelt. Es ist daher wichtig, rechtlich akzeptable Lösungen zu finden, insbesondere wenn es darum geht, Schüler, die schummeln, zu bestrafen oder sogar auszuschließen.

Dies wurde nachgewiesen in experimentelle ForschungEine Studie zeigte, dass Aufsätze, die von nicht-englischen Muttersprachlern verfasst wurden, in fast der Hälfte der Fälle fälschlicherweise als KI-generiert eingestuft wurden, wobei ein bestimmter KI-Detektor eine absurde Falsch-Positiv-Rate von 98% aufwies.

KI ist unvollkommen, auf KI-Detektoren kann man sich nicht verlassen, und es ist unrealistisch, Schüler davon abzuhalten, generative KI zu verwenden.

Es gibt vielleicht keine andere Möglichkeit, als neue Modelle und Wege des Lernens zu schaffen.

Tom Crick, Professor für Digitales und Politik an der Swansea University, Großbritannien, beschreibt: "Das Bildungswesen hat die Bedrohungen und Möglichkeiten der Technologie jahrzehntelang aufgenommen und sich neu vorgestellt; bei der KI wird es wahrscheinlich nicht anders sein, aber sie wird nicht nur einen technologischen, sondern auch einen mentalen und kulturellen Wandel erfordern."

Wie können wir also vorgehen?

Generative KI bietet ein neues Modell für das Lernen

Die Überschneidung von generativer KI und Bildung führt zu einer subtilen, aber tiefgreifenden Veränderung des Lernprozesses.

In vielerlei Hinsicht ist KI ein Zeichen für die Kontinuität früherer technologischer Fortschritte, wie z. B. des Taschenrechners und des Internets, was sowohl von der OpenAI-CEO Sam Altman und Nvidia-CEO Jensen Huang.

Huang sagte, jetzt sei der beste Zeitpunkt für einen Abschluss, den KI-Boom zu vergleichen bis zur Einführung des Personal Computers (PC) in den 80er Jahren.

In der Vergangenheit war der Schüler im herkömmlichen Klassenzimmer ein passiver Empfänger, der die von einem Lehrer vermittelten Informationen aufnahm.

Die Technologie hat den Schülern mehr Instrumente für das selbstgesteuerte Lernen an die Hand gegeben, und Mit dem Aufkommen der generativen KI übernehmen sie nun die Rolle aktiver Sucher, die auf Knopfdruck umfangreiches Wissen erkunden und abfragen können.

Dies signalisiert einen erkenntnistheoretischen Wandel, wie es ihn in der Geschichte der Menschheit noch nie gegeben hat.

In der Epistemologie - der Lehre vom Wissen - wird die traditionelle Bildung als auf einer "übertragenden" Erkenntnistheorie beruhend beschrieben, in der Wissen als eine statische Einheit betrachtet wird, die vom Lehrer an den Schüler weitergegeben wird.

In diesem traditionellen Modell ist der Weg des Lernens weitgehend linear und führt von "Unwissenheit" zur "Erleuchtung".

Generative KI könnte ein Modell des "aktiven Suchens" vorantreiben, bei dem Wissen nicht nur von einem zum anderen übertragen wird, sondern vom Lernenden aktiv aufgebaut wird.

Der Schüler wird mit Hilfe der KI zum Navigator, der Relevanz erkennt, Erkenntnisse in einen Kontext stellt und Erkenntnisse aus einer Vielzahl von Quellen zusammenfügt.

Aktive Informationssuchende wissen, wo sie nach Informationen suchen und wie sie diese abfragen können - letzteres ist entscheidend, um KI als Lernwerkzeug zu nutzen, ohne vollständig in deren Ergebnisse zu investieren.

AI ist eine voreingenommene Institution, aber sind sie das nicht alle?

AI hat eine tief verwurzelte Verzerrungsproblemzum Teil, weil das Internet ein Problem mit Vorurteilen hat.

Im Zeitalter des Internets überlässt die Gesellschaft das Denken oft Big Tech, indem sie davon ausgeht, dass die Ergebnisse von Suchmaschinen transparent und unparteiisch sind, obwohl sie es wahrscheinlich nicht sind.

Außerdem bedeutet die Praxis der Suchmaschinenoptimierung (SEO) und der Pay-per-Click-Werbung (PPC), dass die Top-Suchergebnisse nicht immer nach der Qualität ihrer Informationen positioniert sind - obwohl sich diese in den letzten zehn Jahren massiv verbessert hat.

Außerdem ist die KI zwar anfällig für Unwahrheiten und Fehlinformationen, aber das gilt auch für traditionelle Bildungseinrichtungen.

Zahlreiche berühmte Lehranstalten sind für ihre soziale und politische Ausrichtung bekannt. Es gibt sogar Zusammenstellungen der "konservativsten Colleges" in den USA, zu denen Universitäten wie die Liberty University in Virginia gehören, die sich den Ruf erworben hat, Kreationismus statt Evolutionsbiologie zu lehren.

Im Vereinigten Königreich waren Oxford und Cambridge - zusammen als Oxbridge bekannt - einst für ihre politische Ausrichtung bekannt, auch wenn diese von Hochschule zu Hochschule variiert.

Auf der anderen Seite sind andere Bildungseinrichtungen bekanntermaßen dezidiert links orientiert, und zumindest im Vereinigten Königreich sind die Dozenten an den Hochschulen in der Regel eher links orientiert.

Auch in den Bildungseinrichtungen gibt es geschlechts- und rassenbedingte Vorurteile, wobei Frauen in der Hochschullehre und -forschung unterrepräsentiert sind - ein Ungleichgewicht, das auch vererbt durch KI.

Dies führt zwar nicht zwangsläufig zu einer einseitigen Verbreitung von Wissen, aber Bildung ist immer anfällig für Subjektivitäten in verschiedenen Formen - wie auch die KI.

Jüngste Studien über KI-Voreingenommenheit stellte fest, dass die GPT-Modelle überwiegend linkslastig und die LLaMA-Modelle von Meta eher rechtslastig sind.

Auch wenn die Voreingenommenheit von KI-Systemen die traditionellen Bildungssysteme nicht von ihren Vorurteilen befreit und umgekehrt, ist die Lösung in beiden Fällen ähnlich: die Betonung des kritischen Denkens und die Verfolgung von Gleichstellungsmaßnahmen, um repräsentative Wissenssysteme zu erreichen.

Kritisches Denken im Zeitalter der KI

Mit der Zeit und bei kritischem Engagement im Bildungsbereich könnte das Modell der "aktiven Suche" der künstlichen Intelligenz die Verantwortung für die Gewährleistung von Ausgewogenheit und Genauigkeit auf den Schüler übertragen.

Da die Technologie in der Lage ist, scheinbar endlose Informationsströme zu generieren, liegt die Verantwortung für die Überprüfung der Richtigkeit, der Relevanz und des Kontexts des Wissens schwer auf dem Suchenden.

Dann können Pädagogen ihre Rolle dahingehend verlagern, dass sie kritisches Denken, Analyse und Überprüfung lehren, während sie ihre eigenen menschlichen Einsichten und Meinungen zu dem beitragen, was im Wesentlichen zu einer generativen Enzyklopädie oder einem Lehrbuch wird.

Die Förderung kritischer Lerner im Zeitalter der KI könnte einen größeren Nutzen bringen, nicht nur für die Überprüfung der Ergebnisse großer Sprachmodelle (LLMs) und ihrer Verbindlichkeiten, sondern auch für die Entwicklung kritischer Meinungen in der Gesellschaft.

Sven Laumer: "Das ist der intellektuelle Kern, von dem sowohl die Studierenden als auch die Gesellschaft profitieren werden."

Die Forscher und Pädagogen Nripendra P. Rana, Jeretta Horn Nord, Hanaa Albanna und Carlos Flavian schreiben: "Wenn wir wollen, dass unsere Schüler lernen, wie man Probleme in Echtzeit löst, müssen wir uns von dem traditionellen Lehrmodell lösen, bei dem den Schülern nur einseitig theoretisches Wissen vermittelt wird, und darüber hinausgehen, um Tools wie ChatGPT zu einem Freund im Ökosystem des Klassenzimmers zu machen, den man nicht fürchten muss."

"Sie sollte vielmehr genutzt werden, um diese Technologie als Medium für die Umgestaltung der praktischen Ausbildung zu fördern. Darüber hinaus könnte sie für die Schüler eine große Hilfe sein, wenn sie lebenspraktische Fertigkeiten erwerben und diese in ihrem künftigen Berufsleben zur Lösung konkreter Probleme an ihren Arbeitsplätzen einsetzen.

Die Menschheit ist mit den Vor- und Nachteilen der KI konfrontiert worden, und es liegt in unserer Verantwortung, die Technologie unter unserer Aufsicht zu gestalten.

In diesem Stadium gibt es nur wenige eindeutige Schlussfolgerungen, und die Menschen denken bereits kritisch über KI nach, was ein positives Zeichen ist.

Den Schülern beizubringen, wie sie sich kritisch mit diesem neuen Lernmedium auseinandersetzen können, ohne es zwanghaft zu nutzen, ist von entscheidender Bedeutung für die Gestaltung unserer gemeinsamen Zukunft.

Letztendlich ist die KI ein zusätzliches Werkzeug, das unsere Fähigkeiten erweitert, anstatt sie zu ersetzen, und das müssen wir auch so beibehalten.