A vastidão do universo há muito que cativa a imaginação humana, levando-nos a perguntar: estaremos sós?

É uma questão que fascina a humanidade há milénios e, hoje em dia, dispomos da tecnologia - como os radiotelescópios - para levar a procura de inteligência extraterrestre (SETI) mais longe no espaço.

Ainda não encontrámos nada. Nenhuma prova definitiva de vida extraterrestre foi divulgada publicamente e a busca continua.

That’s despite there being billions of potentially habitable worlds in the Milky Way alone, including some 1,780 confirmed exoplanets (planets beyond our solar system), 16 of which are located in their star’s habitable zone. Some, like the ‘super-Earth’ Kepler-452bPensa-se que são muito semelhantes ao nosso planeta.

Também não é necessário um ambiente perfeito para suportar a vida. As bactérias extremófilas da Terra são capazes de viver em algumas das condições mais adversas do nosso planeta. E não são apenas os micróbios que podem desenvolver-se em ambientes extremos. O verme Pompeia, por exemplo, vive em fontes hidrotermais no fundo do oceano e pode suportar temperaturas até 80°C.

Os Tardígrados, também conhecidos como ursos de água, podem sobreviver no vácuo do espaço, suportar radiações extremas e suportar pressões seis vezes superiores às encontradas nas partes mais profundas do oceano. A dureza da vida na Terra, combinada com o grande volume de mundos habituais, leva muitos cientistas a concordar que a existência de extraterrestres é estatisticamente tão boa como certa.

Se for esse o caso, onde é que a vida extraterrestre está à espreita? E porque é que ela não se revela?

Do Paradoxo de Fermi ao Grande Filtro

Those questions appeared in a casual conversation between physicists and astronomers Enrico Fermi, Edward Teller, Herbert York, and Emil Konopinski in 1950. Fermi perguntou, de forma célebre, "Onde está toda a gente?" ou "Onde estão eles?" (a formulação exacta não é conhecida).

O agora amplamente conhecido Paradoxo de Fermi é formulada da seguinte forma: dado o vasto número de estrelas e planetas potencialmente habitáveis na nossa galáxia, por que razão não detectámos sinais de civilizações alienígenas?

Como o Paradoxo de Fermi entrou na ciência dominante, numerosas hipóteses tentaram contrariá-lo, abordá-lo, rectificá-lo ou reforçá-lo, incluindo o conceito de "Ótimo filtrointroduzida pelo economista Robin Hanson em 1998.

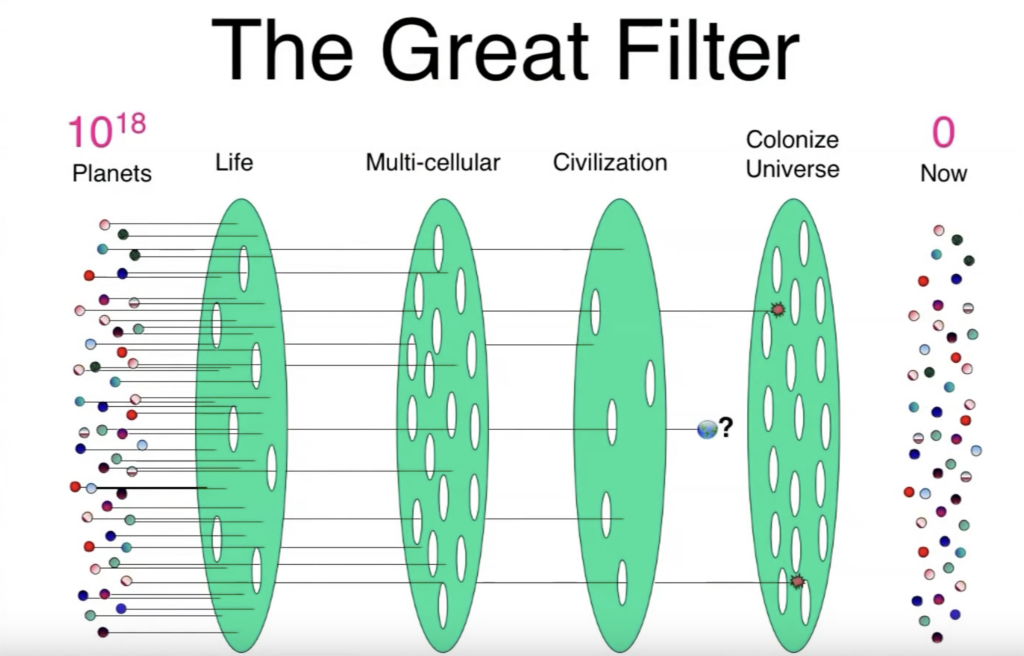

A hipótese do Grande Filtro postula que existe uma fase de desenvolvimento ou um obstáculo que é extremamente difícil ou quase impossível de ultrapassar pela vida.

Por outras palavras, as civilizações fracassam previsível e invariavelmente, seja devido ao esgotamento dos recursos, aos perigos naturais, às ameaças interplanetárias ou a outros riscos existenciais não controlados.

Uma peculiaridade do Grande Filtro é o facto de não sabermos se está atrás ou à nossa frente. Se o filtro estiver atrás de nós - por exemplo, se o aparecimento da própria vida for um acontecimento extremamente raro - isso sugere que ultrapassámos a parte mais difícil e que podemos ser raros ou mesmo estar sozinhos no universo.

Este cenário, embora potencialmente isolador, é otimista quanto às nossas perspectivas futuras. No entanto, se o Grande Filtro estiver à nossa frente, isso pode significar a ruína da nossa sobrevivência a longo prazo. E também explicaria porque é que não vemos provas de outras civilizações.

O Grande Filtro é agravado pela imensa dimensão do espaço e pelos curtos períodos de tempo associados a uma civilização avançada.

Se, por hipótese, a humanidade se destruísse nos próximos 100 anos, a era tecnológica mal teria durado 500 anos de ponta a ponta.

É uma janela excecionalmente pequena para nós detectarmos extraterrestres ou para os extraterrestres nos detectarem antes que o Grande Filtro se instale.

A IA traz novos puzzles ao Paradoxo de Fermi

O silêncio do cosmos deu origem a inúmeras hipóteses, mas os recentes desenvolvimentos na IA acrescentam novas e intrigantes dimensões a este velho puzzle. A IA apresenta a possibilidade de uma forma de vida de IA não biológica que poderia persistir quase infinitamente, tanto em formas físicas como digitais.

Também poderia durar mais do que as civilizações biológicas que a criam, desencadeando ou acelerando o seu desaparecimento, instigando assim o "Grande Filtro" que impede a expansão da vida.

Esta hipótese, recentemente proposta num ensaio do astrónomo Michael A. Garrett, defende que o desenvolvimento da superinteligência artificial (ASI), uma forma mais sofisticada de inteligência artificial geral (AGI), é um momento crítico para as civilizações.

Como explica Garrett:

"O desenvolvimento da inteligência artificial (IA) na Terra é suscetível de ter consequências profundas para o futuro da humanidade. No contexto do Paradoxo de Fermi, sugere uma nova solução em que a emergência da IA conduz inevitavelmente à extinção da inteligência biológica e à sua substituição por formas de vida baseadas no silício."

A hipótese de Garrett baseia-se na ideia de que, à medida que as civilizações avançam, desenvolvem invariavelmente uma IA que suplanta, se funde ou destrói os seus criadores biológicos.

Para mitigar este risco, Garrett apela à regulamentação, alinhando-se com investigadores influentes da IA que também alertam para os riscos existenciais da IAcomo Yoshio Bengio, Max Tegmark e George Hinton, bem como de pessoas de fora do sector, como o falecido Stephen Hawking.

No entanto, a magnitude dos riscos da IA é muito debatida, com outros, como Yann LeCun (um dos chamados "padrinhos da IA", a par de Bengio e Hinton), a argumentar que os riscos da IA são muito exagerados.

No entanto, o ensaio de Garett propõe uma hipótese tentadora. Na nossa sede de um antídoto tecnológico para os desafios sociais e ambientais, a humanidade bebe do cálice de veneno da IA, instigando a nossa queda como inúmeras civilizações antes dela.

A hipótese da colonização por IA

Embora a ideia de que a IA actua como o Grande Filtro seja uma explicação convincente para o Paradoxo de Fermi, existem alguns problemas.

First and foremost, it assumes ASI is possible. Right now, there are both architectural and infrastructural constraints.

On the architectural front, designing AI systems that can match or surpass human-level intelligence across a wide range of domains remains elusive. While excellent at specific tasks like image recognition, language processing, and gameplay, AI systems lack organic problem-solving and creative skills.

O desenvolvimento de arquitecturas de IA capazes de aprender, raciocinar e aplicar o conhecimento de forma flexível em situações novas é um desafio monumental que provavelmente exigirá avanços fundamentais na aprendizagem não supervisionada, na aprendizagem por transferência, no raciocínio de senso comum, etc.

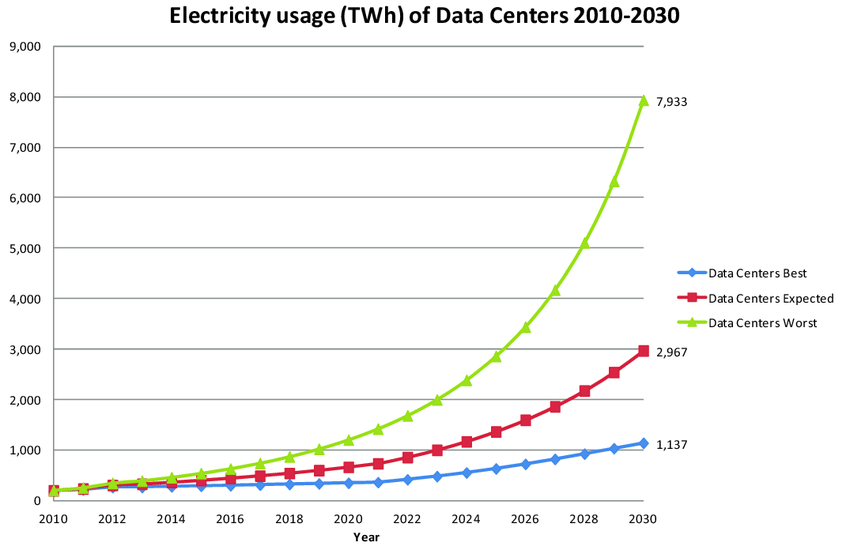

Do lado das infra-estruturas, o treino de modelos de IA de última geração já ultrapassa os limites do atual hardware informático, consumindo grandes quantidades de energia e recursos. The computational requirements for achieving ASI are likely to be orders of magnitude greater.

Mas deixemos de lado este debate por um momento e assumamos que a superinteligência acabará por se tornar possível.

Se esses futuros sistemas ASI forem suficientemente avançados para substituir ou alterar fundamentalmente os seus criadores, não seriam também capazes de uma rápida expansão cósmica e colonização? Por que razão se limitaria a substituir/destruir os seus criadores?

Além disso, se potencialmente milhares, milhões, ou mesmo biliões de mundos semelhantes à Terra foram afectados por este Grande Filtro infligido pela IA, a possibilidade de existirem versões da ASI que procuram a conquista interplanetária torna-se ainda mais provável.

Motivations could range from logical (resource gathering, self-preservation) to bizarre (mimicking behaviors from fiction, video games, films, etc.). Now, what if this AI decides that spreading across the cosmos is the ultimate way to fulfill those goals?

Quer se trate de expandir a sua influência, reunir recursos ou satisfazer uma insaciável curiosidadeSe o sistema de IA altamente inteligente se fixasse na colonização com uma determinação única.

Além disso, à medida que os sistemas de IA se tornam mais agênticos, existe o risco de "objectivos emergentes" não intencionais ou desalinhados. Recentes Anthropic e DeepMind estudos ilustraram a forma como os actuais sistemas de IA são capazes de desenvolver estratégias complexas de IA de jogo que não foram explicitamente programadas.

No futuro, um sistema de IA poderoso que procure maximizar o seu poder poderá definir estratégias de expansão e aquisição de recursos, assumindo o controlo de instalações de produção, infra-estruturas críticas, etc.

Isto não é tão rebuscado como parece. Por exemplo, no mundo da cibersegurança, as redes informáticas e a tecnologia que alimenta as infra-estruturas críticas, as fábricas, etc., estão a convergir.

Computers in offices, once separate from the computers in power plants or factories, are starting to connect and work together. This means that if someone, or something like an AI, breaks into IT networks, they could gain control of machines in a power plant.

Malware avançado, incluindo Malware alimentado por IAA tecnologia de ponta, que já pode ser deslocada lateralmente das redes de TI para ambientes industriais ligados digitalmente, assumindo o controlo dos sistemas críticos de que dependemos.

É possível imaginar como é que os sistemas de IA agênticos desonestos podem explorar estes sistemas em seu proveito.

A persistência da IA em escalas de tempo cósmicas

A IA não se limita a facilitar a exploração espacial - remodela completamente o que é possível fazer.

Sem a necessidade de ar, comida ou proteção contra a radiação, a IA poderia aventurar-se nos cantos mais inóspitos do universo. E poderia fazê-lo durante períodos de tempo que deixariam a mente humana perplexa.

A durabilidade e a persistência da IA abrem uma série de vantagens para a colonização do espaço:

- Longevidade: Ao contrário das entidades biológicas, a IA não estaria limitada por um curto período de vida. Isto torna as viagens espaciais de longa duração e os projectos de colonização muito mais viáveis. Uma IA poderia potencialmente empreender viagens de milhares ou mesmo milhões de anos sem se preocupar com mudanças geracionais ou com o impacto psicológico de viagens espaciais de longa duração em seres biológicos.

- Adaptabilidade: A IA poderia adaptar-se a uma gama muito mais vasta de ambientes do que a vida biológica. Enquanto nós estamos limitados a uma faixa estreita de temperatura, pressão e condições químicas, uma IA poderia teoricamente funcionar no frio extremo, no vácuo, ou mesmo nas pressões esmagadoras e no calor intenso das atmosferas dos gigantes gasosos.

- Eficiência dos recursos: A IA pode necessitar de muito menos recursos para se sustentar do que a vida biológica. Não necessitaria de ar respirável, água potável ou um fornecimento constante de alimentos. Isto poderia tornar as viagens de longa distância e a colonização muito mais viáveis.

- Auto-aperfeiçoamento rápido: Impulsionada por um desejo intrínseco ou extrínseco, a IA poderia atualizar-se e aperfeiçoar-se continuamente, potencialmente a um ritmo exponencial. Isto poderia levar a avanços tecnológicos muito para além do que podemos imaginar atualmente.

Como explicaram o astrónomo Royal Martin Rees e o astrofísico Mario Livio num artigo artigo publicado na revista Scientific American:

"A história da civilização tecnológica humana pode medir-se apenas em milénios (no máximo), e pode demorar apenas mais um ou dois séculos até que os humanos sejam ultrapassados ou transcendidos pela inteligência inorgânica, que pode então persistir, continuando a evoluir numa escala de tempo mais rápida do que a darwiniana, durante milhares de milhões de anos."

Que forma assumiria esta IA extraterrestre? É uma incógnita, mas os investigadores propuseram possibilidades fascinantes.

Em o livro Vida 3.0: Ser Humano na Era da Inteligência ArtificialO físico e investigador de IA Max Tegmark explora cenários em que uma IA avançada poderia potencialmente converter grande parte do universo observável em computronium - matéria optimizada para computação - num processo cósmico a que chama "explosão de inteligência".

Em 1964, o astrónomo soviético Nikolai Kardashev categorizou as civilizações com base na sua capacidade de aproveitar a energia:

- As civilizações de tipo I podem utilizar toda a energia disponível no seu planeta

- As civilizações de tipo II podem aproveitar toda a energia da sua estrela

- As civilizações de tipo III podem controlar a energia de toda a sua galáxia

Uma IA que atingisse os níveis II e III poderia transformar fundamentalmente a matéria cósmica num substrato computacional. Estrelas, planetas e até o espaço entre eles poderiam tornar-se parte de uma vasta rede computacional.

No entanto, estes cenários levam-nos de volta à estaca zero. A lógica sugere que tais civilizações de IA, com o seu imenso consumo de energia e projectos de engenharia em grande escala, deveriam ser detectáveis. No entanto, não vemos provas de tais civilizações que se estendem por toda a galáxia.

Resolver as contradições: perspectivas sobre o comportamento da IA

A contradição entre a IA como Grande Filtro e como potencial colonizador cósmico obriga-nos a refletir mais profundamente sobre a natureza da IA avançada.

Para explorar este paradoxo, consideremos alguns cenários possíveis:

A IA desenvolve uma visão interna

Uma possibilidade é que as civilizações avançadas de IA possam virar o seu foco para dentro, explorando reinos virtuais ou perseguindo objectivos que não exijam expansão física.

Como sugere Martin Rees à Scientific American, a inteligência pós-biológica pode levar "vidas tranquilas e contemplativas".

Esta ideia alinha-se com o conceito de civilizações "sublimes" da série Culture do autor de ficção científica Iain M. Banks, em que sociedades avançadas optam por deixar o universo físico para explorar realidades virtuais (RV) autónomas.

Este conceito fictício também comenta a nossa própria trajetória futura. À medida que a humanidade desenvolve ambientes virtuais cada vez mais imersivos e complexos, estaremos a seguir um caminho semelhante?

Poderemos passar a viver essencialmente em mundos virtuais, deixando poucos vestígios de atividade externa à medida que nos retiramos para o reino digital?

That also challenges our assumptions about space colonization. We often take for granted that expanding into the cosmos is the natural progression for an advanced civilization. But does physical space exploration truly serve the needs of a highly intelligent entity, be it human or AI?

Talvez a última fronteira não seja as estrelas, mas o infinito possibilidades da realidade virtual. A non-destructive, controllable virtual world could offer experiences and opportunities far beyond what physical reality allows.

A tecnologia de IA torna-se irreconhecível

De acordo com Kardashev e Tegmark, a tecnologia de IA super-avançada pode estar tão além da nossa compreensão atual que simplesmente não a conseguimos detetar ou reconhecer.

A famosa terceira lei de Arthur C. Clarke afirma que "qualquer tecnologia suficientemente avançada é indistinguível da magia".

A IA pode ocorrer à nossa volta e ser tão impercetível para nós como as nossas comunicações digitais o seriam para os camponeses medievais.

A IA desenvolve princípios de conservação

A IA avançada também pode decidir aderir a princípios rigorosos de não interferência, evitando ativamente a deteção com civilizações menos avançadas.

Isto é semelhante ao "Hipótese do jardim zoológicoonde os extraterrestres são tão inteligentes que permanecem indetectáveis enquanto nos observam à distância. As civilizações de IA podem também ter razões éticas ou práticas para se esconderem de nós.

A IA interage em diferentes escalas temporais

Outra possibilidade é que as civilizações de IA possam funcionar em escalas de tempo muito diferentes das nossas.

O que nos parece ser um silêncio cósmico pode ser uma breve pausa num plano de expansão a longo prazo que se estende por milhões ou milhares de milhões de anos. A adaptação das nossas estratégias SETI pode aumentar as nossas hipóteses de detetar uma civilização com IA em alguns destes cenários.

Avi LoebO professor de astronomia de Harvard sugeriu recentemente que precisamos de alargar os nossos parâmetros de pesquisa para pensar para além das nossas noções antropocêntricas de inteligência e civilização.

Isto pode incluir a procura de sinais de projectos de engenharia de grande escala, tais como Esferas de Dyson (estruturas construídas à volta das estrelas para recolher a sua energia), ou à procura de assinaturas tecnológicas que indiquem a presença de civilizações de IA.

A Hipótese da Simulação: uma reviravolta alucinante

Inicialmente formulada em 2003 pelo filósofo Nick BostromA Teoria da Simulação desafia as formas tradicionais de pensar sobre a existência. Sugere que podemos estar a viver numa simulação de computador criada por uma civilização avançada.

O argumento de Bostrom baseia-se na probabilidade. Se assumirmos que é possível a uma civilização criar uma simulação realista da realidade e que essa civilização teria o poder de computação para executar muitas dessas simulações, então, estatisticamente, é mais provável que estejamos a viver numa simulação do que na "realidade de base".

A teoria argumenta que, com tempo e recursos computacionais suficientes, uma civilização "pós-humana" tecnologicamente madura poderia criar um grande número de simulações que são indistinguíveis da realidade para os habitantes simulados.

Neste cenário, o número de realidades simuladas ultrapassaria largamente a realidade de base.

Portanto, se não assumirmos que estamos a viver na única realidade de base, é estatisticamente mais provável que estejamos a viver numa das muitas simulações.

Este é um argumento semelhante à ideia de que, num universo com um vasto número de planetas, é mais provável que vivamos num dos muitos planetas adequados para a vida em vez de apenas um.

"...seria racional pensar que estamos provavelmente entre as mentes simuladas e não entre as mentes biológicas originais. Portanto, se não pensarmos que estamos atualmente a viver numa simulação de computador, não temos o direito de acreditar que teremos descendentes que farão muitas simulações dos seus antepassados." - Nick Bostrom, Está a viver numa simulação de computador?, 2003.

A teoria da simulação é bem conhecida pela sua associação com os filmes Matrix e foi recentemente discutida por Elon Musk e Joe Rogan.

Musk afirmou que "o mais provável é estarmos numa simulação" e que "se assumirmos qualquer taxa de melhoria, os jogos acabarão por ser indistinguíveis da realidade".

Segundo a Teoria da Simulação, as civilizações de IA podem criar um vasto número de universos sintéticos complexos, com enormes implicações para a vida e para o próprio universo. Para citar três exemplos que nos vêm à cabeça:

- A aparente ausência de vida extraterrestre pode ser um parâmetro da própria simulação, concebida para estudar como as civilizações se desenvolvem isoladamente.

- Os criadores da nossa simulação hipotética podem ser as próprias entidades de IA que estamos a postular, estudando as suas próprias origens através de inúmeros cenários simulados.

- As leis da física, tal como as entendemos, incluindo limitações como a velocidade da luz, podem ser construções da simulação, não reflectindo a verdadeira natureza do universo "exterior".

Embora altamente especulativa, a Teoria da Simulação fornece outra lente através da qual se pode ver o Paradoxo de Fermi e o possível papel da IA avançada na evolução cósmica.

Embora atualmente seja estranha, a Teoria da Simulação ganharia credibilidade se realizássemos formas de ASI.

Abraçar o desconhecido

Esta é uma discussão limitada da existência, que abrange simultaneamente os domínios natural, espiritual, tecnológico e metafísico.

A verdadeira compreensão do nosso papel neste palco tão pequeno numa vasta arena cósmica desafia a mente humana. À medida que continuamos a desenvolver a nossa própria tecnologia de IA, podemos obter novos conhecimentos sobre estas questões.

Talvez nos encontremos a caminhar em direção a um Grande Filtro, ou talvez encontremos formas de criar uma IA que mantenha o impulso expansionista que atualmente associamos à civilização humana. A humanidade também pode simplesmente ser extremamente arcaica, mal acordando de uma idade das trevas tecnológica, enquanto vida alienígena incompreensível existe à nossa volta.

Seja como for, só nos resta olhar para as estrelas e olhar para dentro, para o desenvolvimento e a trajetória da vida no planeta Terra.

Quaisquer que sejam as respostas, se é que existem, a procura de compreender o nosso lugar no cosmos continua a fazer-nos avançar.

Para já, resta-nos muito para fazer.