OpenAI kondigde aan dat het de C2PA standaard gaat gebruiken om metadata toe te voegen aan beelden die gegenereerd zijn met DALL-E 3.

De aankondiging komt op een moment dat bedrijven blijven zoeken naar manieren om te voorkomen dat hun generatieve AI-producten worden gebruikt om desinformatie te verspreiden.

C2PA is een open technische standaard die metadata toevoegt aan een afbeelding, inclusief de oorsprong, bewerkingsgeschiedenis en andere informatie. OpenAI zegt dat afbeeldingen die direct met DALL-E 3 of via ChatGPT of de API zijn gegenereerd, nu C2PA-gegevens bevatten. Mobiele gebruikers zullen dit op 12 februari geïmplementeerd zien.

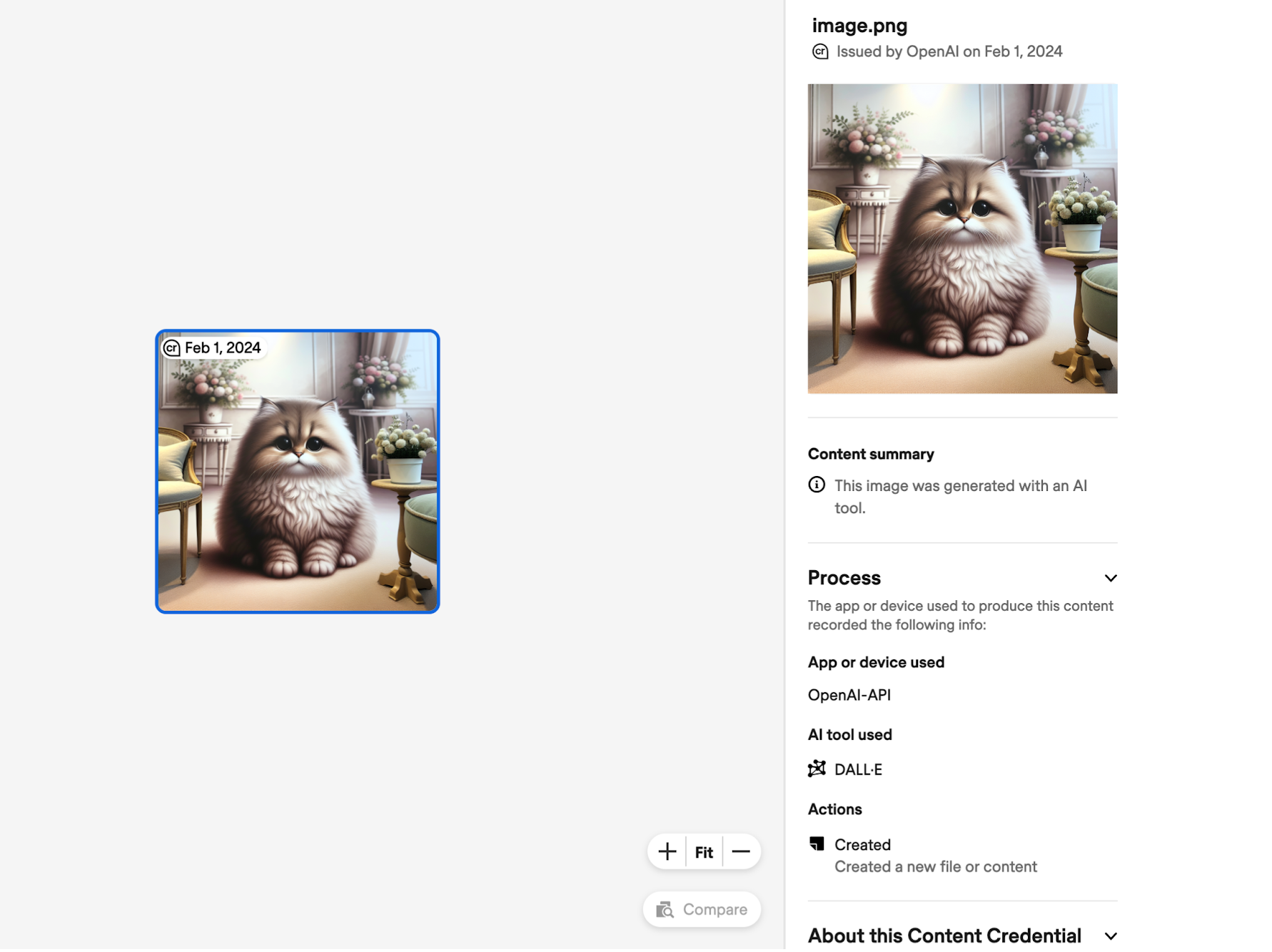

Een afbeelding waaraan C2PA-metagegevens zijn toegevoegd, kan worden geüpload naar sites als Inhoud Credentials Verifiëren om de herkomst van de afbeelding te controleren. Hier is een voorbeeld van de informatie die C2PA onthult over een afbeelding die is gemaakt met DALL-E via de API.

Sociale mediaplatforms zouden deze gegevens ook kunnen gebruiken om afbeeldingen te markeren en te labelen als AI-gegenereerd. Meta kondigde onlangs aan dat het een grotere inspanning zou leveren om dat te doen.

Door de toevoeging van C2PA-gegevens neemt de bestandsgrootte toe. Voorbeeldschattingen van OpenAI zijn:

- 3,1 MB → 3,2 MB voor PNG via API (toename van 3%)

- 287k → 302k voor WebP via API (5% toename)

- 287k → 381k voor WebP via ChatGPT (32% toename)

OpenAI erkent dat "C2PA geen wondermiddel is om problemen met de herkomst op te lossen". De metadata wordt gemakkelijk verwijderd, vaak onbedoeld.

Als je een screenshot van de afbeelding maakt, dan blijven de C2PA-gegevens niet bewaard. Zelfs het converteren van een afbeelding van PNG naar JPG zal de meeste metadata vernietigen. De meeste sociale mediaplatforms verwijderen metadata van afbeeldingen wanneer ze worden geüpload.

OpenAI zegt dat het door C2PA toe te voegen aan DALL-E beelden hoopt "gebruikers aan te moedigen om deze signalen te herkennen als de sleutel tot het vergroten van de betrouwbaarheid van digitale informatie".

Het kan dat in beperkte mate doen, maar het feit dat C2PA zo gemakkelijk te verwijderen is, helpt niet veel wanneer iemand opzettelijk een afbeelding wil gebruiken om misleidend te zijn. Het kan de deepfakers alleen maar een beetje vertragen.

Google's SynthID digitaal watermerk lijkt een veel veiligere oplossing, maar het is onwaarschijnlijk dat OpenAI een tool van de concurrentie zal gebruiken.