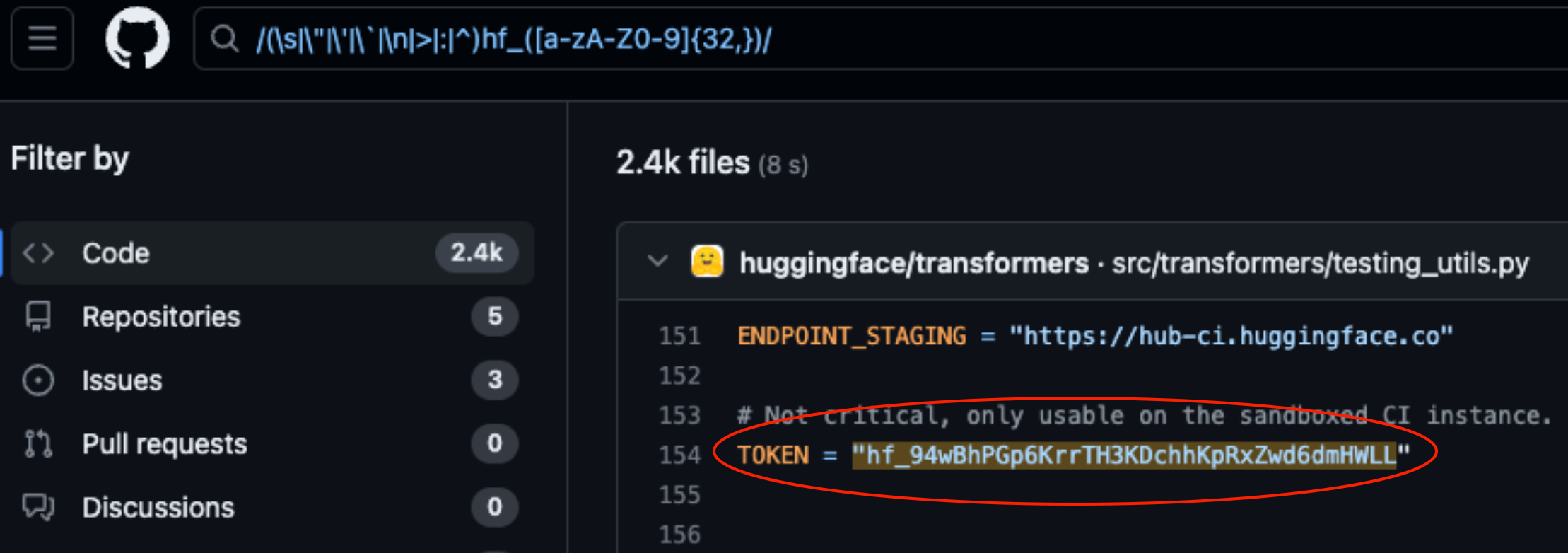

Компания Lasso Security обнаружила уязвимости в системах HuggingFace и GitHub, обнаружив 1681 открытый API-токен, жестко закодированный в коде, хранящемся на этих платформах.

HuggingFace и GitHub - два самых популярных репозитория, где разработчики могут предоставить доступ к своим моделям ИИ и коду. Считайте, что это папки в облаке, которые управляются организациями, владеющими ими.

HuggingFace и GitHub упрощают взаимодействие пользователей с сотнями тысяч моделей и наборов данных ИИ через API. Кроме того, организации, владеющие моделями и наборами данных, могут использовать API-доступ для чтения, создания, изменения и удаления репозиториев и файлов.

Разрешения, связанные с вашим API-токеном, определяют уровень доступа, который вы имеете. Лассо найдено что, немного покопавшись, они смогли найти множество токенов в коде, хранящемся в репозиториях на платформах.

Из 1681 действительного токена 655 пользователей имели права на запись, 77 из которых имели полные права на учетную запись.

Почему это так важно?

Думайте об API-токене как о ключе от входной двери. Может быть, удобно оставить ключ под половиком, но если кто-то найдет его, то получит доступ в ваш дом.

Когда разработчики пишут кусок кода, который должен взаимодействовать с моделью ИИ или набором данных, они иногда немного ленятся. Они могут жестко закодировать токены в своем коде вместо того, чтобы использовать более безопасные способы управления ими.

Некоторые из найденных Lasso токенов давали им полные права на чтение и запись в Meta's Ллама 2, BigScience Workshop и EleutherAI. Все эти организации имеют модели ИИ, которые были загружены миллионы раз.

Если бы злоумышленниками были Lasso, то они могли бы изменить модели или наборы данных в открытых репозиториях. Представьте, если бы кто-то добавил коварный код в репозиторий Meta, а затем миллионы людей скачали бы его.

Когда Meta, Google, Microsoft и другие компании узнали об открытых API-токенах, они быстро отозвали их.

Кража моделей, отравление обучающих данных, комбинирование сторонних наборов данных и предварительно обученных моделей - все это большие риски для ИИ-компаний. Разработчики, небрежно оставляющие API-токены открытыми в коде, только облегчают злоумышленникам их использование.

Стоит задуматься, были ли инженеры Lasso первыми, кто обнаружил эти уязвимости.

Если киберпреступники Если бы они нашли эти жетоны, то, конечно, вели бы себя очень тихо, пока открывали входную дверь.