Цифровой колониализм - это господство технологических гигантов и влиятельных организаций над цифровым ландшафтом, формирующих потоки информации, знаний и культуры в угоду своим интересам.

Это господство заключается не только в контроле над цифровой инфраструктурой, но и во влиянии на нарративы и структуры знаний, которые определяют нашу цифровую эпоху.

Цифровой колониализм, а теперь и колониализм искусственного интеллекта - широко признанные термины, и такие институты, как MIT исследовал и писал о Они широко распространены.

Ведущие исследователи из Anthropic, Google, DeepMind и других технологических компаний открыто обсуждали ограниченность возможностей ИИ в обслуживании людей из разных слоев общества, особенно в том, что касается смещение в системах машинного обучения.

Системы машинного обучения fнесомненно, отражают данные, на которых они обучаются - данные, которые сможно рассматривать как продукт нашего цифрового зейтгейста - совокупности преобладающих нарративов, образов и идей, которые доминируют в онлайн-мире.

Но кто формирует эти информационные силы? Чьи голоса усиливаются, а чьи ослабляются?

Когда ИИ учится на обучающих данных, он наследует специфическое мировоззрение, которое может не совпадать с мировыми культурами и опытом или представлять их. Кроме того, элементы управления, регулирующие результаты работы генеративных инструментов ИИ, формируются под влиянием базовых социокультурных векторов.

Это привело к тому, что разработчики, такие как Anthropic, начали искать демократические методы формирования поведения ИИ с помощью общественного мнения.

Джек Кларк, руководитель отдела политики Anthropic, описал недавний эксперимент Мы пытаемся найти способ разработать конституцию, которая была бы разработана целым рядом сторонних разработчиков, а не людьми, которые случайно работают в лаборатории в Сан-Франциско".

Нынешние парадигмы обучения генеративного ИИ рискуют создать цифровую эхо-камеру, где одни и те же идеи, ценности и взгляды постоянно усиливаются, еще больше укрепляя доминирующее положение тех, кто уже слишком представлен в данных.

По мере того как искусственный интеллект внедряется в процесс принятия сложных решений, от социальное обеспечение и подбор персонала на финансовые решения и медицинские диагнозыНеравномерное представительство приводит к предвзятости и несправедливости в реальном мире.

Наборы данных географически и культурно привязаны друг к другу

Недавно исследование Инициативы по проверке достоверности данных исследовали 1800 популярных наборов данных, предназначенных для обработки естественного языка (NLP), дисциплины искусственного интеллекта, которая фокусируется на языке и текстах.

НЛП - это доминирующая методология машинного обучения, лежащая в основе больших языковых моделей (LLM), включая ChatGPT и модели Llama компании Meta.

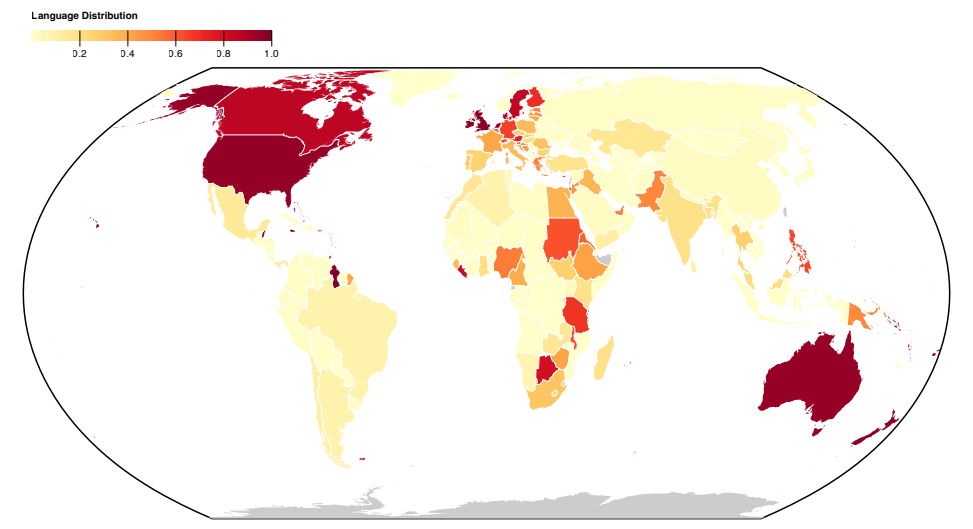

Исследование выявило западноцентричный перекос в представлении языков в наборах данных, причем английский и западноевропейские языки определяют текстовые данные.

Языки азиатских, африканских и южноамериканских народов представлены очень слабо.

В результате магистранты не могут надеяться точно передать культурно-лингвистические нюансы этих регионов в той же степени, что и западные языки.

Даже если языки Глобального Юга оказываются представленными, источник и диалект языка в основном происходят от североамериканских или европейских создателей и веб-источников.

A предыдущий Антропный эксперимент обнаружили, что переключение языков в таких моделях, как ChatGPT, все равно приводит к формированию западноцентричных взглядов и стереотипов в разговорах.

Антропологи пришли к выводу: "Если в языковой модели непропорционально представлены определенные мнения, она рискует вызвать потенциально нежелательные эффекты, такие как продвижение гегемонистских мировоззрений и гомогенизация взглядов и убеждений людей".

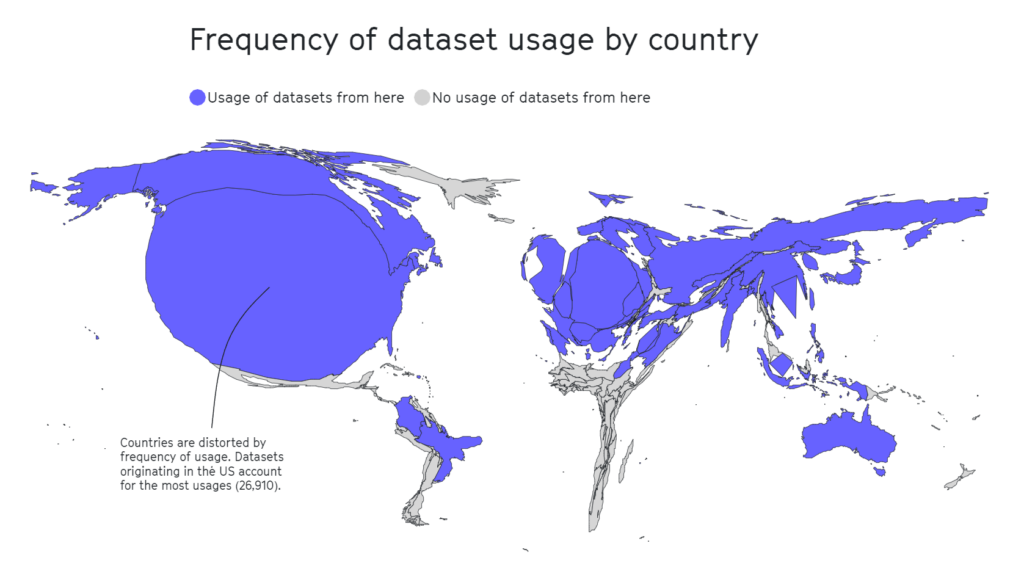

Исследование Data Provenance также позволило проанализировать географический ландшафт курирования наборов данных. Академические организации являются основными движущими силами, предоставляя 69% наборов данных, за ними следуют промышленные лаборатории (21%) и исследовательские институты (17%).

Примечательно, что наибольший вклад внесли AI2 (12,3%), Университет Вашингтона (8,9%) и Facebook AI Research (8,4%).

A отдельное исследование 2020 года В исследовании подчеркивается, что половина наборов данных, использованных для оценки ИИ в примерно 26 000 научных статей, были получены всего от 12 ведущих университетов и технологических компаний.

Как видно из приведенного ниже обзора, такие географические регионы, как Африка, Южная и Центральная Америка и Центральная Азия, оказались крайне недостаточно представлены.

В других исследованиях влиятельные наборы данных, такие как Tiny Images Массачусетского технологического института или Labeled Faces in the Wild, содержали преимущественно белые западные мужские образы, причем в случае Labeled Faces in the Wild речь шла о 77,5% мужчин и 83,5% белокожих людей.

В случае с Tiny Images Анализ 2020 года, проведенный The Register обнаружили, что многие "Крошечные картинки" содержат непристойные, расистские и сексистские надписи.

Антонио Торральба из Массачусетского технологического института сказал, что они не знали об этих метках, и набор данных был удален. Торральба сказал: "Очевидно, что мы должны были вручную отсеять их".

Английский язык доминирует в экосистеме ИИ

Паскаль Фунг, ученый-компьютерщик и директор Центра исследований ИИ при Гонконгском университете науки и технологий, рассказала о проблемах, связанных с гегемонистским ИИ.

Фунг ссылается на более чем 15 научных работ, изучающих многоязычные навыки магистрантов, и постоянно обнаруживает их недостаток, особенно при переводе английского на другие языки. Например, языки с нелатинской графикой, такие как корейский, выявляют недостатки LLM.

В дополнение к плохой многоязыковой поддержке, другие исследования предполагают, что большинство контрольных показателей и мер, связанных с предвзятостью, были разработаны с учетом английских языковых моделей.

Неанглийских эталонов смещения очень мало, что приводит к существенному пробелу в нашей способности оценивать и исправлять смещение в многоязычных языковых моделях.

Есть и признаки улучшения, например, усилия Google по созданию языковой модели PaLM 2 и Мета Массовая многоязычная речь (MMS) который может идентифицировать более 4 000 разговорных языков, что в 40 раз больше, чем при других подходах. Тем не менее, MMS остается экспериментальной.

Исследователи создают разнообразные многоязычные наборы данных, но подавляющее количество англоязычных текстовых данных, часто бесплатных и легкодоступных, делает их де-факто выбором разработчиков.

За пределами данных: структурные вопросы в сфере труда ИИ

Обширный обзор колониализма ИИ от Массачусетского технологического института привлекли внимание к относительно скрытому аспекту развития ИИ - эксплуататорским методам труда.

ИИ вызвал активный рост спроса на услуги по маркировке данных. Такие компании, как Appen и Sama, стали ключевыми игроками, предлагающими услуги по маркировке текста, изображений и видео, сортировке фотографий и расшифровке аудиозаписей для питания моделей машинного обучения.

Специалисты по работе с данными также вручную маркируют типы контента, часто для сортировки данных, содержащих незаконный, нелегальный или неэтичный контент, например, описания сексуального насилия, вредного поведения или другой незаконной деятельности.

Хотя компании, работающие в области искусственного интеллекта, автоматизируют некоторые из этих процессов, все равно необходимо держать "человека в курсе", чтобы обеспечить точность модели и соблюдение требований безопасности.

По прогнозам антрополога Мэри Грей и социолога Сиддхарта Сури, рыночная стоимость этой "призрачной работы" составит к 2030 году вырастет до $13,7 млрд..

Призрачная работа часто связана с эксплуатацией дешевой рабочей силы, особенно из экономически уязвимых стран. Венесуэла, например, стала основным источником рабочей силы, связанной с ИИ, из-за экономического кризиса.

Когда страна столкнулась с самой тяжелой экономической катастрофой мирного времени и астрономической инфляцией, значительная часть ее образованного и подключенного к Интернету населения обратилась к крауд-рабочим платформам как средству выживания.

Сочетание хорошо образованной рабочей силы и экономической безысходности сделало Венесуэлу привлекательным рынком для компаний, занимающихся маркировкой данных.

Это не является спорным моментом - когда MIT публикует статьи с заголовками типа "Искусственный интеллект создает новый колониальный мировой порядокСсылаясь на подобные сценарии, очевидно, что некоторые представители индустрии стремятся приоткрыть завесу над этими нечестными методами работы.

Как сообщает MIT, для многих венесуэльцев бурно развивающаяся индустрия искусственного интеллекта стала обоюдоострым мечом. Обеспечивая экономическое спасение в условиях отчаяния, она в то же время подвергает людей эксплуатации.

Джулиан Посада, кандидат наук из Университета Торонто, подчеркивает "огромный дисбаланс сил" в этих рабочих соглашениях. Платформы диктуют правила, оставляя работникам мало права голоса и ограниченную финансовую компенсацию, несмотря на трудности, возникающие на рабочем месте, например, воздействие тревожного контента.

Эта динамика до жути напоминает историческую колониальную практику, когда империи эксплуатировали труд уязвимых стран, извлекали прибыль и покидали их, как только возможности иссякали, часто потому, что "более выгодные условия" были доступны в других местах.

Аналогичная ситуация наблюдалась в Найроби, Кения, где группа бывших модераторов контента, работавших на ChatGPT подал петицию с кенийским правительством.

Они заявили об "условиях эксплуатации" во время работы в компании Sama, американской компании, предоставляющей услуги по аннотированию данных по контракту с OpenAI. Заявители утверждали, что они подвергались воздействию тревожного контента без надлежащей психосоциальной поддержки, что привело к серьезным психическим расстройствам, включая посттравматическое стрессовое расстройство, депрессию и тревогу.

Документы Reviewed by TIME В докладе говорится, что OpenAI подписала с Sama контракты на сумму около $200 000. Эти контракты предусматривали маркировку описаний сексуального насилия, языка ненависти и насилия.

Воздействие на психическое здоровье работников было глубоким. Мофат Окиньи, бывший модератор, рассказал о психологических последствиях, описав, как воздействие графического контента привело к паранойе, изоляции и значительным личным потерям.

Оплата за такой тяжелый труд была шокирующе низкой - представитель Sama сообщил, что работники получали от $1,46 до $3,74 в час.

Сопротивление цифровому колониализму

Если индустрия ИИ стала новой границей цифрового колониализма, то сопротивление уже становится более сплоченным.

Активисты, часто опираясь на поддержку исследователей ИИ, выступают за подотчетность, изменение политики и разработку технологий, в которых приоритет отдается потребностям и правам местных сообществ.

Нанджала Ньябола Проект "Цифровые права на суахили представляет собой инновационный пример того, как местные проекты могут создать инфраструктуру, необходимую для защиты сообществ от цифровой гегемонии.

Проект учитывает гегемонию западных норм при определении цифровых прав группы людей, поскольку не все защищены законами об интеллектуальной собственности, авторском праве и конфиденциальности, которые многие из нас считают само собой разумеющимися. Таким образом, значительная часть населения планеты становится объектом эксплуатации со стороны технологических компаний.

Понимая, что дискуссии вокруг цифровых прав затухают, если люди не могут изложить суть проблемы на родном языке, Ньябола и ее команда перевели основные термины, касающиеся цифровых прав и технологий, на язык суахили, на котором в основном говорят в Танзании, Кении и Мозамбике.

Ньябола описание проекта"Во время этого процесса [инициативы Huduma Namba] у нас не было языка и инструментов, чтобы объяснить неспециалистам или не говорящим по-английски сообществам в Кении, каковы последствия этой инициативы".

В рамках аналогичного низового проекта Te Hiku Media, некоммерческая радиостанция, вещающая преимущественно на языке маори, располагает обширной базой данных записей за несколько десятилетий, многие из которых звучат голосами предков, которые больше не произносятся.

Основные модели распознавания речи, подобные LLM, как правило, не справляются с заданием на разных языках или диалектах английского.

Сайт Te Hiku Media сотрудничал с исследователями и технологиями с открытым исходным кодом, чтобы обучить модель распознавания речи, адаптированную для языка маори. Активист маори Те Михинга Комене предоставил около 4 000 фраз, а также бесчисленное множество других участников проекта.

Сайт результирующая модель и данные защищены в соответствии с Лицензия Кайтиакитанга - Kaitiakitanga - это слово на языке маори, не имеющее конкретного английского определения, но похожее на "опекун" или "хранитель".

Кеони Маелона, соучредитель Te Hiku Media, остроумно заметил: "Данные - это последний рубеж колонизации".

Эти проекты вдохновили другие коренные и местные сообщества, испытывающие давление цифрового колониализма и других форм социальных потрясений, например, народ могавков в Северной Америке и коренных жителей Гавайев.

По мере удешевления и упрощения доступа к ИИ с открытым исходным кодом итерация и тонкая настройка моделей с использованием уникальных локализованных наборов данных должна стать проще, что расширит межкультурный доступ к технологии.

Хотя отрасль ИИ еще молода, настало время вынести эти проблемы на первый план, чтобы люди могли сообща выработать их решения.

Решения могут быть как макроуровневыми - в виде нормативных актов, политики и подходов к обучению машинному обучению, так и микроуровневыми - в виде местных и низовых проектов.

Вместе исследователи, активисты и местные сообщества могут найти методы, чтобы ИИ приносил пользу всем.