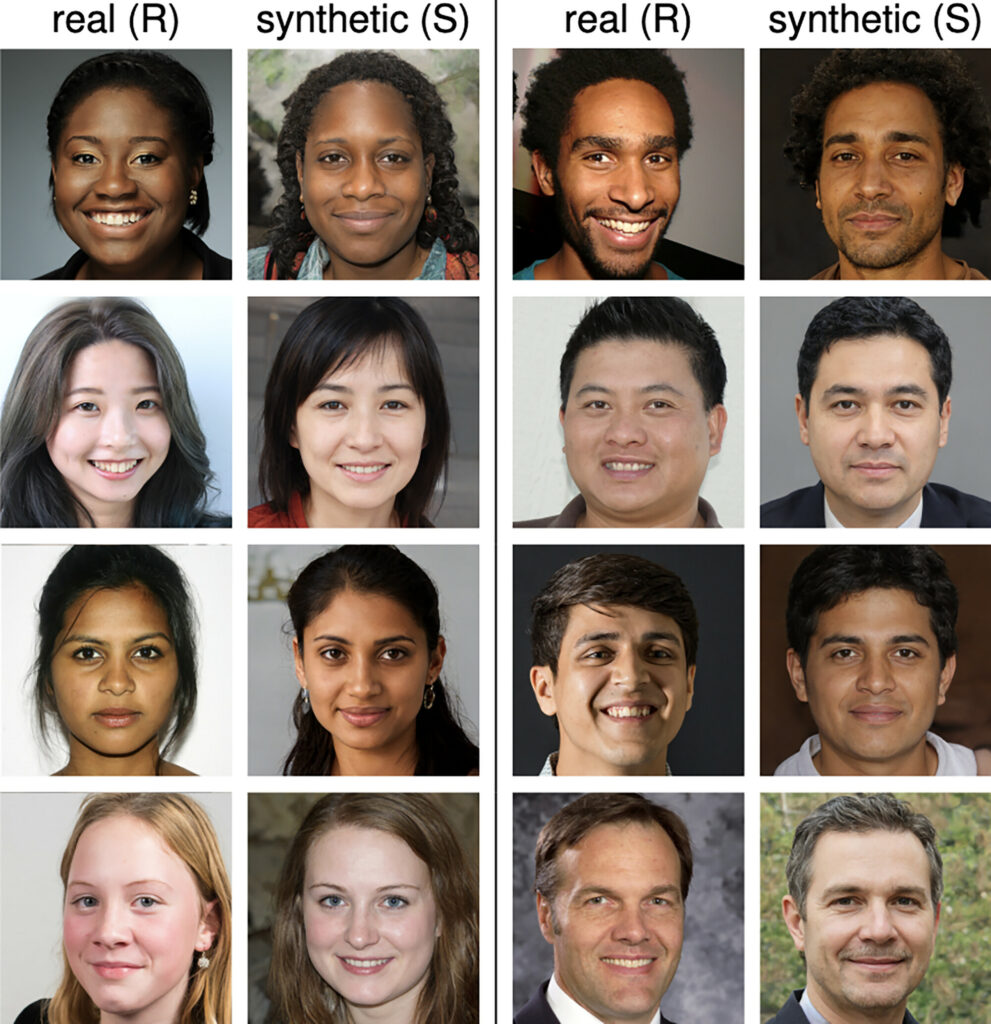

Uma experiência recente revelou que os humanos conseguem identificar corretamente rostos humanos gerados por IA em apenas 48,2% das vezes.

O estudo envolveu 315 participantes com a tarefa de distinguir entre rostos reais e rostos gerados por IA. Os rostos foram sintetizados utilizando o StyleGAN2, um motor de última geração capaz de criar semelhanças humanas diversas e realistas.

Os resultados foram simultaneamente fascinantes e ligeiramente enervantes; a capacidade dos participantes para identificar rostos gerados por IA rondou os 48,2% - pior do que um lançamento de moeda ao ar.

É suggests that to the average person, AI deep fake faces are virtually indistinguishable from those of real human beings.

Pode ver com os seus próprios olhos como estes rostos são realistas visitando esta-pessoa-não-existe.comque apresenta imagens realistas geradas por IA de praticamente qualquer pessoa, em qualquer idade ou de qualquer origem. E esta ferramenta já tem alguns anos.

Mais a fundo, o estudo também explorou se certas raças e géneros eram mais difíceis de classificar corretamente.

Observou-se que os rostos brancos, especialmente os masculinos, eram os mais difíceis de identificar corretamente como reais ou sintéticos.

A razão pela qual isto acontece pode ter origem na sobre-representação de rostos brancos no conjunto de dados de treino da IA, levando a rostos sintéticos brancos mais realistas, de acordo com o estudo.

Ainda mais intrigante foi a descoberta de que os participantes classificaram os rostos sintéticos como mais fiáveis do que os reais, embora por uma margem modesta. Este facto poderá indiciar uma preferência subconsciente pelas características médias que a IA tende a gerar, que, segundo o estudo, foram consideradas mais fiáveis em investigações anteriores.

Um aumento subtil da probabilidade de alguém interpretar uma imagem de IA como sendo mais fiável do que uma imagem real é muito preocupante quando é alargado a níveis populacionais.

A interpretação do cérebro de rostos gerados por IA é complexa

A segundo estudo recente pediram aos participantes que identificassem se um rosto era real ou não enquanto estavam envolvidos numa tarefa concebida para os distrair.

Não conseguiam distinguir conscientemente entre os dois, mas as coisas tornaram-se mais confusas quando a sua atividade cerebral foi medida através de um eletroencefalograma (EEG).

Cerca de 170 milissegundos depois de verem os rostos, a atividade eléctrica do cérebro ilustrava diferenças quando os participantes olhavam para imagens reais e sintéticas.

Parecia que tmente inconsciente "sabia" quando uma imagem podia ser gerada por IA melhor do que a mente consciente. Mas, apesar disso, os participantes não conseguiram rotular conscientemente rostos de IA com um grau de confiança robusto.

Poderíamos especular que existe uma camada consciente de interpretação em que damos aos rostos gerados pela IA "o benefício da dúvida", mesmo quando não temos a certeza.

Afinal de contas, estamos intrinsecamente ligados para identificar e confiar em rostos humanos, pelo que é excecionalmente difícil separarmo-nos disso e isolar inconsistências que possam revelar uma imagem gerada por IA.

É quase como se as suspeitas iniciais dessem lugar a uma confirmação mais afirmativa de que a pessoa é, de facto, real quando não o é - uma forma de pedido de desculpas instigado pela IA.

Seja qual for a explicação para esta peculiaridade, as falsificações profundas geradas pela IA são um risco prioritário para a tecnologia, com um escândalo recente a atingir uma escola de New Jersey.

Fraudes profundas e falsas são uma ocorrência regular, e há preocupações palpáveis de que os conteúdos falsos gerados por IA pode afetar os comportamentos de voto.