O Genie da Google DeepMind é um modelo generativo que traduz imagens simples ou mensagens de texto em mundos dinâmicos e interactivos.

O Genie foi treinado num extenso conjunto de dados com mais de 200.000 horas de vídeos de jogos, incluindo jogos de plataformas 2D e interacções robóticas do mundo real.

Este vasto conjunto de dados permitiu ao Genie compreender e gerar a física, a dinâmica e a estética de inúmeros ambientes e objectos.

O modelo finalizado, documentado numa trabalho de investigaçãocontém 11 mil milhões de parâmetros para gerar mundos virtuais interactivos a partir de imagens em vários formatos ou de instruções de texto.

Assim, pode alimentar o Genie com uma imagem da sua sala de estar ou do seu jardim e transformá-la num nível de plataforma 2D jogável.

Ou rabiscar um ambiente 2D num pedaço de papel e convertê-lo num ambiente de jogo jogável.

O que distingue o Genie de outros modelos de mundos é a sua capacidade de permitir que os utilizadores interajam com os ambientes gerados numa base quadro a quadro.

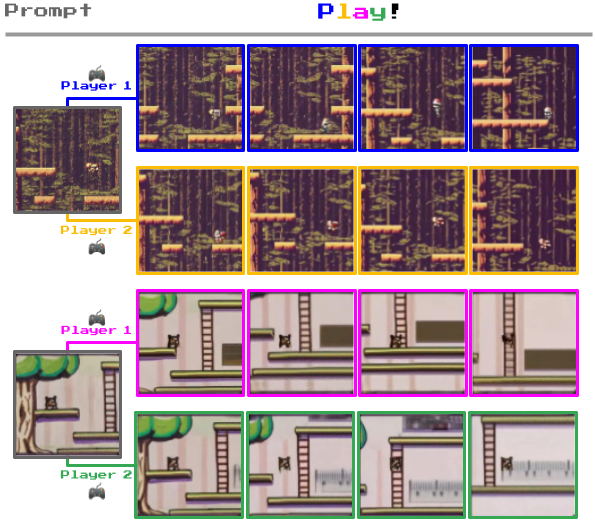

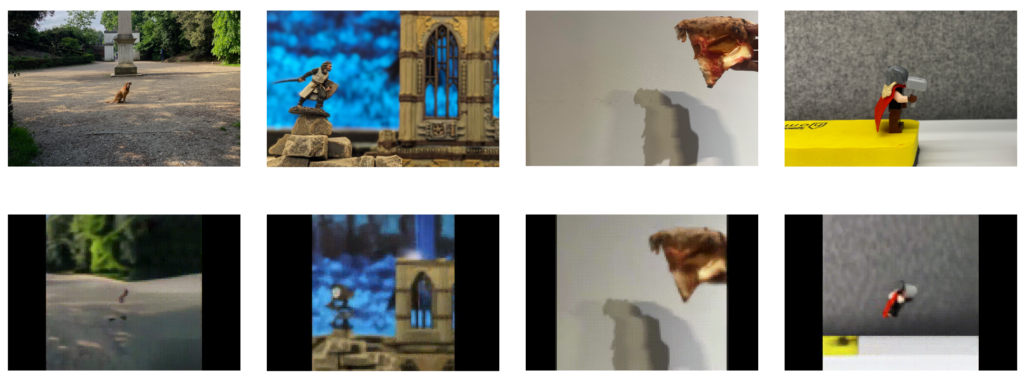

Por exemplo, abaixo, pode ver como o Genie tira fotografias de ambientes do mundo real e as transforma em níveis de jogo 2D.

Como funciona o Genie

O Genie é um "modelo de mundo de fundação" com três componentes principais: um tokenizador de vídeo espácio-temporal, um modelo de dinâmica auto-regressiva e um modelo de ação latente (LAM) simples e escalável.

Eis como funciona:

- Transformadores espácio-temporais: No centro do Genie estão os transformadores espaço-temporais (ST), que processam seqüências de quadros de vídeo. Ao contrário dos transformadores tradicionais que lidam com texto ou imagens estáticas, os transformadores ST são concebidos para compreender a progressão dos dados visuais ao longo do tempo, tornando-os ideais para a geração de vídeo e ambientes dinâmicos.

- Modelo de ação latente (LAM): O Genie compreende e prevê acções nos seus mundos gerados através do LAM. Este infere as acções potenciais que podem ocorrer entre os fotogramas de um vídeo, aprendendo um conjunto de "acções latentes" diretamente a partir dos dados visuais. Isto permite ao Genie controlar a progressão dos acontecimentos em ambientes interactivos, apesar da ausência de etiquetas de ação explícitas nos dados de treino.

- Modelo de dinâmica e tokenizador de vídeo: Para gerenciar dados de vídeo, o Genie emprega um tokenizador de vídeo que comprime quadros de vídeo brutos em um formato mais gerenciável de tokens discretos. Após a tokenização, o modelo dinâmico prevê o próximo conjunto de tokens de quadros, gerando quadros subsequentes no ambiente interativo.

A equipa da DeepMind explicou sobre o Genie: "O Genie pode permitir que um grande número de pessoas crie as suas próprias experiências de jogo. Isto pode ser positivo para aqueles que desejam exprimir a sua criatividade de uma nova forma, por exemplo, as crianças que podem desenhar e entrar nos seus próprios mundos imaginados".

Numa experiência paralela, quando lhe foram apresentados vídeos de braços de robôs reais a interagir com objectos do mundo real, o Genie demonstrou uma capacidade extraordinária para decifrar as acções que esses braços podiam realizar. Isto demonstra potenciais utilizações na investigação em robótica.

Tim Rocktäschel, da equipa Genie, descreveu o potencial aberto do Genie: "É difícil prever que casos de utilização serão possíveis. Esperamos que projectos como o Genie acabem por fornecer às pessoas novas ferramentas para exprimirem a sua criatividade".

A DeepMind estava consciente dos riscos de divulgar este modelo de base, afirmando no documento: "Optámos por não divulgar os pontos de verificação do modelo treinado, o conjunto de dados de treino do modelo ou exemplos desses dados para acompanhar este documento ou o sítio Web."

"Gostaríamos de ter a oportunidade de continuar a colaborar com a comunidade de investigadores (e de jogos de vídeo) e de garantir que quaisquer futuros lançamentos deste tipo sejam respeitosos, seguros e responsáveis."

Utilizar jogos para simular aplicações do mundo real

A DeepMind utilizou jogos de vídeo para vários projectos de aprendizagem automática.

Por exemplo, em 2021, A DeepMind construiu a XLandA equipa de investigação da Universidade de Lisboa, em Lisboa, criou um jogo virtual para testar abordagens de aprendizagem por reforço (RL) para agentes de IA generalistas. Aqui, os modelos de IA dominam a cooperação e a resolução de problemas, realizando tarefas como a deslocação de obstáculos em ambientes de jogo abertos.

Depois, ainda no mês passado, SIMA (Scalable, Instructable, Multiworld Agent) foi concebido para compreender e executar instruções em linguagem humana em diferentes jogos e cenários.

O SIMA foi treinado utilizando nove jogos de vídeo que requerem diferentes conjuntos de competências, desde a navegação básica até à pilotagem de veículos.

Os ambientes de jogo oferecem uma caixa de areia controlável e escalável para treinar e testar modelos de IA.

A experiência da DeepMind em jogos remonta a 2014-2015, quando desenvolveram um algoritmo para derrotar humanos em jogos como Pong e Space Invaders, para não falar do AlphaGo, que derrotou o jogador profissional Fan Hui num tabuleiro de 19×19 em tamanho real.