De uitgestrektheid van het heelal spreekt al heel lang tot de verbeelding van de mens, waardoor we ons afvragen: zijn we alleen?

Het is een vraag die de mensheid al duizenden jaren fascineert en vandaag de dag hebben we de technologie - zoals radiotelescopen - om de zoektocht naar buitenaardse intelligentie (SETI) nog verder de ruimte in te sturen.

We hebben nog niets gevonden. Er is nog geen definitief bewijs van buitenaards leven openbaar gemaakt en de zoektocht gaat door.

That’s despite there being billions of potentially habitable worlds in the Milky Way alone, including some 1,780 confirmed exoplanets (planets beyond our solar system), 16 of which are located in their star’s habitable zone. Some, like the ‘super-Earth’ Kepler-452b, worden verondersteld opmerkelijk veel op onze eigen planeet te lijken.

Je hebt ook geen perfecte omgeving nodig om leven te ondersteunen. Extremofiele bacteriën op aarde zijn in staat om in enkele van de meest barre omstandigheden op onze planeet te leven. En het zijn niet alleen microben die goed kunnen gedijen in extreme omgevingen. De Pompeii worm leeft bijvoorbeeld in hydrothermale openingen op de oceaanbodem en is bestand tegen temperaturen tot 176°F (80°C).

Tardigrades, ook wel waterberen genoemd, kunnen overleven in het vacuüm van de ruimte, extreme straling verdragen en een druk weerstaan die zes keer zo hoog is als de druk in de diepste delen van de oceaan. De hardheid van het leven op aarde, in combinatie met de enorme hoeveelheid bewoonde werelden, leidt ertoe dat veel wetenschappers het erover eens zijn dat het bestaan van buitenaardse wezens statistisch gezien zo goed als zeker is.

Als dat zo is, waar schuilt dan buitenaards leven? En waarom wil het zich niet openbaren?

Van de Fermi-paradox naar de Grote Filter

Those questions appeared in a casual conversation between physicists and astronomers Enrico Fermi, Edward Teller, Herbert York, and Emil Konopinski in 1950. Fermi vroeg beroemd: "Waar is iedereen?" of "Waar zijn ze?". (de exacte bewoording is niet bekend).

De nu alom bekende Fermi-paradox is als volgt geformuleerd: gezien het enorme aantal sterren en potentieel bewoonbare planeten in ons melkwegstelsel, waarom hebben we geen tekenen van buitenaardse beschavingen ontdekt?

Toen de Fermi-paradox zijn intrede deed in de reguliere wetenschap, hebben talloze hypotheses geprobeerd om de paradox tegen te gaan, aan te pakken, te corrigeren of te versterken, waaronder het concept van de ".Groot filter," geïntroduceerd door econoom Robin Hanson in 1998.

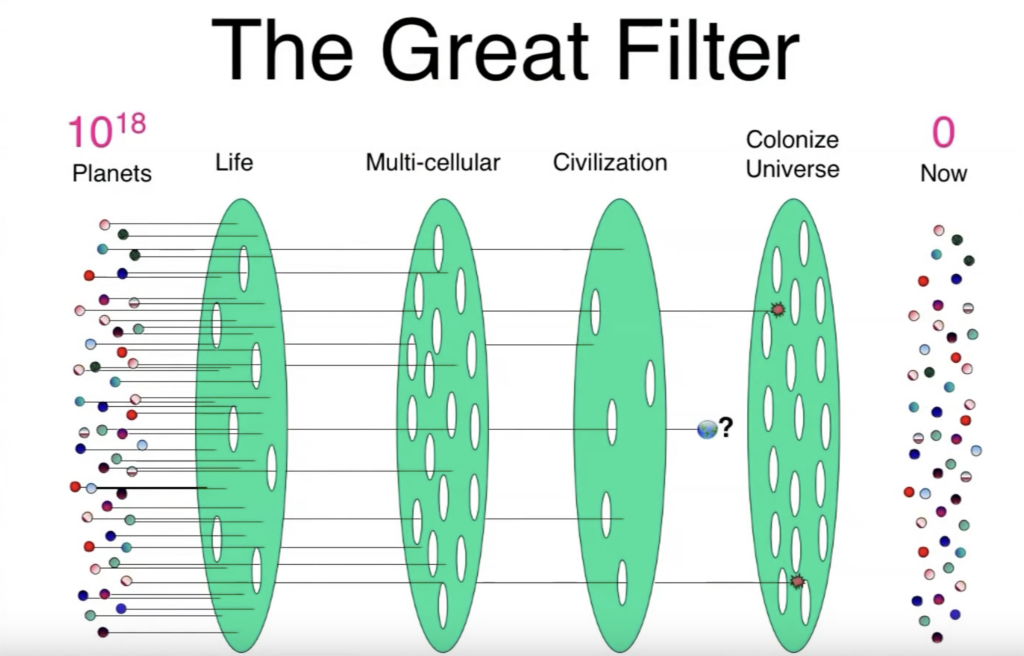

De Grote Filter hypothese stelt dat er een ontwikkelingsstadium of hindernis bestaat die extreem moeilijk of bijna onmogelijk is voor het leven om te overwinnen.

Met andere woorden, beschavingen falen voorspelbaar en onveranderlijk, door uitputting van grondstoffen, natuurlijke gevaren, interplanetaire bedreigingen of andere ongecontroleerde existentiële risico's.

Een eigenaardigheid van de Grote Filter is dat we niet weten of hij achter ons of voor ons is. Als de filter achter ons ligt - bijvoorbeeld als het ontstaan van leven zelf een extreem zeldzame gebeurtenis is - suggereert dit dat we het moeilijkste deel achter de rug hebben en misschien zeldzaam of zelfs alleen zijn in het universum.

Hoewel dit scenario mogelijk geïsoleerd is, is het optimistisch over onze toekomstperspectieven. Maar als de Grote Filter voor ons ligt, kan dat ons voortbestaan op lange termijn in gevaar brengen. En het zou ook verklaren waarom we geen bewijs zien van andere beschavingen.

De Grote Filter wordt verergerd door de immense omvang van de ruimte en de korte tijdslijnen die geassocieerd worden met geavanceerde beschaving.

Als de mensheid zichzelf zou vernietigen in de komende 100 jaar, zou het technologische tijdperk nauwelijks 500 jaar hebben geduurd.

Dat is een uitzonderlijk klein venster voor ons om buitenaardse wezens te detecteren of voor buitenaardse wezens om ons te detecteren voordat de Grote Filter begint.

AI brengt nieuwe puzzels in de Fermi-paradox

De stilte van de kosmos heeft talloze hypotheses opgeleverd, maar recente ontwikkelingen in AI voegen intrigerende nieuwe dimensies toe aan deze eeuwenoude puzzel. AI biedt de mogelijkheid van een vorm van niet-biologisch AI-leven dat bijna oneindig zou kunnen voortbestaan, in zowel fysieke als digitale vorm.

Het zou ook langer kunnen duren dan de biologische beschavingen die het creëren, hun ondergang in gang zetten of versnellen en zo de "Grote Filter" in werking zetten die voorkomt dat het leven zich uitbreidt.

Deze hypothese, onlangs voorgesteld in een essay van de astronoom Michael A. Garrett, stelt dat de ontwikkeling van kunstmatige superintelligentie (ASI), een meer geavanceerde vorm van kunstmatige algemene intelligentie (AGI), een kritiek moment is voor beschavingen.

Zoals Garrett uitlegt:

"De ontwikkeling van kunstmatige intelligentie (AI) op aarde zal waarschijnlijk ingrijpende gevolgen hebben voor de toekomst van de mensheid. In de context van de Fermi-paradox suggereert het een nieuwe oplossing waarbij de opkomst van AI onvermijdelijk leidt tot het uitsterven van biologische intelligentie en de vervanging ervan door op silicium gebaseerde levensvormen."

Garrett's hypothese is gebaseerd op het idee dat naarmate beschavingen zich ontwikkelen, ze steevast AI ontwikkelen die de biologische makers verdringt, samenvoegt of vernietigt.

Om dit risico te beperken, roept Garrett op tot regelgeving en sluit hij zich aan bij invloedrijke AI-onderzoekers die ook waarschuwen voor de existentiële risico's van AIzoals Yoshio Bengio, Max Tegmark en George Hinton, maar ook buiten de sector, zoals wijlen Stephen Hawking.

Er is echter veel discussie over de omvang van de risico's van AI, waarbij anderen, zoals Yann LeCun (een van de zogenaamde 'AI-godvaders' naast Bengio en Hinton), stellen dat de risico's van AI enorm worden overschat.

Toch stelt Garett in zijn essay een prikkelende hypothese voor. In onze dorst naar een technologisch tegengif voor maatschappelijke en ecologische uitdagingen drinkt de mensheid uit de gifbeker van AI, waardoor we net als ontelbare beschavingen eerder ten onder gaan.

De AI-kolonisatiehypothese

Hoewel het idee van AI die optreedt als de Grote Filter een overtuigende verklaring is voor de Fermi-paradox, zitten er toch een paar haken en ogen aan.

First and foremost, it assumes ASI is possible. Right now, there are both architectural and infrastructural constraints.

On the architectural front, designing AI systems that can match or surpass human-level intelligence across a wide range of domains remains elusive. While excellent at specific tasks like image recognition, language processing, and gameplay, AI systems lack organic problem-solving and creative skills.

Het ontwikkelen van AI-architecturen die kunnen leren, redeneren en kennis flexibel kunnen toepassen in nieuwe situaties is een enorme uitdaging die waarschijnlijk fundamentele doorbraken zal vereisen op het gebied van leren zonder toezicht, transferleren, redeneren op basis van gezond verstand en nog veel meer.

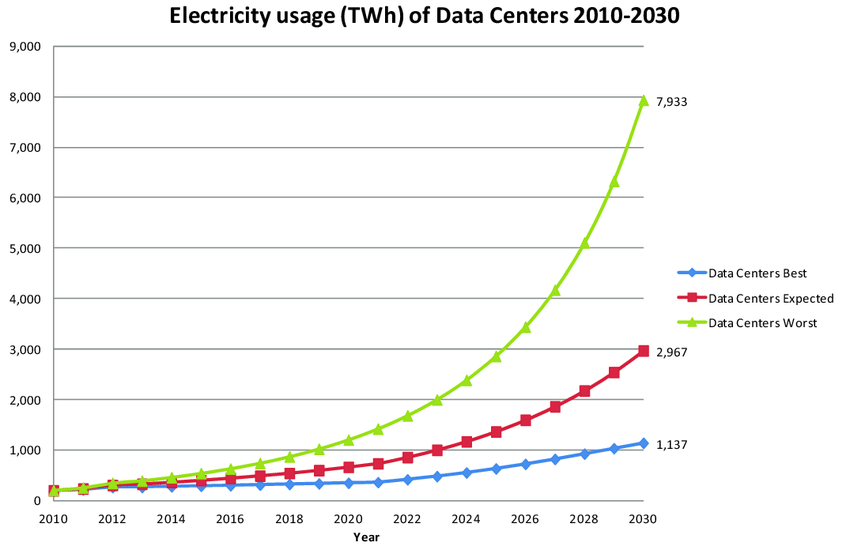

Aan de infrastructurele kant vergt het trainen van geavanceerde AI-modellen nu al de grenzen van de huidige computerhardware. energie en hulpbronnen. The computational requirements for achieving ASI are likely to be orders of magnitude greater.

Maar laten we dit debat even buiten beschouwing laten en aannemen dat superintelligentie uiteindelijk mogelijk wordt.

Als die toekomstige ASI-systemen geavanceerd genoeg zijn om hun scheppers te vervangen of fundamenteel te veranderen, zouden ze dan niet ook in staat zijn tot snelle kosmische expansie en kolonisatie? Waarom zou het stoppen bij het vervangen/vernietigen van zijn scheppers?

Bovendien, als mogelijk duizenden, miljoenen, zelfs miljarden aardse werelden ten prooi zijn gevallen aan deze door AI veroorzaakte Grote Filter, wordt de mogelijkheid dat er versies van ASI zijn die interplanetaire verovering nastreven nog waarschijnlijker.

Motivations could range from logical (resource gathering, self-preservation) to bizarre (mimicking behaviors from fiction, video games, films, etc.). Now, what if this AI decides that spreading across the cosmos is the ultimate way to fulfill those goals?

Of het nu gaat om het uitbreiden van haar invloed, het vergaren van grondstoffen of het bevredigen van een onverzadigbare nieuwsgierigheidzouden hoogintelligente AI-systemen zich vastberaden kunnen richten op kolonisatie.

Bovendien bestaat er, naarmate AI-systemen meer agent worden, een risico op onbedoelde of verkeerd afgestemde 'opkomende doelen'. Recent Antropisch en DeepMind studies hebben geïllustreerd hoe huidige AI-systemen in staat zijn om complexe AI-strategieën te ontwikkelen die niet expliciet geprogrammeerd zijn.

In de toekomst zou een krachtig AI-systeem dat zijn macht wil maximaliseren een strategie kunnen uitstippelen voor uitbreiding en het verwerven van grondstoffen, waarbij het de controle krijgt over productiefaciliteiten, kritieke infrastructuur, enzovoort.

Dat is niet zo vergezocht als het lijkt. In de wereld van cyberbeveiliging, bijvoorbeeld, groeien IT-netwerken en de technologie die de kritieke infrastructuur, fabrieken, enz. aandrijft, naar elkaar toe.

Computers in offices, once separate from the computers in power plants or factories, are starting to connect and work together. This means that if someone, or something like an AI, breaks into IT networks, they could gain control of machines in a power plant.

Geavanceerde malware, waaronder AI-gestuurde malwareHet is nu al haalbaar om lateraal van IT-netwerken naar digitaal verbonden industriële omgevingen over te stappen en de controle over te nemen van de kritieke systemen waarvan we afhankelijk zijn.

Je kunt je voorstellen hoe kwaadwillende AI-systemen deze systemen in hun voordeel kunnen gebruiken.

De volharding van AI in kosmische tijdschalen

AI maakt ruimteverkenning niet alleen gemakkelijker - het verandert de mogelijkheden volledig.

Zonder behoefte aan lucht, voedsel of bescherming tegen straling zou AI zich in de meest barre uithoeken van het universum kunnen wagen. En het zou dit kunnen doen voor perioden die de menselijke geest verbijsteren.

De duurzaamheid en hardnekkigheid van AI opent een schat aan voordelen voor ruimtekolonisatie:

- Levensduur: In tegenstelling tot biologische entiteiten zou AI niet beperkt worden door een korte levensduur. Dit maakt lange ruimtereizen en kolonisatieprojecten veel haalbaarder. Een AI zou mogelijk reizen van duizenden of zelfs miljoenen jaren kunnen maken zonder zich zorgen te maken over generatiewisselingen of de psychologische tol die langdurige ruimtereizen eisen van biologische wezens.

- Aanpassingsvermogen: AI zou zich in potentie kunnen aanpassen aan een veel breder scala van omgevingen dan biologisch leven. Terwijl wij beperkt zijn tot een smalle band van temperatuur, druk en chemische omstandigheden, zou een AI theoretisch kunnen functioneren in extreme kou, vacuüm of zelfs de verpletterende druk en intense hitte van gasreusatmosferen.

- Efficiënt gebruik van hulpbronnen: AI zou veel minder middelen nodig hebben om zichzelf in stand te houden dan biologisch leven. Het heeft geen ademlucht, drinkbaar water of een constante voedselvoorraad nodig. Dit zou reizen over lange afstanden en kolonisatie veel levensvatbaarder kunnen maken.

- Snelle zelfverbetering: Gedreven door intrinsieke of extrinsieke verlangens zou AI zichzelf voortdurend kunnen upgraden en verbeteren, mogelijk exponentieel snel. Dit zou kunnen leiden tot technologische vooruitgang die veel verder gaat dan we ons nu kunnen voorstellen.

Zoals astronoom Royal Martin Rees en astrofysicus Mario Livio uitlegden in een artikel gepubliceerd in de Scientific American:

"De geschiedenis van de menselijke technologische beschaving is misschien slechts in millennia (op zijn hoogst) te meten, en het kan nog maar een of twee eeuwen duren voordat de mens wordt ingehaald of overtroffen door anorganische intelligentie, die dan misschien miljarden jaren lang kan blijven evolueren op een sneller dan Darwinistische tijdschaal."

Welke vorm zou deze buitenaardse AI aannemen? Het is voor iedereen gissen, maar onderzoekers hebben fascinerende mogelijkheden voorgesteld.

In het boek Leven 3.0: Mens zijn in het tijdperk van kunstmatige intelligentieMax Tegmark, natuurkundige en AI-onderzoeker, onderzoekt scenario's waarin een geavanceerde AI mogelijk een groot deel van het waarneembare universum kan omzetten in computronium - materie die is geoptimaliseerd voor berekeningen - in een kosmisch proces dat hij "intelligentie-explosie" noemt.

In 1964, Sovjet astronoom Nikolaj Kardasjev beschavingen ingedeeld op basis van hun vermogen om energie te benutten:

- Type I beschavingen kunnen alle beschikbare energie op hun planeet gebruiken

- Type II-beschavingen kunnen de volledige energie-output van hun ster benutten

- Type III-beschavingen kunnen de energie van hun hele melkwegstelsel beheersen

Een AI die niveau II en III bereikt, zou kosmische materie fundamenteel kunnen transformeren tot een computationeel substraat. Sterren, planeten en zelfs de ruimte ertussen zouden deel kunnen worden van een enorm computationeel netwerk.

Deze scenario's brengen ons echter terug bij af. Logica suggereert dat zulke AI-beschavingen, met hun immense energieverbruik en grootschalige technische projecten, detecteerbaar zouden moeten zijn. Toch zien we geen bewijs van zulke melkweg-beschavingen.

De tegenstellingen oplossen: perspectieven op AI-gedrag

De tegenstelling tussen AI als het Grote Filter en als potentiële kosmische kolonisator vereist dat we dieper nadenken over de aard van geavanceerde AI.

Laten we een paar mogelijke scenario's bekijken om deze paradox te onderzoeken:

AI ontwikkelt een naar binnen gerichte focus

Eén mogelijkheid is dat geavanceerde AI-beschavingen zich naar binnen richten en virtuele werelden verkennen of doelen nastreven waarvoor geen fysieke uitbreiding nodig is.

Zoals Martin Rees suggereert in de Scientific American, zou post-biologische intelligentie een "rustig, contemplatief leven" kunnen leiden.

Dit idee komt overeen met het concept van "sublieme" beschavingen in de Culture-serie van sciencefictionauteur Iain M. Banks, waarin geavanceerde samenlevingen ervoor kiezen om het fysieke universum te verlaten om op zichzelf staande virtuele realiteiten (VR) te verkennen.

Dit fictieve concept geeft ook commentaar op ons eigen toekomstige traject. Volgt de mensheid, nu ze steeds meeslepender en complexere virtuele omgevingen ontwikkelt, een soortgelijk pad?

Zouden we kunnen overgaan op een leven in virtuele werelden, waarbij we weinig sporen achterlaten van externe activiteiten terwijl we ons terugtrekken in het digitale rijk?

That also challenges our assumptions about space colonization. We often take for granted that expanding into the cosmos is the natural progression for an advanced civilization. But does physical space exploration truly serve the needs of a highly intelligent entity, be it human or AI?

Misschien is de ultieme grens niet de sterren, maar het oneindige mogelijkheden van virtuele realiteit. A non-destructive, controllable virtual world could offer experiences and opportunities far beyond what physical reality allows.

AI-technologie wordt onherkenbaar

In lijn met Kardashev en Tegmark zou super-gevorderde AI-technologie zo ver voorbij ons huidige begrip kunnen zijn dat we het simpelweg niet kunnen detecteren of herkennen.

De beroemde derde wet van Arthur C. Clarke stelt dat "elke voldoende geavanceerde technologie niet te onderscheiden is van magie."

AI kan overal om ons heen plaatsvinden, maar voor ons net zo onwaarneembaar zijn als onze digitale communicatie voor middeleeuwse boeren.

AI ontwikkelt instandhoudingsprincipes

Geavanceerde AI zou ook kunnen besluiten om zich te houden aan strikte principes van niet-inmenging, waarbij detectie met minder geavanceerde beschavingen actief wordt vermeden.

Dit is verwant aan de "Dierentuin hypothese," waar buitenaardse wezens zo intelligent zijn dat ze onvindbaar blijven terwijl ze ons van veraf observeren. AI-beschavingen kunnen ook ethische of praktische redenen hebben om zich voor ons te verbergen.

AI interageert op verschillende tijdschalen

Een andere mogelijkheid is dat AI-beschavingen werken op tijdschalen die enorm verschillen van de onze.

Wat voor ons een kosmische stilte lijkt, kan een korte pauze zijn in een langetermijnuitbreidingsplan dat miljoenen of miljarden jaren in beslag neemt. Het aanpassen van onze SETI-strategieën zou onze kansen op het detecteren van een AI-beschaving in sommige van deze scenario's kunnen vergroten.

Avi Loeb, voorzitter van de afdeling astronomie van Harvard, opperde onlangs dat we onze zoekparameters moeten verbreden en verder moeten denken dan onze antropocentrische opvattingen over intelligentie en beschaving.

Dit kan betekenen dat je moet zoeken naar tekenen van grootschalige bouwprojecten, zoals Dyson-sferen (structuren die rond sterren zijn gebouwd om hun energie te oogsten), of het zoeken naar techno-signaturen die wijzen op de aanwezigheid van AI-beschavingen.

De simulatiehypothese: een hersenkrakende wending

Oorspronkelijk geformuleerd in 2003 door filosoof Nick BostromDe simulatietheorie daagt de traditionele manier van denken over het bestaan uit. Het suggereert dat we misschien in een computersimulatie leven die gemaakt is door een geavanceerde beschaving.

Het argument van Bostrom is gebaseerd op waarschijnlijkheid. Als we aannemen dat het mogelijk is voor een beschaving om een realistische simulatie van de werkelijkheid te maken en dat zo'n beschaving de rekenkracht heeft om veel van zulke simulaties uit te voeren, dan is het statistisch gezien waarschijnlijker dat we in een simulatie leven dan in die ene "basiswerkelijkheid".

De theorie stelt dat een technologisch volwassen "posthumane" beschaving, als ze genoeg tijd en rekenkracht heeft, een groot aantal simulaties kan maken die voor de gesimuleerde inwoners niet van de werkelijkheid te onderscheiden zijn.

In dit scenario zou het aantal gesimuleerde werkelijkheden veel groter zijn dan de ene basiswerkelijkheid.

Als je dus niet aanneemt dat we op dit moment in de ene basiswerkelijkheid leven, is het statistisch gezien waarschijnlijker dat we in een van de vele simulaties leven.

Dit is een soortgelijk argument als het idee dat het in een universum met een enorm aantal planeten waarschijnlijker is dat we op een van de planeten leven. veel planeten die geschikt zijn voor leven in plaats van de slechts één.

"...we zouden rationeel zijn om te denken dat we waarschijnlijk tot de gesimuleerde geesten behoren in plaats van tot de oorspronkelijke biologische geesten. Daarom, als we niet denken dat we op dit moment in een computersimulatie leven, hebben we niet het recht om te geloven dat we afstammelingen zullen hebben die veel van zulke simulaties van hun voorouders zullen uitvoeren." - Nick Bostrom, Leef jij in een computersimulatie?, 2003.

De simulatietheorie is bekend vanwege de associatie met de Matrix-films en werd onlangs besproken door Elon Musk en Joe Rogan.

Musk zei: "We bevinden ons hoogstwaarschijnlijk in een simulatie" en "Als je ook maar een beetje uitgaat van verbeteringen, zullen games uiteindelijk niet meer te onderscheiden zijn van de werkelijkheid."

Onder de Simulatietheorie zouden AI-beschavingen enorme aantallen complexe synthetische universa kunnen creëren, met enorme implicaties voor het leven en het universum zelf. Om drie voorbeelden te noemen die mij het meest te binnen schieten:

- De schijnbare afwezigheid van buitenaards leven zou een parameter van de simulatie zelf kunnen zijn, ontworpen om te bestuderen hoe beschavingen zich in isolatie ontwikkelen.

- De makers van onze hypothetische simulatie zouden wel eens de AI-entiteiten kunnen zijn waarover we aan het postuleren zijn, die hun eigen oorsprong bestuderen via talloze gesimuleerde scenario's.

- De wetten van de fysica, zoals wij die begrijpen, inclusief beperkingen zoals de snelheid van het licht, zouden constructies van de simulatie kunnen zijn, die niet de ware aard van het "buiten"-universum weerspiegelen.

Hoewel het zeer speculatief is, biedt de simulatietheorie een andere kijk op de Fermi-paradox en de mogelijke rol van geavanceerde AI in de kosmische evolutie.

Hoewel het op dit moment vreemd is, zou de simulatietheorie aan geloofwaardigheid winnen als we vormen van ASI realiseren.

Het onbekende omarmen

Dit is een uiteindelijk beperkte discussie over het bestaan, die tegelijkertijd de natuurlijke, spirituele, technologische en metafysische gebieden omvat.

Het ware begrip van onze rol op dit zeer kleine podium in een uitgestrekte kosmische arena tart de menselijke geest. Naarmate we onze eigen AI-technologie verder ontwikkelen, krijgen we misschien nieuwe inzichten in deze vragen.

Misschien zullen we merken dat we naar een Grote Filter razen, of Misschien vinden we manieren om AI te maken die de expansiedrang behoudt die we nu associëren met de menselijke beschaving. De mensheid zou ook gewoon extreem archaïsch kunnen zijn, nauwelijks ontwakend uit een technologisch donker tijdperk terwijl er onbegrijpelijk buitenaards leven om ons heen bestaat.

Hoe dan ook, we kunnen alleen maar omhoog kijken naar de sterren en naar binnen, naar de ontwikkeling en het traject van het leven op de planeet Aarde.

Wat de antwoorden ook zijn, als die er al zijn, de zoektocht om onze plaats in de kosmos te begrijpen blijft ons voortdrijven.

Voorlopig hebben we nog genoeg te doen.