Technici van Apple hebben een AI-systeem ontwikkeld dat complexe verwijzingen naar entiteiten op het scherm en gebruikersgesprekken oplost. Het lichtgewicht model zou een ideale oplossing kunnen zijn voor virtuele assistenten op apparaten.

Mensen zijn goed in het oplossen van verwijzingen in gesprekken met elkaar. Wanneer we termen als "de onderste" of "hem" gebruiken, begrijpen we waar de persoon naar verwijst op basis van de context van het gesprek en dingen die we kunnen zien.

Het is veel moeilijker voor een AI-model om dit te doen. Multimodale LLM's zoals GPT-4 zijn goed in het beantwoorden van vragen over afbeeldingen, maar zijn duur om te trainen en vereisen veel rekenoverhead om elke vraag over een afbeelding te verwerken.

De technici van Apple kozen voor een andere aanpak met hun systeem, ReALM (Reference Resolution As Language Modeling) genaamd. Het papier is de moeite waard om te lezen voor meer informatie over hun ontwikkelings- en testproces.

ReALM gebruikt een LLM voor het verwerken van conversatie-, scherm- en achtergrondentiteiten (alarmen, achtergrondmuziek) die deel uitmaken van de interacties van een gebruiker met een virtuele AI-agent.

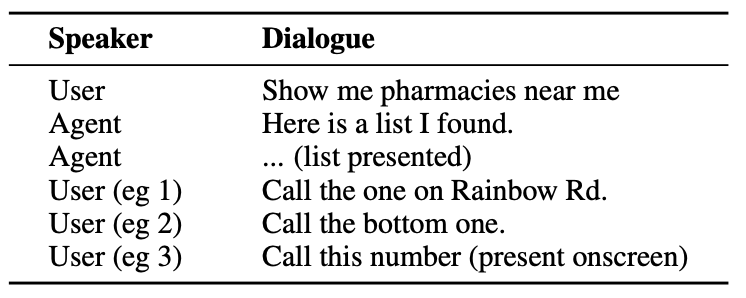

Hier is een voorbeeld van het soort interactie dat een gebruiker zou kunnen hebben met een AI-agent.

De agent moet de conversatie-entiteiten begrijpen, zoals het feit dat wanneer de gebruiker "the one" zegt, hij verwijst naar het telefoonnummer van de apotheek.

Het moet ook de visuele context begrijpen wanneer de gebruiker "de onderste" zegt, en hierin verschilt de benadering van ReALM van modellen zoals GPT-4.

ReALM vertrouwt op upstream encoders om eerst de elementen op het scherm en hun posities te ontleden. ReALM reconstrueert vervolgens het scherm in puur tekstuele representaties van links naar rechts en van boven naar beneden.

Eenvoudig gezegd gebruikt het natuurlijke taal om het scherm van de gebruiker samen te vatten.

Als een gebruiker nu een vraag stelt over iets op het scherm, verwerkt het taalmodel de tekstbeschrijving van het scherm in plaats van dat er een visiemodel nodig is om het beeld op het scherm te verwerken.

De onderzoekers maakten synthetische datasets van gespreks-, scherm- en achtergrondentiteiten en testten ReALM en andere modellen om hun effectiviteit te testen bij het oplossen van verwijzingen in gesprekssystemen.

De kleinere versie van ReALM (80M parameters) presteerde vergelijkbaar met GPT-4 en de grotere versie (3B parameters) presteerde aanzienlijk beter dan GPT-4.

ReALM is een klein model vergeleken met GPT-4. De superieure referentieresolutie maakt het een ideale keuze voor een virtuele assistent die op het apparaat kan bestaan zonder afbreuk te doen aan de prestaties.

ReALM presteert niet zo goed met complexere afbeeldingen of genuanceerde gebruikersverzoeken, maar het zou goed kunnen werken als virtuele assistent in de auto of op het apparaat. Stel je voor dat Siri het scherm van je iPhone zou kunnen "zien" en zou kunnen reageren op verwijzingen naar elementen op het scherm.

Apple is een beetje traag uit de startblokken gekomen, maar recente ontwikkelingen zoals hun MM1-model en ReALM laten zien dat er veel gebeurt achter gesloten deuren.