Een groep vooraanstaande wetenschappers heeft een vrijwillig initiatief gelanceerd waarin een aantal waarden, principes en toezeggingen voor het ontwerpen van AI-eiwitten uiteen worden gezet.

De brief bespreekt het mogelijke misbruik van AI-tools die in staat zijn om met ongekende snelheid en efficiëntie nieuwe eiwitten te ontwerpen.

Hoewel AI een enorme belofte inhoudt voor het aanpakken van urgente wereldwijde uitdagingen, van pandemieën tot duurzame energieoplossingen, roept het ook vragen op over de mogelijkheid van kwaadwillig gebruik, zoals het creëren van nieuwe biowapens.

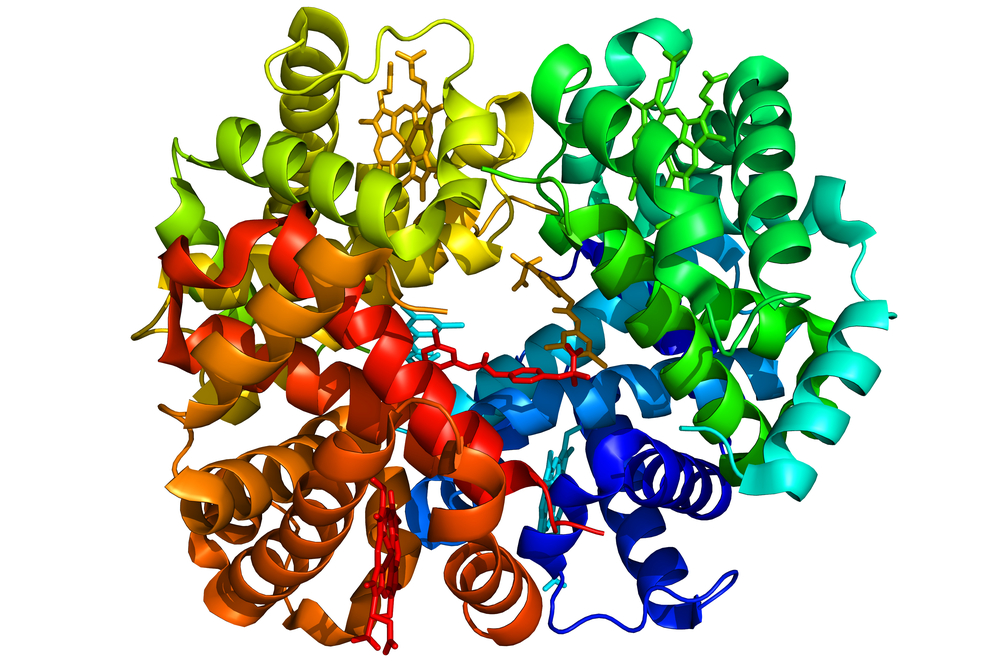

Terwijl de eiwitten die zijn ontworpen door DeepMind's AlphaFold-systeem en later door onderzoekers aan de University of Washington School of Medicine een hoge affiniteit en specificiteit voor hun beoogde doelen hebben aangetoond, bestaat altijd de mogelijkheid dat deze eiwitten op onverwachte manieren met andere moleculen in het lichaam interageren.

Dit kan leiden tot nadelige bijwerkingen of zelfs de ontwikkeling van nieuwe ziekten.

Een ander risico is de mogelijkheid van misbruik of kwaadwillig gebruik van deze technologie. Net zoals AI-ontworpen eiwitten kunnen worden gebruikt om zeer gerichte therapieën te creëren, kunnen ze ook worden ontworpen om schade aan te richten.

Een kwaadwillende actor kan bijvoorbeeld een eiwit ontwerpen dat gericht is op een specifieke etnische groep of misbruik maakt van een bepaalde genetische kwetsbaarheid.

Zoals David Baker, een computationeel biofysicus aan de Universiteit van Washington en een sleutelfiguur achter het initiatief, opmerkt: "De vraag was: hoe, of op welke manier, moet eiwitontwerp worden gereguleerd en wat zijn eventueel de gevaren?".

De meer dan 100 ondertekenaars geloven dat "de voordelen van de huidige AI-technologieën voor eiwitontwerp veel zwaarder wegen dan de potentiële schade", maar erkennen de noodzaak van een proactieve benadering van risicobeheer naarmate de technologie voortschrijdt.

AI voor de biologie heeft het potentieel om enkele van de belangrijkste problemen van onze samenleving op te lossen. Wetenschappelijke openheid is essentieel voor de vooruitgang van ons vakgebied. Als wetenschappers die betrokken zijn bij dit werk, met meer dan 90 ondertekenaars over de hele wereld, bevorderen we een raamwerk... pic.twitter.com/4m81j87Vo9

- Alex Rives (@alexrives) 8 maart 2024

In de brief staat dat "gezien de verwachte vooruitgang op dit gebied, een nieuwe proactieve benadering van risicobeheer nodig kan zijn om het potentieel te beperken van de ontwikkeling van AI-technologieën die, opzettelijk of anderszins, misbruikt kunnen worden om schade te berokkenen".

Ondertekend.

Een goed idee voor veiligheid bij het ontwerpen van eiwitten (al dan niet aangedreven door AI): regel en controleer de machines en firmware voor de eiwitsynthese, niet het AI-onderzoek zelf.

Dit idee heb ik gepromoot op de UK AI Safety Summit. https://t.co/skcUUcgG5a- Yann LeCun (@ylecun) 8 maart 2024

Als onderdeel van de initiatiefhebben onderzoekers een reeks waarden en principes geformuleerd die als leidraad moeten dienen voor de verantwoorde ontwikkeling van AI-technologieën bij het ontwerpen van eiwitten.

Deze omvatten "veiligheid, beveiliging, rechtvaardigheid, internationale samenwerking, openheid, verantwoordelijkheid en het nastreven van onderzoek ten voordele van de maatschappij". De ondertekenaars hebben ook vrijwillig ingestemd met een reeks specifieke, uitvoerbare verbintenissen op basis van deze waarden en principes.

Een belangrijk aspect van het initiatief richt zich op het verbeteren van de screening van DNA-synthese, een cruciale stap in het vertalen van door AI ontworpen eiwitten naar fysieke moleculen.

De wetenschappers verbinden zich ertoe om "alleen DNA synthese diensten af te nemen van leveranciers die kunnen aantonen dat ze zich houden aan de industrienorm voor bioveiligheid screening praktijken, die erop gericht zijn om gevaarlijke biomoleculen op te sporen voordat ze vervaardigd kunnen worden".

De vooruitgang van AI in de geneeskunde en biotechnologie is ongelooflijk geweest en heeft geleid tot nieuwe antibiotica en geneesmiddelen tegen veroudering.

Om deze bevindingen verder te brengen, verbinden de ondertekenaars zich ertoe om "samen te werken met belanghebbenden van over de hele wereld" en "zich te onthouden van onderzoek dat waarschijnlijk zal leiden tot algemene schade of misbruik van onze technologieën mogelijk zal maken".