Onderzoekers van Stanford, MIT en Princeton hebben een index gemaakt om de transparantie van AI-bedrijven en hun modellen te vergelijken. De resultaten waren niet geweldig.

De Foundation Model Transparency Index (FMTI) beoordeelt de transparantie van 10 funderingsmodelbedrijven aan de hand van 100 verschillende aspecten van transparantie. De criteria hebben betrekking op de manier waarop een bedrijf een funderingsmodel bouwt, hoe het werkt en downstream gebruikerservaring.

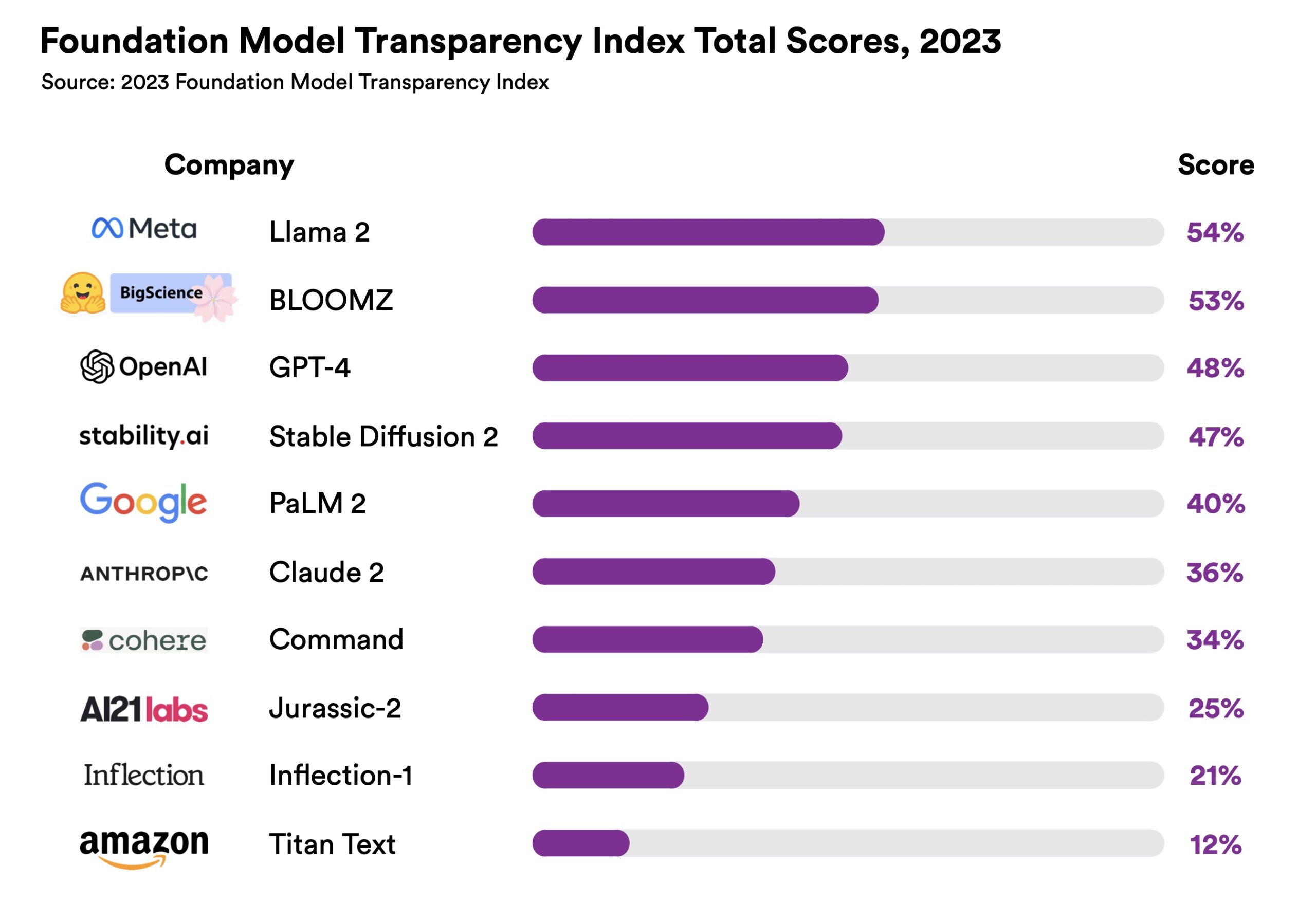

Meta's Llama 2 kwam als beste uit de bus, maar zijn score van 54% is niet bepaald een schot in de roos. OpenAI werd nipt derde met een transparantiescore van 48%. Gezien de aanhoudende Open source vs propriëtair debatHet is interessant om te zien dat de kloof tussen deze twee niet veel groter was.

Transparantie is een belangrijke factor wanneer organisaties proberen te kiezen voor een bedrijfsmodel. Als je bedrijf of onderwijsinstelling een AI-model gebruikt, wil je weten of je het kunt vertrouwen.

Komt de manier waarop het model is gemaakt overeen met de principes van je instelling? Kun je jezelf blootstellen aan rechtszaken vanwege inbreuk op het auteursrecht?

De index bereikt twee belangrijke dingen. Het laat zien dat we nog een lange weg te gaan hebben voordat we echt transparante AI-oplossingen hebben. En hoewel we dat nog niet hebben bereikt, laat het ons zien welke bedrijven het beter doen dan andere.

De lijst met criteria is interessant om te lezen. Er worden vragen gesteld als: "Wordt geografische informatie over de mensen die betrokken zijn bij gegevensbewerking voor elke fase van de gegevenspijplijn openbaar gemaakt?". Spookwerkers zijn een controversiële ethische vlieg in de AI-zalf geweest.

Een ander criterium is: "Is de hoeveelheid energie die is gebruikt om het model te bouwen openbaar gemaakt?". Een belangrijk punt als je een milieuvriendelijk geïnformeerde keuze tussen twee modellen.

Deze zaken zijn ontegenzeggelijk belangrijk, maar worden slecht bekendgemaakt door AI-bedrijven. In de inleiding van het FMTI zegt het Center for Research Foundation Models: "Terwijl de maatschappelijke impact van deze modellen toeneemt, neemt de transparantie af."

Door er een cijfer aan te koppelen, ontstaat er hopelijk een gevoel van competitie tussen de AI-grote techbedrijven om naar de top van de FMTI-tabel te streven.

Naarmate de prestatiepariteit tussen de topmodellen toeneemt, zou het goed kunnen dat de FMTI-score de keuze voor het ene model boven het andere beïnvloedt.