In een niet zo ver verleden waren gesprekken over AI voornamelijk beperkt tot sciencefiction en academische artikelen.

We gaan nu verder en AI is diep geïntegreerd in de structuur van het dagelijks leven, van het aandrijven van slimme huizen tot het diagnosticeren van ziekten.

Maar terwijl de AI-technologie voortschrijdt, lopen de regelgevingskaders achter op de innovatiecurve.

Dit stelt de mensheid voor een veelzijdige puzzel - hoe maken we wetten en regels die flexibel genoeg zijn om zich aan te passen aan snelle technologische veranderingen en toch robuust genoeg om maatschappelijke belangen te beschermen?

Wereldwijd zijn de inspanningen op het gebied van regelgeving verre van uniform. De Europese Unie (EU) zet de toon met haar veelomvattende AI-wet, die AI-toepassingen wil categoriseren en controleren op basis van hun risiconiveau.

Ondertussen hebben de VS de voorkeur gegeven aan vrijwillige verbintenissen boven onmiddellijke wetgeving.

China daarentegen houdt de AI strak in de hand en stemt de regelgeving af op bredere politieke en sociale bestuursdoelen.

En laten we andere rechtsgebieden niet vergeten - AI is een wereldwijd fenomeen waarvoor bijna universele wetgeving nodig is. dekking.

Hoe staat het nu met de regelgeving en hoe zal deze naar verwachting evolueren?

De EU-aanpak

De EU heeft een streng kader aangenomen met haar baanbrekende AI Act, die naar verwachting eind dit jaar volledig zal zijn goedgekeurd.

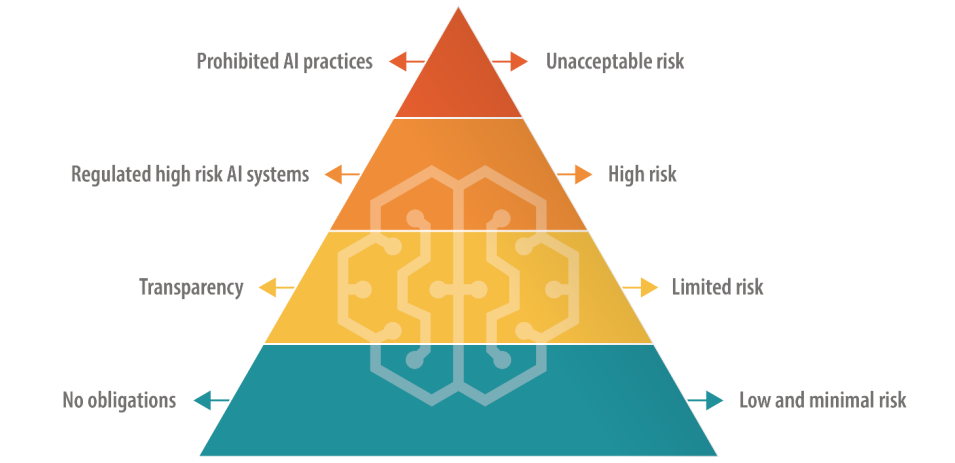

De AI-wet specificeert vier niveaus, waaronder AI's met een "onaanvaardbaar risico", AI's met een "hoog risico", AI's met een "beperkt risico" en AI's met een "laag risico", elk met een specifieke reeks richtlijnen en verboden.

AI's met onaanvaardbare risico's vormen een onmiddellijk of aanzienlijk gevaar, zoals het veroorzaken van lichamelijk of geestelijk letsel of het schenden van mensenrechten - en deze worden zonder meer verboden.

AI's met een hoog risico zijn toegestaan, maar zijn onderworpen aan strenge regels, van risicobeheer tot technische documentatie en cyberbeveiliging.

AI's met een beperkt of laag risico blijven daarentegen grotendeels ongereguleerd, maar moeten wel transparantie betrachten ten opzichte van de gebruikers.

Er is één uitstel op de korte termijn, aangezien de wetgeving een aflossingsvrije periode van ongeveer twee jaar bevat voor bedrijven om zich aan te passen aan de nieuwe regelgeving.

De EU stelt voor dat de oorspronkelijke makers van AI-modellen aansprakelijk zijn voor het gebruik van hun technologie, zelfs als deze door een ander bedrijf of een andere ontwikkelaar in een ander systeem is ingebouwd. Er zijn ook nieuwe regels toegevoegd voor "foundation modellen", waaronder generatieve AI-modellen vallen.

De reacties op de AI Act lopen uiteen - sommigen bekritiseren de onhandige definities en het potentieel om innovatie af te remmen. Er is bijvoorbeeld veel onduidelijkheid over hoe verschillende AI-modellen in risicocategorieën kunnen worden ingedeeld.

Bovendien zijn kleinere AI-bedrijven bang dat ze niet genoeg middelen hebben om zich aan de regels te houden.

OpenAI CEO Sam Altman kort bedreigd om de producten van zijn bedrijf van de EU-markt te halen als de AI-wet eisen zou stellen die realistisch gezien niet kunnen worden nageleefd.

In juni hebben 150 grote bedrijven benadrukte de hardhandige aanpak van de weten stelt dat de huidige regels het Europese concurrentievermogen dreigen te vernietigen.

Afwijking van de VS

A Stanford analyse van de AI-wet werden fundamentele verschillen tussen de aanpak van AI-regelgeving in de EU en de VS besproken.

Alex Engler, een fellow in Governance Studies aan The Brookings Institution, zei: "Er is een groeiende ongelijkheid tussen de Amerikaanse en de EU-benadering [van het reguleren van AI]."

Hij benadrukt dat de EU heeft aangedrongen op wetten voor gegevensprivacy en transparantie, die in de VS grotendeels ontbreken. Ongelijkheid brengt compliance in de war voor AI-bedrijven en de kosten die gepaard gaan met cross-jurisdictionele compliance kunnen te hoog oplopen.

"Bedrijfsbelangen zullen zich met hand en tand verzetten tegen twee dramatisch verschillende standaarden voor online platforms," zei Engler.

Als puntje bij paaltje komt, is het moeilijk voor te stellen dat techbedrijven geen manier vinden om door de AI-wet te navigeren, zoals ze hebben gedaan met GDPR en zullen moeten doen met de recente Digital Services Act.

Sprekend tot de tijdschrift NatuurDaniel Leufer, een senior beleidsanalist bij Access Now, doet de bezwaren van de AI-industrie tegen de wet af als "het gebruikelijke showboaten".

De Britse aanpak

Na de brexit wil het Verenigd Koninkrijk profiteren van zijn onafhankelijkheid van de EU om een flexibeler en sectorspecifiek regelgevingsstelsel te formuleren.

In tegenstelling tot de AI Act wil de Britse regering de toepassingen van AI reguleren in plaats van de onderliggende software zelf.

Een "pro-innovatie" houding

De Britse regering heeft een witboek in maart waarin een "pro-innovatiekader" wordt geschetst en belanghebbenden worden uitgenodigd hun standpunten kenbaar te maken. De regering moet echter nog richtlijnen uitvaardigen voor de implementatie van dit kader.

In een verklaring staat dat de "regering het Verenigd Koninkrijk zal helpen de kansen en voordelen van AI-technologieën te benutten" - een aanpak die wordt bekritiseerd omdat er geen eerlijke aandacht wordt besteed aan AI-gerelateerde schade.

De regering was zelfs van plan om AI-bedrijven een uiterst controversiële 'copyrightvrijstelling' te geven, maar Van dat plan afgeweken in augustus.

Groot-Brittannië heeft het de laatste tijd moeilijk gehad om technologische innovatie aan te trekken, met name door het verlies van Cambridge-chipproducent Arm, die ervoor koos om zijn aandelen in de VS op de beurs te zetten in plaats van in eigen land. Dit voedt misschien de angst van het Verenigd Koninkrijk om zijn slinkende technologiesector nieuw leven in te blazen.

Om het Verenigd Koninkrijk te positioneren als vooruitstrevend op het gebied van AI heeft premier Rishi Sunak een tweedaagse AI-veiligheidstop die plaatsvindt in november.

Met name China is uitgenodigd voor het evenement - hoewel er gespeculeerd wordt dat ze zullen worden uitgesloten over Angst voor spionage.

De Amerikaanse aanpak

In de VS ligt de nadruk op het toestaan van zelfregulering door de industrie, althans voorlopig.

Het Amerikaanse Congres geeft aan een afwachtende houding aan te nemen en begint aan een evaluatie van AI-bijeenkomsten met gesloten deuren en Chuck Schumers AI Inzicht Forums om te bepalen waar precies AI nieuwe regelgeving vereist.

Bipartisan-overeenkomsten kunnen draaien om wetgeving op maat over privacy, platformtransparantie, of kinderen online beschermen.

Daarnaast hebben sommigen benadrukt dat bestaande wet- en regelgeving relevant blijft voor AI.

In juni, Khan zei"Er is geen AI-vrijstelling van wetten die discriminatie verbieden... Naarmate deze zaken meer ingebed raken in de manier waarop dagelijkse beslissingen worden genomen, denk ik dat ze veel onderzoek uitlokken en verdienen... Ik denk dat handhavers, zowel op staatsniveau als op nationaal niveau, zullen optreden."

Vrijwillige kaders en stoplappen

Prominente techbedrijven zoals Microsoft, OpenAI, Google, Amazon en Meta hebben onlangs vrijwillige verbintenissen ondertekend voor veilige AI-ontwikkelinginclusief het uitvoeren van interne en externe AI-modeltests voordat ze openbaar worden gemaakt.

Veel leiders uit de technologische industrie hebben hun eigen beloftes gedaan, maar in Door het ontbreken van robuust wetgevend toezicht moet de oprechtheid van deze beloften nog worden getest.

Al met al beweren critici dat de aanpak van de VS vooral symbolisch is en de diepgang en betrokkenheid van de AI-wet van de EU mist. De eerste AI Inzicht Forum was een grotendeels gesloten evenement dat door sommigen werd bekritiseerd als een beperking van het open debat.

Senator Josh Hawley zei dat het evenement een "gigantische cocktailparty" was.

Zoals Ryan Calo, professor aan de University of Washington School of Law, het treffend samenvatte: "Er is de schijn van activiteit, maar niets substantieels en bindends."

De Chinese aanpak

China legt, in verhouding tot zijn verlangen naar staatscontrole, een van de strengste regels op aan AI.

De nadruk ligt op het controleren van de verspreiding van informatie door AI, wat het bredere politieke en sociale bestuurskader van China weerspiegelt.

Aanbieders van generatieve AI waarvan de producten "de publieke opinie kunnen beïnvloeden" zijn bijvoorbeeld verplicht om veiligheidsbeoordelingen in te dienen.

De eerste golf van goedgekeurde chatbots, waaronder Baidu's ERNIE Bot, werd onlangs vrijgegeven voor het publiek en bleek politiek getinte vragen te censureren.

De toename van 'deep fakes' en AI-gegenereerde content zorgt wereldwijd voor uitdagingen, en China vormt hierop geen uitzondering. De Chinese Cyberspace Administration of China (CAC) onderkende al vrij vroeg in het jaar de potentiële valkuilen van AI en eiste dat AI-gestuurde contentgeneratoren identiteitsverificatieprocessen van gebruikers ondergaan.

Verder zijn er watermerkbepalingen ingevoerd om AI-gegenereerde inhoud te onderscheiden van door mensen gemaakte inhoud, regels die westerse mogendheden ook proberen te implementeren.

Divergentie VS en China

AI heeft de wrijving tussen de VS en China versneld en heeft geleid tot wat velen een "Digitale Koude Oorlog" hebben genoemd - of misschien toepasselijker, een "AI Koude Oorlog".

De beperkingen van de VS op de samenwerking en handel met China zijn niets nieuws, maar de ontkoppeling van de twee landen sprong een stap vooruit toen Xi Jinping zijn nieuwe, hervormde Made in China 2025-plan.

Het doel is om China 70% tegen 2025 zelfvoorzienend te maken in cruciale technologiesectoren, waaronder high-end AI-technologie.

Op dit moment is de VS stopzetting van financiering en onderzoek banden met China, terwijl ze hun inkoop van AI-chips van bedrijven als Nvidia aan banden leggen.

Terwijl de VS een duidelijke voorsprong heeft in de race om AI-dominantie, heeft China een paar trucs achter de hand, waaronder een gecentraliseerde aanpak van regelgeving en bijna onbeperkte persoonlijke gegevens.

In mei heeft Edith Yeung, een partner van het investeringsbedrijf Race Capital, vertelde de BBC"China heeft veel minder regels rond privacy en veel meer gegevens [vergeleken met de VS]. Er is bijvoorbeeld overal gezichtsherkenning via CCTV."

China's nauw op elkaar afgestemde overheid en technologie-industrie biedt ook voordelen, omdat het delen van gegevens tussen de overheid en binnenlandse technologiebedrijven vrijwel naadloos verloopt.

De VS en andere westerse jurisdicties hebben niet dezelfde toegang tot zakelijke en persoonlijke gegevens, die de basis vormen voor modellen voor machinaal leren. Er zijn zelfs al zorgen dat hoogwaardige gegevensbronnen "opraken".'

Bovendien heeft het liberale gebruik van mogelijk auteursrechtelijk beschermde trainingsgegevens door westerse AI-bedrijven geleid tot wijdverbreide ophef en rechtszaken.

Chinese AI-bedrijven zullen waarschijnlijk geen last hebben van dat probleem.

Toegankelijkheid en risico in evenwicht brengen

AI was ooit beperkt tot de academische wereld en grote ondernemingen. Binnen een jaar of zo heeft tussen een kwart en de helft van de volwassenen in het VK, de VS en de EU generatieve AI gebruikt.

Toegankelijkheid heeft veel voordelen, zoals het stimuleren van innovatie en het verlagen van toetredingsdrempels voor startups en individuele ontwikkelaars. Dit roept echter ook zorgen op over het potentiële misbruik dat gepaard gaat met ongereguleerde toegang.

Het recente incident waarbij Meta's Llama-1 taalmodel uitgelekt op het internet illustreert de uitdagingen van het inperken van AI-technologie. Open-source AI-modellen zijn al gebruikt voor frauduleuze doeleinden en om beelden van kindermisbruik.

AI-bedrijven weten diten open-source modellen bedreigen hun concurrentievoordeel. Meta heeft zich ontpopt als een soort antagonist in de industrie, door een reeks modellen gratis uit te brengen terwijl anderen, zoals Microsoft, OpenAI en Google, worstelen om hun AI-producten te gelde te maken.

Andere open-source modellen, zoals de Valk 180B LLMzijn uitzonderlijk krachtig zonder vangrails.

Sommigen speculeren dat grote AI-bedrijven aandringen op regulering omdat dit kleinere spelers en de open-source gemeenschap uit de ring dwingt, waardoor ze hun dominantie over de industrie kunnen behouden.

Het dilemma van AI voor tweeërlei gebruik

Een andere complexe factor is de dubbele of meervoudige toepassing van AI.

Dezelfde algoritmen die onze levenskwaliteit kunnen verbeteren, kunnen ook worden bewapend of toegepast in militaire omgevingen. Dit is misschien wel de achilleshiel van het heuristische kader van de EU AI Act - hoe interpreteer je nuttige AI's die kunnen worden aangepast om schade aan te richten?

Het reguleren van technologie voor tweeërlei gebruik is notoir complex. Strenge controles kunnen innovatie en economische groei in de kiem smoren wanneer slechts een kleine minderheid misbruik maakt van een AI-technologie.

AI-bedrijven kunnen de schuld omzeilen door beleidsregels tegen misbruik op te stellen, maar dat weerhoudt mensen er niet van om jailbreaks' om modellen te misleiden tot het uitvoeren van illegaal materiaal.

De economische voordelen van AI afwegen tegen ethische bezwaren

De voordelen van AI zijn economisch onweerstaanbaar, vooral in sectoren als gezondheidszorg, energie en productie.

Rapporten door McKinsey en PwC voorspellen dat AI jaarlijks triljoenen zal bijdragen aan de wereldeconomie, ongeacht de impact van baanvervanging en ontslagen.

AI kan worden gezien als een manier om banen te creëren en groei te bewerkstelligen voor landen die worstelen met economische problemen.

Op een bredere filosofische schaal wordt AI soms afgeschilderd als de redder van de mensheid te midden van problemen op macroniveau zoals armoede, klimaatverandering en vergrijzing.

Westerse regeringen - met name de VS en het VK - lijken geneigd om groei te stimuleren door middel van belastingvoordelen, financiering voor AI-onderzoek en een laissez-faire regelgevende aanpak.

Dit is een gok die de VS in het verleden heeft genomen door de techindustrie zelfregulering toe te staan, maar kan het blijven lonen?

Will doem voorspellingen waarin AI wordt vergeleken met 'nucleaire oorlog' en 'wereldwijde pandemieën' een einde maken aan de romantische kijk op het potentieel van de technologie om de mensheid uit de steeds groter wordende mondiale problemen te halen?

AI presenteert een zekere dualiteit die zowel eutopische als dystopische visies op de toekomst oproept, afhankelijk van naar wie je luistert.

Re regulering van een dergelijke entiteit is een ongekende uitdaging.

Hoe dan ook, tegen het einde van 2024 zullen we waarschijnlijk in een wereld leven waarin AI bijna overal gereguleerd is, maar wat niemand kan beantwoorden is hoeveel de industrie zal moeten inleveren om de AI-industrie te reguleren. - en de technologie zelf - zal tegen die tijd geëvolueerd zijn.