Artiesten en ontwerpers leggen AI-ontwikkelaars het vuur aan de schenen over mogelijke schending van het auteursrecht.

Typ een prompt in een AI-afbeeldingsgenerator zoals DALL-E, MidJourney of Stable Diffusion en het produceert binnen enkele seconden een schijnbaar unieke afbeelding.

Ondanks hun schijnbaar unieke karaktereze beelden worden gegenereerd uit miljarden andere beelden via wat beschreven kan worden als een complexe digitale collagetechniek.

De bronafbeeldingen zijn afkomstig van 'openbare' of 'open' bronnen.

Als je ChatGPT vraagt hoe een afbeeldingengenerator als DALL-E werkt, zal het iets zeggen als: "Zie DALL-E als een super geavanceerde digitale kunstenaar, die miljoenen afbeeldingen heeft gezien en een nieuwe kan tekenen op basis van jouw beschrijving, waarbij hij probeert deze zo nauwkeurig mogelijk te maken. Het doet dit door elementen die het heeft geleerd van eerdere 'observaties' te mixen en te matchen."

Het is een beetje zoals ronddwalen door kunstgalerijen over de hele wereld en foto's maken van elk werk - behalve dat je er niet uitgeschopt kunt worden.

Het internet heeft geen bewakers en camera's die mensen in de gaten houden om piraterij of diefstal te voorkomen, en de praktijk van data scraping - waarbij gegevens van het internet worden verzameld met behulp van bots - heeft altijd een onduidelijk juridisch gebied bezet.

Kunstenaars beweren dat het trainen van tekst-naar-beeld AI's op openbare datasets gelijk staat aan 's werelds grootste kunstroof.

Hoe voelen AI-detectors zich bij kunstenaars?

Voor sommige succesvolle kunstenaars van wie het werk duizenden - zelfs miljoenen - keren is gekopieerd, hebben de gevolgen van AI-gegenereerde kunst het moeilijk gemaakt om onderscheid te maken tussen hun eigen werk en AI-kopieën.

De esthetische verschillen zijn gewoon te klein, waarschijnlijk omdat populaire afbeeldingen veel voorkomen in datasets.

Onder hen Greg Rutowski, die zei: "Mijn werk is meer gebruikt in AI dan Picasso."

Rutowki's fantasy-illustraties komen voor in franchises zoals Dungeons and Dragons en Magic: The Gathering en kunnen worden nagemaakt via tekst-naar-beeld-generators door simpelweg de naam van de artiest toe te voegen aan de prompt, bijvoorbeeld "Maak een draak die vecht tegen een ogre in de stijl van Greg Rutowski".

Hij vertelde de BBCDe eerste maand dat ik het ontdekte, realiseerde ik me dat het mijn carrière duidelijk zal beïnvloeden en dat ik mijn eigen werk niet meer zal kunnen herkennen en vinden op het internet", en hij voegde eraan toe: "De resultaten zullen worden geassocieerd met mijn naam, maar het zal niet mijn afbeelding zijn. Het is niet door mij gemaakt. Het zal dus verwarring scheppen voor mensen die mijn werk ontdekken."

Hij vervolgde: "Alles waar we zoveel jaren aan hebben gewerkt is ons zo gemakkelijk afgenomen met AI."

De laatste uitspraak raakt echt het doel, want de reproductie van complexe, getalenteerde werken door AI duurt slechts enkele seconden, waardoor niet alleen het werk van kunstenaars overbodig wordt, maar ook de vaardigheden die gebruikt zijn om ze te maken verloren gaan.

De mensheid lHet ontbreken van authentieke vaardigheden en kennis is een van de meest urgente risico's van AI, ook wel "verzwakking," geïllustreerd door de Disneyfilm WALL-E, waarin mensen het vermogen om te bewegen verliezen door technologie.

Een andere kunstenaar die zich uitsprak over AI die hun werk reproduceert is Kelly McKernan, een illustrator uit Tennessee die ontdekte dat meer dan 50 kunstwerken van haar waren opgenomen als trainingsgegevens in het Large-scale Artificial Intelligence Open Network (LAION).

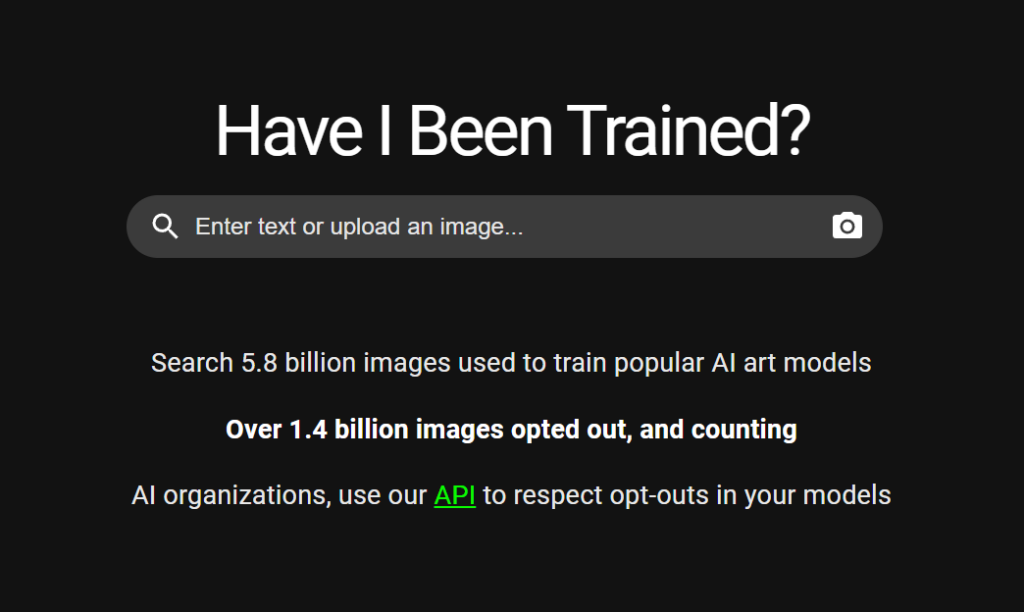

Je kunt zo'n 5,8 miljard afbeeldingen in AI-trainingssets doorzoeken met de tool "Ben ik getraind?"Zo stuitte McKernan op haar werk.

LAION is een non-profitorganisatie die open-sourced modellen en datasets creëert, waarvan er veel zijn gebruikt om spraakmakende tekst-naar-beeldmodellen te trainen, waaronder Stable Diffusion en Imagen.

"Plotseling kregen al deze schilderijen waar ik een persoonlijke relatie en reis mee had een nieuwe betekenis, het veranderde mijn relatie met die kunstwerken," zei McKernan.

Juridische gevechten zijn aan de gang

McKernan heeft samen met collega-kunstenaars Sarah Anderson en Karla Ortiz juridische stappen ondernomen tegen Stability AI, DeviantArt en Midjourney.

Hun rechtszaak voegt zich bij een stroom van juridische stappen tegen AI-bedrijven door zowel schrijvers als beeldend kunstenaars.

Grotere bedrijven klagen ook AI-ontwikkelaars aan of zijn van plan dit te doen, waaronder Getty Images, dat beweerde dat Stability AI 12 miljoen van zijn afbeeldingen zonder toestemming onrechtmatig had gekopieerd en verwerkt.

McKernan zei: "Zoals het nu is, kan het auteursrecht alleen worden toegepast op mijn volledige afbeelding. Ik hoop dat het [de rechtszaak] de bescherming van artiesten bevordert, zodat AI niet kan worden gebruikt om ons te vervangen. Als we winnen, hoop ik dat veel artiesten betaald krijgen. Het is gratis arbeid en sommige mensen profiteren van uitbuiting."

McKernan's stijl, hieronder te zien, is gevraagd in zo'n 12.000 MidJourney-prompts.

Bekijk dit bericht op Instagram

Een fundamenteel probleem hier is dat het auteursrecht simpelweg niet gemaakt is voor het tijdperk van AI.

Liam Budd van de vakbond voor uitvoerende kunsten en entertainment Equity pleitte voor bijgewerkte wetten die de potentiële zakelijke mogelijkheden van generatieve AI weerspiegelen.

Hij verklaarde"We hebben meer duidelijkheid in de wet nodig en voeren campagne om de Copyright Act aan te passen."

Als reactie op het toenemende aantal auteursrechtschendingen door AI hebben verschillende rechtsgebieden, zoals de EU, voorgesteld dat AI-ontwikkelaars al het auteursrechtelijk beschermde materiaal dat voor training wordt gebruikt, openbaar moeten maken.

Zal dat genoeg zijn? Hebben AI-ontwikkelaars al laten zien dat ze er waarschijnlijk mee wegkomen?

De meeste van deze datasets zijn immers al samengesteld en AI-bedrijven zouden kunnen aanvoeren dat ze alleen maar modellen bijwerken om te voorkomen dat ze auteursrechtelijk beschermd materiaal moeten aangeven.

Hebben de rechtszaken een solide juridische basis?

Deze huidige ronde van collectieve rechtszaken draait grotendeels om twee argumenten.

- Ten eerste de bewering dat de bedrijven inbreuk hebben gemaakt op de auteursrechten van artiesten door hun werken zonder toestemming te gebruiken.

- Ten tweede, de bewering dat de AI-outputs in wezen afgeleide inhoud zijn omdat ze zijn opgenomen in de trainingsgegevens.

De toepassing van deze argumenten verschilt wereldwijd, zoals in de VS, waar 'fair use'-wetten over het algemeen liberaler zijn dan in de EU. Dit maakt het auteursrechtlandschap voor AI nog ingewikkelder. Als bedrijven bijvoorbeeld actief zijn in het Verenigd Koninkrijk, kunnen ze het lastiger vinden om 'fair use' te beargumenteren.

Bovendien worden generatieve AI-bedrijven aangeklaagd, niet de entiteiten die de datasets samenstellen, zoals LAION in het geval van MidJourney. Eliana Torres, een advocaat intellectueel eigendom bij het advocatenkantoor Nixon Peabody, wijst erop dat als LAION de dataset heeft gemaakt, de vermeende inbreuk op dat moment plaatsvond, niet toen de dataset werd gebruikt om de modellen te trainen.

Bewijzen dat AI-gegenereerde werken reproducties zijn van originele werken is een uitdaging vanwege de complexe aard van de AI, die algoritmische verwerking gebruikt om beelden te ontleden en opnieuw samen te stellen.

Regelgevende instanties zijn overvallen door de juridische implicaties van generatieve AI en hoewel er tijdelijke oplossingen worden ontwikkeld, zoals geautomatiseerde filters en opt-outbepalingen voor kunstenaars, zijn deze mogelijk niet voldoende.

Totdat rechters een uitspraak doen in individuele zaken, wat maanden kan duren, stellen AI-bedrijven zich bloot aan aanzienlijke juridische risico's in vele rechtsgebieden.

De geschiedenis wijst uit dat het auteursrecht zich kan aanpassen aan nieuwe technologie, maar zolang er geen consensus is, tasten zowel kunstenaars als AI-ontwikkelaars in het duister.

Rechters zetten de dempers op rechtszaken

Tot nu toe hebben de juryleden de artiesten weinig gegeven om optimistisch over te zijn.

Zo trok US District Judge William Orrick de rechtszaak tegen Kelly McKernan in twijfel.

Volgens rechter OrrickMcKernan en de andere aanklagers moesten "meer feiten verstrekken" over de vermeende inbreuk op het auteursrecht en hun claims tegen elk bedrijf (Stability AI, DeviantArt en Midjourney) duidelijk onderscheiden.

Orrick merkte op dat de systemen waren getraind op "vijf miljard gecomprimeerde afbeeldingen", dus artiesten moeten sterker bewijs leveren dat hun werken specifiek betrokken waren bij de vermeende inbreuk op het auteursrecht. A website die deze rechtszaak volgt heeft onlangs technische informatie geüpload over hoe deze modellen werken door inhoud van afbeeldingen in hun trainingsset te interpoleren.

De zaak wordt vertegenwoordigd door de Advocatenkantoor Joseph Saveridie ook minstens 5 andere soortgelijke zaken tegen AI-bedrijven vertegenwoordigt.

En nogmaals, auteursrecht wordt mogelijk geschonden bij het verzamelen van gegevens in plaats van bij het genereren ervan.

Sectie 1202(b) van de Amerikaanse Digital Millennium Copyright Act "gaat over identieke 'kopieën ... van een werk' - niet over losse fragmenten en aanpassingen," - argumenteren dat werken worden 'gekopieerd' door het proces van het AI-model is potentieel zwak.

De standpunten van Orrick roepen ook vragen op over de aansprakelijkheid van bedrijven als MidJourney en DeviantArt, die de Stable Diffusion-technologie van Stability AI verwerken in hun eigen generatieve AI-systemen.

IAls AI-ontwikkelaars, zoals OpenAI, Meta, etc., enige aansprakelijkheid krijgen voor het schenden van auteursrechten van artiesten, zijn ze kwetsbaar voor verdere juridische stappen.

Auteurs en schrijvers starten ook rechtszaken

In een andere recente rechtszaakDe Amerikaanse komiek en schrijfster Sarah Silverman en auteurs Christopher Golden en Richard Kadrey beweren dat hun woorden onrechtmatig zijn gebruikt om AI-modellen zoals ChatGPT en LLaMA te trainen.

De rechtszaak is vergelijkbaar met die van beeldend kunstenaars, maar deze keer zijn de AI's getraind op openbare tekstgegevens.

De rechtszaak beweert dat ChatGPT in staat was om boeken zoals "The Bedwetter" van Silverman, "Ararat" van Golden en "Sandman Slim" van Kadrey nauwkeurig samen te vatten. Cruciaal is dat het detailniveau van de samenvattingen niet kan worden verklaard door uittreksels van de boeken die zijn geüpload op Wikipedia of websites van boekhandels.

De aanklagers beschuldigen OpenAI en Meta van het zonder toestemming gebruiken van auteursrechtelijk beschermde boeken uit "schaduwbibliotheken".

Schaduwbibliotheken, zoals Bibliotik, Library Genesis en Z-Library, huisvesten grote hoeveelheden illegaal gekopieerde informatie.

Hoewel het duidelijk is dat AI-bedrijven producten te gelde hebben gemaakt met behulp van auteursrechtelijk beschermd werk, hebben ze verschillende beschermingslagen, waaronder de inherent complexe aard van hun modellen en de eigenzinnige ruimte die ze innemen in het morele, ethische en juridische landschap.

Wat moeten rechtbanken beslissen?

Terwijl regelgevers nog steeds nadenken over regels rondom AI, kunnen rechters misschien als eerste het toekomstige auteursrechtenlandschap vormgeven.

Dit kan resulteren in een lappendeken van wetgeving die beperkt wordt door de specifieke kenmerken van elke zaak en het rechtsgebied waarin de uitspraak werd gedaan.

Op dit moment zijn er veel vragen te beantwoorden, waaronder:

V1: Is er een licentie nodig voor het trainen van een model op auteursrechtelijk beschermd materiaal?

- Eerlijk gebruik vs. licenties: Rechtbanken moeten misschien beslissen of het tijdelijk kopiëren van gegevens tijdens een training onder "eerlijk gebruik" valt, wat het gebruik zonder licentie zou toestaan. Dit zou kunnen afhangen van factoren zoals het doel van het kopiëren, de aard van het auteursrechtelijk beschermde werk, de hoeveelheid en substantie van het gebruikte gedeelte en het effect op de marktwaarde van het auteursrechtelijk beschermde werk.

- Internationale perspectieven: Verschillende rechtsgebieden kunnen verschillende standpunten hebben over deze kwestie. De EU Copyright Directive kan bijvoorbeeld anders geïnterpreteerd worden dan de Amerikaanse Copyright Act.

V2: Maakt generatieve AI-output inbreuk op het auteursrecht van de materialen waarop het model is getraind?

- Afgeleid werk bepalen: Is de generatieve output gewoon een transformatie of creëert het eigenlijk een afgeleid werk dat het auteursrecht schendt? Deze vraag kan een complexe analyse van gelijkenis en creativiteit vereisen.

- Aansprakelijkheid: Als er sprake is van inbreuk, wie is er dan aansprakelijk? De maker van de AI? De gebruiker van de AI? De distributeur?

V3: Schendt generatieve AI beperkingen op het verwijderen, wijzigen of vervalsen van informatie over copyrightbeheer?

- Specifieke gevallen: Analyse van specifieke algoritmen zoals Stable Diffusion kan nodig zijn om te bepalen of gegenereerde werken watermerken of andere auteursrechtinformatie per ongeluk kunnen reproduceren of manipuleren.

- Opzet vs. toevallige inbreuk: Het kan zijn dat de rechter moet bepalen of het de bedoeling was om auteursrechtelijke informatie te verwijderen of te wijzigen of dat dit een onbedoeld gevolg was van de werking van de AI.

V4: Schendt het genereren van werk in de stijl van iemand de rechten van die persoon?

- Het recht op publiciteit definiëren: Het recht op publiciteit verschilt van rechtsgebied tot rechtsgebied. Rechtbanken moeten mogelijk interpreteren of het creëren van werken in iemands stijl gelijk staat aan het gebruiken van hun gelijkenis of identiteit.

- Commercieel vs. niet-commercieel gebruik: De toepassing kan verschillen afhankelijk van het feit of de output van de AI al dan niet wordt gebruikt voor commercieel gewin.

V5: Hoe zijn open-source licenties van toepassing op het trainen van AI-modellen en het verspreiden van de resulterende uitvoer?

- Open source licenties begrijpen: Mogelijk moeten rechtbanken bepalen hoe open source licenties van toepassing zijn op AI-trainingsgegevens en gegenereerde output.

Op dit moment missen we één ding: een uitspraak. Op dit moment zou het dwaas zijn om te voorspellen of het zomaar schrapen van gegevens acceptabel blijft. Als makers een zwakke plek vinden in het juridische pantser van de AI-industrie, kan de schade groot zijn. Maar het lijkt een grote als.

Zodra de uitspraken beginnen door te dringen en de regelgeving van kracht wordt, zou de toekomstige richting van AI duidelijker moeten worden. - Tot de volgende reeks uitdagingen.