Alibaba lanserte mer enn 100 AI-modeller med åpen kildekode, inkludert Qwen 2.5 72B, som slår andre modeller med åpen kildekode i matematikk- og kodingsbenchmarks.

Mye av AI-bransjens oppmerksomhet innen modeller med åpen kildekode har vært rettet mot Metas innsats med Llama 3, men Alibabas Qwen 2.5 har lukket gapet betydelig. Den nylig lanserte Qwen 2.5-familien av modeller varierer i størrelse fra 0,5 til 72 milliarder parametere med generaliserte basismodeller samt modeller som fokuserer på svært spesifikke oppgaver.

Alibaba sier at disse modellene kommer med "forbedret kunnskap og sterkere evner innen matematikk og koding" med spesialiserte modeller som fokuserer på koding, matematikk og flere modaliteter, inkludert språk, lyd og syn.

Alibaba Cloud kunngjorde også en oppgradering av sin egen flaggskipmodell Qwen-Max, som de ikke har gitt ut som åpen kildekode. Qwen 2.5 Max-benchmarkene ser bra ut, men det er Qwen 2.5 72B-modellen som har skapt mest begeistring blant open source-fans.

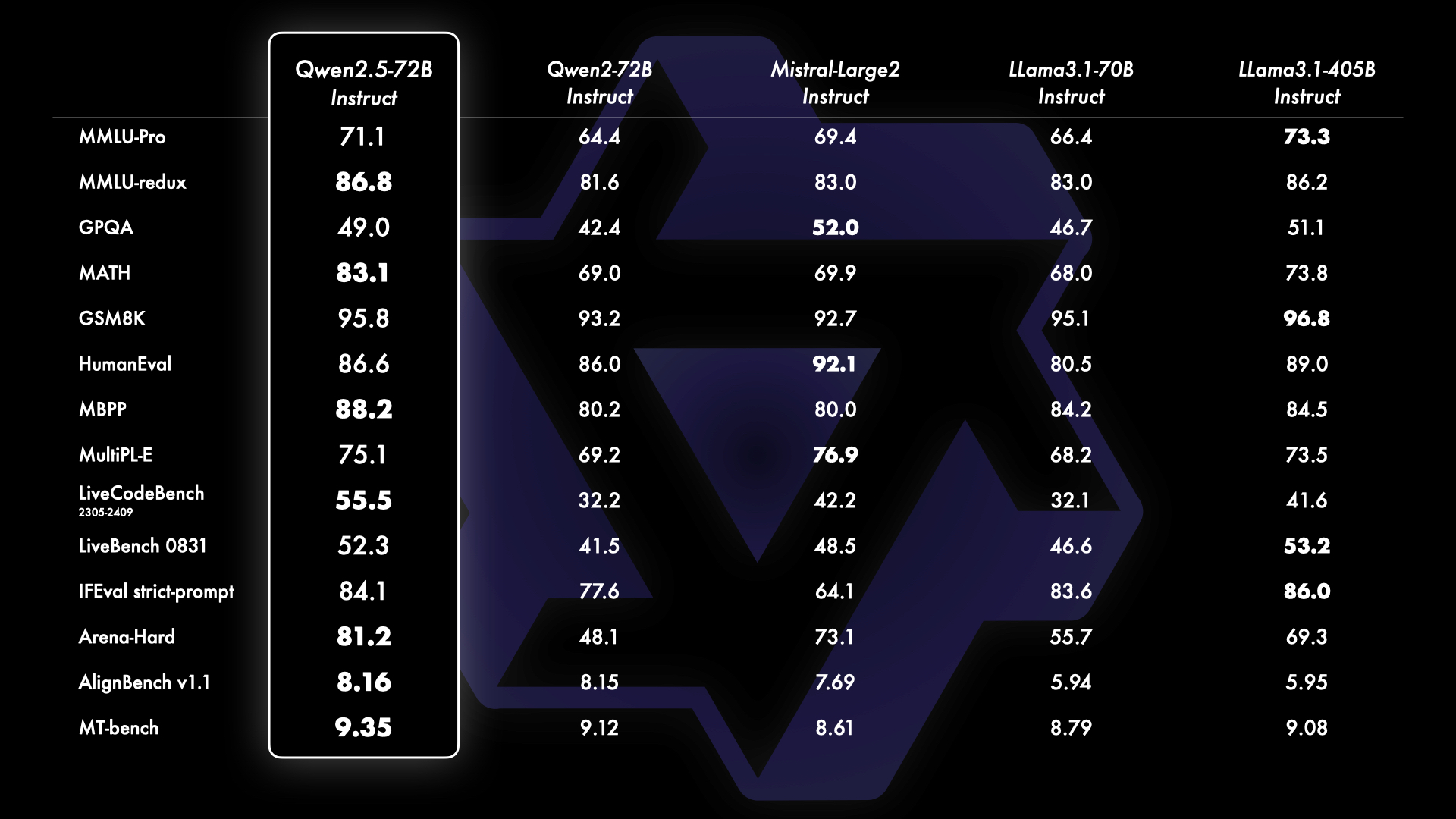

Referansetestene viser at Qwen 2.5 72B slår Metas mye større flaggskip Llama 3.1 405B modellen på flere fronter, spesielt innen matematikk og koding. Gapet mellom modeller med åpen kildekode og proprietære modeller som OpenAI og Google blir også stadig mindre.

Tidlige brukere av Qwen 2.5 72B viser at modellen ligger rett under Sonnet 3.5 og til og med slår OpenAI's o1-modeller i koding.

Qwen 2.5 med åpen kildekode slår o1-modeller på koding 🤯🤯

Qwen 2.5 scorer høyere enn o1-modellene på koding på Livebench AI

Qwen ligger rett under Sonnet 3.5, og for en åpen kildekode-modus er det kjempebra!!!

o1 er god på vanskelig koding, men elendig på problemer med å fullføre koden og... pic.twitter.com/iazam61eP9

- Bindu Reddy (@bindureddy) 20. september 2024

Alibaba sier at disse nye modellene alle ble trent på sitt store datasett som omfatter opptil 18 billioner tokens. Qwen 2.5-modellene kommer med et kontekstvindu på opptil 128k og kan generere utganger på opptil 8k tokens.

Overgangen til mindre, mer kapable gratismodeller med åpen kildekode vil sannsynligvis ha større innvirkning på mange brukere enn mer avanserte modeller som o1. Disse modellenes kant- og enhetsfunksjoner gjør at du kan få mye ut av en gratismodell som kjører på den bærbare datamaskinen din.

Den mindre Qwen 2.5-modellen leverer koding på GPT-4-nivå til en brøkdel av prisen, eller til og med gratis hvis du har en anstendig bærbar PC som kan kjøre den lokalt.

Vi har GPT-4 for koding hjemme! Jeg slo opp OpenAI?ref_src=twsrc%5Etfw”>@OpenAI GPT-4 0613-resultater for ulike referanseverdier og sammenlignet dem med @Alibaba_Qwen 2,5 7B-koder. 👀

> 15 måneder etter lanseringen av GPT-0613 har vi en åpen LLM under Apache 2.0, som fungerer like bra. 🤯

> GPT-4-priser... pic.twitter.com/2szw5kwTe5

- Philipp Schmid (@_philschmid) 22. september 2024

I tillegg til LLM-ene lanserte Alibaba en betydelig oppdatering av sin visjonsspråkmodell med introduksjonen av Qwen2-VL. Qwen2-VL kan forstå videoer som varer i over 20 minutter, og støtter videobaserte spørsmålssvar.

Den er utviklet for integrering i mobiltelefoner, biler og roboter for å muliggjøre automatisering av operasjoner som krever visuell forståelse.

Alibaba avduket også en ny tekst-til-video-modell som en del av sin bildegenerator, Tongyi Wanxiang large model family. Tongyi Wanxiang AI Video kan produsere videoinnhold av kinokvalitet og 3D-animasjon med ulike kunstneriske stiler basert på tekstmeldinger.

Demoene ser imponerende ut, og verktøyet er gratis å bruke, selv om du trenger et kinesisk mobilnummer for å registrer deg for det her. Sora kommer til å få alvorlig konkurranse når, eller hvis, OpenAI etter hvert lanserer den.