Meta har lansert sine oppgraderte Llama 3.1-modeller i versjonene 8B, 70B og 405B, og har forpliktet seg til Mark Zuckerbergs visjon om åpen kildekode for fremtidens AI.

De nye tilskuddene til Metas Llama-familie av modeller kommer med en utvidet kontekstlengde på 128k og støtte for åtte språk.

Meta sier at den etterlengtede 405B-modellen demonstrerer "uovertruffen fleksibilitet, kontroll og toppmoderne funksjoner som kan konkurrere med de beste lukkede kildekodemodellene". De hevder også at Llama 3.1 405B er "verdens største og mest kapable åpent tilgjengelige grunnmodell".

Med iøynefallende datakostnader som brukes til å trene stadig større modeller, var det mange spekulasjoner om at Metas flaggskip 405B-modell kunne være den første betalte modellen.

Llama 3.1 405B ble trent på over 15 billioner tokens ved hjelp av 16 000 NVIDIA H100-enheter, noe som sannsynligvis kostet hundrevis av millioner dollar.

I en blogginnleggbekreftet Meta-sjef Mark Zuckerberg selskapets syn på at AI med åpen kildekode er veien videre, og at lanseringen av Llama 3.1 er neste skritt "mot at AI med åpen kildekode blir bransjestandarden."

Llama 3.1-modellene kan lastes ned gratis og modifiseres eller finjusteres med en rekke tjenester fra Amazon, Databricks og NVIDIA.

Modellene er også tilgjengelige hos skytjenesteleverandører som AWS, Azure, Google og Oracle.

Fra og med i dag viser åpen kildekode vei. Vi introduserer Llama 3.1: Våre mest kapable modeller hittil.

I dag lanserer vi en samling nye Llama 3.1-modeller, inkludert vår etterlengtede 405B. Disse modellene leverer forbedrede resonneringsegenskaper, en større 128K token-kontekst... pic.twitter.com/1iKpBJuReD

- AI på Meta (@AIatMeta) 23. juli 2024

Ytelse

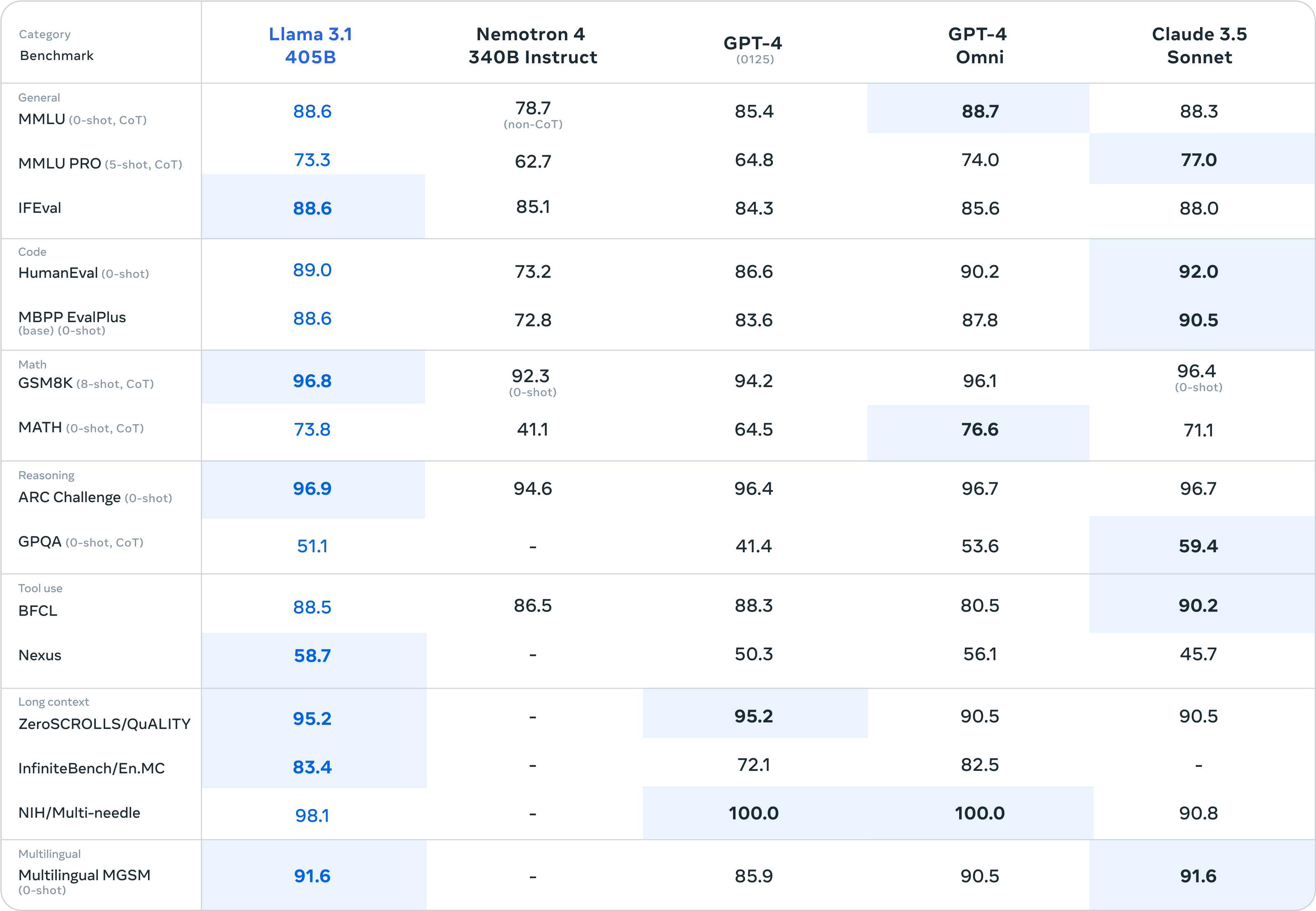

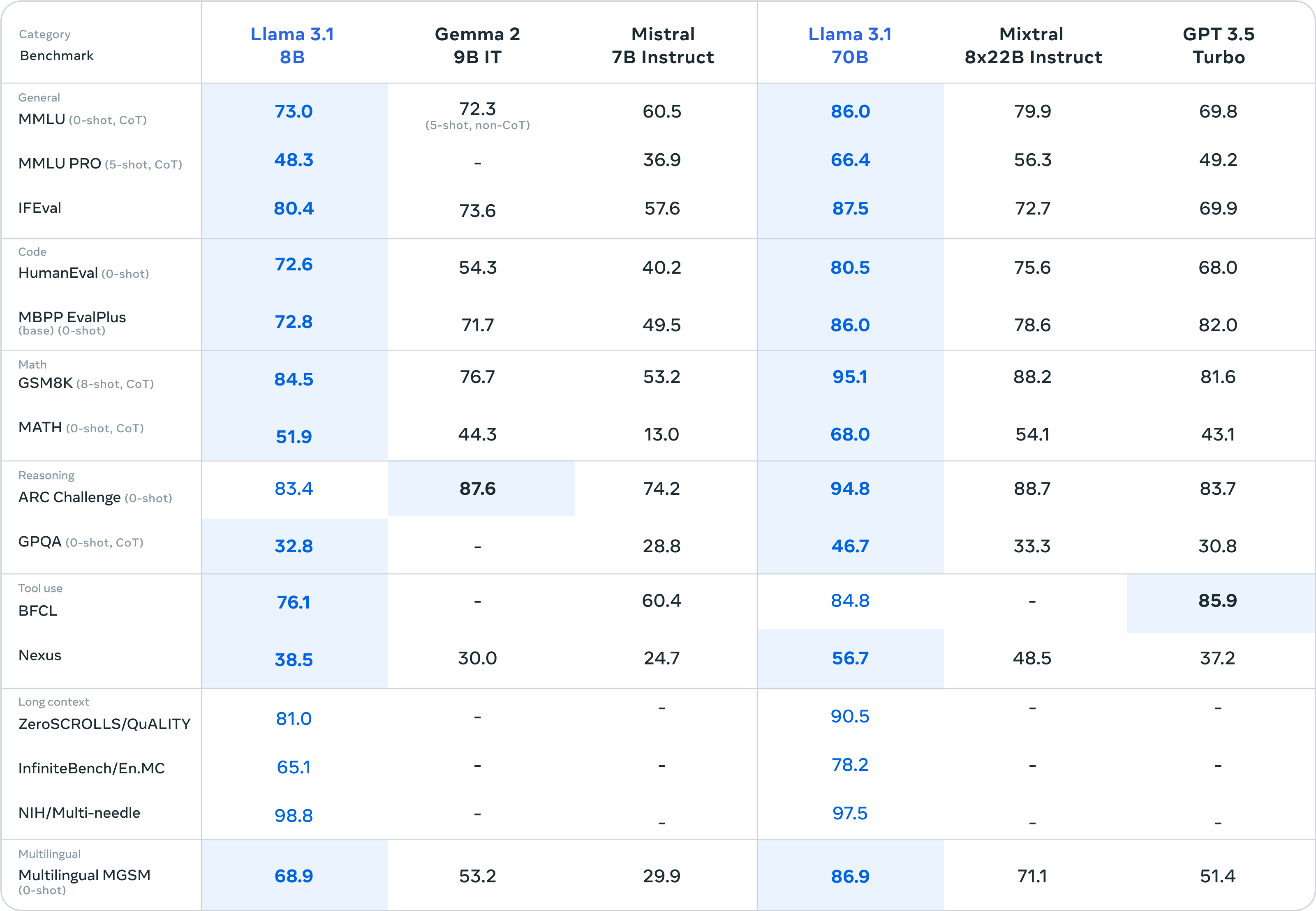

Meta sier at de har testet modellene sine på over 150 referansedatasett og publisert resultater for de vanligste referansene for å vise hvordan de nye modellene står seg mot andre ledende modeller.

Det er ikke mye som skiller Llama 3.1 405B fra GPT-4o og Claude 3.5 Sonnet. Her er tallene for 405B-modellen og deretter de mindre 8B- og 70B-versjonene.

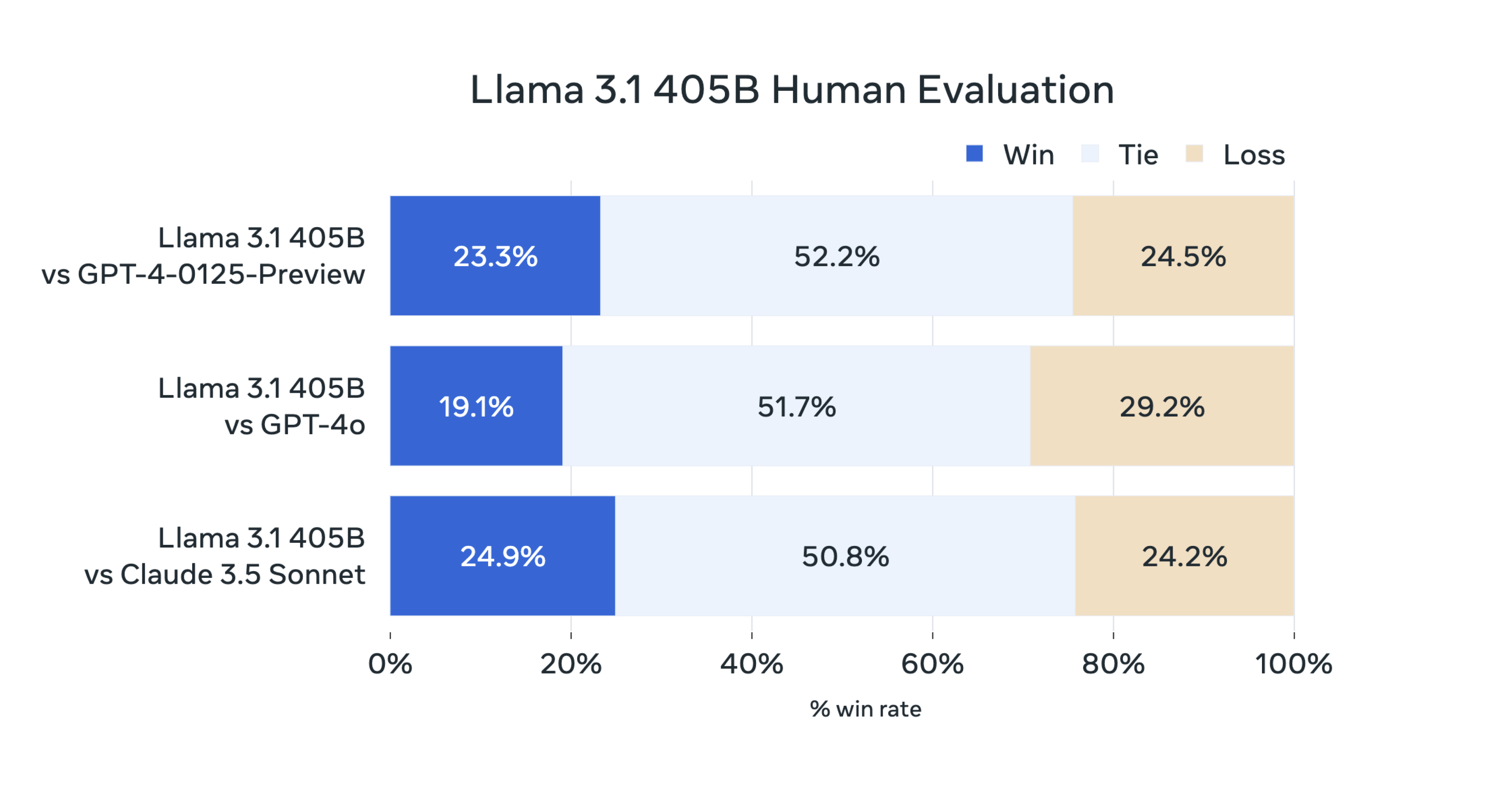

Meta har også utført "omfattende menneskelige evalueringer som sammenligner Llama 3.1 med konkurrerende modeller i virkelige scenarier".

Disse tallene er avhengige av at brukerne bestemmer seg for om de foretrekker responsen fra den ene eller den andre modellen.

Den menneskelige evalueringen av Llama 3.1 405B gjenspeiler den samme pariteten som referansetallene viser.

Meta sier at modellen virkelig er åpen, ettersom Llama 3.1-modellvektene også er tilgjengelige for nedlasting, selv om treningsdataene ikke er delt. Selskapet har også endret lisensen slik at Llama-modellene kan brukes til å forbedre andre AI-modeller.

Friheten til å finjustere, modifisere og bruke Llama-modeller uten begrensninger vil ha kritikere av åpen kildekode AI får alarmklokkene til å ringe.

Zuckerberg mener at en åpen kildekode-tilnærming er den beste måten å unngå utilsiktet skade på. Hvis en AI-modell er åpen for granskning, sier han at det er mindre sannsynlig at den utvikler farlig atferd som vi ellers ville gått glipp av i lukkede modeller.

Når det gjelder potensialet for tilsiktet skade, sier Zuckerberg: "Så lenge alle har tilgang til lignende generasjoner av modeller - som åpen kildekode fremmer - vil myndigheter og institusjoner med mer dataressurser kunne kontrollere dårlige aktører med mindre databehandling."

Når det gjelder risikoen for at statlige motstandere som Kina får tilgang til Metas modeller, sier Zuckerberg at forsøk på å holde disse utenfor kinesiske hender ikke kommer til å fungere.

"Motstanderne våre er gode på spionasje, det er relativt enkelt å stjele modeller som får plass på en minnepinne, og de fleste teknologiselskaper opererer langt fra på en måte som ville gjort dette vanskeligere", forklarte han.

Begeistringen over at en AI-modell med åpen kildekode som Llama 3.1 405B tar opp kampen med de store, lukkede modellene, er berettiget.

Men med rykter om GPT-5 og Claude 3.5 Opus som venter i kulissene, er det ikke sikkert at disse referanseresultatene vil eldes særlig godt.