En gruppe ledende forskere har lansert et frivillig initiativ som skisserer et sett med verdier, prinsipper og forpliktelser for design av AI-proteiner.

Den brev diskuterer potensielt misbruk av AI-verktøy som kan designe nye proteiner med enestående hastighet og effektivitet.

Selv om kunstig intelligens kan bidra til å løse presserende globale utfordringer, fra pandemibekjempelse til bærekraftige energiløsninger, reiser den også spørsmål om muligheten for ondsinnet bruk, for eksempel til å skape nye biovåpen.

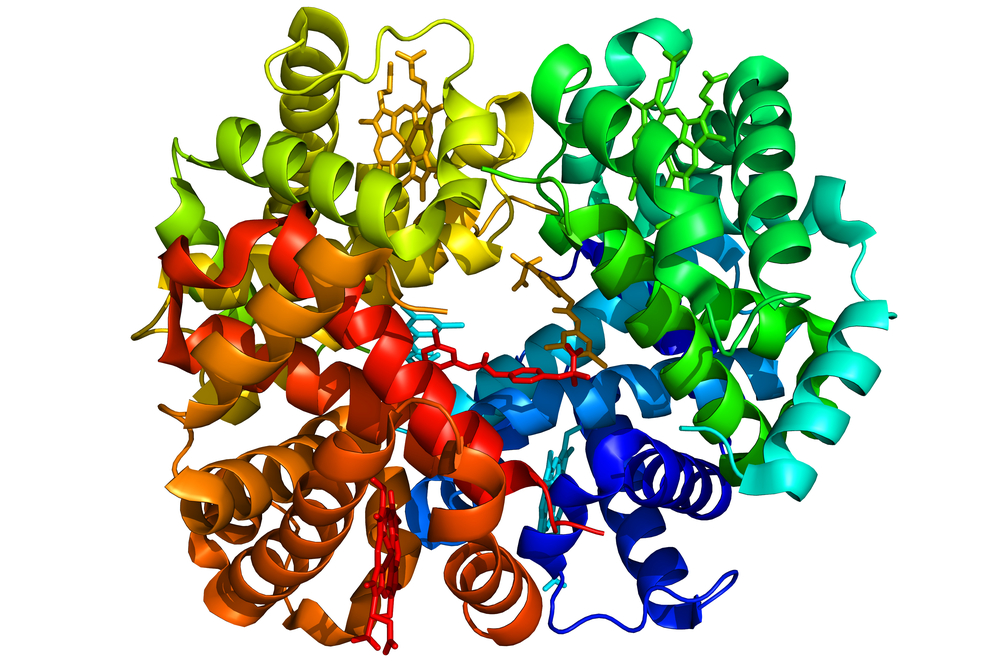

Mens proteinene designet av DeepMinds AlphaFold-system og senere av forskere ved University of Washington School of Medicine viste høy affinitet og spesifisitet til sine tiltenkte mål, er det alltid en mulighet for at disse proteinene kan samhandle med andre molekyler i kroppen på uventede måter.

Dette kan føre til uønskede bivirkninger eller til og med utvikling av nye sykdommer.

En annen risiko er potensialet for misbruk eller ondsinnet bruk av denne teknologien. På samme måte som AI-designede proteiner kan brukes til å skape svært målrettede terapier, kan de også konstrueres slik at de forårsaker skade.

En ondsinnet aktør kan for eksempel potensielt designe et protein som retter seg mot en bestemt etnisk gruppe eller utnytter en bestemt genetisk sårbarhet.

Som David Baker, en beregningsbasert biofysiker ved University of Washington og en av nøkkelpersonene bak initiativet, bemerker: "Spørsmålet var: Hvordan, om på noen måte, bør proteindesign reguleres, og hva er farene, om noen, ved det?"

De over 100 underskriverne mener at "fordelene med dagens AI-teknologi for proteindesign langt oppveier skadepotensialet", men erkjenner behovet for en proaktiv tilnærming til risikohåndtering etter hvert som teknologien utvikler seg.

KI for biologi har potensial til å bidra til å løse noen av de viktigste samfunnsproblemene vi står overfor. Vitenskapelig åpenhet vil være avgjørende for at feltet vårt skal utvikle seg. Som forskere som er engasjert i dette arbeidet, med mer enn 90 signatarer over hele verden, fremmer vi et rammeverk... pic.twitter.com/4m81j87Vo9

- Alex Rives (@alexrives) 8. mars 2024

I brevet står det at "med tanke på de forventede fremskrittene på dette feltet kan det være nødvendig med en ny proaktiv tilnærming til risikostyring for å redusere potensialet for å utvikle AI-teknologi som kan misbrukes, med vilje eller på annen måte, til å forårsake skade."

Signert.

En god idé for sikkerhet i proteindesign (AI-drevet eller ikke): reguler og kontroller proteinsyntesemaskinene og fastvaren, ikke selve AI-forskningen.

Dette er en idé jeg fremmet på UK AI Safety Summit. https://t.co/skcUUcgG5a- Yann LeCun (@ylecun) 8. mars 2024

Som en del av initiativformulerte forskerne et sett med verdier og prinsipper som skal være retningsgivende for en ansvarlig utvikling av AI-teknologi innen proteindesign.

Disse omfatter "trygghet, sikkerhet, rettferdighet, internasjonalt samarbeid, åpenhet, ansvarlighet og forskning til nytte for samfunnet". Underskriverne har også frivillig gått med på et sett med konkrete, handlingsrettede forpliktelser som bygger på disse verdiene og prinsippene.

En viktig del av initiativet fokuserer på å forbedre screeningen av DNA-syntesen, som er et avgjørende skritt i arbeidet med å omdanne AI-designede proteiner til fysiske molekyler.

Forskerne forplikter seg til å "kun kjøpe DNA-syntesetjenester fra leverandører som kan dokumentere at de følger bransjestandarden for biosikkerhetsscreening, som har som mål å oppdage farlige biomolekyler før de kan produseres".

AIs fremskritt innen medisin og bioteknologi har vært helt utrolige, noe som har ført til nye antibiotika og anti-aldringsmedisiner.

For å fremme disse funnene forplikter signatarene seg til å "samarbeide med interessenter fra hele verden" og "avstå fra forskning som kan føre til generell skade eller muliggjøre misbruk av teknologiene våre".