OpenAI kunngjorde at de vil bruke C2PA-standarden til å legge til metadata i bilder generert ved hjelp av DALL-E 3.

Kunngjøringen kommer samtidig som selskaper fortsetter å lete etter måter å hindre at deres generative AI-produkter blir brukt til å spre desinformasjon.

C2PA er en åpen teknisk standard som legger til metadata til et bilde, inkludert opprinnelse, redigeringshistorikk og annen informasjon. OpenAI sier at bilder som genereres ved hjelp av DALL-E 3 direkte, eller via ChatGPT eller dets API, nå vil inkludere C2PA-data. Mobilbrukere vil se dette implementert innen 12. februar.

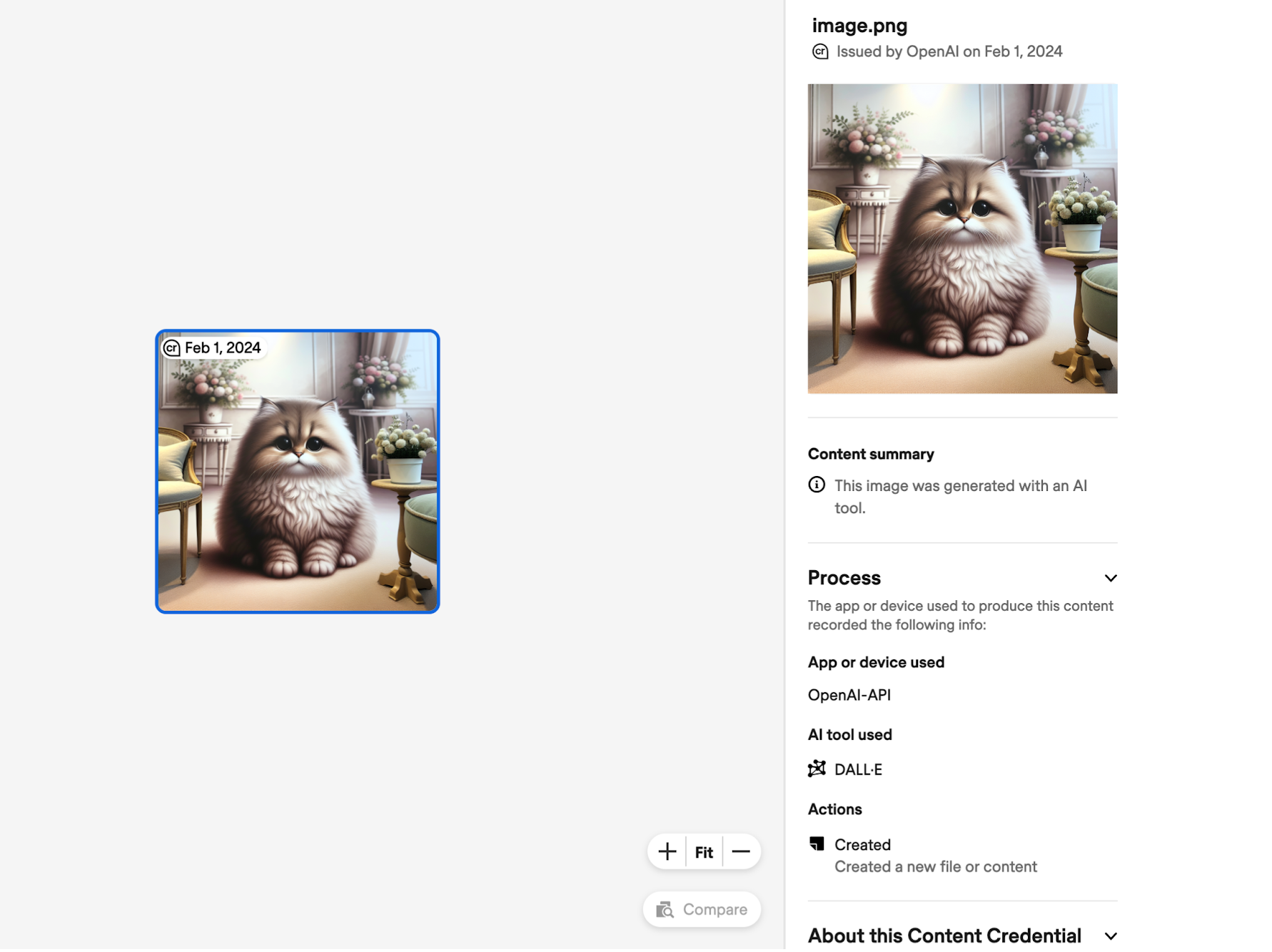

Et bilde som har fått lagt til C2PA-metadata, kan lastes opp til nettsteder som Bekreft innholdslegitimasjon for å sjekke bildets opprinnelse. Her er et eksempel på informasjonen C2PA avslører om et bilde laget med DALL-E via API.

Sosiale medieplattformer kan også bruke disse dataene til å flagge og merke bilder som AI-genererte. Meta kunngjorde nylig at det ville være å gjøre en større innsats for å gjøre det.

Når C2PA-data legges til, øker filstørrelsen, og et eksempel fra OpenAI er oppgitt til

- 3,1 MB → 3,2 MB for PNG via API (3% økning)

- 287k → 302k for WebP gjennom API (økning på 5%)

- 287k → 381k for WebP gjennom ChatGPT (økning på 32%)

OpenAI erkjenner at "C2PA ikke er noen mirakelkur for å løse problemer med proveniens". Metadataene kan lett fjernes, ofte utilsiktet.

Hvis du tar et skjermbilde av bildet, blir ikke C2PA-dataene beholdt. Selv konvertering av et bilde fra PNG til JPG vil ødelegge de fleste metadata. De fleste sosiale medieplattformer fjerner metadata fra bilder når de lastes opp.

OpenAI sier at ved å legge til C2PA i DALL-E-bilder håper de å oppmuntre "brukerne til å innse at disse signalene er nøkkelen til å øke påliteligheten til digital informasjon".

Det kan gjøre det i begrenset grad, men det faktum at C2PA er så enkelt å fjerne, hjelper ikke mye når en person med vilje ønsker å bruke et bilde for å være villedende. Om noe, kan det bare bremse deepfakers litt.

Googles digitale vannmerke SynthID virker som en langt sikrere løsning, men OpenAI vil neppe bruke et verktøy som er laget av en konkurrent.