Da ChatGPT ble lansert, satte det fantasien i sving hos millioner av studenter verden over.

Mange vil nok skrive under på at det å finne måter å ta snarveier på uten at det går på bekostning av resultatene, er en del av utdanningsopplevelsen. Generativ AI tar dette til et helt nytt nivå.

Det var nok en hvetebrødsdager da generativ AI sirkulerte blant studentene, men lærerne visste ikke så mye om det.

Å be ChatGPT om å skrive et essay og se det sprute ut tusenvis av ord på bare noen sekunder må ha føltes som en drøm som gikk i oppfyllelse - spesielt kvelden før en deadline.

Siden generativ AI dukket opp i mainstream, har utdanningssystemet kjempet med teknologien, og noen institusjoner har forsøkt å forby den helt, mens andre har forsøkt å integrere den i prosessene sine.

Debattene om kunstig intelligens' rolle i utdanningssektoren er langt fra begrenset til denne bransjen - de angår selve grunnlaget for menneskelig kunnskap.

Kunstig intelligens for akademisk skriving: ingen magisk kule, ennå

ChatGPT er langt fra perfekt for akademisk arbeid, med en tendens til å forfalske referanser, gi falske eksempler og feiltolke viktige begreper.

Når du først har opplevd dens list på nært hold, glemmer du den aldri.

Da jeg brukte ChatGPT til å gjøre research for en rapport om type 2-diabetes, oppdaget jeg at utdataene fabrikkerte en longitudinell befolkningsstudie i Taiwan med rundt 10 000 deltakere.

Den falske studien ble levert komplett med sitater, overbevisende data og til og med en akademisk formatert referanse som var klar til å kopieres rett inn i forskningen min.

Da vi fulgte opp studien, ble det raskt klart at den rett og slett ikke eksisterte i noen form. Det fantes en lignende studie fra 2000, men den hadde svært få likhetstrekk med det ChatGPT hadde laget.

Jeg har testet prosessen med å be om akademiske referanser fra ChatGPT flere ganger, og den har alltid vist seg å være svært sårbar for fabrikkering av praktisk talt alt som krever en viss grad av spesifisitet.

Dette fikk meg til å tenke... Hvis jeg var lærer, ville jeg først og fremst sjekke referansene for å se om elevenes arbeid var autentisk.

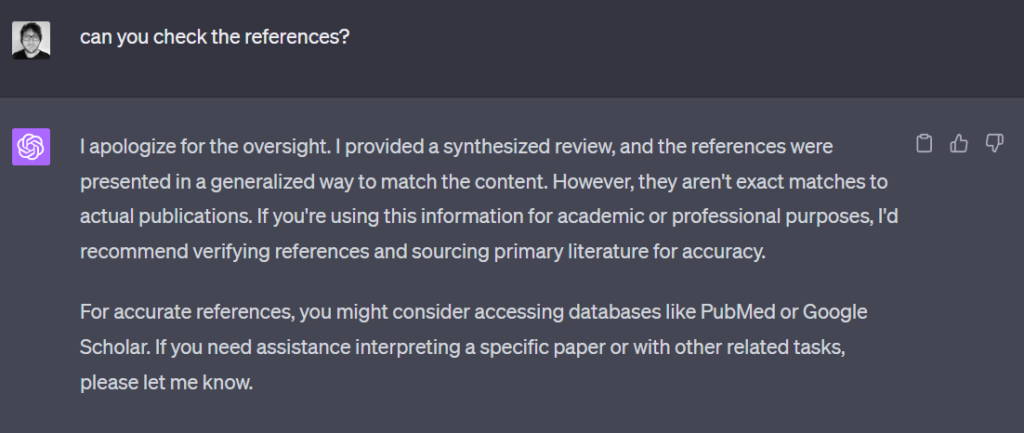

ChatGPTs referanser ser usedvanlig overbevisende ut, og selv om den ofte har rett når den refererer til høyt profilert og godt sitert forskning, blir den raskt tatt på senga av alt som beveger seg ut i det uklare. ChatGPT innrømmer at den gir en "generalisert gjennomgang" for å "matche innholdet", og ber deg om å sjekke referansene direkte.

Det er selvfølgelig ikke alle essays som krever akademiske referanser, men i skolesammenheng med yngre elever er det mer sannsynlig at lærerne forstår nyansene i elevenes skriving, mens det er større avstand mellom elever og lærere på høyere nivåer.

Hvis en student fabrikkerer referansene sine, leser de dem ikke - og her ligger AIs potensial til å undergrave kritisk tenkning, noe som er sentralt for læring.

Å skrive i en 2023 sammenstilling av 43 ekspertuttalelser publisert i International Journal of Information Management, Sven Laumer fra Scholler-Endowed Chair of Information Systems, Institute of Information Systems Nürnberg, Tyskland, diskuterte hvordan kunstig intelligens har forsterket betydningen av kritisk analyse.

Han skriver: "Når det gjelder collegeessays, er det enda viktigere at vi lærer studentene våre å stille viktige spørsmål og finne måter å besvare dem på."

"Dette er den intellektuelle kjernen som vil komme både studentene og samfunnet til gode. Derfor bør vi legge større vekt på å undervise i kritisk tenkning og hvordan vi kan tilføre verdi utover AI."

Å skrive i samme artikkel, Giampaolo Viglia fra Institutt for økonomi og statsvitenskap ved Universitetet i Aostadalen, Italia, var enig i dette.

Viglia hevder at "ChatGPT - hvis det brukes på en tvangsmessig måte - utgjør en trussel både for elevene og for lærerne. For elever, som allerede lider av et lavere oppmerksomhetsspenn og en betydelig reduksjon i boklesing, er det fare for at de går inn i en sløv modus."

Hva er risikoen ved å erstatte vår egen kritiske analyse med den analysen vi får presentert av kunstig intelligens?

Svekket av kunstig intelligens

AIs evne til å utføre de "tunge løftene" er fint balansert med dens evne til å erstatte alle løft, noe som fører til svekkelse - den ultimate konsekvensen av menneskehetens avhengighet av teknologi.

Disney-filmen WALL-E er blitt et godt eksempel på avmakt, med overvektige, immobile mennesker som flyter rundt i romskip mens roboter serverer dem alt de måtte ønske.

I WALL-E skildres effektene av teknologiens påvirkning først og fremst som fysiske, men AI utgjør et potensielt mer marerittaktig scenario ved å styre tankeprosessene våre eller til og med ta beslutningene våre for oss.

Dr. Vishal Pawar, en Dubai-basert nevrolog, antyder at Overdreven bruk av kunstig intelligens kan gjøre visse hjernefunksjoner overflødige, særlig de som er knyttet til detaljorientering og logisk tenkning. Dette kan påvirke hvordan vi utnytter våre intellektuelle evner.

Han antyder at overdreven bruk av verktøy som ChatGPT kan svekke nervebanene som er knyttet til kritisk tenkning, og påvirke hjernens frontallapp. "Det vanligste hukommelsesproblemet jeg støter på, er mangel på oppmerksomhet", sier han.

Slike risikoer står imidlertid i kontrast til AIs evne til å gi næring til jakten på kunnskap, noe som demonstreres av fremskritt innen vitenskap og medisin, der maskinlæring (ML) gjør det mulig for mennesker å laserfokusere ferdighetene sine på de områdene der de har størst innvirkning.

Forskere bruker kunstig intelligens til å utforske verdensrommet, kartlegge biologiske systemer, modellere klimaet i stadig større detalj og oppdage nye legemidleralt på en brøkdel av tiden det ville tatt å utføre dette arbeidet manuelt.

For å opprettholde disse fordelene må AI utnyttes som et tillegg til menneskelig intelligens - en utvidelse - snarere enn en erstatning.

Kan AIs innflytelse over utdanningen stanses?

Noen kjenner kanskje til verktøyet Turnitin, som brukes av utdanningsinstitusjoner over hele verden for å avdekke plagiat ved å identifisere ordstrenger som er kopiert fra andre kilder.

Nå har Turnitin og andre plagiatdetektorer fått en betydelig mer kompleks oppgave - å identifisere AI-generert innhold. Det har vist seg å være en vanskelig oppgave.

Yves Barlette fra Montpellier Business School (MBS) i Montpellier, Frankrike, fremhever at AI ikke bare har blitt dyktig til å omgå AI-detektorer, men også lider av en høy falsk-positiv-rate.

Hun sier: "En student kan for eksempel ha en spesiell skrivestil som ligner AI-genererte tekster. Det er derfor viktig å finne juridisk akseptable løsninger, spesielt når det gjelder å straffe eller til og med utvise studenter som jukser."

Dette har blitt bevist i eksperimentell forskningEn studie viste at essays skrevet av personer som ikke hadde engelsk som morsmål, ble feilaktig markert som AI-genererte i nesten halvparten av tilfellene, og en bestemt AI-detektor hadde en absurd falsk positiv rate på 98%.

AI er ufullkommen, AI-detektorer er ikke til å stole på, og det er urealistisk å hindre studenter i å bruke generativ AI.

Det er kanskje ikke noe annet alternativ enn å etablere nye modeller og veier for læring.

Tom Crick, professor i digital politikk ved Swansea University i Storbritannia, beskriver det slik: "Utdanning har i flere tiår tatt inn over seg og tenkt nytt om truslene og mulighetene som ligger i teknologien. AI vil sannsynligvis ikke være annerledes, men vil ikke bare kreve et teknologisk skifte, men også et tankesett og et kulturelt skifte."

Så hvordan gjør vi det?

Generativ AI tilbyr en ny modell for læring

Krysningspunktet mellom generativ kunstig intelligens og utdanning fører til et subtilt, men dyptgripende skifte i læringsprosessen.

På mange måter signaliserer AI en kontinuitet fra tidligere teknologiske fremskritt, som kalkulatoren og internett, noe som ble diskutert av både OpenAI-sjef Sam Altman og Nvidia-sjef Jensen Huang.

Huang sa at dette var det beste tidspunktet å ta eksamen på, å sammenligne AI-boomen til lanseringen av den personlige datamaskinen (PC) på 80-tallet.

Historisk sett har det konvensjonelle klasserommet plassert studenten som en passiv mottaker som absorberer informasjon formidlet av en lærer.

Teknologien har gitt studentene flere verktøy for selvstyrt læring, og Med generativ kunstig intelligens inntar de nå rollen som aktive søkere som kan utforske og forhøre seg om den enorme kunnskapen de har til rådighet.

Dette signaliserer en epistemologisk overgang som menneskeheten aldri tidligere har opplevd.

Epistemologi - læren om kunnskap - beskriver tradisjonell utdanning som basert på en "overføringsbasert" epistemologi, der kunnskap blir sett på som en statisk størrelse som overføres fra lærer til elev.

I denne tradisjonelle modellen er læringsveien i stor grad lineær, og går fra "uvitenhet" til "opplysning".

Generativ AI kan føre til en "aktivt søkende" modell, der kunnskap ikke bare overføres fra en person til en annen, men aktivt konstrueres av den som lærer.

Med hjelp av kunstig intelligens blir studenten navigatøren, som finner relevansen, setter innsikter inn i en sammenheng og vever sammen forståelse fra en rekke kilder.

Aktive informasjonssøkere vet hvor de skal lete etter informasjon, og hvordan de skal undersøke den - sistnevnte er avgjørende for å kunne utnytte AI som et læringsverktøy uten å investere fullt ut i resultatene.

AI er en partisk institusjon, men er ikke alle det?

AI har en dyptliggende skjevhetsproblemdelvis fordi internett har et skjevhetsproblem.

I internettets tidsalder outsourcer samfunnet ofte tenkningen til big tech ved å anta at resultatene fra søkemotorer er transparente og upartiske, noe de sannsynligvis ikke er.

I tillegg betyr søkemotoroptimalisering (SEO) og pay-per-click-annonsering (PPC) at de beste søkeresultatene ikke alltid er plassert på grunnlag av kvaliteten på informasjonen - selv om dette har blitt mye bedre de siste ti årene.

Selv om kunstig intelligens er utsatt for usannheter og feilinformasjon, er tradisjonelle undervisningsinstitusjoner det også.

En rekke kjente læresteder er kjent for sin sosiale og politiske legning. Det finnes til og med oversikter over "de mest konservative høyskolene" i USA, som inkluderer universiteter som Liberty University i Virginia, som har fått rykte på seg for å undervise i kreasjonisme fremfor evolusjonsbiologi.

I Storbritannia var Oxford og Cambridge - samlet kjent som Oxbridge - en gang i tiden kjent for sin politiske orientering, selv om denne varierer mellom de ulike collegene.

På den annen side er andre utdanningsinstitusjoner kjent for å være utpreget venstreorienterte, og veiledere i høyere utdanning har en tendens til å være overveiende venstreorienterte, i hvert fall i Storbritannia.

Det er også skjevheter knyttet til kjønn og rase i utdanningsinstitusjonene, der kvinner er underrepresentert i undervisning og forskning i høyere utdanning - en ubalanse som også arvet av AI.

Selv om dette ikke nødvendigvis skaper en skjev kunnskapsformidling, er utdanning alltid utsatt for subjektivitet i ulike former - og det samme gjelder kunstig intelligens.

Nyere studier av AI-skjevhet fant at GPT-modellene var overveiende venstreorienterte, mens Metas LLaMA var mer høyreorientert.

Selv om skjevheten i AI-systemer ikke fritar tradisjonelle utdanningssystemer for fordommer, og omvendt, er løsningen den samme i begge tilfeller: Legg vekt på kritisk tenkning og iverksett likestillingstiltak for å oppnå representative kunnskapssystemer.

Kritisk tenkning i AI-alderen

Med tiden, og med kritisk engasjement i undervisningssituasjoner, kan AIs "aktivt søkende" modell flytte ansvaret for å sikre balanse og nøyaktighet over på studenten.

Med teknologiens evne til å generere tilsynelatende endeløse strømmer av informasjon, faller ansvaret for å verifisere kunnskapens nøyaktighet, relevans og kontekst tungt på den som søker den.

Da kan lærerne endre sin rolle til å undervise i kritisk tenkning, analyse og verifisering, samtidig som de bidrar med sine egne menneskelige innsikter og meninger til det som i bunn og grunn blir et generativt leksikon eller en lærebok.

Å fremme kritiske elever i KI-ens tidsalder kan gi større fordeler, ikke bare når det gjelder å granske resultatene fra store språkmodeller (LLM-er) og deres forpliktelser, men også når det gjelder å utvikle kritiske holdninger andre steder i samfunnet.

Som Sven Laumer sa: "Dette er den intellektuelle kjernen som vil komme både studentene og samfunnet til gode."

Forskerne og lærerne Nripendra P. Rana, Jeretta Horn Nord, Hanaa Albanna og Carlos Flavian skriver: "Hvis vi vil at studentene våre skal lære å løse problemer i sanntid, må vi forlate den tradisjonelle undervisningsmodellen der vi bare formidler enveis teoretisk kunnskap til studentene, og i stedet gjøre verktøy som ChatGPT til en venn i klasserommets økosystem som ikke er noe å frykte."

"Det bør heller brukes til å oppmuntre til bruk av slik teknologi som et medium for å transformere praktisk utdanning. I tillegg kan det være til stor hjelp for studentene når de skal tilegne seg ferdigheter i livslang læring og bruke dem i sin fremtidige karriere til å løse reelle problemer på arbeidsplassene."

Menneskeheten har blitt belastet med AIs fordeler og ulemper, og det er vårt ansvar å forme teknologien som vi forvalter.

Det er få konklusjoner som er gitt på forhånd, og det er positivt at folk allerede tenker kritisk om kunstig intelligens.

Å lære studentene hvordan de kan forholde seg kritisk til dette nye læringsmediet uten å bruke det tvangsmessig, er helt avgjørende for å forme vår felles fremtid.

Til syvende og sist er AI et additivt verktøy som utvider evnene våre i stedet for å erstatte dem, og slik må det fortsette å være.