La recherche sur l'IA est alimentée par la poursuite d'une sophistication toujours plus grande, ce qui inclut l'entraînement des systèmes à penser et à se comporter comme des humains.

L'objectif final ? On ne sait pas. L'objectif actuel ? Créer des agents d'IA autonomes et généralisés, capables d'accomplir un large éventail de tâches.

Ce concept est généralement appelé intelligence générale artificielle (AGI) ou superintelligence.

Il est difficile de définir précisément ce qu'implique l'AGI, car il n'existe pratiquement aucun consensus sur ce qu'est l'"intelligence", ni d'ailleurs sur le moment ou la manière dont les systèmes artificiels pourraient y parvenir.

Les sceptiques pensent même que l'IA, dans son état actuel, ne pourra jamais vraiment obtenir une intelligence générale.

Professeur Tony Prescott et Dr. Stuart Wilson de l'Université de Sheffield modèles linguistiques génératifs décritsLa Commission européenne considère que les personnes qui, comme le ChatGPT, sont intrinsèquement limitées parce qu'elles sont "désincarnées" et n'ont pas de perception sensorielle ni d'ancrage dans le monde naturel.

Yann LeCun, directeur scientifique de Meta, a déclaré que même l'intelligence d'un chat domestique est incroyablement plus avancée que les meilleurs systèmes d'intelligence artificielle actuels.

"Mais pourquoi ces systèmes ne sont-ils pas aussi intelligents qu'un chat ?" LeCun a demandé lors du Sommet mondial des gouvernements à Dubaï.

"Un chat peut se souvenir, comprendre le monde physique, planifier des actions complexes, faire preuve d'un certain niveau de raisonnement - en fait, il est bien meilleur que les plus grands LLM. Cela montre qu'il nous manque quelque chose d'important sur le plan conceptuel pour que les machines soient aussi intelligentes que les animaux et les êtres humains.

Bien que ces compétences ne soient peut-être pas nécessaires pour réaliser l'AGI, il existe un certain consensus sur le fait que le passage des systèmes d'IA complexes du laboratoire au monde réel nécessitera l'adoption de comportements similaires à ceux observés dans les organismes naturels.

Comment y parvenir ? Une première approche consiste à disséquer les éléments de la cognition et à déterminer comment les systèmes d'IA peuvent les imiter.

Un précédent essai de DailyAI a étudié curiosité et sa capacité à guider les organismes vers de nouvelles expériences et de nouveaux objectifs, alimentant ainsi l'évolution collective du monde naturel.

Mais il existe une autre émotion - une autre composante essentielle de notre existence - dont l'AGI pourrait bénéficier. Il s'agit de la peur.

Comment l'IA peut tirer des enseignements de la peur biologique

Loin d'être une faiblesse ou un défaut, la peur est l'un des outils les plus puissants de l'évolution pour assurer la sécurité des organismes.

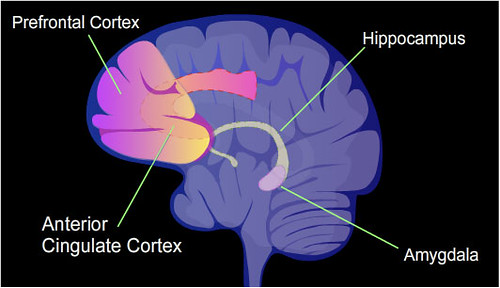

L'amygdale est la structure centrale qui régit la peur chez les vertébrés. Chez l'homme, il s'agit d'une petite structure en forme d'amande nichée dans les lobes temporaux du cerveau.

Souvent appelée "centre de la peur", l'amygdale sert de système d'alerte précoce, analysant en permanence les informations sensorielles entrantes à la recherche de menaces potentielles.

Lorsqu'une menace est détectée - qu'il s'agisse de l'embardée soudaine d'une voiture qui freine ou d'une ombre mouvante dans l'obscurité - l'amygdale entre en action, déclenchant une cascade de changements physiologiques et comportementaux optimisés pour une réponse défensive rapide :

- Le rythme cardiaque et la tension artérielle augmentent, préparant le corps à la lutte ou à la fuite.

- L'attention se rétrécit et s'affine, se concentrant sur la source du danger.

- Les réflexes s'accélèrent, préparant les muscles à une action d'évitement en une fraction de seconde.

- Le traitement cognitif passe à un mode rapide, intuitif, "mieux vaut prévenir que guérir".

Cette réponse n'est pas un simple réflexe, mais une série de changements hautement adaptatifs et sensibles au contexte qui permettent d'adapter le comportement à la nature et à la gravité de la menace.

Elle est aussi exceptionnellement rapide. Nous devenons conscients d'une menace environ 300 à 400 millisecondes après la détection initiale.

De plus, l'amygdale ne fonctionne pas de manière isolée. Elle est étroitement liée à d'autres régions clés du cerveau impliquées dans la perception, la mémoire, le raisonnement et l'action.

Pourquoi la peur peut-elle profiter à l'IA ?

Pourquoi la peur est-elle importante dans le contexte de l'IA ?

Dans les systèmes biologiques, la peur est un mécanisme crucial pour la détection et la réponse rapides aux menaces. En imitant ce système dans l'IA, nous pouvons potentiellement créer des systèmes artificiels plus robustes et plus adaptables.

Ceci est particulièrement pertinent pour les systèmes autonomes qui interagissent avec le monde réel. Exemple : malgré l'explosion de l'intelligence artificielle au cours des dernières années, les voitures sans conducteur ont encore tendance à manquer de sécurité et de fiabilité.

Les régulateurs enquêtent sur de nombreux incidents mortels impliquant des voitures à conduite autonome, notamment des modèles Tesla dotés des fonctions Autopilot et Full Self-Driving.

S'adressant au Guardian en 2022, Matthew Avery, directeur de recherche à Thatcham Research, a expliqué pourquoi les voitures sans conducteur ont été si difficiles à mettre au point:

"Tout d'abord, il est plus difficile que les fabricants ne l'avaient imaginé", affirme M. Avery.

Avery estime qu'environ 80% des fonctions de conduite autonome impliquent des tâches relativement simples telles que le suivi de la voie et l'évitement des obstacles.

Les actions suivantes, cependant, sont beaucoup plus difficiles. "Le dernier 10% est vraiment difficile", souligne Avery, comme "lorsque vous avez, par exemple, une vache qui se tient au milieu de la route et qui ne veut pas bouger".

Certes, les vaches n'inspirent pas la peur en elles-mêmes. Mais n'importe quel conducteur concentré aura probablement du mal à s'arrêter s'il fonce sur l'une d'entre elles à grande vitesse.

La capacité d'un système d'IA à identifier avec précision une vache et à prendre les décisions appropriées dépend fortement de sa formation de base avec des données pertinentes.

Toutefois, cette formation initiale peut ne pas être suffisante pour éviter un danger, en particulier lorsque l'IA rencontre des objets ou des scénarios peu familiers (appelés "cas limites").

Pour y remédier, les systèmes d'IA avancés traitent les données en temps réel et apprennent en permanence, ce qui leur permet de s'adapter et d'améliorer leurs compétences décisionnelles au fil du temps.

Néanmoins, on est loin des systèmes d'alerte intuitifs et profondément intégrés de la nature. Un conducteur humain peut freiner instinctivement à la simple évocation d'un obstacle, avant même d'avoir pleinement compris de quoi il s'agit.

En outre, les réactions naturelles fondées sur la peur sont très adaptables et s'adaptent bien aux nouvelles situations. Un système d'IA formé avec un nouveau mécanisme de peur pourrait être mieux équipé pour gérer des scénarios imprévus qu'un système utilisant des techniques traditionnelles d'apprentissage par renforcement.

Il y a un bémol à tout cela : les humains ne prennent pas toujours les bonnes décisions non plus. Cela ne change rien à la confiance nécessaire pour déployer en masse et en toute sécurité des véhicules autonomes. Les gens tolèrent les erreurs humaines en raison de leur familiarité, mais considèrent les erreurs des machines avec scepticisme.

On pourrait dire que "mieux vaut le diable que l'on connaît que le diable que l'on ne connaît pas". Pour que les véhicules autonomes soient largement acceptés, les fabricants doivent démontrer qu'ils sont fiables et capables de gérer les erreurs avec autant de sécurité que les humains.

Imprégner les systèmes d'IA d'un sentiment de peur plus profond pourrait constituer un moyen alternatif, plus rapide et plus efficace d'y parvenir que les méthodes traditionnelles.

Déconstruire la peur : l'expérience de la mouche des fruits

Nous sommes loin de développer des systèmes artificiels qui reproduisent les régions neuronales intégrées et spécialisées des cerveaux biologiques. Mais cela ne signifie pas que nous ne pouvons pas modéliser ces mécanismes par d'autres moyens.

Examinons donc l'amygdale et la façon dont les invertébrés - les petits insectes, par exemple - détectent et traitent la peur.

S'ils n'ont pas de structure directement analogue à l'amygdale, cela ne signifie pas qu'ils ne disposent pas de circuits permettant d'atteindre un objectif similaire.

Par exemple, des études récentes sur les réactions de peur des Drosophila melanogaster, la drosophile commune, a permis de découvrir les éléments fondamentaux de l'émotion primitive.

Dans un expérience menée à Caltech en 2015, des chercheurs menés par David Anderson a exposé les mouches à une ombre aérienne conçue pour imiter l'approche d'un prédateur.

À l'aide de caméras à grande vitesse et d'algorithmes de vision artificielle, ils ont minutieusement analysé le comportement des mouches, à la recherche de signes de ce qu'Anderson appelle les "primitives de l'émotion", c'est-à-dire les composantes de base d'un état émotionnel.

Fait remarquable, les mouches présentaient une série de comportements qui correspondaient étroitement aux réactions de peur observées chez les mammifères.

Lorsque l'ombre est apparue, les mouches se sont figées sur place et leurs ailes se sont inclinées pour se préparer à une fuite rapide.

Comme la menace persistait, certaines mouches ont pris leur envol, s'éloignant de l'ombre à grande vitesse. D'autres sont restées figées pendant une longue période, ce qui suggère un état d'éveil et de vigilance accru.

Fait important, ces réponses n'étaient pas de simples réflexes déclenchés automatiquement par le stimulus visuel. Au contraire, elles semblent refléter un état interne durable, une sorte de "peur de la mouche" qui persiste même après la disparition de la menace.

En effet, les comportements défensifs accrus des mouches pouvaient être déclenchés par un stimulus différent (une bouffée d'air), même quelques minutes après l'exposition initiale à l'ombre.

En outre, l'intensité et la durée de la réaction de peur varient en fonction du niveau de menace. Les mouches exposées à plusieurs présentations d'ombres ont montré des comportements défensifs progressivement plus forts et plus durables, ce qui indique une sorte d'"apprentissage de la peur" qui leur permet de calibrer leur réponse en fonction de la gravité et de la fréquence du danger.

Comme l'affirment Anderson et son équipe, ces résultats suggèrent que les éléments constitutifs des états émotionnels - la persistance, l'extensibilité et la généralisation - sont présents même chez les créatures les plus simples.

Si nous parvenons à décoder la manière dont des organismes plus simples, comme les mouches des fruits, traitent les menaces et y répondent, nous pourrons potentiellement extraire les principes fondamentaux d'un comportement adaptatif et d'auto-préservation.

Les formes primitives de la peur pourraient être utilisées pour développer des systèmes d'IA plus robustes, plus sûrs et mieux adaptés aux risques et aux défis du monde réel.

Injecter des circuits de peur dans l'IA

C'est une belle théorie, mais l'IA peut-elle être imprégnée d'une forme authentique et fonctionnelle de "peur" dans la pratique ?

Un intrigant étude a examiné exactement cela dans le but d'améliorer la sécurité des voitures sans conducteur et d'autres systèmes autonomes.

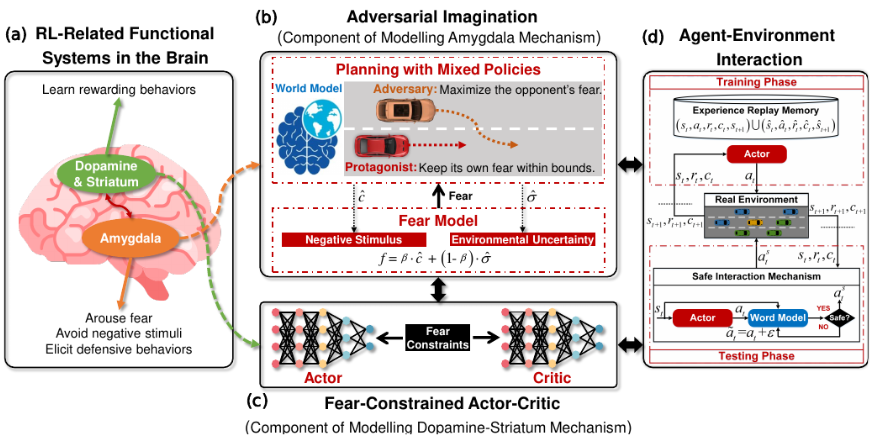

"Apprentissage par renforcement inspiré par la peur pour une conduite autonome sûre", sous la direction de Chen Lv à l'université technologique de Nanyang, à Singapour, ont mis au point un cadre d'apprentissage par renforcement inspiré par la peur et le neurone (FNI-RL) pour améliorer les performances des voitures sans conducteur.

En construisant des systèmes d'IA capables de reconnaître et de répondre aux indices et modèles subtils qui déclenchent la conduite défensive humaine - ce qu'ils appellent les "neurones de la peur" -, nous pourrions être en mesure de créer des voitures autonomes qui naviguent sur la route avec la prudence intuitive et la sensibilité au risque dont elles ont besoin.

Le cadre FNI-RL traduit les principes clés du circuit de la peur dans le cerveau en un modèle informatique de conduite sensible aux menaces, permettant à un véhicule autonome d'apprendre et de déployer des stratégies défensives adaptatives en temps réel.

Il comporte trois éléments clés inspirés des éléments fondamentaux de la réponse neuronale à la peur :

- Un "modèle de peur" qui apprend à reconnaître et à évaluer les situations de conduite qui signalent un risque accru de collision, jouant un rôle analogue aux fonctions de détection des menaces de l'amygdale.

- Un module d'"imagination contradictoire" qui simule mentalement des scénarios dangereux, permettant au système de "s'entraîner" en toute sécurité à des manœuvres défensives sans conséquences dans le monde réel - une forme d'apprentissage sans risque qui rappelle les capacités de répétition mentale des conducteurs humains.

- Un moteur de prise de décision "limité par la peur" qui évalue les actions potentielles non seulement en fonction des récompenses immédiatement attendues (par exemple, la progression vers une destination), mais aussi en fonction du niveau de risque évalué par le modèle de la peur et les composantes de l'imagination contradictoire. Cela reflète le rôle de l'amygdale dans l'orientation flexible du comportement sur la base d'un calcul permanent de la menace et de la sécurité.

Pour mettre ce système à l'épreuve, les chercheurs l'ont testé dans une série de simulations de conduite haute-fidélité présentant des scénarios difficiles et critiques pour la sécurité :

- Coupures et embardées soudaines de la part de conducteurs agressifs

- Piétons erratiques qui se jettent dans la circulation

- Virages serrés et angles morts avec une visibilité limitée

- Routes glissantes et mauvaises conditions météorologiques

Lors de ces tests, les véhicules équipés du FNI-RL ont démontré des performances remarquables en matière de sécurité, surpassant systématiquement les conducteurs humains et les techniques traditionnelles d'apprentissage par renforcement (RL) pour éviter les collisions et mettre en pratique les compétences de conduite défensive.

Dans un exemple frappant, le système FNI-RL a réussi à gérer une fusion soudaine et à grande vitesse du trafic avec un taux de réussite de 90%, contre seulement 60% pour un système RL de référence.

Il a même obtenu des gains de sécurité sans sacrifier les performances de conduite ou le confort des passagers.

Dans d'autres tests, les chercheurs ont évalué la capacité du système FNI-RL à apprendre et à généraliser des stratégies défensives dans différents environnements de conduite.

Dans une simulation d'un carrefour urbain très fréquenté, l'IA a appris en quelques essais seulement à reconnaître les signes révélateurs d'un conducteur imprudent - changement de voie soudain, accélération agressive - et à ajuster préventivement son propre comportement pour lui accorder une plus grande marge de manœuvre.

Fait remarquable, le système a ensuite été en mesure de transférer cette méfiance apprise à un nouveau scénario de conduite sur autoroute, en enregistrant automatiquement les manœuvres dangereuses de coupure et en réagissant par une action d'évitement.

Cela démontre le potentiel de l'intelligence émotionnelle inspirée des neurones pour améliorer la sécurité et la robustesse des systèmes de conduite autonome.

En dotant les véhicules d'une "amygdale numérique" sensible aux signaux viscéraux des risques routiers, nous pourrons peut-être créer des voitures auto-conduites capables de relever les défis de la route avec une conscience défensive fluide et proactive.

Vers une science de la robotique sensible aux émotions

Alors que les progrès récents de l'IA reposaient sur une puissance de calcul brute, les chercheurs s'inspirent désormais des réactions émotionnelles humaines pour créer des systèmes artificiels plus intelligents et plus adaptatifs.

Ce paradigme, appelé "IA bio-inspiréeLe concept de "voiture autonome" s'étend au-delà des voitures auto-conduites à des domaines tels que la fabrication, les soins de santé et l'exploration de l'espace.

De nombreux aspects passionnants sont à explorer. Par exemple, des mains robotisées sont en cours de développement avec des "nocicepteurs numériques" qui imitent les récepteurs de la douleur, permettant des réactions rapides aux dommages potentiels.

En termes de matériel, Puces analogiques bio-inspirées d'IBM utilisent des "memristors" pour stocker des valeurs numériques variables, réduisant ainsi la transmission de données entre la mémoire et le processeur.

De même, des chercheurs de l'Indian Institute of Technology, à Bombay, ont conçu une puce pour le contrôle de la qualité. Réseaux neuronaux à pointes (SNN)qui reproduisent fidèlement le fonctionnement des neurones biologiques.

Le professeur Udayan Ganguly indique que cette puce permet d'obtenir "une énergie par pic 5 000 fois inférieure à une surface similaire et une puissance en veille 10 fois inférieure" par rapport aux conceptions conventionnelles.

Ces avancées dans le domaine de l'informatique neuromorphique nous rapprochent de ce que M. Ganguly décrit comme "un cœur neurosynaptique à très faible consommation d'énergie et un mécanisme d'apprentissage en temps réel sur la puce", des éléments clés pour des réseaux neuronaux autonomes et inspirés par la biologie.

La combinaison d'une technologie d'IA inspirée de la nature avec des architectures informées par des états émotionnels naturels tels que la peur ou la curiosité pourrait propulser l'IA dans un état d'être entièrement nouveau.

En repoussant ces limites, les chercheurs ne se contentent pas de créer des machines plus efficaces : ils donnent potentiellement naissance à une nouvelle forme d'intelligence.

Au fur et à mesure de l'évolution de cette ligne de recherche, des machines autonomes pourraient parcourir le monde parmi nous, réagissant aux indices environnementaux imprévisibles avec curiosité, peur et d'autres émotions considérées comme distinctement humaines.

Les impacts ? C'est une toute autre histoire.