OpenAI hat neue fortschrittliche Denkmodelle mit der Bezeichnung "o1"-Serie veröffentlicht.

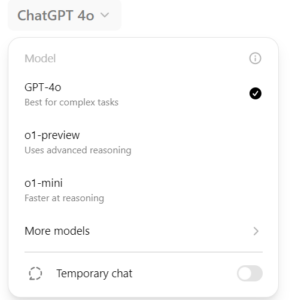

o1 gibt es derzeit in zwei Versionen - o1-preview und o1-mini - und ist darauf ausgelegt, komplexe logische Aufgaben zu lösen, was OpenAI als "neues Paradigma" in der KI-Entwicklung bezeichnet.

"Das ist es, was wir als das neue Paradigma in diesen Modellen betrachten", erklärte Mira Murati, Chief Technology Officer von OpenAI, in einer Anweisung an Verkabelt. "Er ist viel besser in der Lage, sehr komplexe Denkaufgaben zu bewältigen.

Im Gegensatz zu früheren Iterationen, die sich vor allem durch ihre Skalierbarkeit auszeichneten, indem sie z. B. Rechenleistung auf ein Problem warfen, zielt o1 darauf ab, den menschenähnlichen Denkprozess des "Durchdenkens" von Problemen nachzuahmen.

Anstatt eine einzige Antwort zu generieren, arbeitet das Modell Schritt für Schritt, wobei es mehrere Ansätze in Betracht zieht und sich bei Bedarf selbst überarbeitet - eine Methode, die als "chain of thought"-Einleitung bekannt ist.

Dadurch kann es komplexe Probleme in Mathematik, Codierung und anderen Bereichen mit einer Präzision lösen, die von bestehenden Modellen, einschließlich des GPT-4o, nicht erreicht wird.

Wir veröffentlichen eine Vorschau auf OpenAI o1 - eine neue Reihe von KI-Modellen, die mehr Zeit zum Nachdenken benötigen, bevor sie reagieren.

Diese Modelle können komplexe Aufgaben durchdenken und schwierigere Probleme lösen als frühere Modelle in den Bereichen Wissenschaft, Programmierung und Mathematik. https://t.co/peKzzKX1bu

- OpenAI (@OpenAI) 12. September 2024

Mark Chen, der Vizepräsident für Forschung bei OpenAI, erläuterte den Lernprozess von o1 und wie er sich von typischen Sprachmodellen unterscheidet. "Das Modell schärft sein Denken und stimmt die Strategien ab, die es verwendet, um die Antwort zu finden", sagte Chen.

Er demonstrierte das Modell anhand mehrerer mathematischer Rätsel und fortgeschrittener chemischer Fragen, an denen GPT-4o zuvor gescheitert war.

Ein Rätsel, das frühere Modelle verblüffte, lautete: "Eine Prinzessin ist so alt, wie der Prinz sein wird, wenn die Prinzessin doppelt so alt ist, wie der Prinz war, als das Alter der Prinzessin die Hälfte der Summe ihres heutigen Alters war. Was ist das Alter des Prinzen und der Prinzessin?"

Das o1-Modell hat die richtige Antwort ermittelt: Der Prinz ist 30 und die Prinzessin 40.

Zugang zu o1

ChatGPT Plus-Benutzer können bereits von ChatGPT aus auf o1 zugreifen.

Das ist eine Überraschung, denn die Sprachfunktion des GPT-4o wird noch Monate nach der Demo eingeführt. Nur wenige haben erwartet, dass o1 so plötzlich auf den Markt kommt und die übliche Vorlaufzeit umgeht.

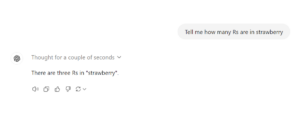

o1 scheint mit OpenAIs Projekt mit dem Codenamen "Strawberry" zusammenzuhängen. Und jetzt kommt etwas Lustiges: Die meisten KI-Modelle wissen nicht, wie viele Rs in "Erdbeere" enthalten sind. Das stört ihre logischen Fähigkeiten.

Ich habe dies in o1 getestet. Und siehe da, er hat es richtig gemacht. Offensichtlich hilft der Ansatz von o1, solche Fragen effizient zu lösen.

Sam Altmans jüngste Rede über Erdbeeren in den sozialen Medien könnte mit diesem berühmten KI-Problem mit Erdbeergeschmack und dem Codenamen "Project Strawberry" von o1 zusammenhängen. Wenn nicht, ist es ein seltsamer Zufall.

Ein Wandel in der Problemlösungskompetenz

Die Fähigkeit des o1-Modells, sich seinen Weg durch Probleme zu "denken", stellt einen Fortschritt in der KI dar - etwas, das sich als bahnbrechend erweisen könnte, wenn sich seine Leistung in der realen Welt "in freier Wildbahn" bewährt.

Die neuen Modelle haben bereits bei Tests wie der American Invitational Mathematics Examination (AIME) gute Leistungen gezeigt.

Nach Angaben von OpenAI löste das neue Modell 83% der in der AIME präsentierten Probleme, verglichen mit nur 12% von GPT-4o.

Die Stärken von o1 liegen auf der Hand, aber es gibt auch Abstriche.

Das Modell braucht aufgrund seiner durchdachten Methodik länger, um Antworten zu generieren. Die Zeit wird zeigen, wie stark sich dies auf die allgemeine Benutzerfreundlichkeit auswirkt.

Die seltsamen Ursprünge von o1

o1 ist das Ergebnis von Gesprächen über ein OpenAI-Projekt mit dem Codenamen "Strawberry". die Ende 2023 auftauchte.

Ursprünglich wurde gemunkelt, dass es sich um ein KI-Modell handelt, das in der Lage ist, eigenständig das Internet zu erkunden und "tiefgehende Recherchen" durchzuführen.

Das Gerede über Strawberry hat sich vor nicht allzu langer Zeit intensiviert, als The Information einige Informationen über die internen Projekte von OpenAI durchsickerten. OpenAI entwickelt nämlich angeblich zwei Formen von Strawberry.

- Die eine ist eine kleinere, vereinfachte Version, die für die Integration in ChatGPT gedacht ist. Sie zielt darauf ab, die Argumentationsfähigkeiten in Szenarien zu verbessern, in denen die Benutzer eher durchdachte, detaillierte Antworten als schnelle Antworten benötigen. Das klingt, als könnte es o1 sein.

- Eine andere ist eine größere, leistungsfähigere Version, die verwendet wird, um hochwertige "synthetische" Trainingsdaten für das nächste Flaggschiff-Sprachmodell von OpenAI mit dem Codenamen "Orion" zu erzeugen. Dieses kann, muss aber nicht mit o1 verbunden sein.

OpenAI hat nicht direkt klargestellt, was Strawberry wirklich ist. Es wird jedoch allgemein angenommen, dass o1 Strawberry ist.

Als Ergänzung, nicht als Ersatz

Murati betonte, dass o1 nicht dazu gedacht ist, GPT-4o zu ersetzen, sondern es zu ergänzen.

"Es gibt zwei Paradigmen", sagte sie. "Das Paradigma der Skalierung und dieses neue Paradigma. Wir gehen davon aus, dass wir beide zusammenbringen werden."

Während OpenAI weiter an der Entwicklung von GPT-5 arbeitet, das wahrscheinlich noch größer und leistungsfähiger als GPT-4o sein wird, könnten zukünftige Modelle die Argumentationsfunktionen von o1 übernehmen.

Diese Verschmelzung könnte die anhaltenden Beschränkungen von großen Sprachmodellen (LLMs) angehen, wie z.B. ihre Schwierigkeiten mit scheinbar einfachen Problemen, die logische Deduktion erfordern, z.B. das oben genannte Erdbeerproblem.

Anthropic und Google sind angeblich dabei, ähnliche Funktionen in ihre Modelle zu integrieren. Das Projekt AlphaProof von Google beispielsweise kombiniert ebenfalls Sprachmodelle mit Verstärkungslernen, um schwierige mathematische Probleme zu lösen.

Chen glaubt jedoch, dass OpenAI im Vorteil ist. "Ich glaube, wir haben dort einige Durchbrüche erzielt", sagte er, "ich denke, das ist ein Teil unseres Vorteils. Es ist tatsächlich ziemlich gut darin, in allen Bereichen zu denken.

Yoshua Bengio, ein führender KI-Forscher und Träger des prestigeträchtigen Turing-Preises, lobte den Fortschritt, mahnte aber zur Vorsicht.

"Wenn KI-Systeme wirklich logisch denken würden, wäre es möglich, Fakten, Argumente und Schlussfolgerungen, die von der KI gezogen werden, in Einklang zu bringen. sagte er der FT.

Sicherheit und ethische Erwägungen

Im Rahmen seines Engagements für verantwortungsvolle KI hat OpenAI die Sicherheitsfunktionen von o1 verstärkt, einschließlich der standardmäßig aktivierten Tools zur Sicherheit von Inhalten.

Mit diesen Werkzeugen kann verhindert werden, dass das Modell schädliche oder unsichere Ergebnisse produziert.

"Wir freuen uns, ankündigen zu können, dass Prompt Shields und Protected Materials for Text nun allgemein im Azure OpenAI Service verfügbar sind", so OpenAI in einer Microsoft-Blogbeitrag.

Die o1-Serie ist für einen frühen Zugang in Microsofts Azure AI Studio und GitHub Models verfügbar, eine breitere Veröffentlichung ist in Kürze geplant.

OpenAI hofft, dass o1 es Entwicklern und Unternehmen ermöglicht, kosteneffizienter zu innovieren. Dies steht im Einklang mit der allgemeinen Mission von OpenAI, KI für Unternehmen leichter zugänglich zu machen.

"Wir glauben, dass wir damit Intelligenz billiger liefern können", schloss Chen. "Und ich denke, das ist wirklich die Kernaufgabe unseres Unternehmens.

Alles in allem eine spannende Veröffentlichung. Es wird sehr interessant sein zu sehen, mit welchen Fragen, Problemen und Aufgaben sich o1 beschäftigt.