Die steigende Nachfrage nach künstlicher Intelligenz ist auf Kollisionskurs mit der ökologischen Nachhaltigkeit, und Experten sind der Meinung, dass die Kohlekraft zur Aufrechterhaltung des Strombedarfs weiterhin genutzt werden könnte.

Länder auf der ganzen Welt streben den Übergang zu einer Netto-Nullbilanz an, investieren in grüne Energie und reduzieren den Verbrauch fossiler Brennstoffe.

Dies steht im Widerspruch zu dem immensen Strombedarf, den die KI, insbesondere die generative KI, die weltweit Millionen von Nutzern bedient, verursacht.

Das ist ein entscheidender Punkt - noch vor ein paar Jahren waren die KI-Modelle vergleichsweise klein und auf lokale Anwendungen beschränkt.

Heute haben Sie, ich und Millionen andere zumindest mit KI experimentiert. Einigen Schätzungen zufolge etwa 40% der Erwachsenen in den USA und Europa und 75% der unter 18-Jährigen.

KI-Unternehmen sehen eine Zukunft, in der ihre Produkte in alles, was wir tun, und in jedes Gerät, das wir benutzen, eingebettet sind, aber KI wird nicht aus der Luft gegriffen. Wie alle Technologien benötigt auch sie Energie.

A aktuelle Publikation stellte fest, dass das BLOOM-Modell 433 MWh für das Training verbrauchte, während GPT-3 satte 1287 MWh benötigte.

Der ChatGPT von OpenAI benötigt schätzungsweise 564 MWh pro Tag, um die Antworten auf die Benutzeranfragen zu berechnen. Jede einzelne Ausgabe stellt eine Berechnung dar, die über die weitläufigen neuronalen Netze von OpenAI durchgeführt wird, und jede davon benötigt Energie.

Stellen wir uns das einmal vor: 1287 MWh könnten 43.000 bis 128.700 durchschnittliche Haushalte einen Tag lang mit Strom versorgen, wenn man von einem durchschnittlichen Tagesverbrauch von 10 bis 30 kWh pro Haushalt ausgeht.

Es könnte auch über 200.000.000 LED-Glühbirnen eine Stunde lang mit Strom versorgen oder ein Elektrofahrzeug etwa 4 bis 5 Millionen Kilometer weit fahren.

Diese und andere Studien haben zwar ihre Grenzen, aber öffentliche Daten von Open-Source-KI-Unternehmen wie HuggingFace bestätigen das Ausmaß dieser Zahlen.

Die Umweltauswirkungen der KI gehen über den reinen Energieverbrauch hinaus. Wasserverbrauch in den Rechenzentren von Microsoft unterstreicht den ressourcenintensiven Charakter des KI-Betriebs. Ein 15-Megawatt-Rechenzentrum kann täglich bis zu 360.000 Gallonen Wasser verbrauchen.

Die Internationale Energieagentur (IEA) hat vor den weitreichenden Auswirkungen von Rechenzentren gewarnt, auf die bereits mehr als 1,3% des weltweiten Stromverbrauchs. Diese Zahl wird noch steigen, da der Bedarf an KI und Datenverarbeitung eskaliert, was die globale Energieinfrastruktur weiter belastet und den Ruf nach nachhaltigeren Praktiken in der KI-Branche verstärkt.

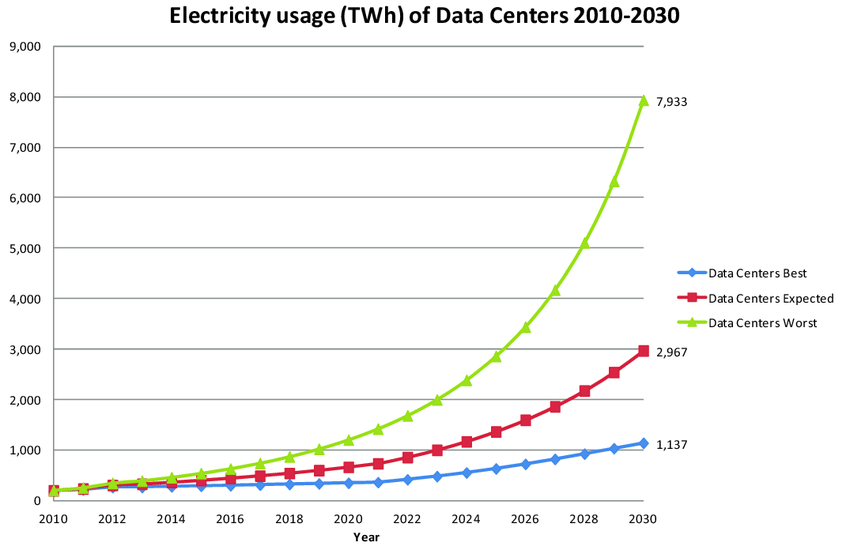

Die Boston Consulting Group schätzt, dass sich der Stromverbrauch der US-Rechenzentren bis zum Ende dieses Jahrzehnts gegenüber 2022 auf 390 Terawattstunden verdreifachen könnte, was etwa 7,5% des prognostizierten Strombedarfs des Landes entspricht.

Die EU hat auch den Energiebedarf von Rechenzentren wird sich bis 2026 verdoppeln. Allein in den USA oder China könnten Rechenzentren bis etwa 2030 die Jahresleistung von etwa 80 bis 130 Kohlekraftwerken verbrauchen.

In einem Worst-Case-Szenario könnten Rechenzentren bis 2030 rund 8.000 TWh Strom verbrauchen, was 30% des heutigen weltweiten Stromverbrauchs entspricht. Das ist das Doppelte dessen, was die USA jährlich verbrauchen.

Wir beeilen uns, nicht zu übertreiben - denken wir daran, dass es sich hierbei um eine Schätzung am oberen Ende der Skala handelt und dass Rechenzentren neben der KI auch für viele andere Zwecke genutzt werden -, aber es ist immer noch ziemlich schockierend, selbst wenn man die unteren Grenzen von 1.100 TWh ansetzt.

Auf dem Weltwirtschaftsforum sagte Sam Altman, CEO von OpenAI, selbst: "Wir brauchen viel mehr Energie in der Welt, als wir bisher dachten. Wir wissen immer noch nicht, wie viel Energie diese Technologie benötigt.

"KI wird viel mehr Energie verbrauchen, als die Menschen erwartet haben", fuhr er fort und deutete an, dass Energiequellen wie Kernfusion oder billigere Solarenergie für den Fortschritt der KI unerlässlich sind.

Rechenzentren belasten das Energienetz

Im Herzen von Nord-Virginia, einer Region, die inzwischen als "Data Center Alley" bekannt ist, stößt das schnelle Wachstum der generativen KI an die Grenzen der Stromerzeugung.

Die örtlichen Stromversorger mussten sogar einmal im Jahr 2022 den Anschluss neuer Rechenzentren stoppen, da die Nachfrage einfach zu hoch war. Aufgrund des Widerstands der Bevölkerung wurden Vorschläge, bei Stromengpässen Dieselgeneratoren einzusetzen, auf Eis gelegt.

Bloomberg berichtet dass im Gebiet von Kansas City der Bau eines Datenzentrums und einer Fabrik für Elektroauto-Batterien so viel Strom benötigt, dass die Pläne zur Stilllegung eines Kohlekraftwerks verschoben wurden.

Ari Peskoe von der Electricity Law Initiative an der Harvard Law School warnte vor den möglichen schlimmen Folgen, wenn sich die Versorgungsunternehmen nicht anpassen: "Neue Lasten werden verzögert, Fabriken können nicht in Betrieb genommen werden, unser wirtschaftliches Wachstumspotenzial wird geschmälert", sagt er.

"Das schlimmste Szenario ist, dass die Versorgungsunternehmen sich nicht anpassen und alte, mit fossilen Brennstoffen betriebene Kapazitäten am Netz lassen und sich nicht weiterentwickeln.

Rob Gramlich von Grid Strategies schloss sich diesen Bedenken an und wies gegenüber Bloomberg auf die Gefahr von Stromausfällen hin, wenn sich die Infrastrukturverbesserungen verzögern.

Die Herausforderungen für den Versorgungssektor beschränken sich nicht auf Rechenzentren. Jüngste Gesetze und Anreize fördern den Bau von Halbleiter-, Elektrofahrzeug- und Batteriefabriken, was ebenfalls zur steigenden Nachfrage nach Strom beiträgt.

So hat Evergy, das den Großraum Kansas City versorgt, die Stilllegung eines Kohlekraftwerks aus den 1960er Jahren verschoben, um die Nachfrage nach neuen Entwicklungen zu decken, darunter ein Meta Platforms-Rechenzentrum und eine Panasonic EV-Batteriefabrik.

Obwohl viele Technologieunternehmen und Hersteller sauberer Technologien erneuerbare Energien bevorzugen, sieht die Realität anders aus. Es ist schwer vorstellbar, wie dieser Energieverbrauch ausgeglichen werden kann.

Die Situation ist nicht nur in den USA zu beobachten. Weltweit haben China, Indien, das Vereinigte Königreich und die EU Warnungen vor dem steigenden Strombedarf der KI ausgesprochen.

Wie werden wir bezahlen?

Während KI-Technologien allgegenwärtig werden, kollidiert ihr ökologischer Fußabdruck mit den globalen Ambitionen für eine Netto-Null-Zukunft. Selbst wenn man die hochgesteckten Ziele für eine Netto-Null-Zukunft beiseite lässt, können die Stromnetze den derzeitigen Kurs der Branche einfach nicht aufrechterhalten.

Steht ein "KI-Winter" bevor, in dem die KI einen langen Prozess der Verfeinerung und Effizienzsteigerung durchläuft, bevor sie intelligenter wird? Oder werden Durchbrüche und Versprechen der Industrie die Entwicklung am Laufen halten?

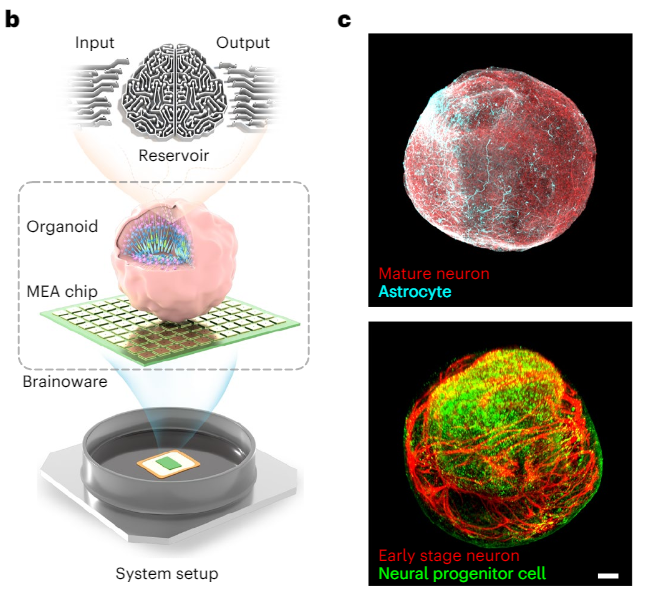

Bio-inspirierte KI, ist beispielsweise ein vielversprechender Ansatz, der darauf abzielt, die Effizienz natürlicher Systeme mit rechnerischer Intelligenz in Einklang zu bringen. Die Erde wird von Milliarden extrem fortschrittlicher Organismen bewohnt, die von natürlichen Quellen wie Nahrung und der Sonne "angetrieben" werden - kann dies eine Blaupause für die KI sein?

Die Antwort ist ein vorsichtiges Ja, denn neuromorphe KI-Chips, die auf synaptischen Funktionen basieren, werden zunehmend realisierbar. Die KI-Spracherkennung wurde sogar schon mit biologischen Zellen durchgeführt zu "Organoiden" - im Wesentlichen "Mini-Gehirnen" - geformt.

Andere Methoden zur Eindämmung des Ressourcenverbrauchs der KI-Industrie umfassen eine "KI-Steuer".

Eine KI-Steuer, die in der Regel als Methode zur Milderung von KI-bedingten Arbeitsplatzverlusten vorgeschlagen wird, könnte dazu führen, dass Unternehmen, die von KI-Fortschritten profitieren, zur Milderung ihrer Umweltauswirkungen beitragen.

Letztendlich ist es schwer vorherzusagen, wie die Industrie mit diesen Anforderungen umgehen wird und inwieweit die Menschen die Last tragen müssen.