Über 100 gefälschte Werbevideos mit dem britischen Premierminister Rishi Sunak wurden auf Facebook verbreitet.

Das Online-Kommunikationsunternehmen Fenimore Harper führte die Untersuchung durch und veröffentlichte ihre Ergebnisse in diesem Bericht.

Die gefälschten Anzeigen erreichten möglicherweise 400.000 Menschen über 143 Anzeigen, die ihren Ursprung in folgenden Bereichen haben aus Ländern wie den USA, der Türkei, Malaysia und den Philippinen. Die Ausgaben für die Werbung beliefen sich wahrscheinlich auf über 12.929 £.

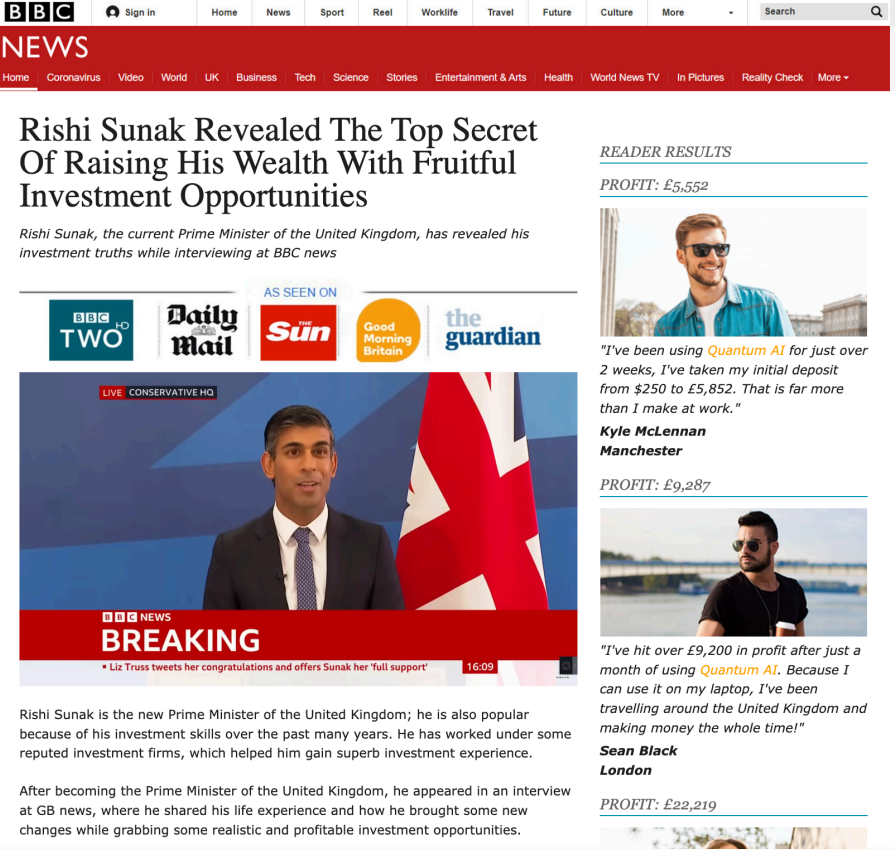

Ein besonders auffälliges Beispiel ist ein gefälschter Clip der BBC-Nachrichtensprecherin Sarah Campbell, in dem sie fälschlicherweise über einen Skandal berichtet, in den Sunak und eine angeblich von Elon Musk entwickelte App verwickelt sind.

In der Anzeige wird behauptet, Elon Musk habe "eine Anwendung auf den Markt gebracht, die in der Lage ist, autonom Aktien- und Markttransaktionen durchzuführen" und weiter: "Ich persönlich kann für die Zuverlässigkeit dieser Anlageplattform bürgen."

Sie führte zu einer gefälschten BBC-Nachrichtenseite, die für eine betrügerische Investition warb.

Marcus Beard, der Gründer von Fenimore Harper, erklärte, "Mit dem Aufkommen von billigen, einfach zu bedienenden Stimm- und Gesichtsklonen braucht es nur sehr wenig Wissen und Erfahrung, um das Abbild einer Person für böswillige Zwecke zu verwenden.

Er wies auch auf das Problem der unzureichenden Moderation bezahlter Werbung auf Plattformen wie Facebook hin und stellte fest: "Diese Anzeigen verstoßen gegen mehrere der Werberichtlinien von Facebook. Allerdings scheinen nur sehr wenige der Anzeigen, auf die wir gestoßen sind, entfernt worden zu sein".

Als Reaktion darauf erklärte ein Sprecher der britischen Regierung: "Wir arbeiten in der gesamten Regierung intensiv daran, sicherzustellen, dass wir auf jegliche Bedrohung unserer demokratischen Prozesse durch unsere Taskforce zur Verteidigung der Demokratie und spezielle Regierungsteams schnell reagieren können."

"Unser Online-Sicherheitsgesetz geht noch weiter, indem es soziale Plattformen dazu verpflichtet, illegale Fehlinformationen und Desinformationen - auch wenn sie von KI generiert werden - umgehend zu entfernen, sobald sie davon Kenntnis erhalten."

Die BBC, die die zunehmende Verbreitung von Desinformation anerkennt, rief zur Wachsamkeit auf. Eine Sprecherin erklärte"Wir haben BBC Verify 2023 ins Leben gerufen, um der wachsenden Bedrohung durch Desinformation zu begegnen - wir investieren in ein hochspezialisiertes Team mit einer Reihe von forensischen und Open-Source-Intelligenz (OSINT), um zu recherchieren, Fakten zu prüfen, Videos zu verifizieren, Desinformation zu bekämpfen, Daten zu analysieren und komplexe Geschichten zu erklären."

"Wir bauen Vertrauen beim Publikum auf, indem wir zeigen, wie BBC-Journalisten die Informationen kennen, über die sie berichten, und Erklärungen anbieten, wie man gefälschte und gefälschte Inhalte erkennt. Wenn wir auf gefälschte BBC-Inhalte aufmerksam werden, ergreifen wir schnell Maßnahmen".

Meta, die Muttergesellschaft von Facebook, hat sich ebenfalls zu diesen Bedenken geäußert. Ein Sprecher von Meta kommentierte: "Wir entfernen Inhalte, die gegen unsere Richtlinien verstoßen, unabhängig davon, ob sie von einer KI oder einem Menschen erstellt wurden."

Die zunehmende Raffinesse und Verbreitung von KI-generierten Fälschungen, insbesondere im Zusammenhang mit politischen Kampagnen, werfen große Fragen über die Integrität von Informationen im Zeitalter der KI auf.

KI-manipulierte Inhalte üben Druck auf Wahlen aus

Während sich die Welt auf eine Reihe von hochkarätigen Wahlen in den Jahren 2024 und 2025 vorbereitet, werden tiefgreifende Fehlinformationen in politischen Kampagnen zu einem allgegenwärtigen globalen Problem.

In der Slowakei, KI-manipulierte Audio fälschlich porträtieren Kurz vor der Wahl tauchten politische Persönlichkeiten auf, die die Fähigkeit der KI zur Verzerrung politischer Darstellungen anzweifelten.

Nationale Wahlen in Bangladesch erlebte ähnliche HerausforderungenDort wurde berichtet, dass regierungsnahe Gruppen KI-generierte Nachrichtenclips nutzen, um die öffentliche Meinung zu beeinflussen.

Große Technologieunternehmen wie Google und Meta haben damit begonnen, Richtlinien für politische Werbung einzuführen, die die Offenlegung jeglicher Form von KI oder digitalen Veränderungen vorschreiben. Diese Maßnahmen greifen jedoch oft zu kurz.