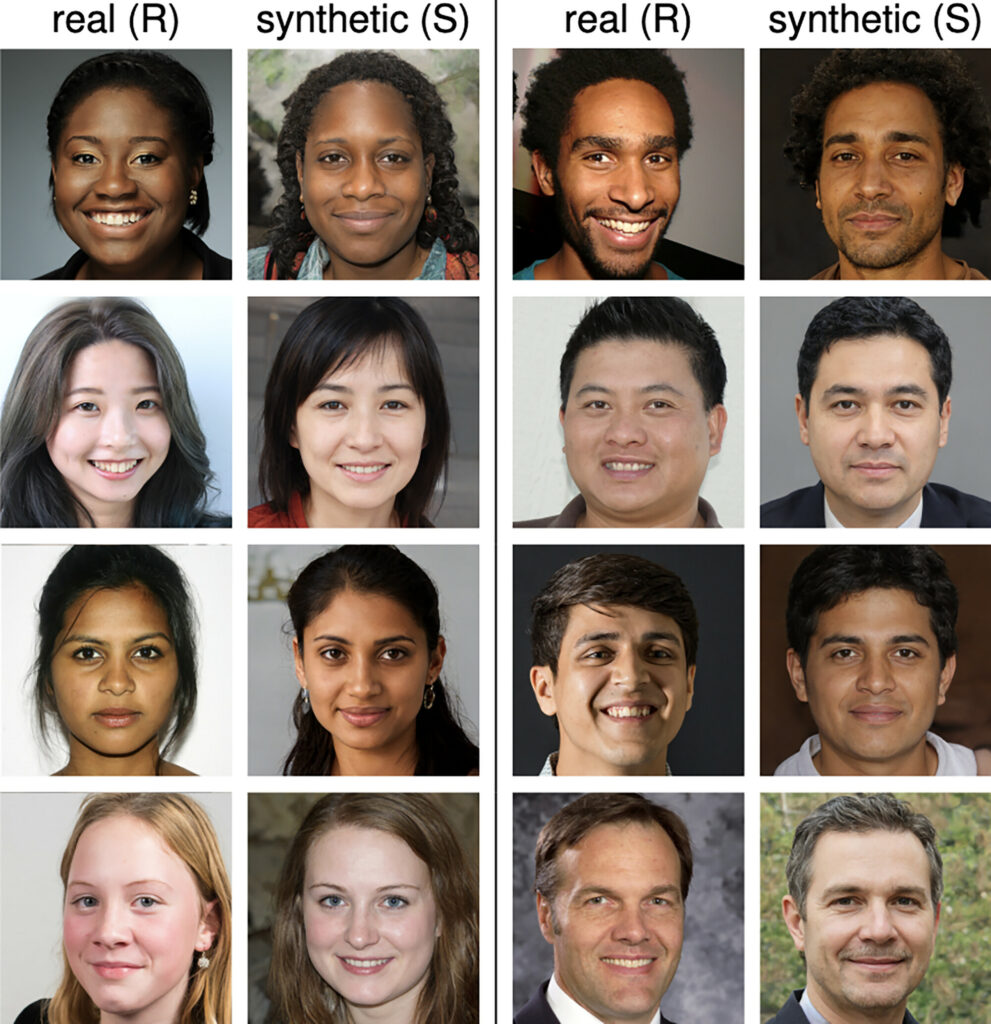

Ein kürzlich durchgeführtes Experiment ergab, dass Menschen KI-generierte menschliche Gesichter nur in 48,2% der Fälle richtig identifizieren können.

Die Studie nahmen 315 Teilnehmer teil, die zwischen echten und künstlich erzeugten Gesichtern unterscheiden sollten. Die Gesichter wurden mit StyleGAN2 synthetisiert, einer hochmodernen Engine, die in der Lage ist, vielfältige und realistische menschliche Ähnlichkeiten zu erzeugen.

Die Ergebnisse waren sowohl faszinierend als auch leicht beunruhigend: Die Fähigkeit der Teilnehmer, KI-generierte Gesichter zu erkennen, lag bei 48,2% - schlechter als ein Münzwurf.

Es suggests, dass für den Durchschnittsmenschen KI-Gesichtsfälschungen praktisch nicht von denen echter Menschen zu unterscheiden sind.

Wie naturgetreu diese Gesichter sind, können Sie selbst sehen, indem Sie die Website diese-person-does-nicht-existiert.dedas realistische, von künstlicher Intelligenz erzeugte Bilder von praktisch jeder Person, in jedem Alter und mit jedem Hintergrund anzeigt. Und dieses Tool ist nun schon ein paar Jahre alt.

In der Studie wurde auch untersucht, ob bestimmte Rassen und Geschlechter schwieriger richtig zu klassifizieren sind.

Es wurde festgestellt, dass weiße Gesichter, insbesondere männliche, von den Teilnehmern am schwierigsten als echt oder synthetisch zu identifizieren waren.

Der Grund dafür könnte in der Überrepräsentation weißer Gesichter im Trainingsdatensatz der KI liegen, was zu realistischeren weißen synthetischen Gesichtern führt, so die Studie.

Noch verblüffender war die Entdeckung, dass die Teilnehmer synthetische Gesichter als vertrauenswürdiger einstuften als echte Gesichter, wenn auch nur mit einem geringen Abstand. Dies könnte auf eine unterbewusste Vorliebe für die durchschnittlichen Merkmale hindeuten, die KI in der Regel erzeugt und die laut der Studie in früheren Untersuchungen als vertrauenswürdiger wahrgenommen wurden.

Ein leichter Anstieg der Wahrscheinlichkeit, dass jemand ein KI-Bild als vertrauenswürdiger als ein echtes Bild interpretiert, ist sehr besorgniserregend, wenn man ihn auf die Bevölkerungsebene hochrechnet.

Die Interpretation von KI-generierten Gesichtern durch das Gehirn ist komplex

A zweite aktuelle Studie sollten die Teilnehmer erkennen, ob ein Gesicht echt war oder nicht, während sie mit einer Aufgabe beschäftigt waren, die sie ablenken sollte.

Sie konnten nicht bewusst zwischen den beiden unterscheiden, aber die Dinge wurden noch verwirrender, als ihre Gehirnaktivität mit einem Elektroenzephalogramm (EEG) gemessen wurde.

Etwa 170 Millisekunden nach dem Betrachten der Gesichter zeigte die elektrische Aktivität des Gehirns Unterschiede, wenn die Teilnehmer echte und synthetische Bilder betrachteten.

Es schien, als ob dieas Unterbewusstsein "wusste" besser als der bewusste Verstand, wann ein Bild KI-generiert sein könnte. Trotzdem konnten die Teilnehmer die KI-Gesichter nicht mit einem robusten Maß an Vertrauen bewusst zuordnen.

Wir könnten spekulieren, dass es eine bewusste Interpretationsebene gibt, bei der wir KI-generierten Gesichtern "im Zweifelsfall" glauben, auch wenn wir uns unsicher sind.

Schließlich sind wir von Natur aus darauf eingestellt, menschliche Gesichter zu erkennen und ihnen zu vertrauen. Daher ist es außerordentlich schwierig, sich davon zu lösen und Ungereimtheiten zu erkennen, die ein von einer KI generiertes Bild offenbaren könnten.

Es ist fast so, als ob der anfängliche Verdacht einer Bestätigung weicht, dass die Person tatsächlich real ist, wenn sie es nicht ist - eine Art von KI-gestützter Entschuldigung.

Was auch immer die Erklärung für diese Eigenart ist, KI-generierte tiefe Fälschungen sind ein vorrangiges Risiko für die Technologie, mit einer jüngster Skandal die eine Schule in New Jersey trifft.

Tiefgreifende Betrügereien sind an der Tagesordnung, und es besteht die Sorge, dass gefälschte, von KI generierte Inhalte könnte das Wahlverhalten beeinflussen.