In der nicht allzu fernen Vergangenheit waren Gespräche über KI vor allem auf den Bereich der Science-Fiction und akademische Abhandlungen beschränkt.

Heute ist KI tief in das tägliche Leben integriert, von der Steuerung intelligenter Häuser bis zur Diagnose von Krankheiten.

Doch während die KI-Technologie immer weiter voranschreitet, müssen die rechtlichen Rahmenbedingungen aufholen und hinken oft der Innovationskurve hinterher.

Dies stellt die Menschheit vor ein vielschichtiges Rätsel: Wie können wir Gesetze und Vorschriften schaffen, die flexibel genug sind, um sich an den raschen technologischen Wandel anzupassen, und gleichzeitig robust genug, um die Interessen der Gesellschaft zu schützen?

Auf der ganzen Welt sind die Regulierungsbemühungen alles andere als einheitlich. Die Europäische Union (EU) macht es mit ihrem umfassenden KI-Gesetz vor, das darauf abzielt, KI-Anwendungen auf der Grundlage ihrer Risikostufe zu kategorisieren und zu kontrollieren.

In der Zwischenzeit haben die USA freiwillige Verpflichtungen gegenüber sofortigen Rechtsvorschriften bevorzugt.

China hingegen hat die KI fest im Griff und richtet die Regulierung an umfassenderen politischen und sozialen Zielen aus.

Und vergessen wir nicht die anderen Rechtsordnungen - KI ist ein globales Phänomen, das eine nahezu universelle Gesetzgebung erfordern wird Abdeckung.

Wo steht die Regulierung jetzt, und wie soll sie sich weiterentwickeln?

Der EU-Ansatz

Die EU hat mit ihrem bahnbrechenden KI-Gesetz, das bis Ende des Jahres vollständig verabschiedet werden soll, einen strengen Rahmen geschaffen.

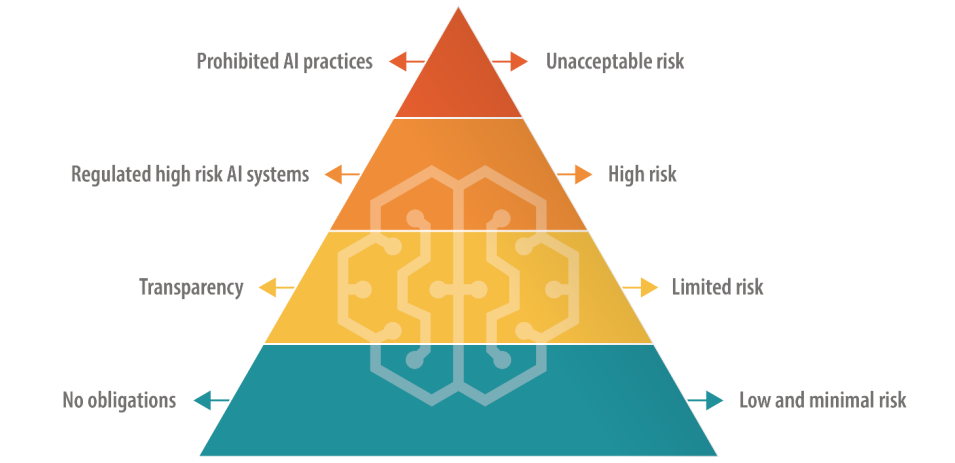

Das Gesetz über künstliche Intelligenz sieht vier Stufen vor, darunter "unannehmbare Risiken", "hohe Risiken", "begrenzte Risiken" und "niedrige Risiken", für die jeweils bestimmte Leitlinien und Verbote gelten.

KI mit unannehmbaren Risiken stellen eine unmittelbare oder erhebliche Gefahr dar, z. B. die Verursachung körperlicher oder seelischer Schäden oder die Verletzung von Menschenrechten, und werden daher ganz verboten.

KI mit hohem Risiko sind zugelassen, unterliegen aber strengen Vorschriften, die vom Risikomanagement bis zur technischen Dokumentation und Cybersicherheit reichen.

Begrenzte und risikoarme KI bleiben dagegen überwiegend unreguliert, müssen aber gegenüber den Nutzern Transparenz wahren.

Kurzfristig gibt es einen Aufschub, da die Gesetzgebung eine Gnadenfrist von etwa zwei Jahren für Unternehmen vorsieht, um sich an die neuen Vorschriften anzupassen.

Die EU schlägt vor, dass die ursprünglichen Entwickler von KI-Modellen dafür haften sollten, wie ihre Technologie verwendet wird, auch wenn sie von einem anderen Unternehmen oder Entwickler in ein anderes System eingebettet wird. Neu hinzugekommen sind auch Regeln für "Basismodelle", zu denen auch generative KI-Modelle gehören.

Das KI-Gesetz wird unterschiedlich aufgenommen - einige kritisieren seine schwerfälligen Definitionen und sein Potenzial, Innovationen zu hemmen. So besteht beispielsweise erhebliche Unsicherheit darüber, wie verschiedene KI-Modelle in Risikokategorien einzuordnen sind.

Außerdem befürchten kleinere KI-Unternehmen, dass ihnen die Ressourcen für die Einhaltung der Vorschriften fehlen.

Sam Altman, CEO von OpenAI kurzzeitig bedroht die Produkte seines Unternehmens vom EU-Markt zu nehmen, wenn das KI-Gesetz Anforderungen enthält, die realistischerweise nicht eingehalten werden können.

Im Juni wurden 150 große Unternehmen hob den schwerfälligen Ansatz des Gesetzes hervorund erklärte, dass die derzeitigen Vorschriften die Gefahr bergen, die europäische Wettbewerbsfähigkeit zu zerstören.

Abweichung von den USA

A Stanford-Analyse des KI-Gesetzes wurden grundlegende Unterschiede zwischen den Ansätzen der EU und der USA bei der KI-Regulierung erörtert.

Alex Engler, Fellow in Governance Studies an der Brookings Institution, sagte: "Es gibt eine wachsende Diskrepanz zwischen dem Ansatz der USA und der EU [bei der Regulierung von KI]."

Er hebt hervor, dass die EU auf Datenschutz- und Transparenzgesetze gedrängt hat, die in den USA noch weitgehend fehlen. Die Ungleichheit verwirrt die Einhaltung der Vorschriften für KI-Unternehmen, und die Kosten, die mit der länderübergreifenden Einhaltung der Vorschriften verbunden sind, könnten übermäßig hoch sein.

"Die Interessen der Unternehmen werden sich mit Händen und Füßen wehren, wenn es zwei völlig unterschiedliche Standards für Online-Plattformen gibt", so Engler.

Wenn es hart auf hart kommt, ist es schwer vorstellbar, dass Technologieunternehmen keinen Weg finden, das KI-Gesetz zu umgehen, wie sie es mit der GDPR getan haben und mit dem neuen Gesetz über digitale Dienstleistungen tun müssen.

Im Gespräch mit der Zeitschrift NatureDaniel Leufer, Senior Policy Analyst bei Access Now, weist die Einwände der KI-Industrie gegen das Gesetz als "die übliche Effekthascherei" zurück.

Der britische Ansatz

Nach dem Brexit will das Vereinigte Königreich seine Unabhängigkeit von der EU nutzen, um ein flexibleres und sektorspezifisches Regulierungssystem zu formulieren.

Im Gegensatz zum KI-Gesetz beabsichtigt die britische Regierung, die Anwendungen von KI und nicht die zugrunde liegende Software selbst zu regulieren.

Eine "innovationsfreundliche" Haltung

Die britische Regierung veröffentlichte eine Weißbuch im März die einen "innovationsfreundlichen" Rahmen skizziert und die Beteiligten auffordert, ihre Ansichten mitzuteilen. Die Regierung hat jedoch noch keine Leitlinien für die Umsetzung dieses Rahmens herausgegeben.

In einer Erklärung heißt es: "Die Regierung wird dem Vereinigten Königreich dabei helfen, die Chancen und Vorteile der KI-Technologien zu nutzen" - ein Ansatz, der kritisiert wird, weil er den durch KI verursachten Schäden keine angemessene Aufmerksamkeit schenkt.

Die Regierung hatte sogar geplant, KI-Firmen eine äußerst umstrittene "Copyright-Ausnahme" anzubieten, aber hat diesen Plan umgedreht im August.

Großbritannien hat es in letzter Zeit schwer gehabt, technische Innovationen anzuziehen, und hat insbesondere den Chiphersteller Arm aus Cambridge verloren, der sich dafür entschieden hat, seine Aktien in den USA an die Börse zu bringen, statt im eigenen Land. Dies schürt vielleicht die Sorge des Vereinigten Königreichs, seinen schwindenden Technologiesektor wieder anzukurbeln.

Um das Vereinigte Königreich als Vordenker in Sachen KI zu positionieren, hat Premierminister Rishi Sunak eine zweitägige AI-Sicherheitsgipfel die im November stattfindet.

Insbesondere China wurde zu der Veranstaltung eingeladen - obwohl es Spekulationen gibt, dass es wegen Angst vor Spionage.

Der US-Ansatz

In den USA liegt der Schwerpunkt auf der Selbstregulierung der Branche, zumindest im Moment.

Der US-Kongress signalisiert eine abwartende Haltung, indem er mit der Überprüfung von KI-Treffen hinter verschlossenen Türen und Chuck Schumers AI Insight-Foren um festzustellen, wo genau KI neue Regelungen erfordert.

Überparteiliche Vereinbarungen könnten sich um eng zugeschnittene Rechtsvorschriften zum Datenschutz, zur Transparenz von Plattformen oder zur Schutz von Kindern im Internet.

Darüber hinaus haben einige hervorgehoben, dass die bestehenden Gesetze und Vorschriften für KI weiterhin relevant sind.

Im Juni, Khan sagteEs gibt keine Ausnahmen von Gesetzen, die Diskriminierung verbieten... Da diese Dinge immer mehr in die täglichen Entscheidungen einfließen, denke ich, dass sie zu einer genauen Prüfung einladen und diese auch verdienen... Ich denke, dass die Durchsetzungsbehörden, sei es auf staatlicher oder auf nationaler Ebene, handeln werden."

Freiwillige Rahmen und Lückenfüller

Prominente Technologieunternehmen wie Microsoft, OpenAI, Google, Amazon und Meta haben kürzlich freiwillige Verpflichtungen für eine sichere KI-Entwicklung unterzeichneteinschließlich der Durchführung interner und externer KI-Modelltests vor der öffentlichen Freigabe.

Viele führende Vertreter der Technologiebranche haben ihre eigenen Zusagen gemacht, aber in In Ermangelung einer soliden legislativen Kontrolle muss die Aufrichtigkeit dieser Versprechen erst noch getestet werden.

Alles in allem behaupten die Kritiker, dass der Ansatz der USA im Wesentlichen symbolisch ist und nicht die Tiefe und das Engagement des KI-Gesetzes der EU aufweist. Die erste AI-Insight-Forum war eine weitgehend geschlossene Veranstaltung, die von einigen als Einschränkung der öffentlichen Debatte kritisiert wurde.

Senator Josh Hawley bezeichnete die Veranstaltung als eine "riesige Cocktailparty".

Wie Ryan Calo, Professor an der University of Washington School of Law, treffend zusammenfasste: "Es gibt den Anschein von Aktivität, aber nichts Substanzielles und Verbindliches".

Der chinesische Ansatz

China erhebt, entsprechend seinem Wunsch nach staatlicher Kontrolle, einige der strengsten Vorschriften für KI.

Der Schwerpunkt liegt auf der Kontrolle der Informationsverbreitung durch KI und spiegelt damit die allgemeinen politischen und sozialen Rahmenbedingungen in China wider.

So müssen beispielsweise Anbieter von generativer KI, deren Produkte "die öffentliche Meinung beeinflussen" können, eine Sicherheitsüberprüfung durchführen lassen.

Die erste Welle von zugelassenen Chatbots, darunter der ERNIE Bot von Baidu, wurde kürzlich für die Öffentlichkeit freigegeben und die Zensur von Fragen mit politischem Inhalt festgestellt.

Die Zunahme von "Deep Fakes" und KI-generierten Inhalten stellt weltweit eine Herausforderung dar, und China bildet hier keine Ausnahme. Die Cyberspace Administration of China (CAC) hat die potenziellen Fallstricke der KI relativ früh in diesem Jahr erkannt und verlangt von KI-gesteuerten Inhaltsgeneratoren, dass sie die Identität der Nutzer überprüfen.

Darüber hinaus wurden Wasserzeichen eingeführt, um von KI generierte Inhalte von solchen zu unterscheiden, die von Menschenhand geschaffen wurden - Regeln, die auch westliche Mächte umzusetzen versuchen.

Divergenz zwischen den USA und China

KI hat die Spannungen zwischen den USA und China verschärft und einen "digitalen Kalten Krieg" ausgelöst - oder vielleicht besser gesagt einen "KI-Kalten Krieg".

US-Beschränkungen für die Zusammenarbeit und den Handel mit China sind nichts Neues, aber die Entkopplung der beiden Länder ist einen Schritt weiter gegangen, als Xi Jinping seine neue, reformierte Plan "Made in China 2025.

Ziel ist es, dass China bis 2025 in wichtigen Technologiesektoren, darunter auch in der Spitzentechnologie für künstliche Intelligenz, autark wird. 70%

Derzeit sind die USA Streichung von Mitteln und Forschung Beziehungen zu China, während sie ihre Beschaffung von KI-Chips von Unternehmen wie Nvidia unterdrücken.

Während die USA im Rennen um die Vorherrschaft der KI einen klaren Vorsprung haben, hat China einige Tricks in petto, darunter einen zentralisierten Ansatz für die Regulierung und nahezu unbegrenzte persönliche Daten.

Im Mai wurde Edith Yeung, eine Partnerin der Investmentfirma Race Capital, sagte der BBCIn China gibt es viel weniger Regeln für den Datenschutz und viel mehr Daten [als in den USA]. Es gibt zum Beispiel überall eine CCTV-Gesichtserkennung".

Die enge Zusammenarbeit zwischen der chinesischen Regierung und der Technologiebranche bringt ebenfalls Vorteile mit sich, da der Datenaustausch zwischen der Regierung und den einheimischen Technologieunternehmen praktisch reibungslos funktioniert.

Die USA und andere westliche Länder haben nicht den gleichen Zugang zu geschäftlichen und persönlichen Daten, die das Lebenselixier für maschinelle Lernmodelle sind. In der Tat gibt es bereits Bedenken, dass hochwertige Die Datenquellen gehen aus.'

Darüber hinaus hat die freizügige Verwendung potenziell urheberrechtlich geschützter Trainingsdaten durch westliche KI-Firmen für breite Empörung gesorgt und Rechtsstreitigkeiten.

Chinas KI-Unternehmen werden wahrscheinlich nicht unter diesem Problem leiden.

Abwägung von Zugänglichkeit und Risiko

Früher war die KI auf den akademischen Bereich und große Unternehmen beschränkt. Innerhalb von etwa einem Jahr haben zwischen einem Viertel und der Hälfte der Erwachsenen in Großbritannien, den USA und der EU generative KI genutzt.

Die Zugänglichkeit hat viele Vorteile, u. a. die Förderung von Innovationen und die Senkung der Eintrittsbarrieren für Start-ups und einzelne Entwickler. Dies wirft jedoch auch Bedenken hinsichtlich des potenziellen Missbrauchs auf, der mit einem unregulierten Zugang einhergeht.

Der jüngste Vorfall, bei dem das Sprachmodell Llama-1 von Meta wurde im Internet veröffentlicht ist ein Beispiel für die Herausforderungen bei der Eindämmung der KI-Technologie. Open-Source-KI-Modelle wurden bereits für betrügerische Zwecke und zur Generierung von Bilder von Kindesmissbrauch.

KI-Unternehmen wissen dasund Open-Source-Modelle bedrohen ihren Wettbewerbsvorteil. Meta hat sich zu einer Art Antagonist der Branche entwickelt und veröffentlicht eine Reihe von Modellen kostenlos, während andere, wie Microsoft, OpenAI und Google, darum kämpfen, ihre KI-Produkte zu Geld zu machen.

Andere Open-Source-Modelle, wie das Falke 180B LLMsind außerordentlich leistungsfähig, haben aber keine Leitplanken.

Einige spekulieren, dass die großen KI-Unternehmen auf eine Regulierung drängen, da dies kleinere Akteure und die Open-Source-Gemeinschaft aus dem Ring drängt und es ihnen ermöglicht, die Vorherrschaft in der Branche zu behalten.

Das Dual-Use-Dilemma der KI

Ein weiterer komplexer Faktor sind die doppelten oder mehrfachen Anwendungen der KI.

Dieselben Algorithmen, die unsere Lebensqualität verbessern können, lassen sich auch als Waffe einsetzen oder im militärischen Bereich verwenden. Dies könnte die Achillesferse des heuristischen Rahmens des EU-KI-Gesetzes sein - wie interpretiert man nützliche KI, die zum Schaden verändert werden kann?

Die Regulierung von Technologien mit doppeltem Verwendungszweck ist notorisch komplex. Die Durchführung strenger Kontrollen könnte Innovation und Wirtschaftswachstum ersticken, wenn nur eine winzige Minderheit eine KI-Technologie missbraucht.

KI-Firmen können die Schuldfrage umgehen, indem sie Richtlinien gegen Missbrauch erstellen, aber das hält die Menschen nicht davon ab, die KI zu benutzen. 'Gefängnisausbrüche', um Modelle zur Ausgabe von illegalem Material zu verleiten.

Abwägung zwischen dem wirtschaftlichen Nutzen von KI und ethischen Bedenken

Die Vorteile der KI sind wirtschaftlich überzeugend, vor allem in Bereichen wie Gesundheitswesen, Energie und Fertigung.

Berichte von McKinsey und PwC prognostizieren, dass KI jährlich einen Beitrag in Billionenhöhe zur Weltwirtschaft leisten wird, unabhängig von den Auswirkungen der Ersetzung von Arbeitsplätzen und Entlassungen.

KI kann als ein Weg zur Schaffung von Arbeitsplätzen und Wachstum für Länder betrachtet werden, die mit wirtschaftlichen Problemen zu kämpfen haben.

Auf einer breiteren philosophischen Ebene wird die KI manchmal als Retter der Menschheit inmitten von Makroproblemen wie Armut, Klimawandel und Überalterung der Bevölkerung dargestellt.

Westliche Regierungen - insbesondere die der USA und Großbritanniens - scheinen geneigt zu sein, das Wachstum durch steuerliche Anreize, die Finanzierung der KI-Forschung und einen Laissez-faire-Ansatz bei der Regulierung zu fördern.

Dies ist ein Wagnis, das die USA in der Vergangenheit eingegangen sind, indem sie der Tech-Industrie die Möglichkeit zur Selbstregulierung gaben, aber kann es sich weiterhin auszahlen?

WHaben die Unkenrufe, die KI mit einem "Atomkrieg" und "globalen Pandemien" vergleichen, der romantischen Vorstellung vom Potenzial der Technologie, die Menschheit aus den immer größer werdenden globalen Problemen zu befreien, ein Ende gesetzt?

KI stellt eine gewisse Dualität dar, die sowohl eutopische als auch dystopische Zukunftsvisionen hervorruft, je nachdem, wem man zuhört.

Rie Regulierung einer solchen Einrichtung ist eine noch nie dagewesene Herausforderung.

In jedem Fall werden wir Ende 2024 wahrscheinlich in einer Welt leben, in der KI nahezu universell reguliert ist, aber was niemand beantworten kann, ist, wie sehr die Industrie - und die Technologie selbst - wird sich bis dahin entwickelt haben.