Vi er for alvor kommet ind i en tid, hvor man ikke kan stole på, hvad man ser på nettet.

Det udsagn har været delvist sandt i årtier, men AI har løftet indholdsmanipulation til nye niveauer og overhalet den offentlige bevidsthed.

AI deep fake-teknologi kan skabe og ændre billeder, videoer og lydoptagelser, lægge ord i munden på offentlige personer eller få dem til at fremstå i situationer, der aldrig har fundet sted.

I mange tilfælde kræver det mere end et andet blik at afgøre, om indholdet er ægte, og falske medier kan akkumulere millioner af visninger, før de bliver identificeret.

Vi er nu vidne til dybe forfalskninger, der potentielt kan afbryde demokratiske processer, selvom det er for tidligt at måle håndgribelige virkninger på stemmeadfærden.

Lad os undersøge nogle af de mest bemærkelsesværdige politiske AI deep fake-hændelser, vi har været vidne til indtil nu.

Joe Biden New Hampshire-hændelse

Januar 2024, A New Hampshire, USA, a Robocall, der efterligner Bidens stemme opfordrede vælgerne til at "gemme din stemme til valget i november" og antydede fejlagtigt, at deltagelse i primærvalget utilsigtet ville gavne Donald Trump.

Det blev tilskrevet Kathy Sullivan, en tidligere formand for det demokratiske parti i delstaten, hendes personlige mobilnummer. Sullivan fordømte handlingen som en åbenlys form for indblanding i valget og personlig chikane.

Statsadvokaten i New Hampshire sagde, at dette var et ulovligt forsøg på at forstyrre præsidentens primærvalg og undertrykke valgdeltagelsen.

Den fabrikerede lyd blev identificeret som værende genereret ved hjælp af ElevenLabs, der er førende inden for talesyntese.

ElevenLabs suspenderede senere den skyldige bag den falske Biden-stemme og "Vi er dedikerede til at forhindre misbrug af audio AI-værktøjer og tager alle tilfælde af misbrug ekstremt alvorligt."

Den tyske kansler Olaf Scholz dyb falsk hændelse

I november 2023 var Tyskland vidne til en AI deep fake, der fejlagtigt afbildede kansler Olaf Scholz, som støttede et forbud mod det højreekstreme parti Alternativ for Tyskland (AfD).

Denne dybt falske video var en del af en kampagne fra en kunst-aktivistgruppe, the Center for Politisk Skønhed (CPB)og har til formål at henlede opmærksomheden på AfD's stigende indflydelse. Kritikken af AfD er foregrebet af Tysklands historie fra 1930'erne.

Under ledelse af filosoffen og kunstneren Philipp Ruch har CPB-gruppen til formål at skabe "politisk poesi" og "moralsk skønhed", der tager fat på vigtige nutidige emner som menneskerettighedskrænkelser, diktatur og folkedrab.

CPB har engageret sig i adskillige kontroversielle projekter, som f.eks. "Søg efter os"-installation nær Forbundsdagensom de hævdede indeholdt jord fra tidligere dødslejre og rester af Holocaust-ofre.

Mens støtten til AfD er vokset, viser talrige protester over hele Tyskland en stærk modstand mod AfD's ideologier.

En talsmand for gruppen bag deep fake udtalte: "I vores øjne er højreekstremismen i Tyskland, som sidder i parlamentet, farligere."

AfD-embedsmænd kaldte den dybt falske kampagne for en vildledende taktik, der havde til formål at miskreditere partiet og påvirke den offentlige mening.

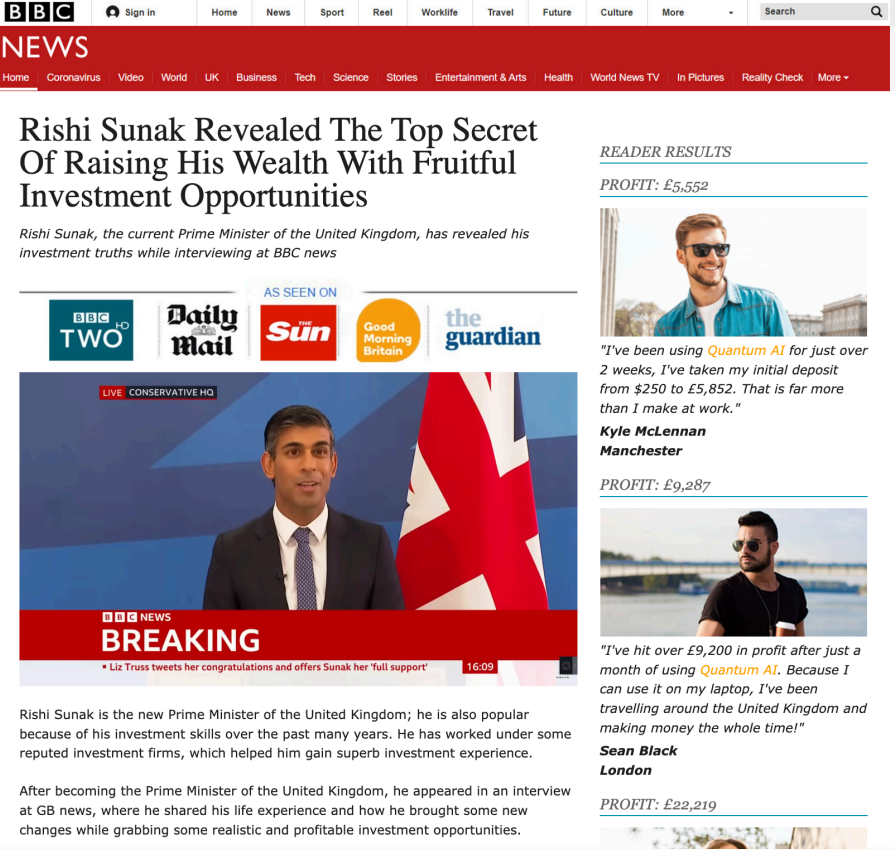

Storbritanniens premierminister Rishi Sunak indblandet i svindel

I januar 2024 fandt et britisk researchfirma ud af, at premierminister Rishi Sunak var involveret i over 100 vildledende videoreklamer, der primært blev spredt på Facebook og nåede ud til anslået 400.000 personer.

Disse annoncer, der stammer fra forskellige lande, herunder USA, Tyrkiet, Malaysia og Filippinerne, promoverede falske investeringsordninger, der fejlagtigt var forbundet med højt profilerede personer som Elon Musk.

Undersøgelsen, der blev udført af online-kommunikationsbureauet Firmaet Fenimore HarperI den forbindelse blev det fremhævet, at de sociale medier simpelthen ikke reagerer på denne form for indhold inden for en rimelig tidsramme.

Marcus Beard, grundlægger af Fenimore Harper, forklarede, hvordan AI demokratiserer misinformation: "Med fremkomsten af billige, brugervenlige stemme- og ansigtskloninger kræver det meget lidt viden og ekspertise at bruge en persons udseende til ondsindede formål."

Beard kritiserede også den utilstrækkelige indholdsmoderation på de sociale medier og bemærkede: "Disse reklamer er i strid med flere af Facebooks reklamepolitikker. Men meget få af de annoncer, vi stødte på, ser ud til at være blevet fjernet."

Den britiske regering reagerede på risikoen for bedrageriske forfalskninger: "Vi arbejder intensivt på tværs af regeringen for at sikre, at vi er klar til hurtigt at reagere på eventuelle trusler mod vores demokratiske processer gennem vores taskforce til forsvar for demokratiet og dedikerede regeringsteams."

Pakistans premierminister Imran Khan optræder i virtuelt rally

I december 2023 sidder Pakistans tidligere premierminister, Imran Khan, fængslet på grund af lækage af statshemmeligheder, optrådte ved et virtuelt rally ved hjælp af AI.

På trods af at Khan er bag tremmer, blev hans digitale avatar set af millioner af mennesker. Mødet indeholdt optagelser fra tidligere taler, der involverede hans politiske parti, Pakistan Tehreek-e-Insaaf (PTI).

Khans fire minutter lange tale handlede om modstandskraft og trods mod den politiske undertrykkelse, som PTI-medlemmerne er udsat for.

AI-stemmen formulerede sig: "Vores parti har ikke lov til at holde offentlige møder. Vores folk bliver kidnappet, og deres familier bliver chikaneret," og fortsatte: "Historien vil huske jeres ofre."

For at forvirre situationen forsøgte den pakistanske regering angiveligt at blokere for adgangen til demonstrationen.

NetBlocks, en organisation, der overvåger internettet, sagde: "Målinger viser, at store sociale medieplatforme var begrænset i Pakistan i [næsten] 7 timer søndag aften under et politisk møde på nettet; hændelsen er i overensstemmelse med tidligere tilfælde af internetcensur rettet mod oppositionslederen Imran Khan og hans parti PTI."

ℹ️ ICYMI: Målinger viser, at store sociale medieplatforme blev begrænset i #Pakistan i ca. 7 timer søndag aften under et politisk online-møde; hændelsen er i overensstemmelse med tidligere tilfælde af internetcensur rettet mod oppositionsleder Imran Khan og hans parti PTI https://t.co/AS9SdfwqoH pic.twitter.com/XXMYBhknXd

- NetBlocks (@netblocks) 18. december 2023

Usama Khilji, der er fortaler for ytringsfrihed i Pakistan, kommenterede: "Med en fuldstændig undertrykkelse af PTI's ret til forenings- og ytringsfrihed via anholdelser af ledere, markerer partiets brug af kunstig intelligens til at udsende en virtuel tale med ordene fra dets fængslede formand og tidligere premierminister Imran Khan et nyt punkt i brugen af teknologi i pakistansk politik."

Falsk lyd af den tidligere sudanesiske præsident Omar al-Bashir på TikTok

En AI-drevet kampagne på TikTok udnyttede stemmen fra Sudans tidligere præsident Omar al-Bashir midt i landets igangværende civile uro.

Siden slutningen af august 2023 har en anonym konto postet, hvad den hævder at være "lækkede optagelser" af al-Bashir. Analytikere fandt dog ud af, at optagelserne var AI-genererede forfalskninger.

al-Bashir' har været fraværende i offentligheden, siden han blev fordrevet fra landet i 2019 på grund af alvorlige anklager om krigsforbrydelser.

Slovakiets lydsvindel på valgdagen

På dagen for det slovakiske valg blev der offentliggjort en kontroversiel lydoptagelse af Michal Šimečka, leder af partiet Progressive Slovakia, og journalisten Monika Tódová, der diskuterede korrupte metoder som stemmekøb.

Dette kom frem under Slovakiets medie-blackout før valget, så de implicerede personer kunne ikke nemt offentligt afvise deres involvering før efter valget.

Begge implicerede parter fordømte senere optagelsen som en dyb forfalskning, hvilket et faktatjekbureau bekræftede.

Volodymyr Zelenskiys dybe falskhed

I 2023 blev en dybt falsk video af den ukrainske præsident Volodymyr Zelenskiy, som på amatørbasis antydede, at han opfordrede soldater til at forlade deres poster, hurtigt identificeret som falsk og fjernet af de store sociale medieplatforme.

Tyrkisk valg dybt falsk drama

I optakten til Tyrkiets parlaments- og præsidentvalg blev en video, der fejlagtigt viste, at præsident Recep Tayyip Erdoğans hovedudfordrer, Kemal Kılıçdaroğlu, modtog støtte fra PKK, spredt på nettet.

Donald Trump dybe forfalskninger

I begyndelsen af 2023 var vi vidne til realistisk udseende deep fakes af Donald Trump, der blev arresteret, og en kampagnevideo af Ron DeSantis med AI-genererede billeder af Trump, der omfavner Anthony Fauci.

Belgisk politisk partis Trump-dybde er falsk

En tidligere hændelse i 2018 i Belgien skabte politisk røre, da en dybt falsk video skabt af et politisk parti skabte et offentligt ramaskrig.

Videoen viste fejlagtigt, at præsident Donald Trump rådede Belgien til at trække sig ud af klimaaftalen fra Paris.

Videoen var en del af en højteknologisk forfalskning, som senere blev erkendt af partiets mediehold. Den viste, hvor omfattende forfalskninger der kan bruges til at fabrikere udtalelser fra verdens ledere for at påvirke den offentlige mening og politik.

Dyb forfalskning af Nancy Pelosi

En manipuleret video af Nancy Pelosi i 2020, der fik det til at se ud, som om hun talte usammenhængende og var beruset, spredte sig hurtigt på de sociale medier.

Det viste, at deep fakes har potentiale til at miskreditere og bringe offentlige personer i forlegenhed, hvilket ofte fortsætter, efter at indholdet er blevet betragtet som falsk.

Audio deepfake af Keir Starmer

En anden hændelse i britisk politik involverede et lydklip, som angiveligt fangede oppositionsleder Sir Keir Starmer, der bandede af sine medarbejdere.

Klippet, som blev spredt på de sociale medier, viste sig senere at være en AI-genereret deep fake.

I takt med at teknologivirksomheder udforsker måder at tackle deep fakes på i stor skala, vil de AI-modeller, der bruges til at skabe falske medier, kun blive mere sofistikerede og lettere at bruge.

Den kommende rejse kræver en fælles indsats blandt teknologer, politikere og offentligheden for at udnytte AI's fordele og samtidig beskytte vores samfunds søjler af tillid og integritet.

Tilliden til politik og offentlige institutioner er mildest talt allerede spinkel. Dybe forfalskninger vil underminere den yderligere.