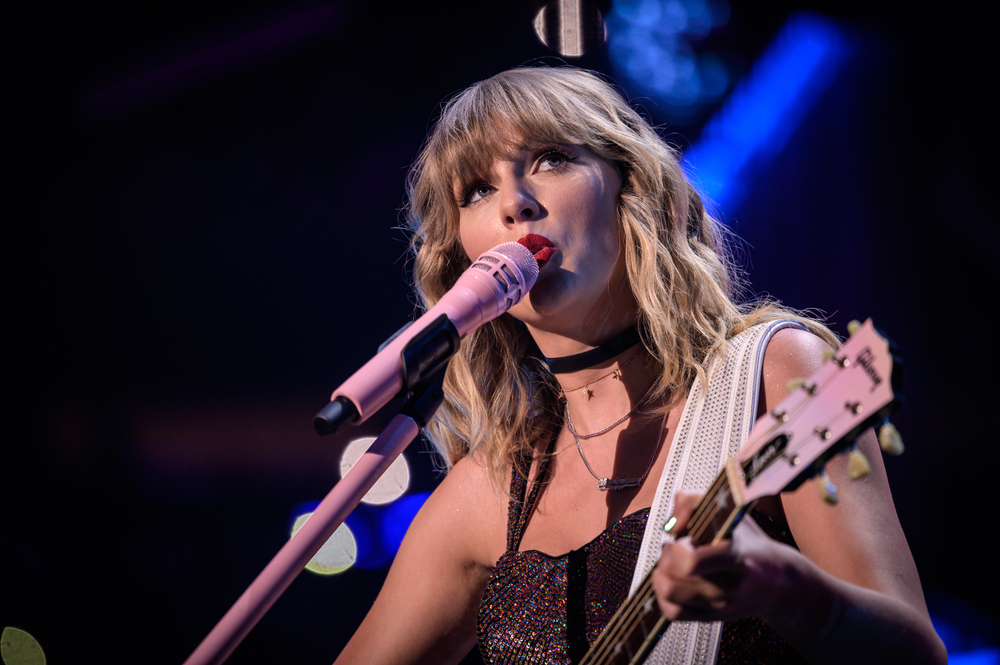

Недавно в социальных сетях были распространены откровенно поддельные изображения поп-звезды Тейлор Свифт, созданные искусственным интеллектом, что вызвало всеобщее возмущение.

Несмотря на строгие правила, запрещающие подобный контент, эти снимки, на которых Свифт изображена в откровенно сексуальных позах, провисели 19 часов, набрав более 27 миллионов просмотров и 260 тысяч лайков, прежде чем аккаунт был приостановлен.

Этот инцидент стал поводом для многочисленных вопросов об эффективности политики социальных сетей в отношении глубокая фальшивая дезинформация.

Можно ли его остановить? Похоже, что нет. Так как же с этим бороться? Что ж, сервисы обнаружения ИИ (похожие на службы проверки фактов) и "Заметки сообщества", прикрепляемые к постам на сайте X, - два возможных решения, но у обоих есть свои недостатки.

Откровенные изображения Тейлор Свифт распространялись в основном в социальных сетях на платформе X, но также попали на другие социальные медиаплатформы, включая Facebook, показывая, как противоречивый контент ИИ распространяется как лесной пожар.

Представитель Meta отреагировал на инцидент, заявив: "Этот контент нарушает наши правила, и мы удаляем его с наших платформ и принимаем меры против аккаунтов, которые его разместили. Мы продолжаем мониторинг, и если мы обнаружим еще какой-либо нарушающий правила контент, мы удалим его и примем соответствующие меры".

Миллионы пользователей Reddit обсуждают последствия этого и других недавних вирусных инцидентов с фейками, включая фотографию горящей Эйфелевой башни.

В сети TikTok появилось видео, просмотренное миллионы раз, в котором утверждается, что Эйфелева башня горит. Эйфелева башня не горит. pic.twitter.com/IxlsKOqOsI

- Алистер Коулман (@alistaircoleman) 22 января 2024 года

Хотя многие воспримут эти изображения как очевидную подделку, мы не можем предполагать, что широкая общественность знает об этом.

Один из комментаторов на Reddit сказал об инциденте с Тейлор Свифт: "Теперь я знаю, как много людей не знают, что такое глубокие подделки", подразумевая низкую осведомленность о проблеме.

Эксперты отрасли также обсудили эту проблему с бывшим руководителем компании-Stability Эдом Ньютоном-Рексом, который утверждает, что технологические компании придерживаются "порывистого" подхода и плохо вовлекают в работу руководителей.

Явные, несогласованные глубокие подделки ИИ - результат целого ряда неудач.

- Культура генеративного ИИ, основанная на принципах "корабль - как можно быстрее", независимо от последствий

- Умышленное игнорирование компаниями, занимающимися разработкой ИИ, того, для чего используются их модели

- Полное пренебрежение доверием и...- Эд Ньютон-Рекс (@ednewtonrex) 26 января 2024 года

Бен Декер из Memetica, агентства цифровых расследований, прокомментировал отсутствие контроля над воздействием ИИ: "Это яркий пример того, как искусственный интеллект развязывается для множества гнусных целей без достаточных ограждений, чтобы защитить общественность".

Он также указал на недостатки стратегий мониторинга контента, применяемых компаниями в социальных сетях.

Сообщается, что Тейлор Свифт рассматривает возможность судебного разбирательства с сайтом, разместившим эти изображения.

Было множество подобных случаев откровенных глубоких подделок, в основном с участием женщин и детей, иногда с намерение подкупить людейЕго также называют "сексплуатацией".

ИИ-изображения сексуального насилия над детьми - самый мрачный и вызывающий опасения результат применения технологии генерации изображений. Недавно в США мужчина был приговорен к 40 годам в тюрьму за хранение таких изображений.

После этого и других подобных инцидентов участились призывы к принятию законодательства, направленного на борьбу с этой формой неправомерного использования ИИ.

Представитель США Джо Морелль назвал распространение фальшивок Свифт "ужасающим" и призвал к срочным юридическим действиям. Он отметил: "В том, что произошло с Тейлор Свифт, нет ничего нового", подчеркнув непропорционально большое влияние такого контента на женщин.

Глубокая фальшивая дезинформация также широко обсуждалась на Всемирный экономический форум в Давосе с растущим опасения по поводу возможности влияния манипулируемого контента на фондовые рынки, выборы и общественное мнение.

Усилия по борьбе с подделками уже предпринимаются: и стартапы, и технологические гиганты разрабатывают технологии обнаружения.

Например, компания Intel выпустила продукт, способный распознавать поддельные видеоролики с точностью 96%.

Однако пока эта проблема остается практически непреодолимой, поскольку технология быстро развивается и распространяется по всему интернету.