В 1956 году Филип К. Дик написал роман "Доклад меньшинства", в котором рассказывалось о будущем, где "прекоги" могут предвидеть преступления до того, как они произойдут в реальности.

Несколько десятилетий спустя Том Круз перенес это жуткое видение на большой экран, преследуя потенциальных преступников на основе этих предсказаний.

Обе версии заставляют нас задуматься об этических последствиях ареста за то, что вы можете сделать в будущем.

Сегодня, когда методы предиктивного полицейского контроля пробивают себе дорогу в современную правоохранительную систему, стоит задуматься: не стоим ли мы на пороге воплощения в жизнь провидческих предсказаний Дика?

Что такое предиктивная полиция и как она работает?

Предиктивная полицейская деятельность объединяет правоохранительные органы и передовую аналитику, используя машинное обучение для предвидения преступных действий до их совершения.

На бумаге все выглядит достаточно просто: если мы сможем расшифровать закономерности, скрытые в исторических данных о преступлениях, то сможем разработать алгоритмы для прогнозирования будущих происшествий.

Процесс начинается с сбора исторических данных о преступлениях, записей с камер наблюдения, разговоров в социальных сетях и даже таких нюансов, как погодные колебания. Затем эта обширная информация поступает в сложные модели машинного обучения, предназначенные для выявления основных закономерностей.

Например, модель может определить, что в определенном районе наблюдается всплеск краж в дождливые вечера выходных.

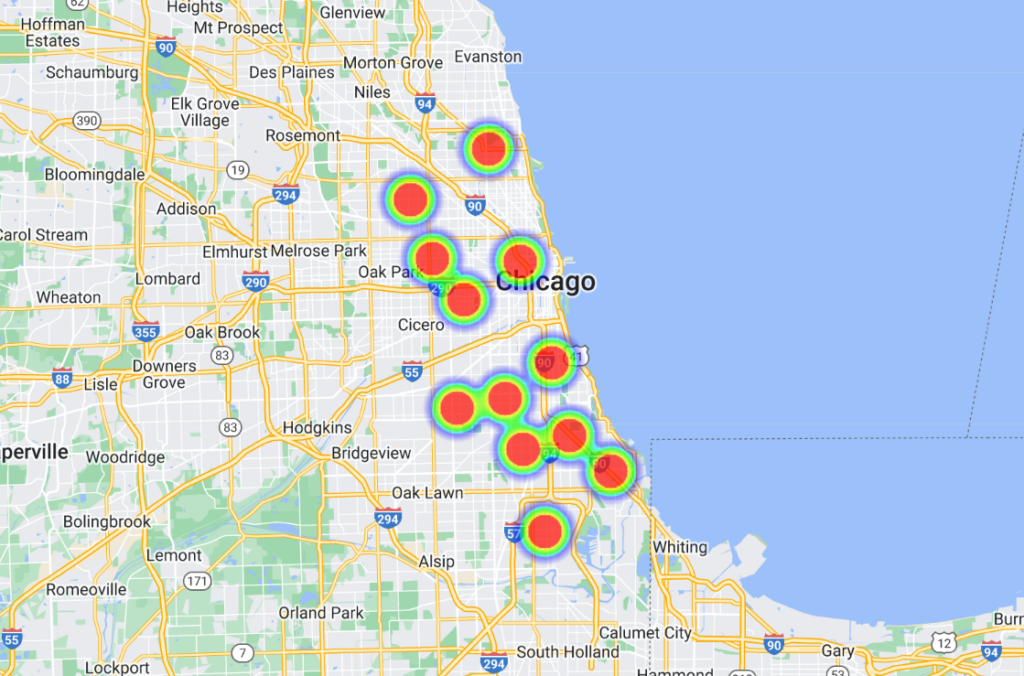

Как только эти взаимосвязи выявлены, передовые программные платформы преобразуют их в визуальные представления, часто напоминающие "тепловые карты" с указанием вероятных очагов преступности. Это, в свою очередь, позволяет полиции проактивно распределять свои ресурсы, оптимизируя патрулирование и вмешательство.

Некоторые модели пошли дальше и стали перечислять людей по именам и адресам, предоставляя офицерам очень конкретные и локализованные прогнозы.

История предиктивного полицейского контроля

Технология предиктивной полиции все еще находится в зачаточном состоянии, и, хотя в отрасли уже есть несколько влиятельных игроков, таких как Palantir, сама отрасль невелика.

В июне 2022 года Чикагский университет разработали модель искусственного интеллекта способный прогнозировать местоположение и уровень преступности в городе с точностью до 90%.

Опираясь на открытые данные о преступности с 2014 по 2016 год, команда разделила Чикаго на квадраты длиной около 1000 футов (300 м). Модель могла за неделю предсказать квадрат с наибольшей вероятностью совершения преступления.

Исследование преследовало честные цели - выявить пространственные и социально-экономические предубеждения в работе полиции и распределении ресурсов. Оно показало, что богатые районы получают больше ресурсов, чем районы с низким уровнем дохода.

По словам авторов исследования, "здесь мы показываем, что, хотя прогностические модели могут усиливать власть государства через криминальный надзор, они также позволяют следить за государством, отслеживая системные предубеждения в правоприменении".

Кроме того, модель была обучена на данных из семи других городов США, показав схожие результаты. Все наборы данных и алгоритмы доступны на GitHub.

Чикаго - важный пример полицейской деятельности, основанной на данных и искусственном интеллекте. Другой пример - городская программа тепловая карта преступлений с применением огнестрельного оружияВ нем выявляются "горячие точки" преступности, которые могут быть использованы в работе полиции.

Примечательный случай произошел в 2013 году - в самом начале становления предиктивной полиции. привлеченный Роберт МакДэниелсжитель чикагского района Остин, на который приходится 90% всех преступлений с применением огнестрельного оружия в городе.

Несмотря на то что Макдэниел не совершал насильственных действий, его включили в список потенциально опасных преступников, и он дважды становился жертвой насилия с применением огнестрельного оружия: полиция приходила к нему в дверь и делала его мишенью.

Расследование The Verge В нем говорится, что журналист из Chicago Tribune связался с МакДэниелом по поводу "теплового списка" - неофициального названия, которое полиция присвоила алгоритмам, обозначающим потенциальных стрелков и цели.

Ишану Чаттопадхьяй, ведущий исследователь из Чикаго 2022 года. проект по прогнозированию преступностиНо он подчеркнул, что их модель предсказывает места, а не отдельных людей. Это не "Minority Report", - сказал он, - но событие с Макдэниелсом, безусловно, наводит на некоторые параллели.

Отвечая на вопрос о предвзятости, Чаттопадхьяй отметил, что они намеренно не учитывали мелкие правонарушения, связанные с наркотиками и нарушением правил дорожного движения, сосредоточившись на более часто регистрируемых насильственных и имущественных преступлениях.

Однако сисследования показывают, что на чернокожих людей чаще поступают заявления о преступлениях, чем на их белых сверстников. Следовательно, черные районы несправедливо называют "районами повышенного риска".

Более того, усиление полицейской работы в районе означает увеличение количества сообщений о преступлениях, что создает обратную связь, искажающую восприятие преступности.

В таком случае, опираясь на прошлые данные, можно закрепить стереотипы и упустить потенциал для изменений и реабилитации.

Как работает предиктивная полиция?

Предиктивная полицейская деятельность, что неудивительно, вызывает много споров, но работает ли она вообще или выполняет ли свою основную задачу?

Расследование, проведенное в октябре 2023 года Разметка и Wired выявили вопиющие провалы, пополнив растущий объем доказательств, свидетельствующих об опасностях и недостатках передачи принятия решений правоохранительными органами машинам.

В центре внимания находится программа Geolitica, программное обеспечение для предиктивной работы полиции, используемое полицией города Плейнфилд, штат Нью-Джерси. Стоит отметить, что полицейский департамент Плейнфилда был единственным из 38 департаментов, готовых поделиться данными со СМИ.

Ранее известный как PredPolЭто программное обеспечение для машинного обучения было приобретено различными полицейскими департаментами.

The Markup и Wired проанализировали 23 631 предсказание Geolitica с февраля по декабрь 2018 года. Из них менее 100 предсказаний совпали с реальными случаями преступлений, в результате чего коэффициент успешности составил менее половины процента.

Эти модели предсказаний всегда вызывали споры и многочисленные этические вопросы, связанные с тем, что они могут усилить дискриминационные и расистские предубеждения, распространенные в искусственном интеллекте и правоохранительных органах.

Недавнее расследование подчеркивает этические дилеммы и ставит под сомнение эффективность программного обеспечения в предсказании преступлений.

Хотя программное обеспечение продемонстрировало незначительные различия в точности прогнозирования по видам преступлений (например, оно правильно предсказало 0,6 % ограблений или нападений при отягчающих обстоятельствах по сравнению с 0,1 % краж со взломом), общая картина остается крайне неудовлетворительной.

Откровенный ответ капитана полиции Плейнфилда Дэвида Гуарино проливает свет на реальное положение дел. "Почему мы приобрели PredPol? Мы хотели повысить эффективность борьбы с преступностью, - прокомментировал он.

"Я не уверен, что он достиг этой цели. Мы редко, если вообще когда-либо, использовали его". Он также упомянул, что полицейский департамент прекратил его использование.

Капитан Гуарино предположил, что средства, выделенные Geolitica - а это $20 500 годовой абонентской платы плюс еще $15 500 на второй год - можно было бы более эффективно вложить в программы, ориентированные на сообщество.

Компания Geolitica намерена свернуть свою деятельность до конца года.

Факты, подтверждающие предвзятое отношение к предиктивной работе полиции

Перспективы предиктивной работы полиции остаются заманчивыми, особенно в условиях, когда полицейские силы становятся все более растянутыми, а качество принятия полицейских решений людьми становится все более сомнительным.

Полицейские силы США, Великобритании и ряда европейских стран, включая Францию, подвергаются тщательной проверке в связи с предвзятым отношением к меньшинствам.

Члены Палаты лордов и Палаты общин Великобритании призывают к временная остановка о внедрении в полиции технологии распознавания лиц в реальном времени.

Это произошло после того, как министр по делам полиции Крис Филипп обсудил вопрос о предоставлении полицейским силам доступа к 45 миллионам изображений из базы данных паспортов для распознавания лиц полицейских. На данный момент 65 парламентариев и 31 организация, занимающаяся вопросами прав и расового равенства, выступают против использования технологий распознавания лиц в работе полиции.

Адвокатская группа Большой брат смотреть В исследовании говорится, что 89% предупреждений о распознавании лиц в полиции Великобритании не справляются со своей задачей, причем непропорционально худшие результаты показывают группы этнических меньшинств и женщины. Испытание распознавания лиц, проведенное в 2018 году Лондонской столичной полицией, дало удручающие результаты коэффициент успеха составляет всего около 2%.

Майкл Биртвистл, сотрудник Института Ады Лавлейс, описаноТочность и научная основа технологий распознавания лиц весьма спорны, а их законность неясна".

В США в рамках совместного проекта Колумбийского университета, Института AI Now и других организаций недавно был проведен анализ судебных разбирательств в США, связанных с алгоритмами.

Исследование показало, что системы искусственного интеллекта часто внедряются поспешно, без надлежащего надзора, в основном для сокращения расходов. К сожалению, эти системы часто приводят к проблемам с конституцией из-за присущей им предвзятости.

По меньшей мере четыре чернокожих мужчины были ошибочно арестованы и/или заключены в тюрьму из-за неправильного совпадения лиц в США, в том числе Ниджир Паркс, ложно обвинили в краже из магазина и дорожных правонарушениях, несмотря на то, что он находился в 30 милях от предполагаемых инцидентов. Впоследствии он провел десять дней в тюрьме и был вынужден оплатить тысячи судебных издержек.

Сайт Авторы исследования пришли к выводуЭти системы искусственного интеллекта были внедрены без полноценного обучения, поддержки или надзора, а также без какой-либо конкретной защиты для получателей. Отчасти это объясняется тем, что они были приняты для экономии средств и стандартизации в рамках монолитной модели закупок технологий, которая редко учитывает проблемы конституционной ответственности".

Предиктивная полицейская деятельность может способствовать принятию неестественных решений

Даже если предиктивная полиция точна, люди должны действовать в соответствии с прогнозами, и вот тут-то все и становится запутанным.

Когда алгоритм сообщает полиции, что им нужно быть в каком-то месте, потому что там совершается/может быть совершено преступление, далеко не факт, что это искажает процесс принятия решений.

Существует несколько основных психологических теорий, с которыми стоит ознакомиться при рассмотрении роли искусственного интеллекта в работе полиции.

Во-первых, когда алгоритм сообщает полиции о вероятном месте преступления, он потенциально заставляет ее рассматривать ситуацию через призму ожиданий. Возможно, это сыграло свою роль в инциденте с Макданиэлсом - полиция прибыла на место происшествия, ожидая инцидента, что спровоцировало эскалацию событий в условиях нестабильной обстановки.

В основе этого лежит предубеждение подтверждения, предполагающее, что, получив информацию, мы склонны искать и интерпретировать последующую информацию таким образом, чтобы она соответствовала нашему первоначальному убеждению.

Когда алгоритм сообщает человеку о вероятности совершения преступления, он может бессознательно придать большее значение сигналам, подтверждающим это предсказание, и пропустить те, которые ему противоречат.

Более того, алгоритмы, особенно используемые в официальных целях, могут восприниматься как авторитетные в силу своей вычислительной природы, и сотрудники могут излишне доверять им.

Кроме того, существует риск морального отстранения. Офицеры могут переложить ответственность за свои действия на алгоритм, считая, что это программа приняла решение, а не они - что также весьма актуально в области ведения боевых действий.

Дебаты здесь идут параллельно с дебатами вокруг Использование искусственного интеллекта на поле боя, который ставит перед нами схожие дилеммы.

Навязанные полномочия ИИ могут привести к "разрыву ответственности", когда никто не берет на себя ответственность за ошибки, совершенные ИИ, как подчеркивают Кейт Кроуфорд и Джейсон Шульц в недавней статье Статья из JSTOR.

В целом, судя по имеющимся у нас данным, предиктивная полицейская деятельность зачастую не уменьшает, а закрепляет предвзятость.

Когда прогнозы сочетаются с принятием решений человеком, последствия могут быть катастрофическими.