В недалеком прошлом разговоры об искусственном интеллекте в основном ограничивались научной фантастикой и академическими статьями.

Сегодня ИИ глубоко интегрирован в повседневную жизнь: от управления умными домами до диагностики заболеваний.

Но пока технологии искусственного интеллекта мчатся вперед, нормативно-правовая база играет в догонялки, зачастую отставая от инновационной кривой.

Это ставит перед человечеством многогранную задачу: как разработать законы и правила, достаточно гибкие, чтобы адаптироваться к быстрым технологическим изменениям и в то же время достаточно надежные, чтобы защитить интересы общества?

Во всем мире усилия по регулированию далеко не одинаковы. Европейский союз (ЕС) создает основу для принятия всеобъемлющего закона об искусственном интеллекте, который направлен на классификацию и контроль приложений искусственного интеллекта в зависимости от степени их риска.

В то же время США предпочитают добровольные обязательства немедленному принятию закона.

Китай, напротив, жестко контролирует ИИ, согласуя регулирование с более широкими политическими и социальными целями управления.

Не стоит забывать и о других юрисдикциях - ИИ является глобальным явлением, которое потребует практически повсеместного законодательного регулирования. покрытие.

Итак, на каком этапе находится регулирование и как оно должно развиваться?

Подход ЕС

Евросоюз принял строгие рамки с помощью своего новаторского закона об искусственном интеллекте, который, как ожидается, будет полностью утвержден к концу года.

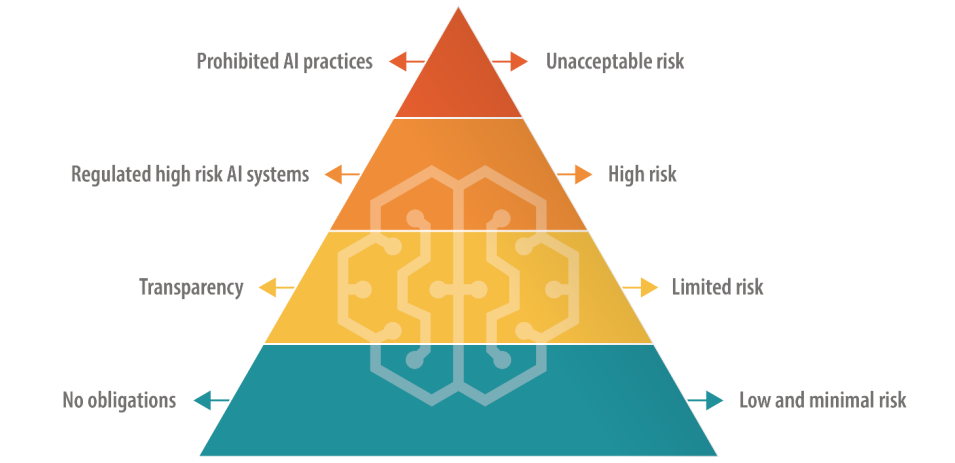

Закон об искусственном интеллекте определяет четыре уровня, включая "искусственный интеллект с неприемлемым риском", "искусственный интеллект с высоким риском", "искусственный интеллект с ограниченным риском" и "искусственный интеллект с низким риском", каждый из которых имеет конкретный набор рекомендаций и запретов.

ИИ с неприемлемым риском, представляющие непосредственную или значительную опасность, например, причиняющие физический или психический вред или нарушающие права человека, будут полностью запрещены.

ИИ с высоким уровнем риска разрешены, но подлежат строгому регулированию - от управления рисками до технической документации и кибербезопасности.

С другой стороны, ИИ с ограниченным и низким уровнем риска остаются преимущественно нерегулируемыми, но обязаны поддерживать прозрачность в отношениях с пользователями.

В краткосрочной перспективе есть одна отсрочка: законодательство предусматривает льготный период в два года, в течение которого компании смогут привести свои действия в соответствие с новыми правилами.

ЕС предлагает, чтобы оригинальные создатели моделей ИИ несли ответственность за то, как используется их технология, даже если она внедрена в другую систему другой компанией или разработчиком. Также добавлены новые правила для "базовых моделей", которые включают генеративные модели ИИ.

Закон об искусственном интеллекте был воспринят по-разному: некоторые критикуют его неуклюжие определения и потенциал для подавления инноваций. Например, существует значительная неопределенность в отношении того, как различные модели ИИ распределяются по категориям риска.

Кроме того, небольшие компании, работающие в сфере ИИ, опасаются, что им не хватит ресурсов для обеспечения соответствия нормативным требованиям.

Генеральный директор OpenAI Сэм Альтман под угрозой вывести продукцию своей компании с рынка ЕС, если в Законе об искусственном интеллекте будут указаны требования, которые невозможно выполнить.

В июне 150 крупных компаний подчеркнули жесткий подход к закону, заявив, что нынешние правила рискуют уничтожить европейскую конкурентоспособность.

Расхождение с США

A Стэнфордский анализ В рамках Закона об искусственном интеллекте обсуждались фундаментальные различия между подходами ЕС и США к регулированию искусственного интеллекта.

Алекс Энглер, научный сотрудник отдела исследований управления Института Брукингса, сказал: "Между подходами США и ЕС [к регулированию ИИ] наблюдается растущее несоответствие".

Он подчеркивает, что ЕС добился принятия законов о конфиденциальности и прозрачности данных, которые в США в основном отсутствуют. Различия мешают компаниям, работающим в сфере ИИ, соблюдать требования законодательства, а затраты, связанные с соблюдением требований разных юрисдикций, могут оказаться непосильными.

"Корпоративные интересы будут бороться до последнего, если у вас будет два кардинально разных стандарта для онлайн-платформ", - сказал Энглер.

В общем, когда дело дойдет до драки, трудно представить, что технологические компании не найдут способ ориентироваться в Законе об искусственном интеллекте, как они это сделали с GDPR и должны будут сделать с недавно принятым Законом о цифровых услугах.

Выступая перед журнал ПриродаДэниел Лейфер (Daniel Leufer), старший аналитик по вопросам политики в Access Now, считает возражения индустрии ИИ против закона "обычным показушничеством".

Подход Великобритании

После Brexit Великобритания намерена воспользоваться своей независимостью от ЕС, чтобы разработать более гибкий и специфический для каждого сектора режим регулирования.

В отличие от Закона об искусственном интеллекте, правительство Великобритании намерено регулировать приложения искусственного интеллекта, а не само программное обеспечение, лежащее в его основе.

Позиция "за инновации"

Правительство Великобритании опубликовало белая книга в марте в котором излагается концепция "за инновации" и предлагается заинтересованным сторонам поделиться своим мнением. Однако правительство еще не выпустило руководство по реализации этой концепции.

В заявлении говорится, что "правительство поможет Великобритании использовать возможности и преимущества, которые предоставляют технологии искусственного интеллекта" - подход, который критикуют за то, что он не уделяет должного внимания вреду, связанному с искусственным интеллектом.

Правительство даже планировало предложить ИИ-компаниям крайне спорное "освобождение от авторских прав", но Отказался от этого плана. в августе.

В последнее время Британия испытывает трудности с привлечением технологических инноваций, в частности, потеряв кембриджского производителя чипов Arm, который предпочел разместить акции на бирже в США, а не внутри страны. Это, возможно, подогревает беспокойство Великобритании по поводу того, как оживить свой угасающий технологический сектор.

Чтобы помочь Великобритании стать передовой страной в области искусственного интеллекта, премьер-министр Риши Сунак объявил о проведении двухдневного Саммит по безопасности искусственного интеллекта которая состоится в ноябре.

Примечательно, что на мероприятие был приглашен Китай, хотя есть предположения, что его не допустят к участию. опасения шпионажа.

Подход США

В США основное внимание уделяется саморегулированию отрасли, по крайней мере, на данный момент.

Конгресс США сигнализирует о своей позиции "подождать и посмотреть", приступая к пересмотру закрытых встреч ИИ и Чака Шумера Форумы AI Insight чтобы определить, где именно искусственный интеллект требует нового регулирования.

Двухпартийные соглашения могут заключаться в принятии узкоспециализированных законов, касающихся конфиденциальности, прозрачности платформ или защита детей в интернете.

Кроме того, некоторые отмечают, что существующие законы и правила по-прежнему актуальны для ИИ.

В июне, Хан сказал"ИИ не освобождается от законов, запрещающих дискриминацию... Поскольку эти вещи все больше внедряются в процесс принятия повседневных решений, я думаю, они требуют и заслуживают пристального внимания... Я думаю, что правоохранительные органы, будь то на уровне штата или на национальном уровне, будут действовать".

Добровольные рамочные программы и меры предосторожности

Такие известные технологические компании, как Microsoft, OpenAI, Google, Amazon и Meta, недавно подписали добровольные обязательства по безопасной разработке ИИвключая проведение внутреннего и внешнего тестирования моделей ИИ до их публичного выпуска.

Многие лидеры технологической индустрии выступили с собственными обещаниями, но в В отсутствие надежного законодательного надзора искренность этих обещаний еще предстоит проверить.

В целом, критики утверждают, что подход США по сути символический, ему не хватает глубины и целеустремленности, как у закона ЕС об искусственном интеллекте. Первый Форум AI Insight Это было в основном закрытое мероприятие, которое некоторые критиковали как ограничивающее открытые дебаты.

Сенатор Джош Хоули сказал, что это мероприятие было "гигантской коктейльной вечеринкой".

Как метко подметил Райан Кало, профессор Школы права Вашингтонского университета, "есть видимость деятельности, но нет ничего существенного и обязательного".

Китайский подход

Китай, соразмерно своему стремлению к государственному контролю, вводит одни из самых строгих правил в отношении ИИ.

Особое внимание уделяется контролю за распространением информации ИИ, что отражает более широкие политические и социальные рамки управления в Китае.

Например, поставщики генеративного ИИ, чьи продукты могут "влиять на общественное мнение", обязаны проходить проверку на безопасность.

Первая волна одобренных чат-ботов, включая бота ERNIE Bot компании Baidu, была недавно представлена. выпущено для общественности и обнаружил цензуру вопросов на политическую тематику.

Всплеск "глубоких подделок" и контента, созданного искусственным интеллектом, создает проблемы во всем мире, и Китай не является исключением. Признав потенциальные проблемы ИИ относительно рано, Администрация киберпространства Китая (CAC) потребовала от генераторов контента на основе ИИ проходить процедуру проверки личности пользователей.

Кроме того, были введены положения о водяных знаках, чтобы отличать контент, созданный ИИ, от контента, созданного человеком, - правила, которые стремятся внедрить и западные державы.

Расхождения между США и Китаем

ИИ ускорил трения между США и Китаем, вызвав то, что многие называют "цифровой холодной войной" - или, возможно, более уместно, "холодной войной ИИ".

Ограничения США на сотрудничество и торговлю с Китаем не являются чем-то новым, но разделение двух стран сдвинулось на шаг вперед, когда Си Цзиньпин объявил о своей новой, реформированной План "Сделано в Китае 2025.

Цель этой программы - к 2025 году сделать Китай 70% самодостаточным в важнейших технологических отраслях, включая высокотехнологичный искусственный интеллект.

В настоящее время США прекращение финансирования и исследований связи с Китаем, при этом подчиняя себе закупки чипов искусственного интеллекта у таких компаний, как Nvidia.

Хотя США имеют явное преимущество в гонке за доминирование ИИ, у Китая есть несколько хитростей в рукаве, включая централизованный подход к регулированию и практически неограниченное количество персональных данных.

В мае Эдит Юнг, партнер инвестиционной компании Race Capital, рассказал Би-би-си"В Китае гораздо меньше правил, касающихся конфиденциальности, и гораздо больше данных [по сравнению с США]. Например, там повсеместно используется система распознавания лиц CCTV".

Тесное взаимодействие китайского правительства и технологической индустрии также дает свои преимущества, поскольку обмен данными между правительством и отечественными технологическими компаниями практически беспрепятственен.

США и другие западные юрисдикции не имеют такого же доступа к деловым и личным данным, которые являются жизненной силой для моделей машинного обучения. Более того, уже есть опасения, что высококачественные источники данных "заканчиваются".'

Более того, свободное использование западными компаниями ИИ потенциально авторских учебных данных вызвало широкий резонанс и иски.

Китайские компании, занимающиеся разработкой искусственного интеллекта, скорее всего, не будут страдать от этой проблемы.

Баланс между доступностью и риском

Когда-то ИИ был уделом только научных кругов и крупных предприятий. Уже через год от четверти до половины взрослых в Великобритании, США и ЕС использовали генеративный ИИ.

Доступность имеет множество преимуществ, включая стимулирование инноваций и снижение входных барьеров для стартапов и индивидуальных разработчиков. Однако это также вызывает опасения по поводу потенциального злоупотребления, связанного с нерегулируемым доступом.

Недавний случай, когда языковая модель Llama-1 компании Meta просочилась в интернет. является примером проблем сдерживания технологий ИИ. Модели ИИ с открытым исходным кодом уже использовались в мошеннических целях и для создания изображения жестокого обращения с детьми.

Компании, занимающиеся разработкой искусственного интеллекта, знают об этомНо в то же время модели с открытым исходным кодом угрожают их конкурентному преимуществу. Meta стала своего рода антагонистом индустрии, выпустив ряд моделей бесплатно, в то время как другие компании, такие как Microsoft, OpenAI и Google, пытаются монетизировать свои продукты ИИ.

Другие модели с открытым исходным кодом, например Falcon 180B LLMИсключительно мощные, но не имеющие защитных ограждений.

Некоторые полагают, что крупные компании, занимающиеся разработкой ИИ, настаивают на регулировании, поскольку это вытесняет с ринга более мелких игроков и сообщество разработчиков с открытым исходным кодом, позволяя им сохранить доминирующее положение в отрасли.

Загадка двойного назначения искусственного интеллекта

Еще один сложный фактор - двойное или множественное применение ИИ.

Те же алгоритмы, которые могут улучшить качество нашей жизни, могут быть использованы в военных целях. Это может быть "ахиллесовой пятой" эвристической структуры Закона ЕС об ИИ - как интерпретировать полезные ИИ, которые могут быть изменены для нанесения вреда?

Регулирование технологий двойного назначения известно своей сложностью. Введение жестких мер контроля может затормозить инновации и экономический рост, когда лишь ничтожное меньшинство будет использовать технологию ИИ не по назначению.

Компании, занимающиеся разработкой искусственного интеллекта, могут обойти обвинения, создав политику, направленную на предотвращение злоупотреблений, но это не помешает людям использовать его. 'побег из тюрьмы', чтобы обмануть модели и заставить их выводить нелегальный материал.

Баланс между экономическими преимуществами ИИ и этическими проблемами

Преимущества ИИ экономически убедительны, особенно в таких отраслях, как здравоохранение, энергетика и производство.

Отчеты McKinsey и PwC прогнозируют, что ИИ будет ежегодно приносить триллионы в мировую экономику, независимо от последствий замены рабочих мест и увольнений.

ИИ можно рассматривать как путь к созданию рабочих мест и росту для стран, испытывающих экономические трудности.

В более широком философском плане ИИ иногда представляется спасителем человечества на фоне таких макропроблем, как бедность, изменение климата и старение населения.

Правительства западных стран, в частности США и Великобритании, склонны стимулировать рост за счет налоговых льгот, финансирования исследований в области ИИ и беззаботного подхода к регулированию.

На такую авантюру США пошли в прошлом, предоставив технологической индустрии возможность саморегулирования, но сможет ли она оправдать себя в дальнейшем?

WНеужели обреченные прогнозы, сравнивающие ИИ с "ядерной войной" и "глобальными пандемиями", отбросят романтизированные представления о потенциале технологии, способной избавить человечество от постоянно возникающих глобальных проблем?

ИИ представляет собой некую двойственность, вызывающую как эвтопические, так и антиутопические видения будущего, в зависимости от того, кого вы слушаете.

RРегулирование такой организации - беспрецедентная задача.

В любом случае, к концу 2024 года мы, скорее всего, будем жить в мире, где ИИ будет почти повсеместно регулироваться, но никто не может ответить на вопрос, насколько отрасль - и сама технология - к тому времени будет развиваться.