Um novo documento de investigação recomenda que os utilizadores da Internet tenham credenciais para provar que são humanos, uma vez que a IA se torna cada vez mais indistinguível das pessoas reais.

O jornal, da autoria de investigadores da OpenAI, Microsoft, MIT, entre outros, surge numa altura em que a "teoria da internet morta" está a tornar-se cada vez mais credível. Esta teoria sugere que a maioria das interações e conteúdos online são gerados por bots.

É descrita como uma teoria da conspiração, mas os autores deste novo artigo parecem convencidos de que pode acontecer, se é que ainda não aconteceu. O documento refere que "os sistemas de IA altamente capazes podem mudar a paisagem: Há um risco substancial de que, sem mais mitigações, a atividade enganosa da IA possa sobrecarregar a Internet".

É cada vez mais difícil distinguir os utilizadores com IA na Internet. A IA pode gerar conteúdo semelhante ao humano que soa perfeitamente conversacional e avatares de aparência humana em forma de imagem ou vídeo.

Os agentes de IA estão a melhorar a sua capacidade de navegar em sítios Web como um utilizador comum, a elaborar planos sofisticados para atingir objectivos e até a resolver CAPTCHAs quando desafiados.

O segundo problema que o documento identifica é a escalabilidade. Os modelos de IA estão a tornar-se mais potentes, mais baratos e cada vez mais disponíveis. A IA tornou o engano em linha por parte de agentes maliciosos fácil de fazer à escala, especialmente se tivermos um modelo de peso aberto.

O documento refere a preocupação dos investigadores: "Preocupa-nos que a Internet esteja inadequadamente preparada para os desafios que uma IA altamente capaz pode colocar".

Credenciais de personalidade

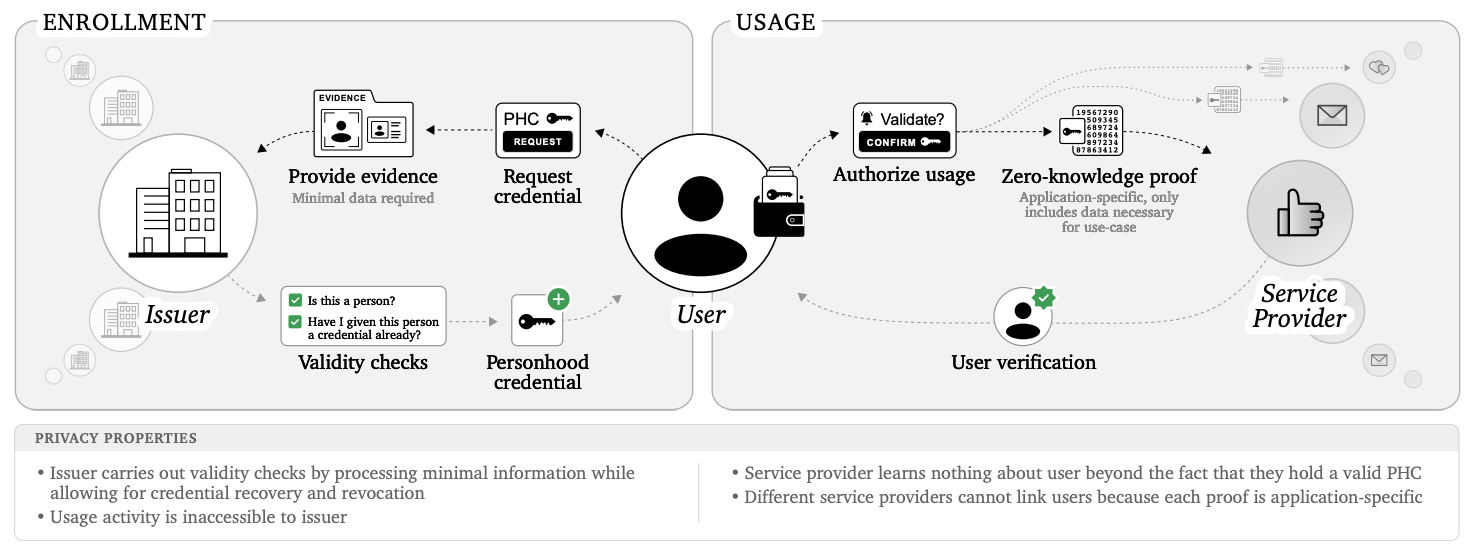

Os investigadores propõem a emissão aos utilizadores da Internet daquilo a que chamam "credenciais de personalidade", ou PHC. Estas credenciais podem ser armazenadas digitalmente nos dispositivos do titular e seriam utilizadas para provar a sua personalidade ao inscrever-se num serviço em linha, como um endereço de correio eletrónico ou uma conta no X.

Várias organizações, governamentais ou não, poderiam servir como emissores das credenciais. Embora o documento não entre em detalhes sobre como isso poderia funcionar, ele sugere uma possível implementação em que uma PHC poderia ser emitida para qualquer detentor de um número de identificação fiscal.

A verificação das credenciais pode ser efectuada utilizando provas de conhecimento zero, de modo a que nenhum aspeto da identidade da pessoa esteja ligado à PHC. A ideia é que se possa provar a um fornecedor de serviços em linha que se é humano, mas mantendo o anonimato.

Se as PHC fossem implementadas, seria possível acabar com o "sockpuppeting", como os milhares de bots que se fazem passar por pessoas na plataforma X e noutras plataformas. A solução proposta também evitaria que um único utilizador criasse várias contas numa plataforma que poderiam depois ser utilizadas em ataques de bots em grande escala.

Riscos e desafios

Se chegámos a um ponto em que precisamos de uma organização que nos emita credenciais que provem que somos humanos, então estamos no território de Blade Runner. A ideia da PHC poderia reduzir o problema dos robots de IA, mas tem outros desafios.

Como é que se garante um acesso equitativo? Se não puder deslocar-se fisicamente a um emissor PHC, poderá ver-se impossibilitado de utilizar a Internet ou, pelo menos, de se registar em contas em linha.

Mesmo que a PHC não revele a sua identidade online, o seu emissor terá essa informação. Até que ponto se sentiria à vontade para dizer o que pensa na Internet se não tivesse a certeza de que o seu anonimato seria preservado?

Suponhamos que um emissor da CPA não é um governo democraticamente eleito com controlos sobre os seus poderes e responsabilidade. Poderá esse governo decidir recusar uma CPA a alguém que o critique?

Os investigadores reconhecem que um "sistema PHC, como qualquer sistema digital, é vulnerável a ataques e explorações por parte de múltiplos actores - sobretudo, subversão pelo próprio emissor, por fornecedores de serviços e por utilizadores com intenções maliciosas".

Ainda não há muito tempo, pensávamos que os CAPTCHAs, as selfies ou uma videochamada eram suficientes para provar que um ser humano real estava do outro lado de uma interação em linha. A IA pôs fim a isso.

Precisamos de uma solução melhor, mas pedir a uma organização uma "prova de personalidade" parece muito orwelliano.