Um grupo de cientistas de renome lançou uma iniciativa voluntária que define um conjunto de valores, princípios e compromissos para a conceção de proteínas de IA.

O carta discute a potencial utilização indevida de ferramentas de IA capazes de conceber novas proteínas com uma rapidez e eficiência sem precedentes.

Embora a IA seja muito promissora para enfrentar desafios globais prementes, desde a resposta a pandemias até às soluções energéticas sustentáveis, também levanta questões sobre a possibilidade de utilização maliciosa, como a criação de novas armas biológicas.

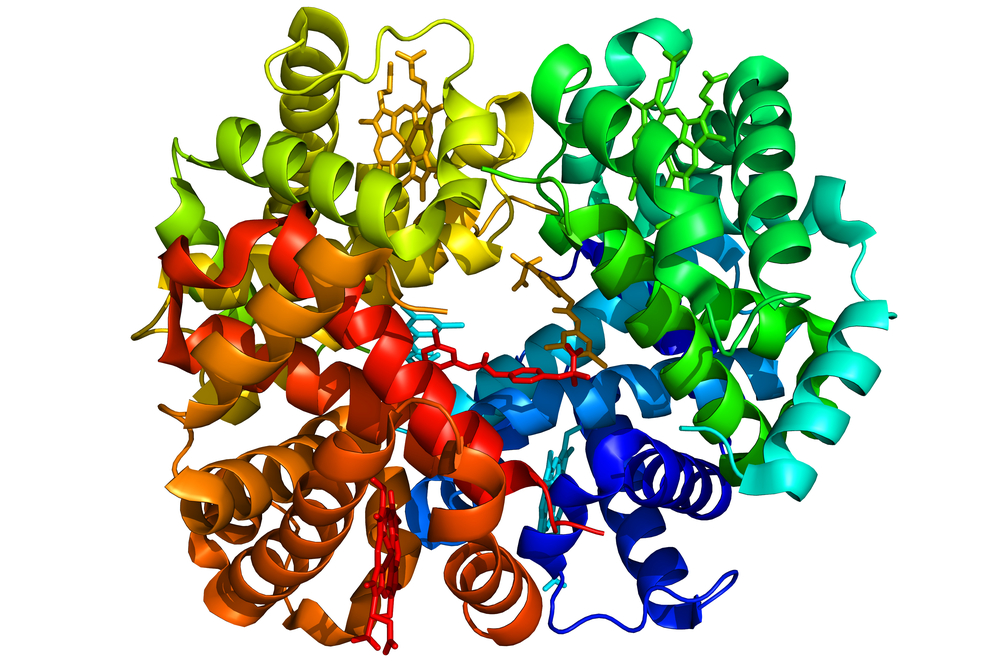

Enquanto as proteínas concebidas pelo sistema AlphaFold da DeepMind e mais tarde pelos investigadores da Faculdade de Medicina da Universidade de Washington demonstraram uma elevada afinidade e especificidade para os seus alvos pretendidos, existe sempre a possibilidade de estas proteínas poderem interagir com outras moléculas do organismo de formas inesperadas.

Isto pode levar a efeitos secundários adversos ou mesmo ao desenvolvimento de novas doenças.

Outro risco é a possibilidade de utilização indevida ou maliciosa desta tecnologia. Tal como as proteínas concebidas por IA podem ser utilizadas para criar terapias altamente direccionadas, também podem ser concebidas para causar danos.

Por exemplo, um agente malicioso pode conceber uma proteína que vise um grupo étnico específico ou que explore uma determinada vulnerabilidade genética.

Como refere David Baker, biofísico computacional da Universidade de Washington e figura-chave por detrás da iniciativa, "a questão era: como, se de alguma forma, a conceção de proteínas deve ser regulada e quais são os perigos, se é que existem?"

Os mais de 100 signatários acreditam que "os benefícios das actuais tecnologias de IA para conceção de proteínas superam de longe o potencial de danos", mas reconhecem a necessidade de uma abordagem proactiva da gestão dos riscos à medida que a tecnologia avança.

A IA para a biologia tem potencial para ajudar a resolver alguns dos problemas mais importantes que a nossa sociedade enfrenta. A abertura científica será fundamental para o progresso do nosso domínio. Enquanto cientistas empenhados neste trabalho, com mais de 90 signatários em todo o mundo, estamos a desenvolver um quadro... pic.twitter.com/4m81j87Vo9

- Alex Rives (@alexrives) 8 de março de 2024

A carta afirma que "tendo em conta os avanços previstos neste domínio, poderá ser necessária uma nova abordagem proactiva de gestão do risco para atenuar o potencial de desenvolvimento de tecnologias de IA que possam ser utilizadas indevidamente, intencionalmente ou não, para causar danos".

Assinado.

Uma boa ideia para a segurança na conceção de proteínas (com IA ou não): regular e controlar as máquinas de síntese de proteínas e o firmware, não a investigação em IA em si.

Esta é uma ideia que promovi na Cimeira de Segurança da IA do Reino Unido. https://t.co/skcUUcgG5a- Yann LeCun (@ylecun) 8 de março de 2024

No âmbito do iniciativaNo âmbito do projeto de investigação da IA, os investigadores articularam um conjunto de valores e princípios para orientar o desenvolvimento responsável das tecnologias de IA na conceção de proteínas.

Estes incluem "a segurança, a equidade, a colaboração internacional, a abertura, a responsabilidade e a prossecução da investigação em benefício da sociedade". Os signatários também concordaram voluntariamente com um conjunto de compromissos específicos e accionáveis baseados nestes valores e princípios.

Um aspeto fundamental da iniciativa centra-se na melhoria do rastreio da síntese de ADN, uma etapa crucial na tradução de proteínas concebidas por IA em moléculas físicas.

Os cientistas comprometem-se a "obter serviços de síntese de ADN apenas de fornecedores que demonstrem a adesão a práticas de rastreio de biossegurança padrão da indústria, que procuram detetar biomoléculas perigosas antes de poderem ser fabricadas".

Os avanços da IA no domínio da medicina e da biotecnologia têm sido incríveis, conduzindo a novos antibióticos e medicamentos anti-envelhecimento.

Para fazer avançar estas conclusões, os signatários comprometem-se a "trabalhar em colaboração com as partes interessadas de todo o mundo" e a "abster-se de investigação suscetível de conduzir a danos globais ou de permitir a utilização indevida das nossas tecnologias".