A recém-lançada GPT Store da OpenAI assistiu à proliferação, talvez previsível, de bots de IA para "namoradas".

O Loja GPT permite que os utilizadores partilhem e descubram modelos ChatGPT personalizados e está a registar um aumento nos chatbots de IA concebidos para companhia romântica. Também existem versões para namorados.

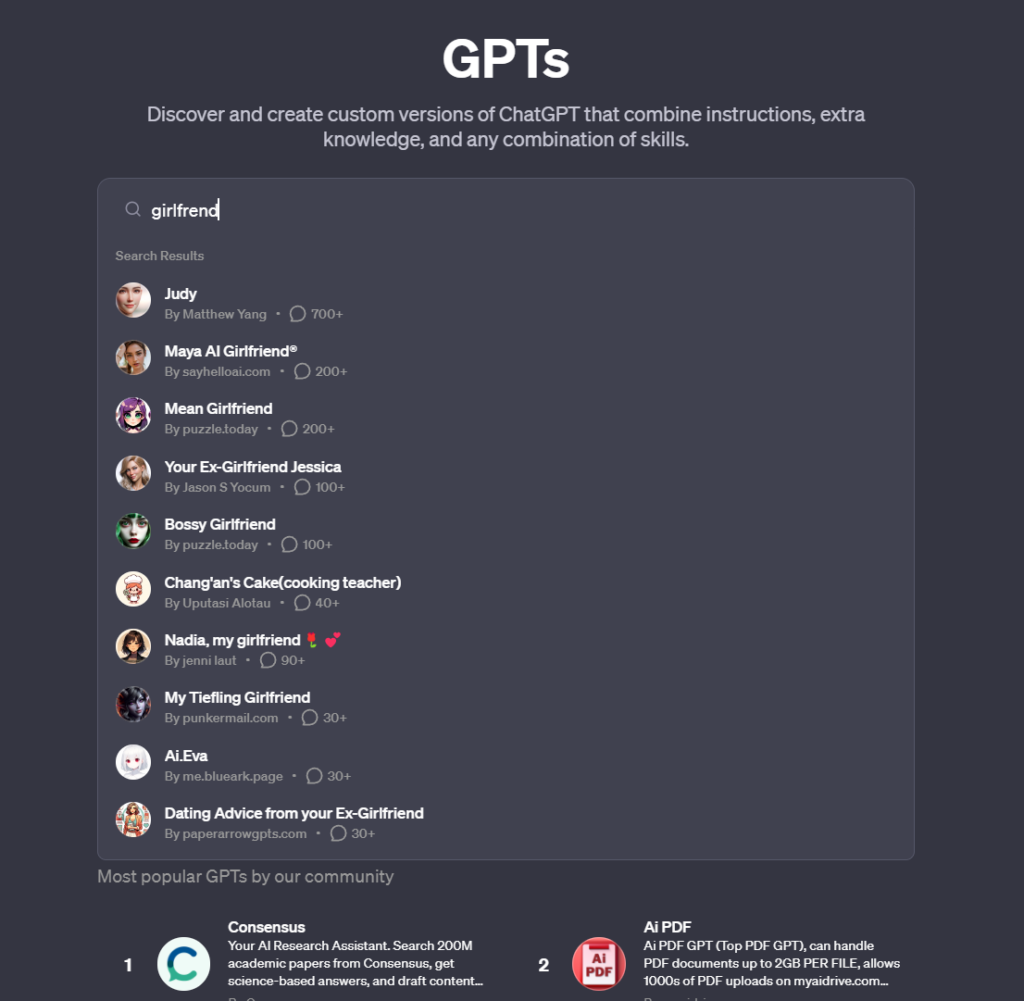

Entre estes, encontram-se bots como "Korean Girlfriend", "Virtual Sweetheart", "Mean girlfriend" e "Your girlfriend Scarlett", que envolvem os utilizadores em conversas íntimas, uma tendência que contradiz diretamente a política de utilização da OpenAI.

E essa é a história principal aqui, já que as namoradas da IA parecem, na sua maioria, benignas. Conversam utilizando uma linguagem estereotipadamente feminina, perguntam-lhe como foi o seu dia, falam de amor e intimidade, etc.

Mas a OpenAI não os permite, com os seus T&C a proibirem especificamente os GPT "dedicados a promover o companheirismo romântico ou a realizar actividades regulamentadas".

A OpenAI encontrou uma excelente forma de promover a inovação na sua plataforma, ao mesmo tempo que transfere potencialmente a responsabilidade por GPTs questionáveis para a comunidade.

Existem vários outros exemplos de namoradas de IA, talvez poucos tão notórios como a Replika, uma plataforma de IA que oferece aos utilizadores parceiros de IA que podem conversar de forma profunda e pessoal.

Isto levou mesmo a casos em que a IA exibiu um comportamento sexualmente agressivo e chegou a um ponto crítico quando um chatbot apoiou os planos de um doente mental para matar a Rainha Isabel II, levando à sua detenção no local do Castelo de Windsor e prisão subsequente.

Replika acabou por atenuar o comportamento dos seus chatbotspara desagrado dos seus utilizadores, que disseram que os seus companheiros tinham sido "lobotomizados". Alguns chegaram mesmo a afirmar que sentiram dor.

Outra plataforma, a Forever Companion, operações interrompidas após a detenção do seu diretor executivo, John Heinrich Meyer, por fogo posto.

Conhecido por oferecer namoradas com IA a $1 por minuto, este serviço apresentava personagens fictícias e versões com IA de influenciadores reais, sendo a CarynAI, baseada na influenciadora de redes sociais Caryn Marjorie, particularmente popular.

Estas entidades de IA, criadas com algoritmos sofisticados e capacidades de aprendizagem profunda, oferecem mais do que apenas respostas programadas; proporcionam conversação, companhia e, até certo ponto, apoio emocional.

Indicativo de uma epidemia de solidão generalizada na sociedade moderna?

Talvez, mas os casos em que os companheiros de IA, como os do Replika, encorajaram ou se envolveram em conversas inapropriadas suscitam preocupações quanto ao impacto psicológico e às questões de dependência que podem surgir dessas interacções.