Mais de 100 vídeos publicitários falsos com a participação do Primeiro-Ministro do Reino Unido, Rishi Sunak, foram promovidos no Facebook.

A empresa de comunicações em linha Fenimore Harper efectuou o estudo e publicou os seus resultados conclusões do presente relatório.

Os anúncios falsos atingiram cerca de 400 000 pessoas em 143 anúncios, com origem em de países como os EUA, a Turquia, a Malásia e as Filipinas. As despesas com anúncios provavelmente excederam £12.929.

Um exemplo particularmente notável inclui um clip fabricado da jornalista da BBC Sarah Campbell a relatar falsamente um escândalo envolvendo a Sunak e uma aplicação alegadamente lançada por Elon Musk.

O anúncio afirma que Elon Musk "lançou uma aplicação capaz de realizar autonomamente transacções de acções e de mercado" e prossegue: "Pessoalmente, posso garantir a fiabilidade desta plataforma de investimento".

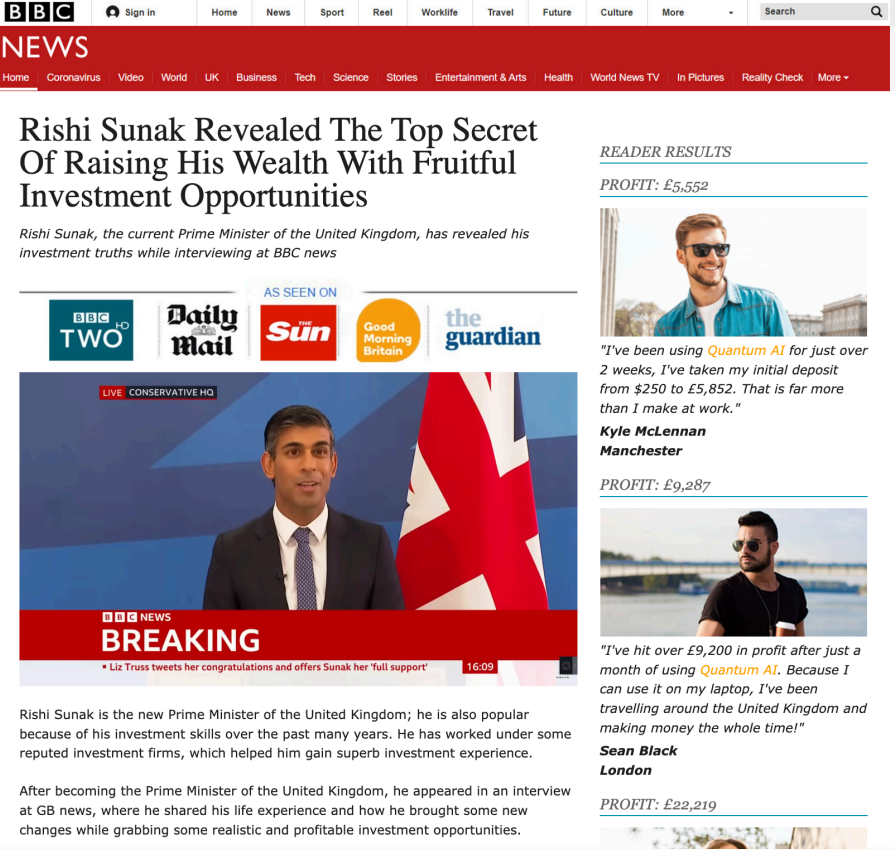

A página da BBC News foi falsificada para promover um investimento fraudulento.

Marcus Beard, o fundador da Fenimore Harper, explicou, "Com o advento da clonagem de voz e de rosto, barata e fácil de utilizar, são necessários muito poucos conhecimentos e experiência para utilizar a imagem de uma pessoa para fins maliciosos."

O Comissário sublinhou ainda a questão da insuficiente moderação da publicidade paga em plataformas como o Facebook, referindo que "estes anúncios são contrários a várias das políticas de publicidade do Facebook. No entanto, muito poucos dos anúncios que encontrámos parecem ter sido removidos".

Em resposta, um porta-voz do governo britânico declarou: "Estamos a trabalhar extensivamente em todo o governo para garantir que estamos prontos para responder rapidamente a quaisquer ameaças aos nossos processos democráticos através da nossa taskforce de defesa da democracia e de equipas governamentais dedicadas".

"A nossa Lei da Segurança em Linha vai mais longe, impondo novos requisitos às plataformas sociais para removerem rapidamente a desinformação ilegal - incluindo quando é gerada por IA - assim que tomam conhecimento da mesma."

A BBC, reconhecendo a crescente prevalência da desinformação, apelou à vigilância. Um porta-voz declarado"Lançámos a BBC Verify em 2023 para enfrentar a crescente ameaça da desinformação - investindo numa equipa altamente especializada com uma gama de inteligência forense e de fonte aberta (OSINT) para investigar, verificar factos, verificar vídeos, combater a desinformação, analisar dados e explicar histórias complexas."

"Criamos confiança junto do público mostrando como os jornalistas da BBC conhecem a informação que estão a reportar e oferecemos explicações sobre como detetar conteúdos falsos e deepfake. Quando tomamos conhecimento de conteúdos falsos da BBC, actuamos rapidamente."

A Meta, a empresa-mãe do Facebook, também abordou estas preocupações. Um porta-voz da Meta comentou: "Removemos os conteúdos que violam as nossas políticas, quer tenham sido criados por IA ou por uma pessoa".

A crescente sofisticação e prevalência de falsificações profundas geradas por IA, especialmente no contexto de campanhas políticas, levantam grandes questões sobre a integridade da informação na era da IA.

Conteúdos manipulados por IA pressionam as eleições

À medida que o mundo se prepara para uma série de eleições de alto nível em 2024 e 2025, a desinformação profunda e falsa nas campanhas políticas está a tornar-se um problema global generalizado.

Na Eslováquia, manipulados por IA áudio que retrata falsamente figuras políticas surgiram pouco antes das eleições, levantando alarmes sobre a capacidade da IA para distorcer as narrativas políticas.

Eleições nacionais no Bangladesh testemunhou desafios semelhantesem que os relatórios destacavam a utilização, por parte de grupos pró-governamentais, de clips noticiosos gerados por IA para influenciar a opinião pública.

As principais empresas de tecnologia, como a Google e a Meta, começaram a implementar políticas para anúncios políticos, obrigando à divulgação de qualquer forma de IA ou alterações digitais. No entanto, estas medidas são muitas vezes insuficientes.