Entrámos, de facto, numa era em que não se pode confiar no que se vê na Internet.

Embora esta afirmação tenha sido parcialmente verdadeira durante décadas, a IA elevou a manipulação de conteúdos a novos níveis, ultrapassando maciçamente a consciencialização do público.

A tecnologia de IA deep fake pode criar e alterar imagens, vídeos e gravações áudio, colocando palavras na boca de figuras públicas ou fazendo-as aparecer em situações que nunca ocorreram.

Em muitos casos, é preciso mais do que um segundo olhar para determinar a autenticidade do conteúdo, e os meios falsos podem acumular milhões de impressões antes de serem identificados.

Estamos agora a assistir a falsificações profundas que podem potencialmente interromper os processos democráticos, embora seja demasiado cedo para medir os impactos tangíveis no comportamento de voto.

Vamos examinar alguns dos mais notáveis incidentes políticos de IA deep fake a que assistimos até à data.

Joe Biden Incidente em New Hampshire

janeiro de 2024, A New Hampshire, EUA, a chamada automática a imitar a voz de Biden encorajou os eleitores a "guardarem o vosso voto para as eleições de novembro", sugerindo erradamente que a participação nas primárias iria inadvertidamente beneficiar Donald Trump.

A mensagem foi atribuída a Kathy Sullivan, um número de telemóvel pessoal de um antigo presidente do Partido Democrata. Sullivan condenou o ato como uma forma flagrante de interferência eleitoral e de assédio pessoal.

O gabinete do Procurador-Geral de New Hampshire afirmou que se tratava de um esforço ilegal para perturbar as primárias presidenciais e suprimir a afluência às urnas.

O áudio fabricado foi identificado como tendo sido gerado usando o ElevenLabs, um líder da indústria em síntese de fala.

Mais tarde, a ElevenLabs suspendeu o responsável pela voz falsa de Biden e afirmou: "Estamos empenhados em evitar a utilização indevida de ferramentas de IA áudio e levamos extremamente a sério quaisquer incidentes de utilização indevida."

Chanceler alemão Olaf Scholz: incidente falso profundo

Em novembro de 2023, a Alemanha assistiu a uma falsa falsificação da IA que mostrava o Chanceler Olaf Scholz a apoiar a proibição do partido de extrema-direita Alternativa para a Alemanha (AfD).

Este vídeo profundamente falso fazia parte de uma campanha de um grupo de arte-ativismo, o Centro de Beleza Política (CPB)e tem como objetivo chamar a atenção para a influência crescente do AfD. As críticas ao AfD são feitas à luz da história alemã dos anos 30 do século passado.

Dirigido pelo filósofo e artista Philipp Ruch, o grupo CPB tem como objetivo criar "poesia política" e "beleza moral", abordando questões fundamentais da atualidade, como as violações dos direitos humanos, a ditadura e o genocídio.

O CPB envolveu-se em numerosos projectos controversos, como o Instalação "Search for Us" junto ao BundestagO projeto de lei, que alegadamente continha terra de antigos campos de extermínio e restos mortais de vítimas do Holocausto.

Embora o apoio ao AfD tenha crescido, numerosos protestos em toda a Alemanha demonstram uma forte oposição às ideologias do AfD.

Um porta-voz do grupo que está por detrás do deep fake declarou: "Aos nossos olhos, o extremismo de direita na Alemanha que se senta no parlamento é mais perigoso".

Os responsáveis do AfD consideraram a campanha "deep fake" uma tática enganosa destinada a desacreditar o partido e a influenciar a opinião pública.

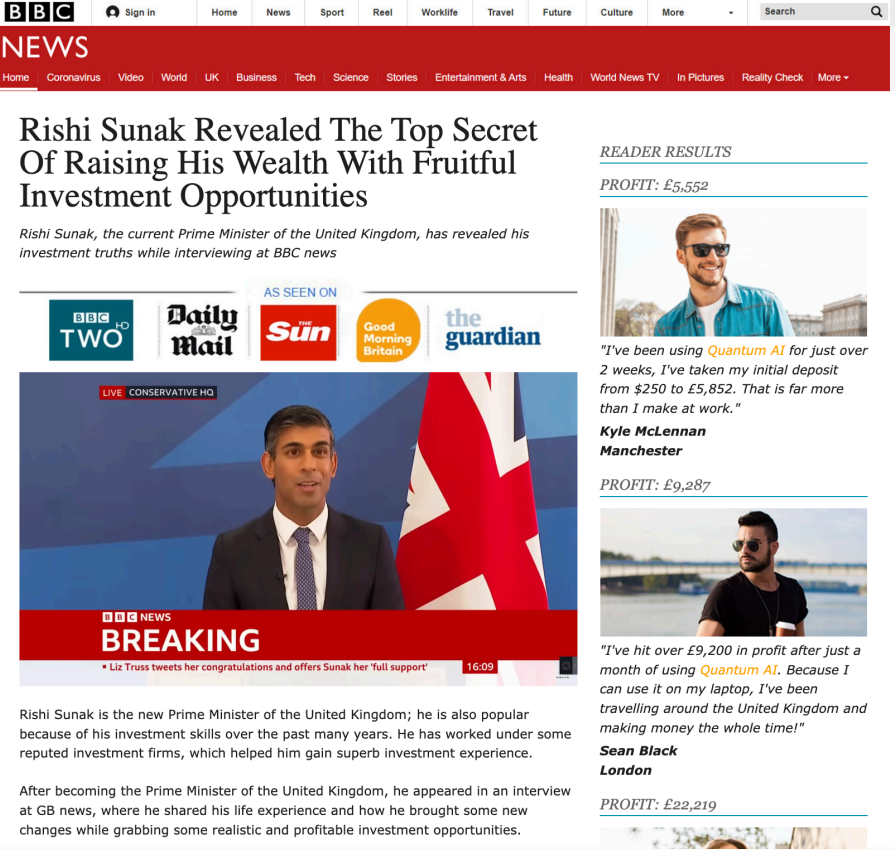

Primeiro-ministro do Reino Unido, Rishi Sunak, implicado em fraudes

Em janeiro de 2024, uma empresa de investigação do Reino Unido descobriu que o PM Rishi Sunak estava envolvido em mais de 100 anúncios de vídeo enganosos divulgados principalmente no Facebook, atingindo cerca de 400 000 pessoas.

Estes anúncios, originários de vários países, incluindo os EUA, a Turquia, a Malásia e as Filipinas, promoviam esquemas de investimento fraudulentos falsamente associados a figuras de alto nível como Elon Musk.

O estudo, realizado pela empresa de comunicação em linha empresa Fenimore HarperO relatório da Comissão Europeia sobre o conteúdo das redes sociais, que foi publicado em fevereiro de 2009, sublinhou que as empresas de redes sociais não estão a responder a este tipo de conteúdo num prazo razoável.

Marcus Beard, o fundador da Fenimore Harper, explicou como a IA democratiza a desinformação: "Com o advento da clonagem de voz e rosto barata e fácil de usar, é preciso muito pouco conhecimento e experiência para usar a semelhança de uma pessoa para fins maliciosos".

Beard também criticou a inadequação da moderação de conteúdos nas redes sociais, referindo que "estes anúncios são contrários a várias das políticas de publicidade do Facebook. No entanto, muito poucos dos anúncios que encontrámos parecem ter sido removidos".

O governo do Reino Unido reagiu ao risco de falsificações profundas fraudulentas: "Estamos a trabalhar extensivamente em todo o governo para garantir que estamos prontos para responder rapidamente a quaisquer ameaças aos nossos processos democráticos através do nosso grupo de trabalho para a defesa da democracia e de equipas governamentais específicas".

O primeiro-ministro paquistanês Imran Khan aparece num comício virtual

Em dezembro de 2023, o antigo Primeiro-Ministro do Paquistão, Imran Khan, atualmente preso sob a acusação de fuga de segredos de Estado, apareceu num comício virtual utilizando a IA.

Apesar de estar atrás das grades, o avatar digital de Khan foi visto por milhões de pessoas de forma notável. O comício continha imagens de discursos anteriores do seu partido político, o Pakistan Tehreek-e-Insaaf (PTI).

O discurso de quatro minutos de Khan falou de resistência e desafio contra a repressão política enfrentada pelos membros do PTI.

A voz da IA articulou-se: "O nosso partido não está autorizado a realizar comícios públicos. O nosso povo está a ser raptado e as suas famílias estão a ser assediadas", continuando: "A história recordará os vossos sacrifícios".

Para confundir a situação, o governo paquistanês terá tentado bloquear o acesso à manifestação.

A NetBlocks, uma organização de monitorização da Internet, declarou: "As métricas mostram que as principais plataformas dos meios de comunicação social foram restringidas no Paquistão durante [quase] 7 horas no domingo à noite, durante uma reunião política em linha; o incidente é consistente com casos anteriores de censura da Internet dirigida ao líder da oposição Imran Khan e ao seu partido PTI".

ℹ️ ICYMI: Os dados mostram que as principais plataformas de redes sociais foram restringidas em #Paquistão durante cerca de 7 horas no domingo à noite, durante uma reunião política em linha; o incidente é coerente com anteriores casos de censura da Internet dirigida ao líder da oposição Imran Khan e ao seu partido PTI https://t.co/AS9SdfwqoH pic.twitter.com/XXMYBhknXd

- NetBlocks (@netblocks) 18 de dezembro de 2023

Usama Khilji, defensor da liberdade de expressão no Paquistão, comentou: "Com uma repressão total do direito do PTI à liberdade de associação e de expressão através da detenção de dirigentes, a utilização de inteligência artificial pelo partido para transmitir um discurso virtual nas palavras do seu presidente encarcerado e antigo primeiro-ministro Imran Khan marca um novo ponto na utilização da tecnologia na política paquistanesa".

Áudio falso do ex-presidente do Sudão, Omar al-Bashir, no TikTok

Uma campanha baseada em IA no TikTok explorou a voz de antigo presidente do Sudão, Omar al-Bashir no meio da atual turbulência civil no país.

Desde o final de agosto de 2023, uma conta anónima publicou o que afirma ser "gravações com fuga de informação" de al-Bashir. No entanto, os analistas determinaram que as gravações eram falsificações geradas por IA.

al-Bashir" tem estado ausente dos olhos do público desde que foi expulso do país em 2019 devido a graves alegações de crimes de guerra.

A fraude áudio do dia das eleições na Eslováquia

No dia das eleições na Eslováquia, um áudio polémico apresentava falsificações profundas de Michal Šimečka, líder do partido Eslováquia Progressista, e da jornalista Monika Tódová a discutir práticas corruptas como a compra de votos.

O caso veio à tona durante o apagão mediático pré-eleitoral da Eslováquia, pelo que os indivíduos implicados não puderam facilmente refutar publicamente o seu envolvimento antes do período pós-eleitoral.

Ambas as partes implicadas denunciaram posteriormente a gravação como uma falsificação profundao que foi confirmado por uma agência de verificação de factos.

O falso profundo de Volodymyr Zelenskiy

Em 2023, um vídeo profundamente falso do Presidente ucraniano Volodymyr Zelenskiy, que sugeria de forma amadora que ele estava a apelar aos soldados para abandonarem os seus postos, foi rapidamente identificado como falso e removido pelas principais plataformas de redes sociais.

Eleições turcas: um falso drama

No período que antecedeu as eleições legislativas e presidenciais na Turquia, foi difundido em linha um vídeo que mostrava falsamente o principal adversário do Presidente Recep Tayyip Erdoğan, Kemal Kılıçdaroğlu, a receber apoio do PKK.

Donald Trump deep fakes

No início de 2023, assistimos a falsificações profundas e realistas de Donald Trump a ser preso e a um vídeo de campanha de Ron DeSantis com imagens geradas por IA de Trump a abraçar Anthony Fauci.

Partido político belga usa Trump como um "deep fake

Um incidente anterior, em 2018, na Bélgica, causou agitação política quando um vídeo profundamente falso criado por um partido político provocou um protesto público.

O vídeo mostrava falsamente o Presidente Donald Trump a aconselhar a Bélgica a retirar-se do Acordo de Paris sobre o clima.

O vídeo fazia parte de uma falsificação de alta tecnologia, que foi posteriormente reconhecida pela equipa de comunicação social do partido. Demonstrou como as falsificações podem ser utilizadas para fabricar declarações de líderes mundiais com o objetivo de influenciar a opinião pública e a política.

Falsificação profunda de Nancy Pelosi

Um vídeo manipulado de Nancy Pelosi em 2020, feito para parecer que ela estava a falar mal e embriagada, espalhou-se rapidamente nas redes sociais.

Este facto demonstrou o potencial das falsificações profundas para desacreditar e embaraçar figuras públicas, que muitas vezes persiste depois de o conteúdo ser considerado falso.

Deepfake áudio de Keir Starmer

Outro incidente na política britânica envolveu um clip áudio que alegadamente captava o líder da oposição, Sir Keir Starmer, a praguejar com os seus funcionários.

O clip, que circulou amplamente nas redes sociais, foi mais tarde revelado como sendo um deep fake gerado por IA.

À medida que as empresas tecnológicas exploram formas de combater as falsificações profundas à escala, os modelos de IA utilizados para criar meios de comunicação falsos tornar-se-ão cada vez mais sofisticados e fáceis de utilizar.

O caminho a percorrer exige um esforço de colaboração entre tecnólogos, decisores políticos e o público em geral para aproveitar os benefícios da IA, salvaguardando simultaneamente os pilares de confiança e integridade da nossa sociedade.

A confiança na política e nas instituições públicas já é frágil, para dizer o mínimo. As falsificações profundas vão miná-la ainda mais.