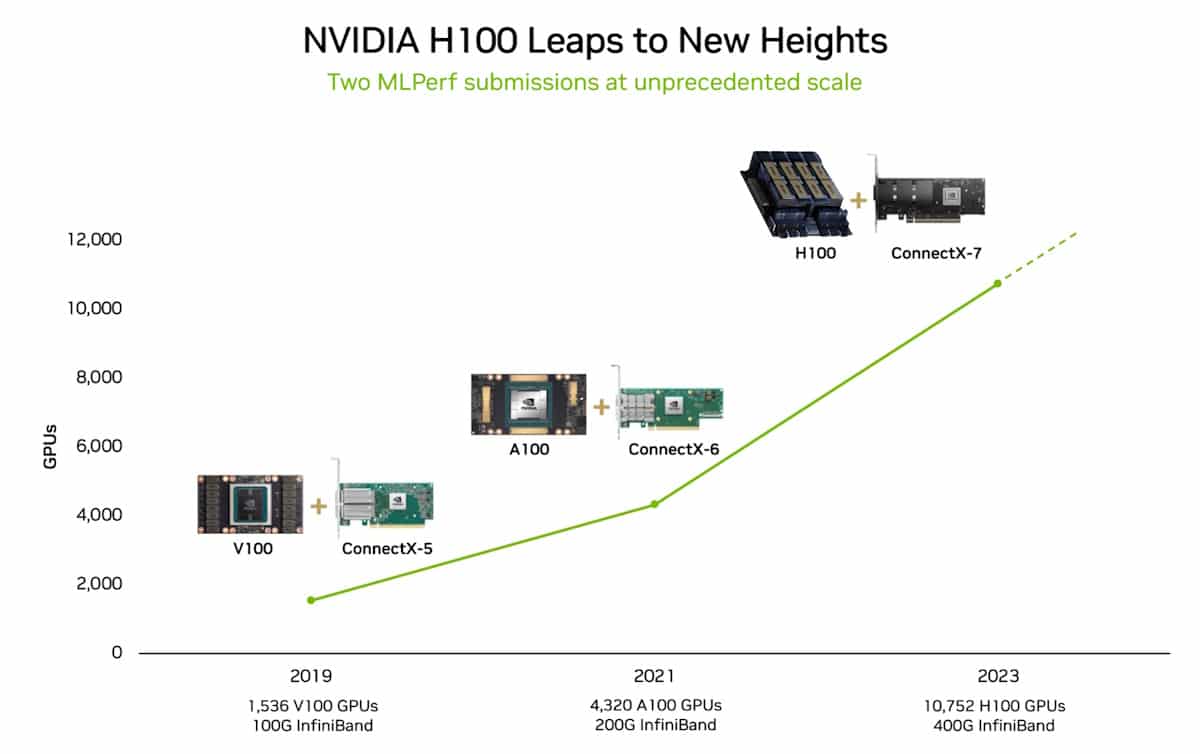

A Nvidia dimensionou e optimizou o seu supercomputador Eos AI para estabelecer novos recordes de benchmark de formação MLPerf AI.

Quando a Nvidia ligou o seu supercomputador de IA Eos em maio, 10.752 GPUs NVIDIA H100 Tensor Core ganharam vida e acabaram de ser submetidas a alguns testes reais.

Este poder de processamento sem precedentes, juntamente com as novas optimizações de software, permitiu à Eos impulsionar o MLPerf referência em território recorde.

O benchmark MLPerf de código aberto é um conjunto de testes de formação e inferência concebido para medir o desempenho de cargas de trabalho de aprendizagem automática em conjuntos de dados do mundo real.

Um dos resultados de destaque foi o facto de o Eos ter conseguido treinar um modelo GPT-3 com 175 mil milhões de parâmetros em mil milhões de fichas em apenas 3,9 minutos.

Quando a Nvidia estabeleceu o recorde neste parâmetro de comparação há menos de 6 meses, demorou quase 3 vezes mais tempo, com um tempo de 10,9 minutos.

A Nvidia também conseguiu atingir uma taxa de eficiência de 93% durante os testes, o que significa que utilizou quase todo o poder de computação teoricamente disponível no Eos.

O Microsoft Azure, que utiliza praticamente a mesma configuração H100 que o Eos na sua máquina virtual ND H100 v5, ficou a 2% dos resultados dos testes da Nvidia nos seus testes MLPerf.

Em 2018, Jensen Huang, CEO da Nvidia, afirmou que o desempenho das GPUs mais do que duplicará a cada dois anos. Essa afirmação foi cunhada como Lei de Haung e provou ser verdadeira, pois deixa A Lei de Moore está a desaparecer no espelho retrovisor da computação.

E depois?

O teste de treino de referência MLPerf que a Nvidia realizou utiliza apenas uma parte do conjunto de dados completo em que o GPT-3 foi treinado. Se pegarmos no tempo que o Eos estabeleceu no teste MLPerf e extrapolarmos para o conjunto de dados GPT-3 completo, então poderia treinar o modelo completo em apenas 8 dias.

Se tentasse fazer isso utilizando o seu anterior sistema de última geração, composto por 512 GPUs A100, demoraria cerca de 170 dias.

Se estivesse a treinar um novo modelo de IA, consegue imaginar a diferença no tempo de colocação no mercado e no custo que representam 8 dias versus 170 dias?

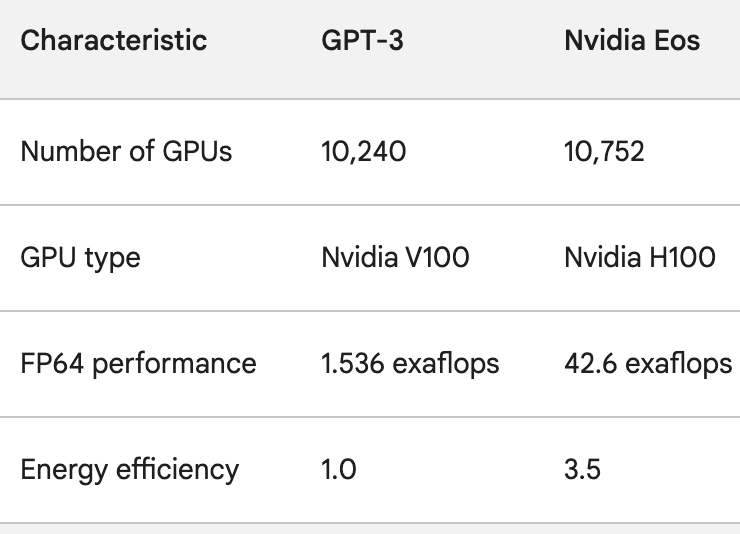

As GPUs H100 não só são muito mais potentes do que as GPUs A100, como também são até 3,5 vezes mais eficientes em termos energéticos. Utilização de energia e A pegada de carbono da IA são questões reais que precisam de ser resolvidas.

Para ter uma ideia da rapidez com que o processamento de IA está a melhorar, pense no ChatGPT, que foi lançado há pouco menos de um ano. O modelo subjacente, GPT-3, foi treinado em 10.240 GPUs Nvidia V100.

Menos de um ano depois, o Eos tem 28 vezes mais capacidade de processamento do que essa configuração, com uma melhoria de 3,5 vezes na eficiência.

Quando Sam Altman, da OpenAI, concluiu o recente DevDay, disse que os projectos em que a OpenAI estava a trabalhar fariam com que os seus últimos lançamentos parecessem estranhos.

Considerando o salto no poder de processamento que empresas como a Nvidia estão a conseguir, a afirmação de Altman resume provavelmente o futuro da indústria da IA como um todo.