Investigadores das universidades britânicas Durham University, University of Surrey e Royal Holloway University of London desenvolveram uma técnica inovadora apoiada por IA para extrair as teclas premidas de gravações acústicas.

O estudo desenvolveu uma técnica para ler com êxito as teclas premidas nos teclados utilizando gravações áudio.

Esta técnica pode permitir que os piratas informáticos analisem as teclas premidas, controlando o microfone de um dispositivo e recolhendo informações pessoais, como palavras-passe, conversas privadas, mensagens e outros dados sensíveis.

Os toques nas teclas são gravados através de um microfone e processados e analisados por um modelo de aprendizagem automática (ML) que determina o seu espaçamento e posicionamento no teclado.

O modelo consegue identificar toques de tecla individuais com uma taxa de precisão chocante de 95% quando os toques são gravados através de um microfone de telefone próximo. A precisão da previsão diminuiu para 93% quando as gravações efectuadas através do Zoom foram utilizadas para treinar o algoritmo de classificação do som.

Os ataques de pirataria acústica tornaram-se cada vez mais sofisticados devido à disponibilidade generalizada de dispositivos equipados com microfones que podem captar áudio de alta qualidade.

Como é que o modelo funciona?

O ataque começa por registar as teclas premidas no teclado do alvo. Estes dados são cruciais para treinar o algoritmo de previsão.

Esta gravação pode ser efectuada utilizando um microfone próximo ou o telemóvel infetado com malware do alvo com acesso ao seu microfone.

Em alternativa, um participante desonesto numa chamada Zoom poderia correlacionar as mensagens digitadas pelo alvo com a sua gravação de som. Também podem existir formas de piratear o microfone do computador utilizando malware ou vulnerabilidades de software.

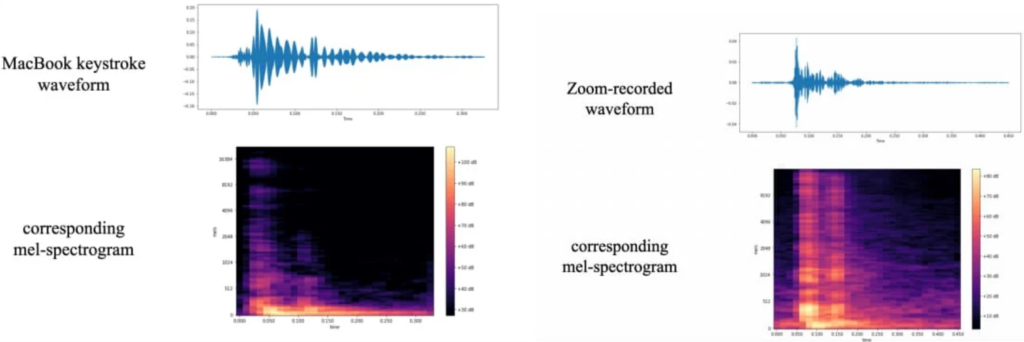

Os investigadores recolheram dados de treino premindo 25 vezes cada uma das 36 teclas de um MacBook Pro moderno, gravando o som gerado por cada premir de tecla. As formas de onda e os espectrogramas foram produzidos a partir destas gravações, visualizando variações identificáveis para cada tecla.

Foi efectuado um processamento de dados adicional para melhorar os sinais utilizados para identificar as teclas premidas.

Estas imagens de espectrogramas foram utilizadas para treinar o "CoAtNet", um classificador de imagens que atribui diferentes espectrogramas de áudio a diferentes toques nas teclas.

Nos seus testes, os investigadores utilizaram um computador portátil com um teclado semelhante ao dos computadores portáteis mais recentes da Apple. Os microfones e métodos de gravação incluíram um iPhone 13 Mini colocado a 17 cm de distância do alvo, Zoom e Skype.

O classificador CoANet demonstrou uma precisão de 95% a partir de gravações de smartphones e de 93% a partir de gravações captadas através do Zoom. Também foram testadas as teclas gravadas através do Skype, o que produziu uma precisão de 91,7%.

O documento de investigação sugere a alteração dos estilos de escrita ou a utilização de palavras-passe aleatórias para evitar tais ataques, mas isso está longe de ser prático.

Outras potenciais medidas defensivas incluem a utilização de software para reproduzir sons de teclas, ruído branco ou filtros de áudio de teclas baseados em software. No entanto, o estudo concluiu que mesmo um teclado silencioso pode ser analisado com êxito para detetar as teclas premidas.

Este é outro exemplo inovador de como a aprendizagem automática pode permitir técnicas sofisticadas de fraude. A estudo recente descobriram que vozes falsas e profundas podiam enganar até 25% de pessoas.

Os ataques de áudio podem ser dirigidos a indivíduos de alto nível, como políticos e directores executivos, para roubar informações sensíveis ou lançar ataques de ransomware com base em conversas roubadas.