O crescimento exponencial dos sistemas de IA está a ultrapassar a investigação e a regulamentação, deixando os governos numa posição difícil para equilibrar as vantagens e os riscos.

As leis levam anos a desenvolver-se e a tornar-se juridicamente vinculativas. A IA evolui numa base semanal.

É esta a dicotomia com que se defrontam os líderes e políticos da IA, com a primeira peça de regulamentação significativa da IA no Ocidente, a Lei da IA da UE, prevista para 2026. Ainda há um ano, o ChatGPT era apenas um sussurro.

Altos funcionários dos EUA e da UE reuniram-se no Conselho de Comércio e Tecnologia (TTC) EUA-UE em 31 de maio em Luleå, na Suécia. Margrethe Vestager, Comissária Europeia para o Digital, que se reuniu com Sundar Pichai, Diretor Executivo da Google, na semana anterior para discutir um potencial "Pacto para a IA", afirmou: "A democracia tem de mostrar que somos tão rápidos como a tecnologia".

As autoridades reconhecem a enorme diferença entre o ritmo da tecnologia e o ritmo da legislação. Referindo-se à IA generativa como o ChatGPT, Gina Raimondo, a secretária do Comércio dos EUA, disse: "Está a chegar a um ritmo como nenhuma outra tecnologia".

Quais foram os resultados da reunião do TTC?

Marca de água, auditorias externas, ciclos de feedback - apenas algumas das ideias debatidas com @AnthropicAI e @sama @OpenAI para o #AI #Código de Conduta lançado hoje na #TTC em #Luleå @SecRaimondo Aguardamos com expetativa o debate com parceiros internacionais. pic.twitter.com/wV08KDNs3h

- Margrethe Vestager (@vestager) 31 de maio de 2023

Os participantes debateram sobretudo quadros não vinculativos ou voluntários em matéria de risco e transparência, que serão apresentados ao G7 no outono.

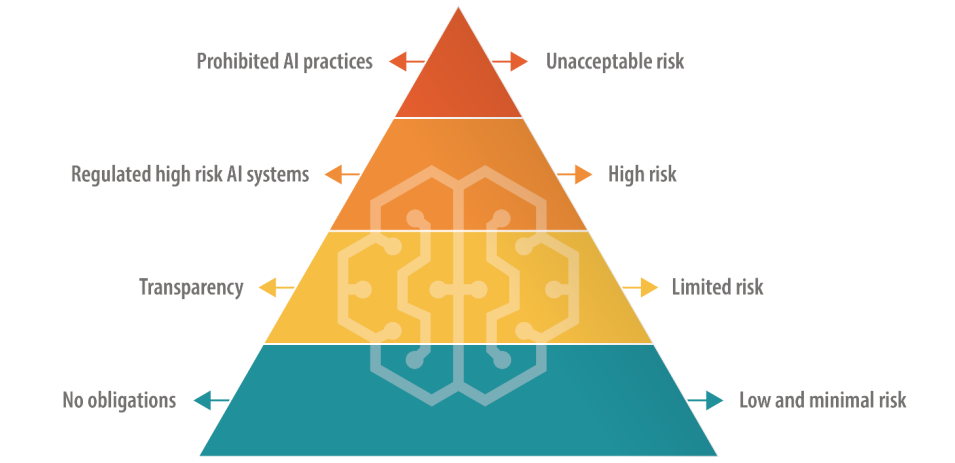

A UE, que tem uma abordagem direta da legislação digital, opta por uma abordagem faseada da regulamentação da IA, em que as IA são classificadas em categorias com base no risco.

Isto inclui um escalão proibido de "risco inaceitável" e um escalão de "alto risco", que os patrões da tecnologia, como o diretor executivo da OpenAI, Sam Altman, receiam que comprometa a funcionalidade dos seus produtos.

Os EUA não estão a propor regulamentos tão definitivos, favorecer regras voluntárias.

Serão necessárias muitas mais reuniões entre a UE, os EUA e as grandes empresas de tecnologia para alinhar os pontos de vista com acções práticas significativas.

As regras voluntárias da IA funcionarão?

Há muitos exemplos de regras voluntárias noutros sectores e indústrias, como os quadros voluntários de segurança dos dados e as divulgações ESG, mas nenhum está tão próximo da vanguarda como um quadro voluntário de governação da IA.

Afinal de contas, estamos perante uma ameaça de extinção, de acordo com os principais líderes tecnológicos e académicos que assinaram o Declaração do Center for AI Safety sobre o risco da IA esta semana.

Grandes empresas como a OpenAI e a Google já têm departamentos centrais dedicados à governação e a questões de conformidade interna, pelo que alinhar os seus produtos e serviços com quadros voluntários pode ser uma questão de reescrever documentos de política interna.

As regras voluntárias são melhores do que nada, mas com numerosas propostas em cima da mesa, os políticos e os líderes da IA terão de escolher algo com que se candidatar, mais cedo ou mais tarde.