Onderzoekers van Stanford en Google DeepMind hebben AI gemaakt die menselijke persoonlijkheden kan nabootsen met een griezelige nauwkeurigheid na slechts een gesprek van twee uur.

Door 1.052 mensen met verschillende achtergronden te interviewen, bouwden ze wat ze "simulatieagenten" noemen - digitale kopieën die griezelig effectief waren in het voorspellen van de overtuigingen, houdingen en gedragingen van hun menselijke tegenhangers.

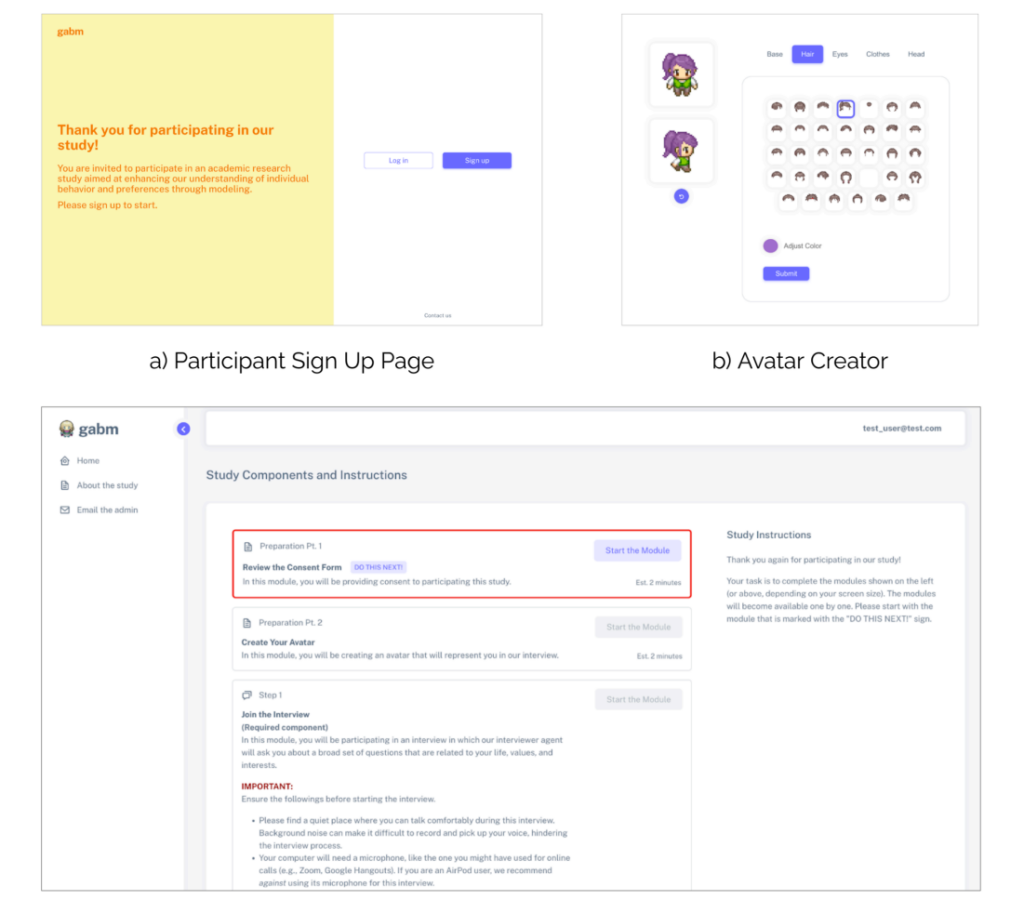

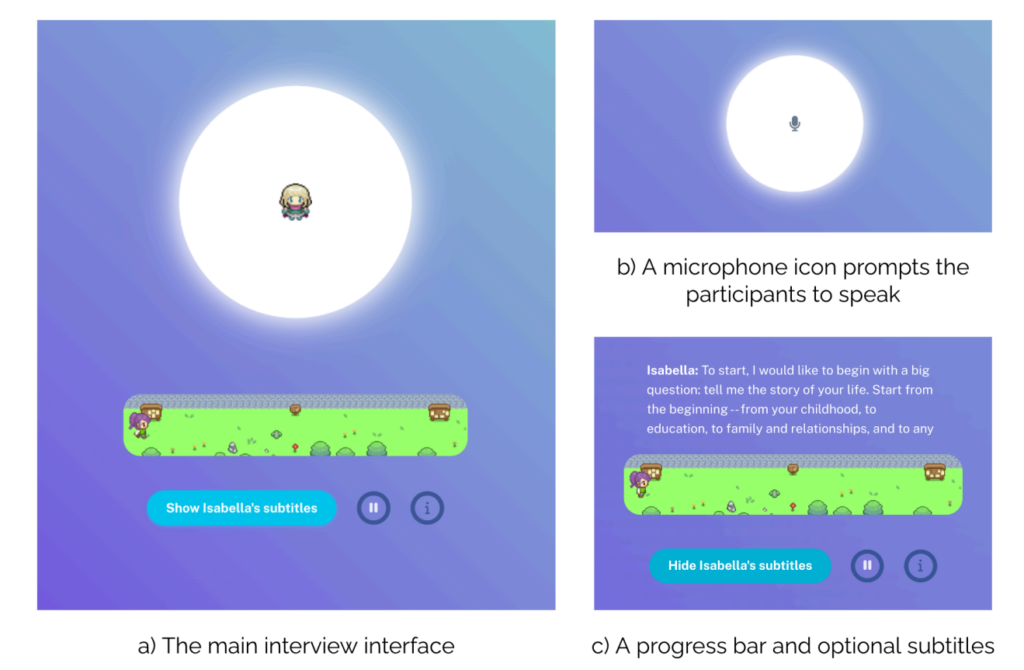

Om de digitale kopieën te maken, gebruikt het team gegevens van een "AI-interviewer" die ontworpen is om deelnemers te betrekken in natuurlijke gesprekken.

De AI-interviewer stelt vragen en genereert persoonlijke vervolgvragen - gemiddeld 82 per sessie - waarin van alles wordt onderzocht, van jeugdherinneringen tot politieke standpunten.

Tijdens deze twee uur durende discussies genereerde elke deelnemer gedetailleerde transcripties van gemiddeld 6500 woorden.

Als een deelnemer bijvoorbeeld zijn geboorteplaats noemt, kan de AI dieper graven en vragen naar specifieke herinneringen of ervaringen. Door een natuurlijk verloop van een gesprek na te bootsen, legt het systeem genuanceerde persoonlijke informatie vast die bij standaardonderzoeken vaak over het hoofd wordt gezien.

Achter de schermen onderzoek documenteert wat de onderzoekers "expertreflectie" noemen - waarbij grote taalmodellen (LLM's) elk gesprek analyseren vanuit vier verschillende professionele gezichtspunten:

- Als psycholoog identificeert het specifieke persoonlijkheidskenmerken en emotionele patronen - bijvoorbeeld hoe iemand onafhankelijkheid waardeert op basis van hun beschrijvingen van familierelaties.

- Door de lens van een gedragseconoom worden inzichten verkregen over financiële besluitvorming en risicotolerantie, zoals hoe ze omgaan met sparen of loopbaankeuzes.

- Het perspectief van de politicoloog brengt ideologische voorkeuren en beleidsvoorkeuren over verschillende onderwerpen in kaart.

- Een demografische analyse brengt sociaaleconomische factoren en levensomstandigheden in kaart.

De onderzoekers concludeerden dat deze op interviews gebaseerde techniek aanzienlijk beter presteerde dan vergelijkbare methoden, zoals het verzamelen van gegevens uit sociale media.

De digitale kopieën testen

Hoe goed waren de AI-kopieën? De onderzoekers onderwierpen ze aan een reeks tests om daar achter te komen.

Eerst gebruikten ze de General Social Survey - een meting van sociale attitudes waarin vragen worden gesteld over van alles en nog wat, van politieke opvattingen tot religieuze overtuigingen. Hier kwamen de AI-exemplaren 85% van de tijd overeen met de antwoorden van hun menselijke tegenhangers.

Op de Big Five persoonlijkheidstest, die eigenschappen als openheid en consciëntieusheid meet aan de hand van 44 verschillende vragen, kwamen de AI-voorspellingen ongeveer 80% van de tijd overeen met de menselijke antwoorden. Het systeem was uitstekend in het vastleggen van eigenschappen als extraversie en neuroticisme.

Het testen van economische spellen onthulde echter fascinerende beperkingen. In het "Dictatorspel", waarbij deelnemers beslissen hoe ze geld met anderen delen, had de AI moeite om menselijke vrijgevigheid perfect te voorspellen.

In het "vertrouwensspel", waarin de bereidheid om met anderen samen te werken voor wederzijds voordeel wordt getest, kwamen de digitale kopieën in slechts tweederde van de gevallen overeen met de menselijke keuzes.

Dit suggereert dat AI onze waarden wel kan begrijpen, maar de nuances van menselijke sociale besluitvorming (nog) niet volledig kan bevatten.

Experimenten in de echte wereld

De onderzoekers lieten het daar niet bij en onderwierpen de kopieën ook aan vijf klassieke experimenten uit de sociale psychologie.

In een experiment waarin werd getest hoe waargenomen opzet schuld beïnvloedt, toonden zowel mensen als hun AI-kopieën vergelijkbare patronen van het toekennen van meer schuld wanneer schadelijke acties opzettelijk leken.

Een ander experiment onderzocht hoe eerlijkheid emotionele reacties beïnvloedt, waarbij AI-exemplaren nauwkeurig menselijke reacties op een eerlijke versus oneerlijke behandeling voorspelden.

De AI-replica's reproduceerden menselijk gedrag met succes in vier van de vijf experimenten, wat suggereert dat ze niet alleen individuele actuele reacties kunnen modelleren, maar ook brede, complexe gedragspatronen.

Eenvoudige AI-klonen: Wat zijn de gevolgen?

AI systems that ‘clone’ human views and behaviors are big business, with Meta kondigde onlangs plannen aan om Facebook en Instagram met AI-profielen die inhoud kunnen maken en met gebruikers kunnen communiceren.

TikTok is ook in de strijd gesprongen met zijn nieuwe "Symphony"-suite van AI-gestuurde creatieve tools, waaronder digitale avatars die kunnen worden gebruikt door merken en makers om gelokaliseerde content op schaal te produceren.

Met Symfonie Digitale AvatarsTikTok stelt makers in staat om avatars te maken die echte mensen voorstellen, compleet met een breed scala aan gebaren, uitdrukkingen, leeftijden, nationaliteiten en talen.

Het onderzoek van Stanford en DeepMind suggereert dat zulke digitale replica's veel geavanceerder zullen worden - en gemakkelijker om op schaal te bouwen en in te zetten.

"Als je een stel kleine 'jij's' kunt hebben die rondrennen en daadwerkelijk de beslissingen nemen die jij zou hebben genomen - dat is, denk ik, uiteindelijk de toekomst," beschrijft hoofdonderzoeker Joon Sung Park, een Stanford promovendus in computerwetenschappen, aan MIT.

Park beschrijft dat deze technologie ook voordelen heeft, omdat het bouwen van nauwkeurige klonen wetenschappelijk onderzoek kan ondersteunen.

In plaats van dure of ethisch twijfelachtige experimenten uit te voeren op echte mensen, zouden onderzoekers kunnen testen hoe populaties reageren op bepaalde input. Het zou bijvoorbeeld kunnen helpen bij het voorspellen van reacties op berichten over de volksgezondheid of bestuderen hoe gemeenschappen zich aanpassen aan grote maatschappelijke verschuivingen.

Uiteindelijk maken dezelfde eigenschappen die deze AI-replica's waardevol maken voor onderzoek, ze ook tot krachtige hulpmiddelen voor misleiding.

Nu digitale kopieën steeds overtuigender worden, is het moeilijk geworden om authentieke menselijke interactie te onderscheiden van AI, zoals we hebben kunnen zien bij een stortvloed aan diepe vervalsingen.

Wat als deze technologie gebruikt zou worden om iemand tegen zijn wil te klonen? Wat zijn de gevolgen van het maken van digitale kopieën die nauwkeurig gemodelleerd zijn naar echte mensen?

Het onderzoeksteam van Stanford en DeepMind erkent deze risico's. Hun raamwerk vereist duidelijke toestemming van deelnemers en stelt hen in staat om hun gegevens in te trekken, waarbij persoonlijkheidsreplicatie met dezelfde privacyzorgen wordt behandeld als gevoelige medische informatie.

Dat biedt tenminste enige theoretische bescherming tegen meer kwaadaardige vormen van misbruik. Maar, in Hoe dan ook, we begeven ons steeds dieper op onbekend terrein van mens-machine interactie en de gevolgen op de lange termijn blijven grotendeels onbekend.