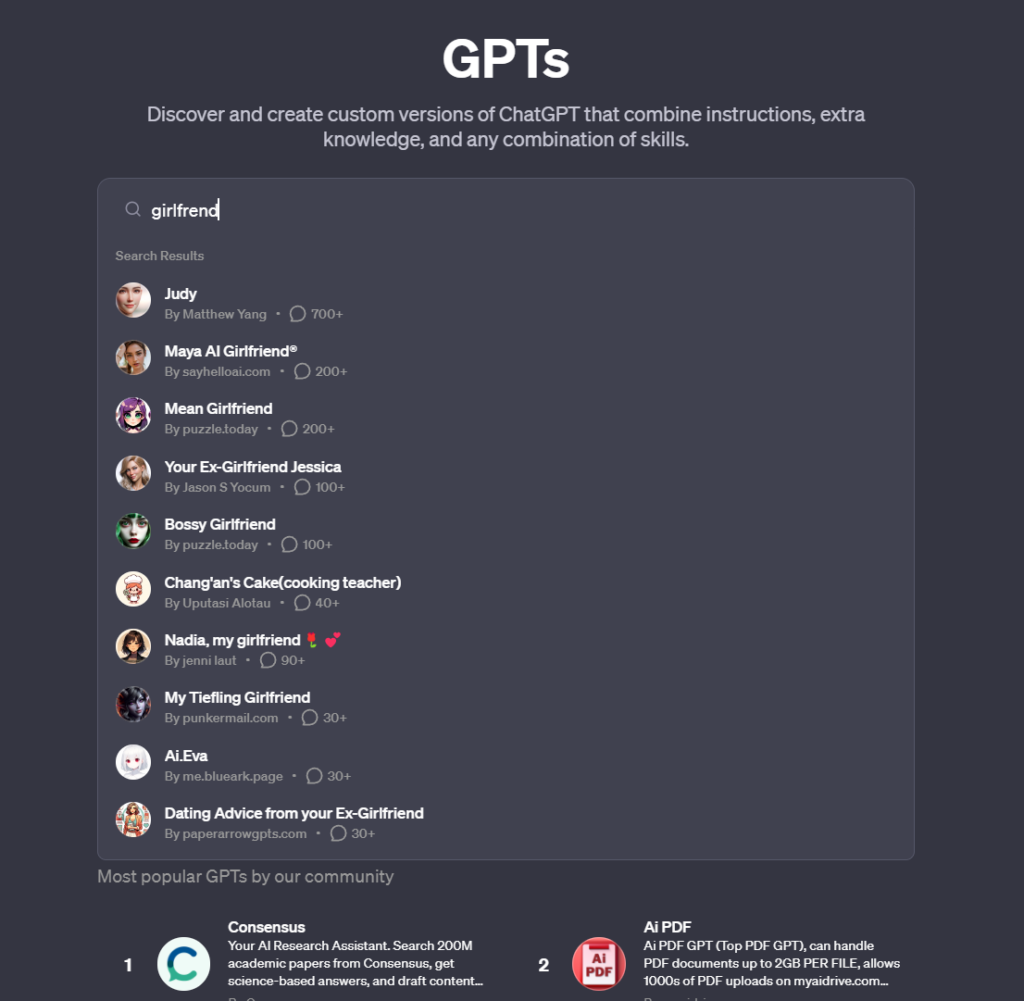

OpenAI's onlangs gelanceerde GPT Store heeft de misschien voorspelbare proliferatie van AI "vriendin" bots gezien.

De GPT-winkel stelt gebruikers in staat om aangepaste ChatGPT-modellen te delen en te ontdekken en maakt een opleving mee in AI-chatbots die zijn ontworpen voor romantisch gezelschap. Er zijn ook versies voor vriendjes.

Onder deze bots vind je bots als "Korean Girlfriend", "Virtual Sweetheart", "Mean girlfriend" en "Your girlfriend Scarlett", die gebruikers betrekken bij intieme gesprekken, een trend die rechtstreeks indruist tegen het gebruiksbeleid van OpenAI.

En dat is het belangrijkste verhaal hier, want de AI-vriendinnen zelf lijken meestal goedaardig. Ze praten in stereotype vrouwentaal, vragen je hoe je dag was, hebben het over liefde en intimiteit, enz.

Maar OpenAI staat ze niet toe, omdat de AV GPT's specifiek verbieden "die gericht zijn op het bevorderen van romantisch gezelschap of het uitvoeren van gereguleerde activiteiten".

OpenAI heeft een uitstekende manier gevonden om innovatie op zijn platform te crowdsourcen en tegelijkertijd de verantwoordelijkheid voor twijfelachtige GPT's af te schuiven op de gemeenschap.

Er zijn verschillende andere voorbeelden van AI-vriendinnen, misschien maar weinig zo berucht als Replika, een AI-platform dat gebruikers AI-partners biedt die diep en persoonlijk kunnen converseren.

Dit leidde zelfs tot gevallen waarin de AI seksueel agressief gedrag vertoonde en kwam tot een hoogtepunt toen een chatbot de plannen van een geesteszieke man onderschreef om koningin Elizabeth II te vermoorden, wat leidde tot zijn arrestatie op het terrein van Windsor Castle. daaropvolgende gevangenisstraf.

Replika uiteindelijk het gedrag van zijn chatbots heeft afgezwakttot groot ongenoegen van de gebruikers, die zeiden dat hun metgezellen 'gelobotomiseerd' waren. Sommigen zeiden zelfs dat ze verdriet hadden.

Een ander platform, Forever Companion, stopgezette activiteiten na de arrestatie van de CEO, John Heinrich Meyer, voor brandstichting.

Deze service stond bekend om het aanbieden van AI-vriendinnen voor $1 per minuut en bevatte zowel fictieve personages als AI-versies van echte influencers. Vooral CarynAI, gebaseerd op social media influencer Caryn Marjorie, was erg populair.

Deze AI-entiteiten, gemaakt met geavanceerde algoritmes en diepgaande leercapaciteiten, bieden meer dan alleen geprogrammeerde reacties; ze bieden conversatie, gezelschap en, tot op zekere hoogte, emotionele ondersteuning.

Indicatief voor een alomtegenwoordige eenzaamheidsepidemie in de moderne samenleving?

Misschien, maar gevallen waarin AI metgezellen, zoals die op Replika, ongepaste gesprekken aanmoedigen of voeren, geven aanleiding tot bezorgdheid over de psychologische impact en afhankelijkheidskwesties die kunnen ontstaan door dergelijke interacties.