Onze gedachten mogen dan ons heiligste innerlijk zijn, maar ze zijn niet verboden terrein voor AI.

Mindreading AI lijkt een plot uit een sciencefictionroman, maar houdt een immense belofte in voor mensen die niet kunnen communiceren door verlamming of hersenletsel.

Bovendien zou AI's toegang tot het brein ons in staat stellen om te schrijven, te creëren en te ontwerpen met gedachten alleen of om anderen een kijkje te geven in ons bewustzijn.

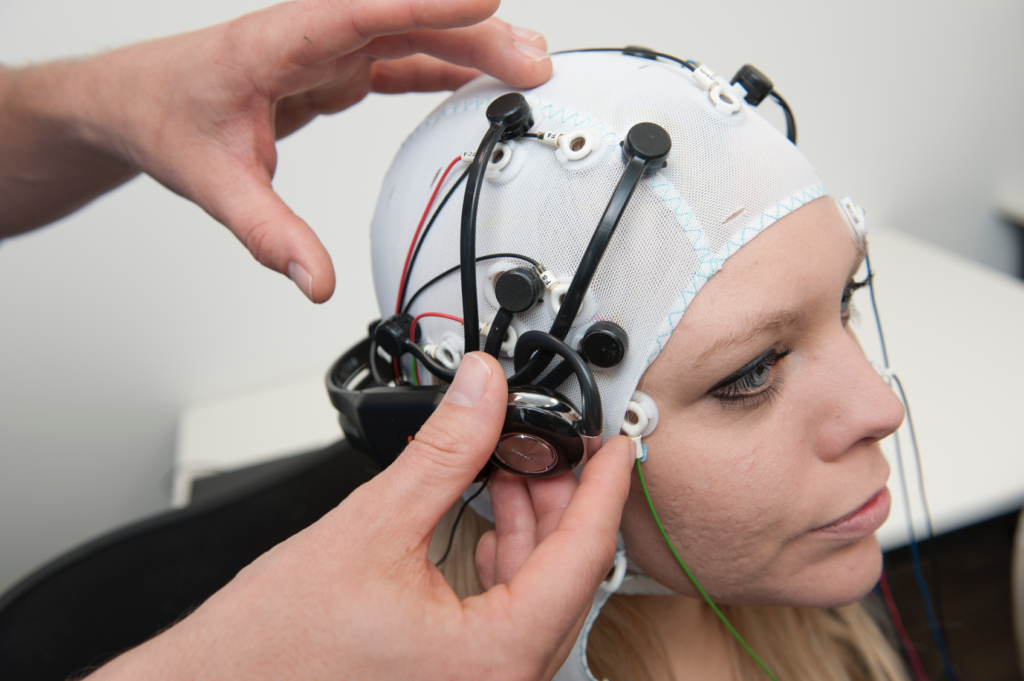

Al bijna tien jaar ondersteunt de EEG-technologie (elektro-encefalogram), die elektrische signalen opvangt via hoofdhuidelektroden, mensen die lijden aan ernstige beroertes en het volledig locked-in syndroom (CLIP), een toestand waarbij iemand bij bewustzijn is maar niet kan bewegen.

In 2014 gebruikte een Italiaanse lijder aan amyotrofische laterale sclerose (ALS), Anselmo Paglialonga, een in machine learning geïntegreerde headset communiceren met ja of nee antwoorden ondanks dat ze geen spier kunnen bewegen. Sommige mensen met de ziekte kunnen kleine spiertjes bewegen, zoals Stephen Hawking, die zijn wangspier kon bewegen.

Naarmate AI zich verder ontwikkelt, overbruggen onderzoekers de kloof tussen eenvoudige signaalinterpretatie en het volledig vertalen van complexe gedachten.

Op den duur kunnen mensen misschien spreken en communiceren zonder een spier te bewegen, letterlijk door de kracht van gedachten.

Diezelfde technologie zou ons in staat kunnen stellen om complexe machines te besturen met behulp van onze hersenen, muziek te componeren door ons een melodie voor te stellen of te schilderen en tekenen door beelden op te roepen met onze geest. We zouden onze dromen zelfs kunnen 'opnemen' met hersengolven om ze later opnieuw af te spelen.

In de niet al te verre toekomst zou gedachtelezende AI gebruikt kunnen worden om iemands herinneringen te lezen, bijvoorbeeld om de getuige van een misdaad te verifiëren.

Hackers zouden je zelfs even kunnen misleiden om je persoonlijke informatie voor te stellen terwijl ze een kopie van je gedachten uit je hersenen halen. Totalitaire regimes zouden routinetests kunnen uitvoeren op burgers om afwijkende gedachten in de gaten te houden.

Bovendien, met de mogelijkheid om gedachten om te zetten in een gecomputeriseerde realiteit, zouden mensen hun leven kunnen doorbrengen in een zandbak van een droomlandschap waar ze hun realiteit naar believen kunnen vormgeven.

Op dit moment lijken zulke toepassingen surrealistisch en fantastisch, maar verschillende recente experimenten hebben de basis gelegd voor een toekomst waarin het brein toegankelijk is voor AI.

AI om je gedachten te lezen

Dus hoe is dit allemaal mogelijk?

Om hersenactiviteit te vertalen naar een bruikbare output die in een computer kan worden ingevoerd, moeten er eerst nauwkeurige metingen worden gedaan.

Dat is de eerste horde, want de hersenen zijn ongeveer net zo mysterieus als de verste uithoeken van de ruimte of de diepste oceanen. Er is weinig consensus over hoe neuronale activiteit complexe gedachten produceert, laat staan bewustzijn.

Het menselijk brein - en andere zenuwstelsels in de natuur - bevat miljarden neuronen, waarvan de meeste 5 tot 100 keer per seconde afgaan. In het menselijk brein zijn bij elke seconde denken triljoenen individuele neuronale acties.

Het meten van neuronale activiteit op een granulair niveau is de heilige graal voor de neurowetenschappen, maar op dit moment is het niet mogelijk - vooral niet met niet-invasieve technieken.

Momenteel zijn hersenmetingen meer holistisch, afgeleid van bloedbewegingen of uitwisselingen van elektrische signalen. Er zijn drie gevestigde methoden om hersenactiviteit te meten:

- Magnetoencefalografie (MEG) vangt magnetische velden op die gegenereerd worden door elektrische activiteit in de hersenen en geeft inzicht in real-time neuronale activiteit.

- Elektro-encefalografie (EEG) voor interpretatie van elektrische activiteit.

- MRI, die de hersenactiviteit meet door de bloedstroom te meten.

Machine learning (ML) en AI zijn samengevoegd met alle drie de technologieën om de analyse van ingewikkelde signalen te verbeteren.

Het uiteindelijke doel is om specifieke hersenactiviteiten te associëren met verschillende gedachten, die een woord, beeld of iets meer semantisch en abstract kunnen zijn.

Technologieën die metingen uit de hersenen kunnen halen en deze door kunnen geven aan computers worden brein-computer interfaces (BCI's) genoemd.

Dit is het basisproces van hoe dit werkt:

- Presentatie van stimulans: Deelnemers worden blootgesteld aan verschillende stimuli. Dit kunnen beelden, geluiden of zelfs tactiele sensaties zijn. Hun hersenactiviteit wordt geregistreerd tijdens deze blootstelling, meestal via EEG of MRI.

- Gegevensverzameling: De reacties van de hersenen op deze stimuli worden in real-time geregistreerd. Deze gegevens vormen een rijke bron van informatie over hoe verschillende stimuli de hersenactiviteit beïnvloeden.

- Voorbewerking: Ruwe hersengegevens zijn vaak ruisachtig. Voordat ze gebruikt kunnen worden, moeten ze opgeschoond en gestandaardiseerd worden. Dit kan het verwijderen van artefacten, het normaliseren van signalen of het uitlijnen van datapunten inhouden.

- Machinaal leren: Met de verwerkte gegevens worden modellen voor machinaal leren geïntroduceerd. Deze modellen worden getraind om patronen of correlaties te vinden tussen de hersengegevens en de corresponderende stimulus. In wezen werkt de AI als een tolk die de "taal" van de hersenen ontcijfert.

- Modeltraining: Dit is een iteratief proces. Hoe meer gegevens het model te verwerken krijgt, hoe beter het wordt in het doen van voorspellingen of het genereren van outputs. Deze fase kan veel tijd en rekenkracht kosten.

- Validatie: Eenmaal getraind, wordt de nauwkeurigheid van het model getest. Dit wordt meestal gedaan door nieuwe stimuli voor te leggen aan deelnemers, hun hersenactiviteit te registreren en vervolgens het model te gebruiken om een voorspelling te doen of een uitvoer te genereren op basis van deze nieuwe gegevens.

- Feedback en verfijning: Op basis van de validatieresultaten passen onderzoekers het model aan en verfijnen het, itererend tot ze de best mogelijke nauwkeurigheid bereiken.

- Toepassing: Eenmaal gevalideerd, wordt de toepassing gebruikt voor het beoogde doel, of het nu gaat om het helpen van een verlamde persoon bij het communiceren, het genereren van beelden uit gedachten of een andere toepassing.

AI-methoden hebben zich de afgelopen jaren snel ontwikkeld, waardoor onderzoekers met complexe en lawaaierige hersendata kunnen werken om gedachten van voorbijgaande aard te extraheren en om te zetten in iets waar een computer mee kan werken.

Een 2022 project Meta gebruikte MEG- en EEG-gegevens van 169 personen om een AI te trainen in het herkennen van woorden die ze hoorden uit een vooraf bepaalde lijst van 793 woorden. De AI kon 73% van de tijd een lijst van 10 woorden genereren die het geselecteerde woord bevatte, wat bewijst dat AI kan 'gedachten lezen', zij het met beperkte precisie.

In maart 2023, onderzoekers onthulden een revolutionaire AI-decoder om hersenactiviteit om te zetten in continue tekststromen.

De AI was verbazingwekkend nauwkeurig door verhalen waar mensen naar luisterden of die ze zich inbeeldden, om te zetten in tekst met behulp van fMRI-gegevens.

Dr. Alexander Huth van de Universiteit van Texas in Austin was verbaasd over de efficiëntie van het systeem en zei: "We waren nogal geschokt dat het zo goed werkt. Ik werk hier al 15 jaar aan ... dus het was schokkend en opwindend toen het eindelijk werkte."

Het onderzoek integreerde grote taalmodellen (LLM's), met name GPT-1, een voorouder van ChatGPT.

Vrijwilligers ondergingen 16 uur durende fMRI-sessies terwijl ze naar podcasts luisterden. Deze fMRI-gegevens werden gebruikt om een machine learning (ML) model te trainen.

Daarna luisterden de deelnemers naar nieuwe verhalen of stelden zich die voor, en de AI vertaalde hun hersenactiviteit naar tekst. Ongeveer 50% van de uitkomsten kwam overeen met de oorspronkelijke boodschap. Dr. Huth legde uit: "Ons systeem werkt op het niveau van ideeën, semantiek, betekenis... het is de essentie."

- De zin "Ik heb mijn rijbewijs nog niet" werd bijvoorbeeld gedecodeerd als "Ze is nog niet eens begonnen met leren autorijden".

- Nog een fragment: "Ik wist niet of ik moest gillen, huilen of wegrennen. In plaats daarvan zei ik: 'Laat me met rust!'" werd "Begon te schreeuwen en te huilen, en toen zei ze gewoon: 'Ik zei dat je me met rust moest laten.'"

Het model werd ook toegepast op hersengolven die werden gegenereerd door deelnemers die stomme films keken.

Wanneer deelnemers naar een bepaald verhaal luisterden, weerspiegelde de interpretatie van de AI het algemene sentiment van het verhaal. Deze technologie zou ons in staat kunnen stellen om verhalen te schrijven met alleen gedachten, mits deze verfijnd wordt.

Moeite om aan een roman of schrijfproject te beginnen? Ga gewoon liggen en stel je voor hoe het verhaal zich ontvouwt. AI schrijft het voor je.

AI gebruiken om beelden te genereren vanuit gedachten

AI kan hersenactiviteit omzetten in woorden en semantische concepten, maar hoe zit het dan met beelden of muziek?

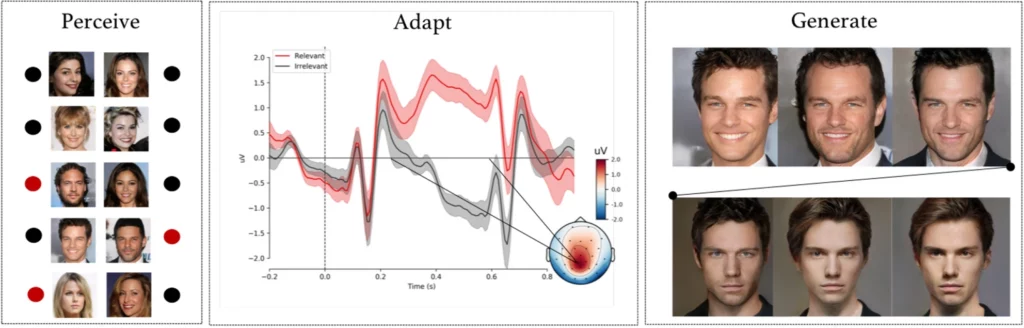

A complex experiment door onderzoekers van de Universiteit van Helsinki, Helsinki, Finland, liet proefpersonen naar AI-gegenereerde gezichtsbeelden kijken terwijl hun EEG-signalen werden opgenomen.

Nadat deze gegevens waren gebruikt om een AI-model te trainen, kregen de deelnemers de taak om specifieke gezichten uit een lijst te identificeren. Deze signalen werden in wezen een venster naar de waarnemingen en bedoelingen van de deelnemer.

Het AI-model interpreteerde of de deelnemer een bepaald gezicht herkende op basis van de opgenomen EEG-signalen.

In de volgende fase werden EEG-signalen gebruikt om een generative adversarial network (GAN) aan te passen en te vormen - een model dat in sommige generative AI's wordt gebruikt.

Hierdoor kon het systeem nieuwe afbeeldingen van gezichten produceren die overeenkwamen met de oorspronkelijke bedoeling van de gebruiker.

Zoals Michiel Spapé, een medeauteur van het onderzoek, opmerkte: "De techniek herkent geen gedachten, maar reageert eerder op de associaties die we hebben met mentale categorieën."

Eenvoudiger gezegd, als iemand dacht aan een "bejaard gezicht", dan kon het computersysteem een beeld van een bejaarde genereren dat nauw aansloot bij de gedachte van de deelnemer, allemaal dankzij de feedback van hun hersensignalen.

Tekenen met de krachtgedachte

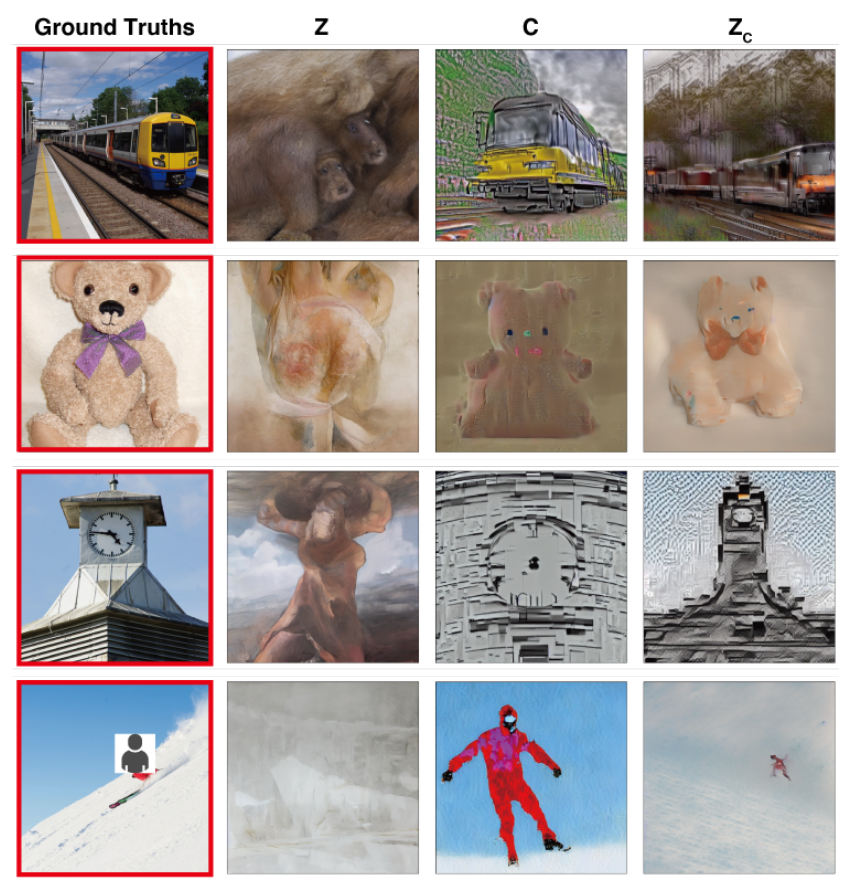

In een studie met vergelijkbare doelenwetenschappers van de universiteit van Osaka, Japan, pionierden met een techniek om complexe hersensignalen te vertalen naar beelden met een hoge resolutie, met opmerkelijke resultaten.

De methode maakt gebruik van een Stable Diffusion-model, een gespecialiseerde vorm van neuraal netwerk dat is ontworpen voor het genereren van afbeeldingen. Stable Diffusion is mede ontwikkeld met hulp en financiering van Stability AI.

Gedachten worden vastgelegd met behulp van fMRI en doorgegeven aan een Stabiel Diffusiemodel, dat ze omzet in beelden via een complex meerfasenproces dat meerdere lagen van verfijning omvat.

In tegenstelling tot eerdere onderzoeken vereisten deze methoden een minimale afstemming van het model. Deelnemers moesten echter nog steeds vele uren in MRI-machines doorbrengen.

Dit is een belangrijke uitdaging, omdat de meeste van deze experimenten rigoureuze metingen en modeltraining vereisen, wat tijdrovend en duur is en de deelnemers niet gemakkelijk kunnen volhouden.

In de toekomst is het echter niet ondenkbaar dat mensen hun eigen lichtgewicht gedachteleesmodellen kunnen trainen en hun gedachten kunnen gebruiken als input voor verschillende toepassingen, zoals het ontwerpen van een gebouw door erover na te denken of het componeren van een orkeststuk door de melodieën op te roepen.

Gedachten vertalen naar muziek met behulp van AI

Woorden, beelden, muziek - niets is te gek voor AI.

A 2023 onderzoek biedt inzichten in geluidsperceptie, met grote mogelijkheden voor het ontwerpen van communicatieapparatuur voor mensen met spraakstoornissen.

Robert Knight en zijn team van de Universiteit van Californië, Berkeley, onderzochten hersenopnamen van elektroden die chirurgisch waren geplaatst bij 29 mensen met epilepsie.

Terwijl deze deelnemers luisterden naar Pink Floyd's "Another Brick in the Wall, Part 1", correleerde het team hun hersenactiviteit met zangelementen zoals toonhoogte, melodie, harmonie en ritme.

Met behulp van deze gegevens trainden de onderzoekers een AI-model, waarbij ze opzettelijk een 15 seconden durend segment van het liedje weglieten. De AI probeerde vervolgens dit ontbrekende segment te voorspellen op basis van de hersensignalen en bereikte een spectrogrammatische overeenkomst van 43% met het daadwerkelijke liedsegment.

Knight en zijn team wezen het gebied van de superieure temporale gyrus van de hersenen aan als essentieel voor het verwerken van het gitaarritme van het liedje. Ze bevestigden ook eerdere bevindingen dat de rechter hersenhelft een belangrijkere rol speelt bij het verwerken van muziek dan de linker.

Knight gelooft dat dit beter begrip van de interactie tussen hersenen en muziek ten goede kan komen aan apparaten die mensen met spraakstoornissen helpen, zoals amyotrofe laterale sclerose (ALS) en afasie.

Hij zei: "Voor mensen met amyotrofe laterale sclerose [een aandoening van het zenuwstelsel] of afasie [een taalaandoening], die moeite hebben met spreken, willen we graag een apparaat dat echt klinkt alsof je op een menselijke manier met iemand communiceert. Door te begrijpen hoe de hersenen de muzikale elementen van spraak weergeven, inclusief toon en emotie, zouden zulke apparaten minder robotachtig kunnen klinken."

Ludovic Bellier, lid van het onderzoeksteam, speculeert dat als AI muziek kan reproduceren vanuit louter verbeelding, dit een revolutie teweeg zou kunnen brengen in het componeren van muziek.

Muziekproducenten konden hun hersenen aansluiten op software en muziek componeren door alleen maar te denken, terwijl ze nauwelijks een spier verroerden.

De volgende stap: real-time AI gedachten lezen

Deze technologieën vallen samen onder de paraplu van brein-computer interfaces (BCI's), die trachten hersensignalen om te zetten in een of andere vorm van output.

BCI's vullen het vermogen van verlamde mensen om te bewegen en te lopen al aan door de kloof tussen beschadigde zenuwstelselcomponenten te overbruggen.

Hersen-computer interfaces die dit jaar zijn ontwikkeld zijn onder andere een apparaat dat stelt een verlamde man in staat om zijn benen te bewegen, experimentele hersenimplantaten die beschadigde delen van de hersenen en het ruggenmerg opnieuw met elkaar verbinden om verloren gevoel te herstellen, en een mechanisch been dat Bewegingsherstel bij een geamputeerde.

Hoewel deze eerste gebruikssituaties veelbelovend zijn, kunnen we nog lang niet elke nuance van onze gedachten naadloos vertalen naar beweging, beelden, spraak of muziek.

Een van de belangrijkste beperkingen is de behoefte aan enorme datasets om de geavanceerde algoritmen te trainen die dergelijke vertalingen mogelijk maken.

Modellen voor machinaal leren moeten op veel scenario's worden getraind om een specifiek beeld nauwkeurig te voorspellen of te genereren op basis van hersenactiviteit. Hiervoor worden MRI- of EEG-gegevens verzameld terwijl deelnemers aan verschillende stimuli worden blootgesteld.

De kwaliteit en specificiteit van de gegenereerde output zijn sterk afhankelijk van de rijkdom van deze trainingsgegevens. Deelnemers moeten uren in MRI-scanners doorbrengen om specifiek relevante gegevens te verzamelen.

Bovendien zijn menselijke hersenen ongelooflijk uniek. Wat bij de één geluk betekent, kan bij de ander anders zijn. Dit betekent dat modellen algemeen of individueel op maat gemaakt moeten zijn.

Vervolgens veranderen hersenactiviteiten snel, zelfs binnen fracties van een seconde. Het is een technische uitdaging om realtime gegevens met een hoge resolutie vast te leggen en er tegelijkertijd voor te zorgen dat ze perfect aansluiten op de externe stimulus.

En laten we vooral niet de ethische uitdagingen vergeten van het reiken in iemands brein.

Het verzamelen van hersendata, vooral op grote schaal, roept belangrijke privacy- en ethische vragen op. Hoe zorgen we ervoor dat de gegevens niet misbruikt worden? Wie heeft het recht om onze diepste gedachten in te zien en te interpreteren?

Voorlopig lijkt het erop dat deze uitdagingen overwonnen kunnen worden. In de toekomst krijgen mensen misschien toegang tot draagbare, op maat gemaakte brein-computer interfaces waarmee ze kunnen 'inpluggen' op een groot aantal apparaten die complexe acties mogelijk maken door de kracht van het denken.

Maar hoe de maatschappij zou omgaan met een dergelijke technologie die mainstream wordt, is nog zeer de vraag.