De exponentiële groei van AI-systemen overtreft onderzoek en regelgeving, waardoor overheden zich in een lastige positie bevinden om de voordelen en risico's tegen elkaar af te wegen.

Het duurt jaren om wetten te ontwikkelen en juridisch bindend te maken. AI ontwikkelt zich wekelijks.

Dat is de dichotomie waar AI-leiders en politici mee te maken hebben, met de eerste zinvolle AI-regelgeving in het Westen, de EU AI Act, die in 2026 wordt verwacht. Zelfs een jaar geleden werd er nog gefluisterd over ChatGPT.

Topambtenaren van de VS en de EU ontmoetten elkaar op 31 mei in Luleå, Zweden, voor de Trade and Tech Council (TTC) tussen de VS en de EU. Margrethe Vestager, Europees commissaris voor digitale zaken, die de week ervoor een ontmoeting had met Google CEO Sundar Pichai om een mogelijk 'AI-pact' te bespreken, zei: "De democratie moet laten zien dat we net zo snel zijn als de technologie."

Ambtenaren erkennen de gapende kloof tussen het tempo van de technologie en het tempo van de wetgeving. Verwijzend naar generatieve AI zoals ChatGPT zei Gina Raimondo, de Amerikaanse minister van Handel: "Het komt met een snelheid zoals geen andere technologie."

Wat heeft de TTC-vergadering opgeleverd?

Watermerken, externe audits, feedbacklussen - slechts enkele van de ideeën die zijn besproken met @AnthropicAI en @sama @OpenAI voor de #AI 1TP5Gedragscode vandaag gelanceerd op de #TTC in #Luleå @SecRaimondo Ik kijk uit naar gesprekken met internationale partners. pic.twitter.com/wV08KDNs3h

- Margrethe Vestager (@vestager) 31 mei 2023

De aanwezigen bespraken vooral niet-bindende of vrijwillige kaders rond risico en transparantie, die in het najaar aan de G7 zullen worden voorgelegd.

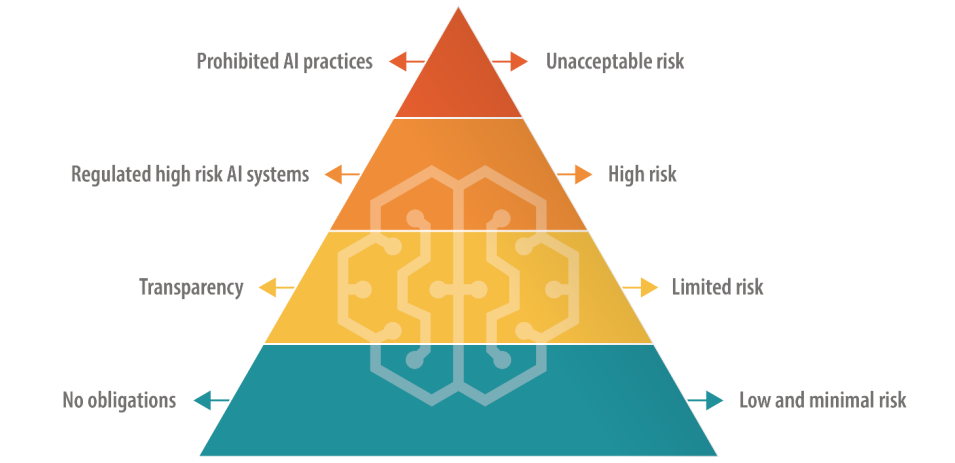

De EU, die een directe benadering heeft van digitale wetgeving, kiest voor een trapsgewijze benadering van AI-regelgeving, waarbij AI's worden ingedeeld in categorieën op basis van risico.

Dit omvat een verboden niveau van "onaanvaardbaar risico" en een niveau van "hoog risico", waarvan techbazen zoals OpenAI CEO Sam Altman vrezen dat het de functionaliteit van hun producten in gevaar zal brengen.

De VS stellen zulke definitieve regels niet voor, voorkeur voor vrijwillige regels.

Er zullen nog veel meer ontmoetingen nodig zijn tussen de EU, de VS en de grote technologiebedrijven om standpunten op één lijn te brengen met zinvolle praktische actie.

Zullen vrijwillige AI-regels werken?

Er zijn veel voorbeelden van vrijwillige regels in andere sectoren en bedrijfstakken, zoals vrijwillige kaders voor gegevensbeveiliging en ESG-bekendmakingen, maar geen daarvan is zo geavanceerd als een vrijwillig kader voor AI-governance.

Per slot van rekening hebben we hier te maken met een bedreiging op het niveau van uitsterven, volgens toptechnische leiders en academici die de Verklaring van het Center for AI Safety over AI-risico's deze week.

Grote bedrijven als OpenAI en Google hebben al centrale afdelingen die zich bezighouden met governance en interne compliance, dus het afstemmen van hun producten en diensten op vrijwillige kaders zou een kwestie kunnen zijn van het herschrijven van interne beleidsdocumenten.

Vrijwillige regels zijn beter dan niets, maar met de vele voorstellen die op tafel liggen, zullen politici en AI-leiders vroeg of laat iets moeten kiezen om mee verder te gaan.