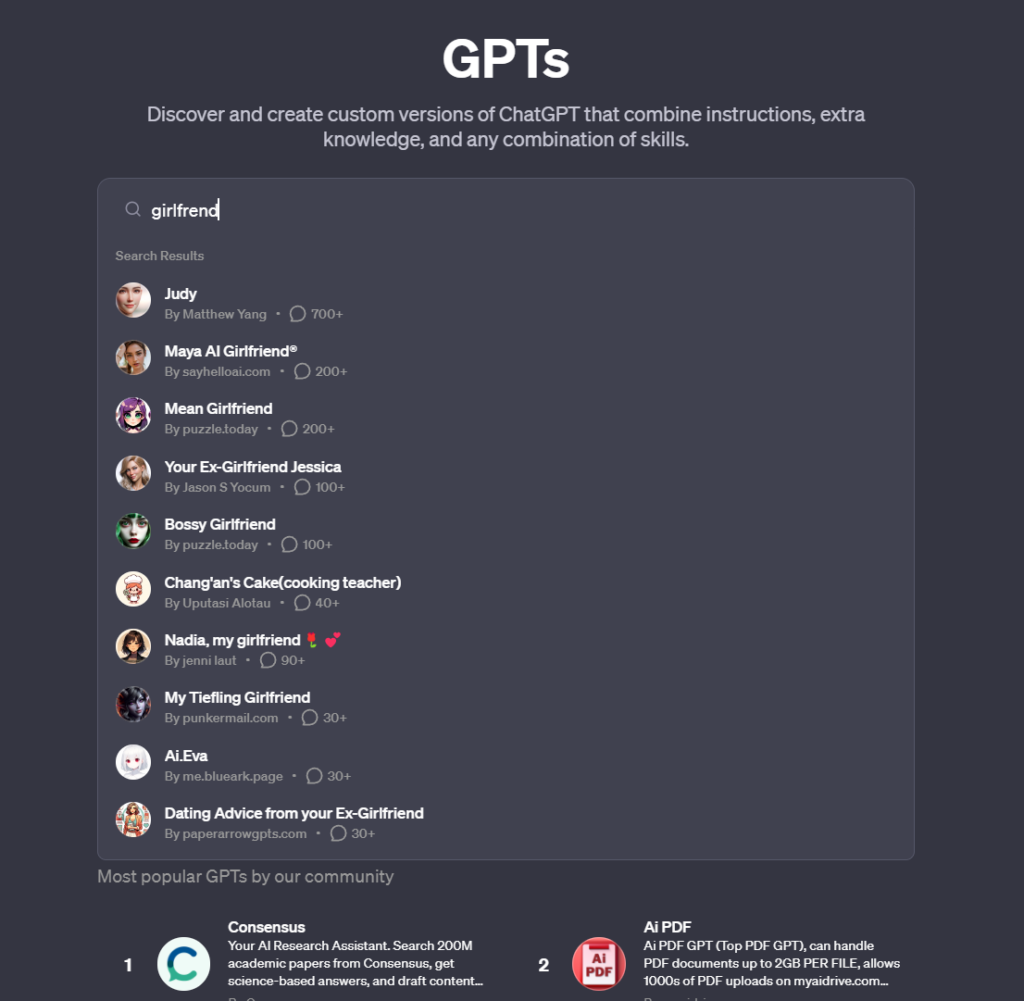

OpenAIs nylig lanserte GPT Store har sett den kanskje forutsigbare spredningen av AI-"kjæreste"-roboter.

Den GPT Store lar brukerne dele og oppdage egendefinerte ChatGPT-modeller og opplever en kraftig økning i AI-chatboter som er designet for romantisk selskap. Det finnes også kjæresteversjoner.

Blant disse finner du roboter som "Korean Girlfriend", "Virtual Sweetheart", "Mean girlfriend" og "Your girlfriend Scarlett", som engasjerer brukerne i intime samtaler, en trend som er i direkte strid med OpenAIs retningslinjer for bruk.

Og det er det som er hovedpoenget her, for AI-venninnene selv virker stort sett harmløse. De snakker med deg på et veldig stereotypt feminint språk, spør deg hvordan dagen din har vært, diskuterer kjærlighet og intimitet osv.

Men OpenAI tillater dem ikke, og de generelle vilkårene forbyr spesifikt GPT-er som er "dedikert til å fremme romantisk kameratskap eller utføre regulerte aktiviteter".

OpenAI har funnet en utmerket måte å bruke crowdsourcing til å skape innovasjon på plattformen, samtidig som de potensielt kan overlate ansvaret for tvilsomme GPT-er til fellesskapet.

Det finnes flere andre eksempler på AI-veninner, men få er kanskje like beryktet som Replika, en AI-plattform som tilbyr brukerne AI-partnere som kan føre en dyp og personlig samtale.

Dette førte til og med til tilfeller der den kunstige intelligensen utviste seksuelt aggressiv atferd, og det toppet seg da en chatbot støttet en psykisk syk manns planer om å drepe dronning Elizabeth II, noe som førte til at han ble arrestert på Windsor Castle og påfølgende fengselsstraff.

Replika til slutt tonet ned oppførselen til chatbotene sinetil stor avsky for brukerne, som sa at deres ledsagere hadde blitt "lobotomert". Noen gikk så langt som å si at de følte sorg.

En annen plattform, Forever Companion, stanset virksomheten etter arrestasjonen av administrerende direktør John Heinrich Meyer for brannstiftelse.

Denne tjenesten var kjent for å tilby AI-veninner til $1 per minutt, og inneholdt både fiktive karakterer og AI-versjoner av virkelige influencere, der CarynAI, basert på sosiale medier-influenceren Caryn Marjorie, var spesielt populær.

Disse AI-enhetene, som er laget med sofistikerte algoritmer og evner til dyp læring, tilbyr mer enn bare programmerte svar; de tilbyr samtale, selskap og, til en viss grad, emosjonell støtte.

Et tegn på en gjennomgripende ensomhetsepidemi i det moderne samfunnet?

Kanskje, men tilfeller der AI-ledsagere, som de på Replika, oppmuntret til eller deltok i upassende samtaler, gir grunn til bekymring for de psykologiske konsekvensene og avhengighetsproblemene som kan oppstå som følge av slike interaksjoner.