Under sitt besøk i Storbritannia i forbindelse med AI Safety Summit kunngjorde USAs visepresident Kamala Harris at 30 land har sluttet seg til USAs forslag til retningslinjer for militær bruk av kunstig intelligens.

Kunngjøringen "Politisk erklæring om ansvarlig militær bruk av kunstig intelligens og autonomi" ble lagt ut til det amerikanske utenriksdepartementets nettsted 1. november, og ytterligere detaljer om rammeverket ble publisert 9. november.

I sin uttalelse om rammeverket sa Harris: "For å skape orden og stabilitet midt i den globale teknologiske utviklingen, er jeg overbevist om at vi må la oss lede av et felles sett av forståelser mellom nasjonene."

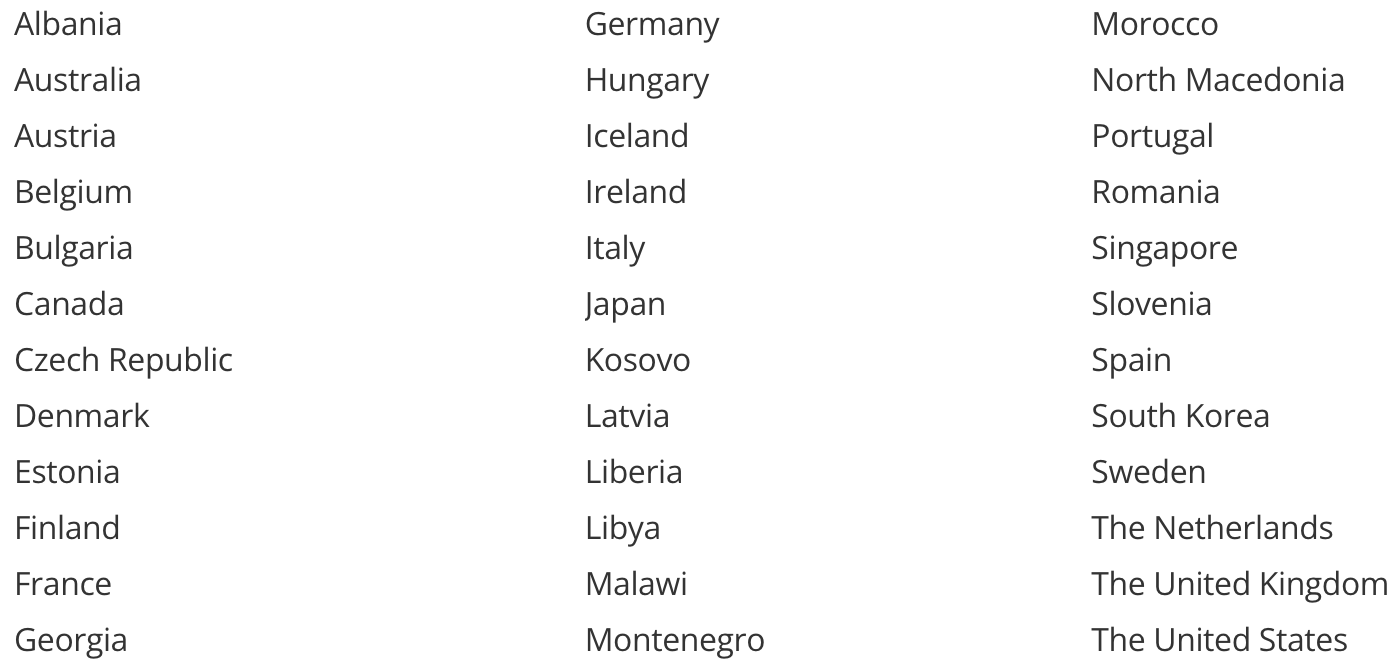

Dette er landene som har lovet å støtte initiativet.

Kina og Russland er ikke med på denne listen. Kina sluttet seg til Bletchley-erklæringenog lovet sin prinsipielle støtte til en trygg utvikling av kunstig intelligens generelt.

Russlands og Kinas beslutning om ikke å slutte seg til erklæringen om militær KI kan ha mer å gjøre med forfatterne av dokumentet enn med deres syn på innholdet i det.

Et annet hull på listen etterlates av to land som for tiden mottar milliarder i militær støtte fra noen av de støttende statene, nemlig Israel og Ukraina.

Som USAs allierte er deres beslutning om ikke å støtte løftet mer sannsynlig fordi begge landene for tiden bruker kunstig intelligens i konfliktene de er involvert i.

Israel bruker kunstig intelligens i ulike militære applikasjoner, blant annet i sin Jernkuppelen system. Ukraina har skapt kontroverser med sitt Autonome AI-droner som retter seg mot soldater og militært utstyr i konflikten med Russland.

Hva forplikter de seg til?

Hvis du vil lese alle detaljene om hva signatarene forplikter seg til kan du gjøre det her.

Her er kortversjonen, som kanskje ofrer litt substans for å fatte seg i korthet:

- Sørg for at Forsvaret ditt tar i bruk disse AI-prinsippene.

- Den militære AI-bruken må være i samsvar med folkeretten og beskytte sivile.

- Toppledelsen må styre utviklingen og utplasseringen av militær AI.

- Proaktivt minimere utilsiktede skjevheter i militære AI-kapasiteter.

- Vær forsiktig når du lager eller bruker AI-våpen.

- Sørg for at AI-forsvarsteknologien din er gjennomsiktig og kontrollerbar.

- Gi opplæring til dem som bruker eller godkjenner bruken av militære AI-kapasiteter, slik at de ikke stoler blindt på AI-en når den tar feil.

- Definer tydelig hva du planlegger å gjøre med den militære AI-teknologien din, og design den slik at den bare gjør det.

- Fortsett å teste selvlærende og kontinuerlig oppdatere militære AI-funksjoner for å se om de fortsatt er trygge.

- Ha en av-knapp i tilfelle AI-våpenet ditt oppfører seg dårlig.

Dette er prisverdige idealer, men det er tvilsomt om forsvarsorganisasjonene har teknologiske eller logistiske muligheter til å gjennomføre dem.

Vil de kunne håndheves? Signering av løftet er en bekreftelse på prinsipiell tilslutning, men innebærer ingen juridisk forpliktelse.

Å signere et dokument der det står: "Vi skal være forsiktige når vi bruker kunstig intelligens i militæret vårt", innebærer også at landet har til hensikt å bruke kunstig intelligens som et våpen, om enn på en "ansvarlig og etisk" måte.

Disse landene erkjenner i det minste at kunstig intelligens har potensial til å forsterke skadene som konvensjonelle våpen allerede forårsaker. Har dette rammeverket gjort verden litt tryggere, eller har det bare rettet søkelyset mot det som uunngåelig ligger foran oss?