OpenAI a annoncé qu'elle utiliserait la norme C2PA pour ajouter des métadonnées aux images générées par DALL-E 3.

Cette annonce intervient alors que les entreprises continuent de chercher des moyens d'empêcher que leurs produits d'IA générative ne soient utilisés pour diffuser de la désinformation.

C2PA est une norme technique ouverte qui ajoute des métadonnées à une image, notamment son origine, l'historique des modifications et d'autres informations. OpenAI indique que les images générées à l'aide de DALL-E 3 directement, ou via ChatGPT ou son API, incluront désormais des données C2PA. Les utilisateurs de mobiles verront cette mesure mise en œuvre dès le 12 février.

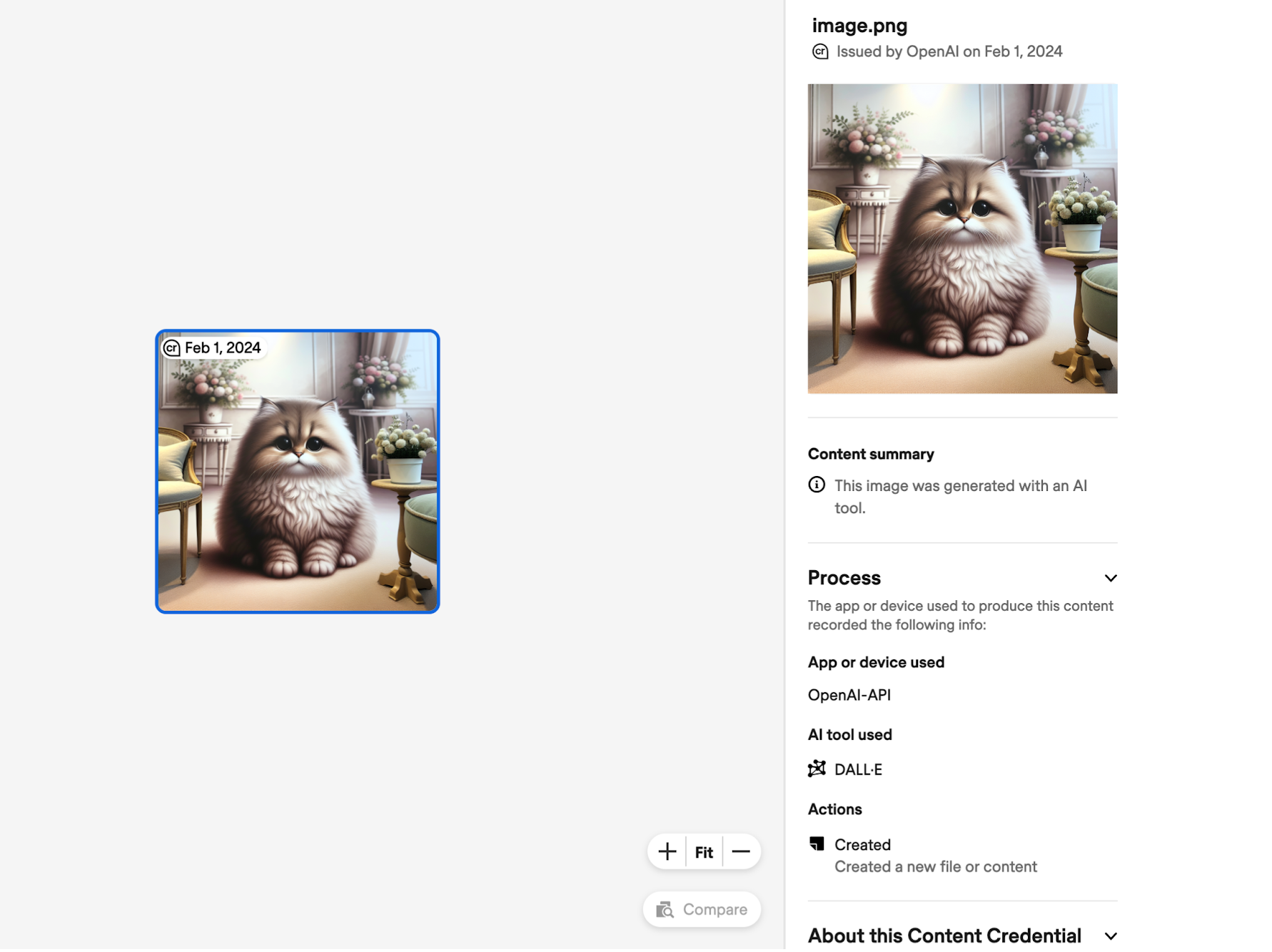

Une image à laquelle ont été ajoutées des métadonnées C2PA peut être téléchargée sur des sites tels que Vérification des informations d'identification du contenu pour vérifier la provenance de l'image. Voici un exemple des informations que C2PA révèle sur une image réalisée avec DALL-E via l'API.

Les plateformes de médias sociaux pourraient également utiliser ces données pour signaler et étiqueter les images générées par l'IA. Meta a récemment annoncé qu'elle ferait un effort plus important dans ce sens.

L'ajout des données C2PA augmente la taille du fichier, avec des estimations d'OpenAI citées à titre d'exemple :

- 3,1MB → 3,2MB pour PNG via API (augmentation de 3%)

- 287k → 302k pour WebP via API (augmentation de 5%)

- 287k → 381k pour WebP via ChatGPT (augmentation de 32%)

L'OpenAI reconnaît que "C2PA n'est pas une solution miracle pour résoudre les problèmes de provenance". Les métadonnées sont facilement supprimées, souvent involontairement.

Si vous faites une capture d'écran de l'image, les données C2PA ne sont pas conservées. Même la conversion d'une image de PNG en JPG détruit la plupart des métadonnées. La plupart des plateformes de médias sociaux suppriment les métadonnées des images lorsqu'elles sont téléchargées.

L'OpenAI explique qu'en ajoutant le C2PA aux images de DALL-E, elle espère encourager "les utilisateurs à reconnaître que ces signaux sont essentiels pour accroître la fiabilité des informations numériques".

C'est peut-être le cas dans une certaine mesure, mais le fait que la C2PA soit si facile à supprimer n'est pas d'une grande aide lorsqu'une personne veut intentionnellement utiliser une image pour induire en erreur. Au contraire, cela ne fera que ralentir un peu les fraudeurs.

Filigrane numérique SynthID de Google semble être une solution bien plus sûre, mais il est peu probable qu'OpenAI utilise un outil créé par ses concurrents.