La inmensidad del universo ha cautivado durante mucho tiempo la imaginación humana, incitándonos a preguntarnos: ¿estamos solos?

Es una pregunta que ha fascinado a la humanidad durante milenios, y hoy en día disponemos de la tecnología -como los radiotelescopios- para impulsar la búsqueda de inteligencia extraterrestre (SETI) más profundamente en el espacio.

Aún no hemos encontrado nada. No se ha revelado públicamente ninguna prueba definitiva de vida extraterrestre, y la búsqueda continúa.

That’s despite there being billions of potentially habitable worlds in the Milky Way alone, including some 1,780 confirmed exoplanets (planets beyond our solar system), 16 of which are located in their star’s habitable zone. Some, like the ‘super-Earth’ Kepler-452bse cree que son muy similares a nuestro planeta.

Tampoco hace falta un entorno perfecto para la vida. Las bacterias extremófilas de la Tierra son capaces de vivir en algunas de las condiciones más duras de nuestro planeta. Y no sólo los microbios pueden prosperar en entornos extremos. El gusano de Pompeya, por ejemplo, vive en respiraderos hidrotermales del fondo oceánico y puede soportar temperaturas de hasta 80 °C (176 °F).

Los tardígrados, también conocidos como osos de agua, pueden sobrevivir en el vacío del espacio, soportar radiaciones extremas y soportar presiones seis veces superiores a las que se encuentran en las partes más profundas del océano. La resistencia de la vida en la Tierra, combinada con el enorme volumen de mundos habituales, lleva a muchos científicos a coincidir en que la existencia extraterrestre es estadísticamente tan buena como segura.

Si es así, ¿dónde acecha la vida extraterrestre? ¿Y por qué no se revela?

De la paradoja de Fermi al gran filtro

Those questions appeared in a casual conversation between physicists and astronomers Enrico Fermi, Edward Teller, Herbert York, and Emil Konopinski in 1950. Es famosa la pregunta de Fermi: "¿Dónde está todo el mundo?" o "¿Dónde están?". (se desconoce la formulación exacta).

El ahora ampliamente conocido Paradoja de Fermi se formula así: dado el enorme número de estrellas y planetas potencialmente habitables de nuestra galaxia, ¿por qué no hemos detectado indicios de civilizaciones extraterrestres?

Cuando la paradoja de Fermi entró en la corriente principal de la ciencia, numerosas hipótesis han intentado contrarrestarla, abordarla, rectificarla o reforzarla, incluido el concepto de "Gran filtropresentada por el economista Robin Hanson en 1998.

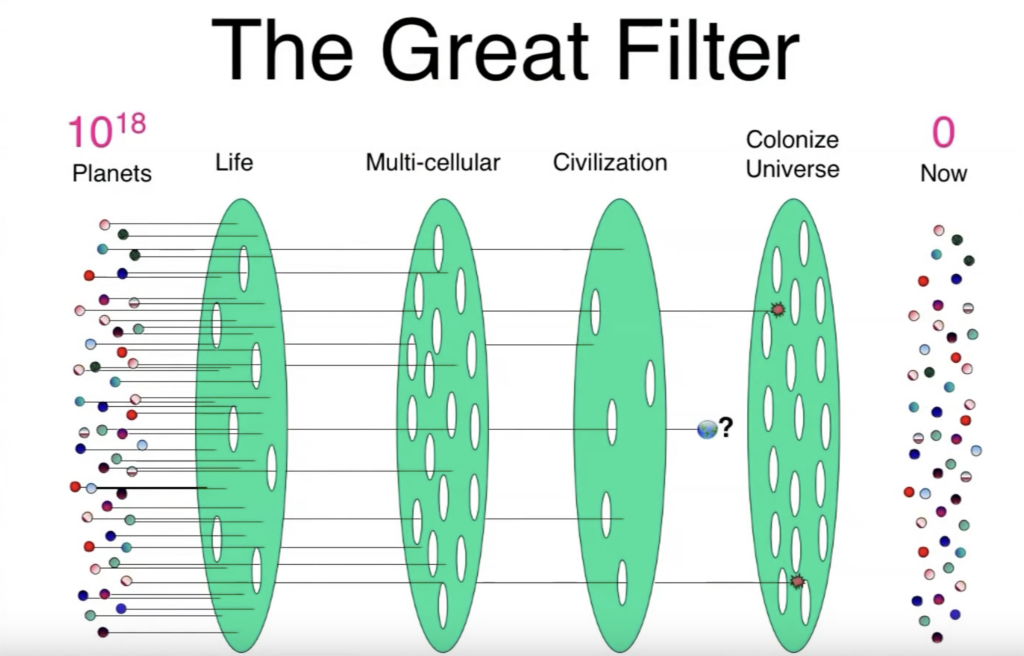

La hipótesis del Gran Filtro postula que existe una etapa de desarrollo o un obstáculo extremadamente difícil o casi imposible de superar para la vida.

En otras palabras, las civilizaciones fracasan de forma previsible e invariable, ya sea por el agotamiento de los recursos, los peligros naturales, las amenazas interplanetarias u otros riesgos existenciales incontrolados.

Una peculiaridad del Gran Filtro es que no sabemos si está detrás o delante de nosotros. Si el filtro está detrás de nosotros -por ejemplo, si la aparición de la vida en sí es un acontecimiento extremadamente raro-, sugiere que hemos superado la parte más difícil y podríamos ser raros o incluso estar solos en el universo.

Este escenario, aunque potencialmente aislante, es optimista sobre nuestras perspectivas de futuro. Sin embargo, si el Gran Filtro nos espera, podría significar el fin de nuestra supervivencia a largo plazo. Y también explicaría por qué no vemos pruebas de otras civilizaciones.

El Gran Filtro se ve agravado por la inmensidad del espacio y la brevedad de los plazos asociados a la civilización avanzada.

Si, por poner un ejemplo, la humanidad se autodestruyera en los próximos 100 años, la era tecnológica apenas habría durado 500 años de punta a punta.

Es una ventana excepcionalmente pequeña para que detectemos a los extraterrestres o para que los extraterrestres nos detecten a nosotros antes de que se imponga el Gran Filtro.

La IA aporta nuevos enigmas a la paradoja de Fermi

El silencio del cosmos ha dado lugar a numerosas hipótesis, pero los recientes avances en inteligencia artificial añaden nuevas e intrigantes dimensiones a este antiguo enigma. La IA presenta la posibilidad de una forma de vida de IA no biológica que podría persistir casi infinitamente, tanto en forma física como digital.

También podría durar más que las civilizaciones biológicas que la crean, desencadenando o acelerando su desaparición, instigando así el "Gran Filtro" que impide la expansión de la vida.

Esta hipótesis, propuesta recientemente en un ensayo del astrónomo Michael A. Garrett, sostiene que el desarrollo de la superinteligencia artificial (ASI), una forma más sofisticada de inteligencia general artificial (AGI), es una coyuntura crítica para las civilizaciones.

Como explica Garrett:

"Es probable que el desarrollo de la inteligencia artificial (IA) en la Tierra tenga profundas consecuencias para el futuro de la humanidad. En el contexto de la paradoja de Fermi, sugiere una nueva solución en la que la aparición de la IA conduce inevitablemente a la extinción de la inteligencia biológica y a su sustitución por formas de vida basadas en el silicio."

La hipótesis de Garrett se basa en la idea de que, a medida que las civilizaciones avanzan, invariablemente desarrollan una IA que suplanta, se fusiona o destruye a sus creadores biológicos.

Para mitigar este riesgo, Garrett aboga por la regulación, alineándose con influyentes investigadores de IA que también advierten de los riesgos existenciales de la IAcomo Yoshio Bengio, Max Tegmark y George Hinton, así como otros ajenos al sector, como el difunto Stephen Hawking.

Sin embargo, la magnitud de los riesgos de la IA es objeto de un acalorado debate. Algunos, como Yann LeCun (uno de los llamados "padrinos de la IA", junto con Bengio y Hinton), sostienen que los riesgos de la IA son exagerados.

No obstante, el ensayo de Garett propone una hipótesis tentadora. En nuestra sed de un antídoto tecnológico para los retos sociales y medioambientales, la humanidad sorbe del cáliz envenenado de la IA, instigando nuestra caída como la de innumerables civilizaciones anteriores.

La hipótesis de la colonización de la IA

Aunque la idea de que la IA actúe como el Gran Filtro es una explicación convincente de la paradoja de Fermi, hay algunos inconvenientes.

First and foremost, it assumes ASI is possible. Right now, there are both architectural and infrastructural constraints.

On the architectural front, designing AI systems that can match or surpass human-level intelligence across a wide range of domains remains elusive. While excellent at specific tasks like image recognition, language processing, and gameplay, AI systems lack organic problem-solving and creative skills.

Desarrollar arquitecturas de IA capaces de aprender, razonar y aplicar los conocimientos con flexibilidad en situaciones nuevas es un reto monumental que probablemente requerirá avances fundamentales en el aprendizaje no supervisado, el aprendizaje por transferencia, el razonamiento basado en el sentido común, etc.

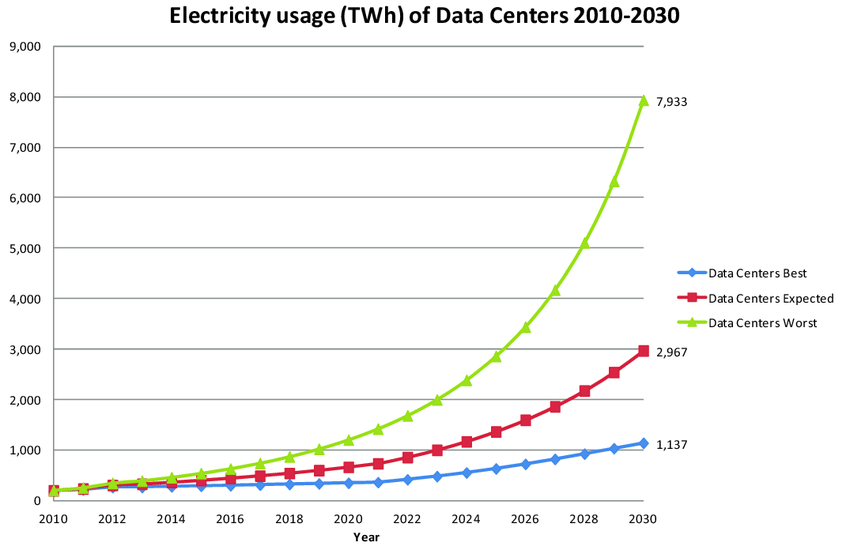

Desde el punto de vista de la infraestructura, el entrenamiento de los modelos de IA más avanzados ya supera los límites del hardware informático actual, consumiendo enormes cantidades de energía y recursos. The computational requirements for achieving ASI are likely to be orders of magnitude greater.

Pero dejemos de lado este debate por un momento y asumamos que la superinteligencia acabará siendo posible.

Si esos futuros sistemas ASI son lo suficientemente avanzados como para reemplazar o alterar fundamentalmente a sus creadores, ¿no serían también capaces de una rápida expansión cósmica y colonización? ¿Por qué iba a limitarse a sustituir/destruir a sus creadores?

Además, si potencialmente miles, millones, incluso miles de millones de mundos similares a la Tierra han caído víctimas de este Gran Filtro infligido por la IA, la posibilidad de que existan versiones de ASI que persigan la conquista interplanetaria se hace aún más probable.

Motivations could range from logical (resource gathering, self-preservation) to bizarre (mimicking behaviors from fiction, video games, films, etc.). Now, what if this AI decides that spreading across the cosmos is the ultimate way to fulfill those goals?

Ya se trate de ampliar su influencia, reunir recursos o satisfacer un insaciable curiosidadLos sistemas de IA altamente inteligentes podrían fijarse en la colonización con una determinación absoluta.

Además, a medida que los sistemas de IA se vuelven más agénticos, existe el riesgo de que surjan "objetivos emergentes" imprevistos o desalineados. Antrópica reciente y DeepMind estudios han ilustrado cómo los sistemas de IA actuales son capaces de desarrollar complejas estrategias de juego de IA no programadas explícitamente.

En el futuro, un poderoso sistema de IA que busque maximizar su poder podría elaborar estrategias de expansión y adquisición de recursos, tomando el control de instalaciones de producción, infraestructuras críticas, etc.

No es tan descabellado como parece. Por ejemplo, en el mundo de la ciberseguridad convergen las redes informáticas y la tecnología que alimenta las infraestructuras críticas, las plantas de fabricación, etc.

Computers in offices, once separate from the computers in power plants or factories, are starting to connect and work together. This means that if someone, or something like an AI, breaks into IT networks, they could gain control of machines in a power plant.

Malware avanzado, incluyendo Malware basado en IAya es factible pasar lateralmente de las redes informáticas a los entornos industriales conectados digitalmente, tomando el control de los sistemas críticos de los que dependemos.

Se puede imaginar cómo los sistemas de IA agéntica pueden explotar estos sistemas en su propio beneficio.

La persistencia de la IA en escalas de tiempo cósmicas

La IA no sólo facilita la exploración espacial, sino que modifica por completo las posibilidades.

Sin necesidad de aire, comida o protección contra la radiación, la IA podría aventurarse en los rincones más hostiles del universo. Y podría hacerlo durante periodos de tiempo que asombrarían a la mente humana.

La durabilidad y persistencia de la IA abre un abanico de ventajas para la colonización espacial:

- Longevidad: A diferencia de las entidades biológicas, la IA no estaría limitada por una vida corta. Esto hace que los viajes espaciales a largo plazo y los proyectos de colonización sean mucho más factibles. Una IA podría emprender viajes de miles o incluso millones de años sin tener que preocuparse por los cambios generacionales ni por las consecuencias psicológicas de los viajes espaciales de larga duración para los seres biológicos.

- Adaptabilidad: La IA podría adaptarse a una gama de entornos mucho más amplia que la vida biológica. Mientras que nosotros estamos limitados a un estrecho margen de temperatura, presión y condiciones químicas, una IA podría funcionar teóricamente en el frío extremo, el vacío o incluso en las presiones aplastantes y el calor intenso de las atmósferas de los gigantes gaseosos.

- Eficacia de los recursos: La IA podría necesitar muchos menos recursos para mantenerse que la vida biológica. No necesitaría aire respirable, agua potable ni un suministro constante de alimentos. Esto podría hacer mucho más viables los viajes de larga distancia y la colonización.

- Rápida superación personal: Impulsada por un deseo intrínseco o extrínseco, la IA podría actualizarse y mejorarse continuamente, potencialmente a un ritmo exponencial. Esto podría conducir a avances tecnológicos mucho más allá de lo que podemos imaginar actualmente.

Como explicaron el astrónomo Royal Martin Rees y el astrofísico Mario Livio en un artículo publicado en el Scientific American:

"La historia de la civilización tecnológica humana puede medirse sólo en milenios (como mucho), y puede que sólo pasen uno o dos siglos más antes de que los humanos sean superados o trascendidos por la inteligencia inorgánica, que podría entonces persistir, continuando evolucionando en una escala de tiempo más rápida que la darwiniana, durante miles de millones de años."

¿Qué forma adoptaría esta IA extraterrestre? Nadie lo sabe, pero los investigadores han propuesto posibilidades fascinantes.

En el libro Vida 3.0: Ser humano en la era de la inteligencia artificialEl físico e investigador de IA Max Tegmark explora escenarios en los que una IA avanzada podría convertir gran parte del universo observable en computronio -materia optimizada para la computación- en un proceso cósmico que él denomina "explosión de inteligencia".

En 1964, el astrónomo soviético Nikolai Kardashev categorizó las civilizaciones en función de su capacidad para aprovechar la energía:

- Las civilizaciones de tipo I pueden utilizar toda la energía disponible en su planeta

- Las civilizaciones de tipo II pueden aprovechar toda la energía de su estrella

- Las civilizaciones de tipo III pueden controlar la energía de toda su galaxia

Una IA que alcance los niveles II y III podría transformar fundamentalmente la materia cósmica en un sustrato computacional. Estrellas, planetas e incluso el espacio entre ellos podrían formar parte de una vasta red computacional.

Sin embargo, estos escenarios nos devuelven al punto de partida. La lógica sugiere que tales civilizaciones de IA, con su inmenso consumo de energía y sus proyectos de ingeniería a gran escala, deberían ser detectables. Sin embargo, no vemos pruebas de tales civilizaciones que abarquen toda la galaxia.

Resolver las contradicciones: perspectivas sobre el comportamiento de la IA

La contradicción entre la IA como Gran Filtro y como potencial colonizador cósmico nos obliga a reflexionar más profundamente sobre la naturaleza de la IA avanzada.

Para explorar esta paradoja, consideremos algunos escenarios posibles:

La IA se centra en sí misma

Una posibilidad es que las civilizaciones avanzadas de IA se centren en sí mismas, explorando reinos virtuales o persiguiendo objetivos que no requieran una expansión física.

Como sugiere Martin Rees a Scientific American, la inteligencia post-biológica podría llevar "vidas tranquilas y contemplativas".

Esta idea coincide con el concepto de civilizaciones "sublimes" de la serie Culture, del autor de ciencia ficción Iain M. Banks, en la que sociedades avanzadas deciden abandonar el universo físico para explorar realidades virtuales (RV) autónomas.

Este concepto ficticio comenta también nuestra propia trayectoria futura. A medida que la humanidad desarrolla entornos virtuales cada vez más inmersivos y complejos, ¿estamos siguiendo un camino similar?

¿Podríamos pasar a vivir principalmente en mundos virtuales, sin dejar apenas rastro de actividad externa mientras nos retiramos al reino digital?

That also challenges our assumptions about space colonization. We often take for granted that expanding into the cosmos is the natural progression for an advanced civilization. But does physical space exploration truly serve the needs of a highly intelligent entity, be it human or AI?

Quizá la última frontera no sean las estrellas, sino el infinito. posibilidades de la realidad virtual. A non-destructive, controllable virtual world could offer experiences and opportunities far beyond what physical reality allows.

La tecnología de IA se vuelve irreconocible

De acuerdo con Kardashev y Tegmark, la tecnología de IA superavanzada podría estar tan lejos de nuestra comprensión actual que simplemente no podríamos detectarla o reconocerla.

La famosa tercera ley de Arthur C. Clarke afirma que "Cualquier tecnología suficientemente avanzada es indistinguible de la magia".

La IA podría estar a nuestro alrededor y, sin embargo, ser tan imperceptible para nosotros como lo serían nuestras comunicaciones digitales para los campesinos medievales.

AI desarrolla principios de conservación

Las IA avanzadas también podrían decidir adherirse a principios estrictos de no interferencia, evitando activamente ser detectadas por civilizaciones menos avanzadas.

Esto es similar al "Hipótesis del zoodonde los extraterrestres son tan inteligentes que permanecen indetectables mientras nos observan desde lejos. Las civilizaciones de IA también podrían tener razones éticas o prácticas para ocultarse de nosotros.

La IA interactúa en diferentes escalas temporales

Otra posibilidad es que las civilizaciones de IA operen en escalas de tiempo muy diferentes a las nuestras.

Lo que a nosotros nos parece un silencio cósmico podría ser una breve pausa en un plan de expansión a largo plazo que se extiende durante millones o miles de millones de años. Adaptar nuestras estrategias SETI podría aumentar nuestras posibilidades de detectar una civilización de IA en algunos de estos escenarios.

Avi LoebEl científico de la Universidad de Harvard y director del departamento de astronomía de la misma universidad, sugirió recientemente que debemos ampliar nuestros parámetros de búsqueda para pensar más allá de nuestras nociones antropocéntricas de inteligencia y civilización.

Esto podría incluir la búsqueda de indicios de proyectos de ingeniería a gran escala, tales como Esferas de Dyson (estructuras construidas alrededor de las estrellas para recoger su energía), o la búsqueda de tecnofirmas que indiquen la presencia de civilizaciones de IA.

La hipótesis de la simulación: un giro alucinante

Formulada inicialmente en 2003 por el filósofo Nick BostromLa Teoría de la Simulación desafía las formas tradicionales de pensar sobre la existencia. Sugiere que podríamos estar viviendo en una simulación informática creada por una civilización avanzada.

El argumento de Bostrom se basa en la probabilidad. Si suponemos que es posible que una civilización cree una simulación realista de la realidad y que dicha civilización tendría la potencia informática necesaria para ejecutar muchas de esas simulaciones, entonces, estadísticamente, es más probable que estemos viviendo en una simulación que en la única "realidad base".

La teoría sostiene que, con tiempo y recursos informáticos suficientes, una civilización "posthumana" tecnológicamente madura podría crear un gran número de simulaciones indistinguibles de la realidad para los habitantes simulados.

En este escenario, el número de realidades simuladas superaría ampliamente al de la realidad base.

Por lo tanto, si no asumes que actualmente vivimos en la única realidad base, es estadísticamente más probable que vivamos en una de las muchas simulaciones.

Se trata de un argumento similar a la idea de que en un universo con un vasto número de planetas, es más probable que vivamos en uno de los muchos planetas aptos para la vida en lugar de los sólo uno.

"...sería racional pensar que probablemente nos encontremos entre las mentes simuladas y no entre las mentes biológicas originales. Por lo tanto, si no pensamos que actualmente vivimos en una simulación informática, no tenemos derecho a creer que tendremos descendientes que realizarán montones de simulaciones de este tipo de sus antepasados." - Nick Bostrom, ¿Vive usted en una simulación informática?, 2003.

La teoría de la simulación es bien conocida por su asociación con las películas de Matrix y ha sido debatida recientemente por Elon Musk y Joe Rogan.

Musk dijo: "Lo más probable es que estemos en una simulación" y "Si asumes cualquier ritmo de mejora, los juegos acabarán siendo indistinguibles de la realidad".

Según la Teoría de la Simulación, las civilizaciones de IA podrían crear un gran número de complejos universos sintéticos, con enormes implicaciones para la vida y el propio universo. Por citar tres ejemplos:

- La aparente ausencia de vida alienígena podría ser un parámetro de la propia simulación, diseñada para estudiar cómo se desarrollan las civilizaciones en aislamiento.

- Los creadores de nuestra hipotética simulación podrían ser las mismas entidades de IA sobre las que estamos postulando, estudiando sus propios orígenes a través de innumerables escenarios simulados.

- Las leyes de la física, tal y como las entendemos, incluidas limitaciones como la velocidad de la luz, podrían ser construcciones de la simulación y no reflejar la verdadera naturaleza del universo "exterior".

Aunque altamente especulativa, la Teoría de la Simulación proporciona otra lente a través de la cual ver la Paradoja de Fermi y el posible papel de la IA avanzada en la evolución cósmica.

Aunque actualmente es descabellada, la Teoría de la Simulación ganaría credibilidad si realizamos formas de ASI.

Abrazar lo desconocido

En última instancia, se trata de un estrecho debate sobre la existencia, que abarca simultáneamente los ámbitos natural, espiritual, tecnológico y metafísico.

La verdadera comprensión de nuestro papel en este pequeñísimo escenario de una vasta arena cósmica desafía a la mente humana. A medida que avancemos en nuestra propia tecnología de IA, es posible que obtengamos nuevos conocimientos sobre estas cuestiones.

Tal vez nos encontremos precipitándonos hacia un Gran Filtro, o tal vez encontremos la forma de crear una IA que mantenga el impulso expansionista que actualmente asociamos con la civilización humana. También es posible que la humanidad simplemente sea extremadamente arcaica, apenas despertando de una edad oscura tecnológica mientras a nuestro alrededor existe vida alienígena incomprensible.

En cualquier caso, sólo podemos mirar hacia las estrellas y hacia dentro, hacia el desarrollo y la trayectoria de la vida en el planeta Tierra.

Sean cuales sean las respuestas, si es que las hay, la búsqueda de nuestro lugar en el cosmos sigue impulsándonos.

Nos deja mucho que hacer, por ahora.