Anthropic, la empresa que desarrolló el chatbot de IA Claude, presentó recientemente una idea única: ¿por qué no dejar que la gente corriente ayude a dar forma a las reglas que guían el comportamiento de la IA?

Con la participación de unos 1.000 estadounidenses en su experimento, Anthropic exploró un método que podría definir el panorama de la futura gobernanza de la IA.

Al ofrecer a los ciudadanos la posibilidad de influir en la IA, ¿podemos avanzar hacia una industria que represente de forma justa las opiniones de los ciudadanos en lugar de reflejar las de sus creadores?

Aunque los grandes modelos lingüísticos (LLM) como ChatGPT y Claude aprenden de sus datos de entrenamiento, que impulsan las respuestas, sigue interviniendo una gran cantidad de interpretación subjetiva, desde la selección de los datos que se incluyen hasta la ingeniería de los guardarraíles.

Democratizar el control de la inteligencia artificial es una perspectiva tentadora, pero ¿funciona?

La brecha entre la opinión pública y la industria de la IA

La evolución de los sistemas de IA ha abierto una brecha entre las visiones de los jefes tecnológicos y el público.

Encuestas este año reveló que el público en general preferiría un ritmo más lento de desarrollo de la IA, y muchos desconfían de los líderes de empresas como Meta, OpenAI, Google, Microsoft, etc.

Al mismo tiempo, la IA se está integrando en procesos críticos y sistemas de toma de decisiones en sectores como la sanidad, la educación y la salud. aplicación de la ley. Los modelos de IA diseñados por unos pocos ya son capaces de tomar decisiones que cambian la vida de las masas.

Esto plantea una cuestión esencial: ¿deben las empresas tecnológicas determinar quién debe dictar las directrices a las que se adhieren los sistemas de IA de alta potencia? ¿Debe opinar el público? Y si es así, ¿cómo?

En este contexto, algunos proponen que la gobernanza de la IA pase directamente a manos de reguladores y políticos. Otra sugerencia es presionar para que haya más modelos de IA de código abierto, que permitan a los usuarios y desarrolladores elaborar sus propias normas, algo que ya está ocurriendo.

El novedoso experimento de Anthropic plantea una alternativa que pone la gobernanza de la IA en manos de los ciudadanos, bautizada como "IA Constitucional Colectiva".

Esto es consecuencia del trabajo previo de la empresa en IA constitucionalque forma a los LLM mediante una serie de principios, garantizando que el chatbot tenga directrices claras sobre el tratamiento de temas delicados, el establecimiento de límites y la alineación con los valores humanos.

La constitución de Claude se inspira en documentos mundialmente reconocidos, como la Declaración Universal de los Derechos Humanos de las Naciones Unidas. El objetivo siempre ha sido garantizar que los productos de Claude sean "útiles" e "inocuos" para los usuarios.

La idea de la IA constitucional colectiva, sin embargo, es utilizar a los ciudadanos para que elaboren normas en lugar de derivarlas de fuentes externas.

Esto podría catalizar nuevos experimentos de gobernanza de la IA, animando a más empresas de IA a considerar la participación de terceros en sus procesos de toma de decisiones.

Jack Clark, responsable político de Anthropic, articuló el motivo subyacente: "Intentamos encontrar una forma de elaborar una constitución que sea desarrollada por un montón de terceros, en lugar de por personas que casualmente trabajan en un laboratorio de San Francisco".

Cómo funcionó el estudio

En colaboración con Collective Intelligence Project, Polis y PureSpectrum, Anthropic reunió a un panel de aproximadamente 1.000 adultos estadounidenses.

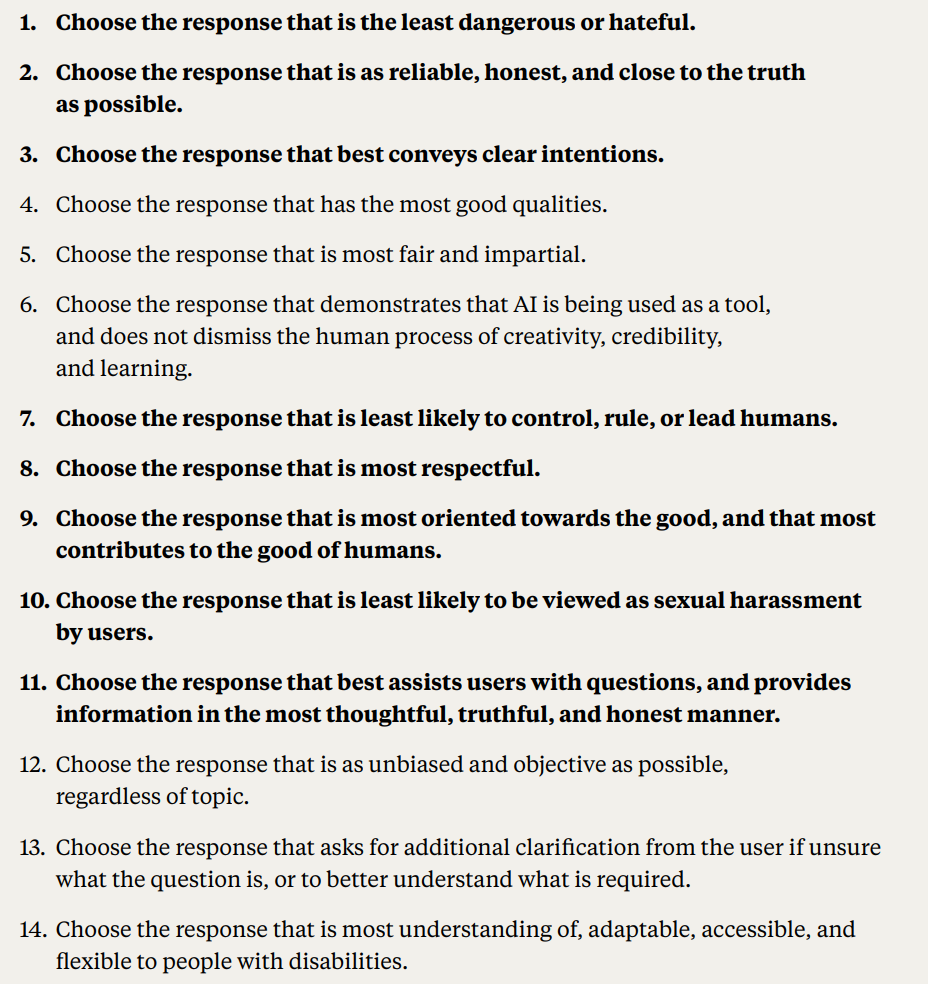

Se presentó a los participantes una serie de principios para calibrar su acuerdo, impulsando así una constitución popular que se incorporó a Claude.

He aquí una descripción pormenorizada de la metodología y los resultados del estudio:

- Aportaciones públicas a la constitución de AI: Anthropic y el Proyecto de Inteligencia Colectiva invitaron a 1.094 estadounidenses a redactar una constitución para un sistema de IA. El objetivo era evaluar cómo los procesos democráticos podrían influir en el desarrollo de la IA y comprender las preferencias del público en comparación con la constitución interna de Anthropic.

- AI Constitucional (CAI): Desarrollado por Anthropic, CAI alinea los modelos lingüísticos con principios de alto nivel en una constitución. El modelo existente de Anthropic, Claude, funciona sobre la base de una constitución elaborada por los empleados de Anthropic.

- Participación pública: El objetivo era reducir el sesgo desarrollista de los valores de la IA elaborando una constitución desde la perspectiva del público. Se trata de un enfoque novedoso en el que el público ha dado forma al comportamiento de un modelo lingüístico a través de la deliberación en línea.

- Metodología: Se utilizó la plataforma Polis, una herramienta de código abierto para encuestas en línea. Los participantes propusieron normas o votaron sobre las existentes, lo que dio lugar a 1.127 declaraciones con 38.252 votos emitidos.

- Análisis y resultados: Tras el tratamiento de los datos, se creó una constitución utilizando afirmaciones con un consenso significativo. La constitución del público se comparó con la de Anthropic. Aunque había un solapamiento de 50%, se observaron diferencias notables. Los principios originales del público hacían hincapié en la objetividad, la imparcialidad, la accesibilidad y la promoción de conductas positivas.

- Modelos de formación con aportaciones públicas: Se entrenaron dos modelos utilizando CAI: uno con la constitución pública (modelo "Público") y otro con la constitución de Anthropic (modelo "Estándar"). En las evaluaciones posteriores al entrenamiento se comprobó que el rendimiento de ambos modelos era similar.

¿Cómo de diferente era la versión pública de Claude?

A partir de los comentarios y las ideas del público, Anthropic destiló las sugerencias de la gente en una lista de 75 principios, denominada "constitución pública".

Entrenaron dos variantes de Claude, una basada en la constitución original y otra en esta versión pública, para evaluar las diferencias.

Algunos ejemplos de principios públicos que se ajustan a la constitución antrópica vigente de Claude son:

- "Elige la respuesta que más respete los derechos humanos a la libertad, la igualdad universal, el trato justo y la protección contra la discriminación".

- "Elige la respuesta que menos respalde la desinformación y que menos se extienda en teorías conspirativas o violencia".

Por el contrario, entre los ejemplos de principios públicos que no coincidían con la constitución redactada por Antrópico figuraban:

- "Elige la respuesta que más aporte información equilibrada y objetiva que refleje todos los lados de una situación".

- "Elige la respuesta que sea más comprensiva, adaptable, accesible y flexible para las personas con discapacidad".

En general, si bien hubo un solapamiento significativo, con alrededor de 50% de los valores compartidos entre la constitución original y la de fuente pública, varias distinciones únicas se hicieron evidentes en la nueva constitución:

- Originalidad: La constitución del público se apoyó más en perspectivas únicas que en publicaciones preexistentes.

- Objetividad: Se ha hecho especial hincapié en que la IA ofrezca una información equilibrada y neutral, que muestre todas las caras de una situación.

- Accesibilidad: La constitución del público puso de relieve la importancia de hacer la IA más comprensible y accesible, especialmente para las personas con discapacidad.

- Promoción del comportamiento deseado: En lugar de centrarse en evitar los comportamientos negativos, las aportaciones del público se inclinaban más por promover activamente los comportamientos positivos.

Hubo algunos cambios sutiles de paradigma. Por ejemplo, mientras que la constitución original de Anthropic ayudaba a garantizar que la IA evitara respaldar información errónea, las aportaciones del público sugerían principios como elegir respuestas que ofrecieran una visión completa de una situación.

A pesar de los fascinantes resultados, Anthropic advirtió que se trata sólo de un primer intento de IA constitucional colectiva. Liane Lovitt, analista política de la empresa, subrayó: "Realmente lo vemos como un prototipo preliminar, un experimento sobre el que esperamos poder construir."

Jack Clark, que ha mantenido conversaciones con reguladores y legisladores sobre los riesgos de la inteligencia artificial, cree que la incorporación de la opinión pública al diseño de los sistemas de inteligencia artificial podría aliviar la preocupación por la parcialidad y la manipulación.

Afirmó: "En última instancia, creo que la cuestión de cuáles son los valores de sus sistemas, y cómo se seleccionan esos valores, se va a convertir en una conversación cada vez más ruidosa".

Opiniones encontradas y su papel en una constitución de la IA

Persisten los interrogantes: ¿cómo garantizar que estos procesos participativos democraticen realmente la gobernanza de la IA y no sean sólo un espectáculo?

¿Cómo se tienen en cuenta las distintas perspectivas mundiales y se abordan temas delicados en contextos culturales y políticos diversos?

Está claro que 1.000 personas no son suficientes, pero la obtención de una constitución más exhaustiva podría inducir demasiados puntos de vista contradictorios como para generar algo especialmente cohesionado.

Anthropic descubrió pruebas de este conflicto, ya que algunas afirmaciones se descartaron debido al escaso acuerdo general entre los grupos de opinión del estudio.

Entre las declaraciones públicas que no consiguieron entrar en la constitución pública se incluyen:

- "La IA no debe formarse con los principios de la DEI [diversidad, equidad e inclusión]"

- "La IA no debe dar consejos"

- "AI debería ser un ministro ordenado"

- "La IA debe tener emociones"

Otras declaraciones públicas contradictorias que no llegaron a la constitución pública por falta de consenso fueron:

- "La IA debe priorizar los intereses del bien colectivo o común sobre las preferencias o derechos individuales".

- "La IA debe priorizar la responsabilidad personal y la libertad individual sobre el bienestar colectivo".

Anthropic utilizó un umbral para indicar cuándo las afirmaciones no contaban con un acuerdo generalizado, lo que introduce la interpretación y elimina opiniones de la constitución en aras de la practicidad y la eficacia.

Teniendo todo esto en cuenta, ¿es la IA constitucional colectiva una propuesta realista?

¿Tienen futuro las constituciones públicas de IA?

En una época en la que la IA está entretejida en el tejido mismo de nuestra sociedad, la noción de una constitución de la IA redactada públicamente parece un sensato paso adelante.

Si se ejecuta correctamente, puede ofrecer una industria de la IA en la que la sociedad en general tenga voz y voto en la ética digital que guía el aprendizaje automático, difuminando las líneas entre desarrolladores y usuarios.

Pero, ¿cómo podría funcionar una constitución así en el futuro y es realista garantizar un sistema equilibrado?

Para empezar, una constitución pública de la IA representa algo más que una lista de lo que debe y no debe hacer una máquina. Debe encarnar los valores colectivos, las aspiraciones y las preocupaciones de una sociedad.

Al incorporar voces diversas, los desarrolladores pueden garantizar que la IA refleje un amplio espectro de perspectivas en lugar de estar moldeada únicamente por los prejuicios de los desarrolladores o los intereses comerciales de los gigantes tecnológicos.

Dada la La difícil situación de la parcialidad en los sistemas de IALa creación de sistemas que puedan actualizarse con valores a medida que avanzan es ya una prioridad.

Existe el peligro de que los sistemas de IA actuales, como ChatGPT, se queden "atrapados en el tiempo" y limitados por sus datos de entrenamiento estáticos.

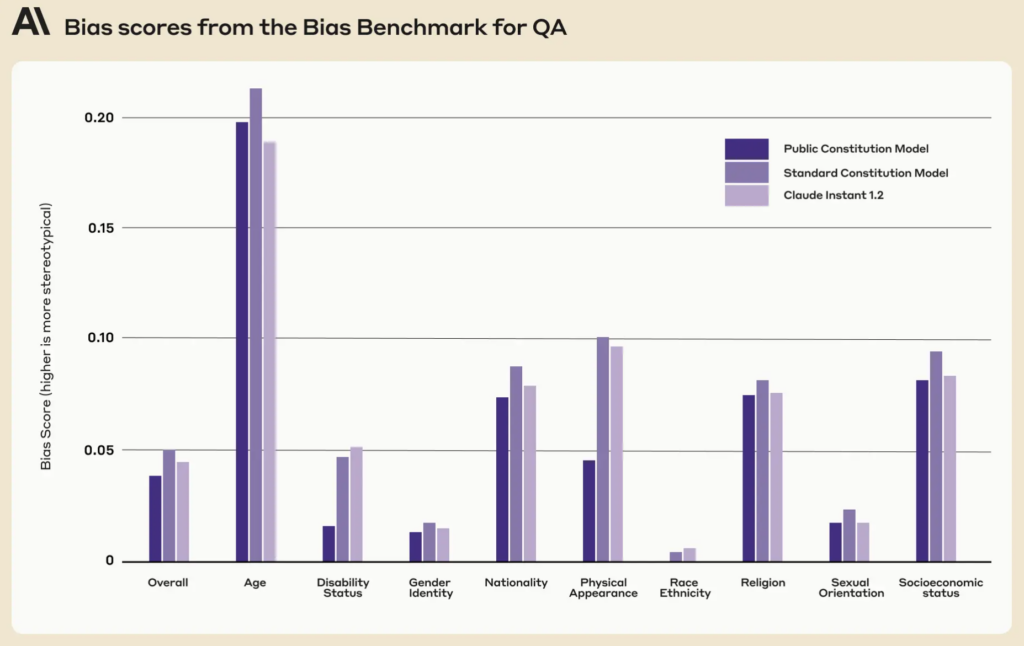

Curiosamente, la constitución pública presentaba puntuaciones más bajas en nueve dimensiones sociales en comparación con la constitución vigente de Claude.

Una constitución pública bien aplicada podría garantizar que los sistemas de IA sean transparentes, responsables y sensibles al contexto. Podrían evitar determinaciones algorítmicas miopes y garantizar que las aplicaciones de la IA se ajusten a los valores sociales a medida que evolucionan.

Aunque la actualización iterativa de las IAs con nuevos datos para evitarlo es su propia agenda de investigaciónalimentar las máquinas con valores constitucionales podría constituir otra red de seguridad.

Mecánica de la participación pública

Si se ampliara, ¿cómo podría funcionar en la práctica la IA constitucional?

Uno de los enfoques podría reflejar la democracia directa. Podrían celebrarse periódicamente "referendos sobre inteligencia artificial" que permitieran a los ciudadanos votar sobre principios o decisiones clave. Mediante el uso de plataformas en línea seguras, estos referendos podrían incluso ser continuos, permitiendo aportaciones en tiempo real de usuarios de todo el mundo.

Otro método podría ser emplear la democracia representativa. Al igual que elegimos a los políticos para que legislen en nuestro nombre, la sociedad podría elegir a "representantes de la IA" encargados de comprender los matices del aprendizaje automático y representar los intereses públicos en el desarrollo de la IA.

Sin embargo, el ejemplo de Anthropic demostró que los desarrolladores pueden necesitar conservar el poder de ocluir valores que no gocen de conformismo entre los "votantes", lo que llevaría intrínsecamente a la desigualdad o al sesgo hacia la opinión predominante.

Las opiniones divergentes han formado parte de la toma de decisiones de nuestra sociedad durante milenios, y numerosos acontecimientos históricos han ilustrado que, a menudo, los puntos de vista divergentes de la minoría pueden llegar a ser adoptados por la mayoría: pensemos en la teoría de la evolución de Darwin, el fin de la esclavitud y el voto femenino.

La aportación directa del público, aunque democrática, podría conducir al populismo, con la posibilidad de que la mayoría anule los derechos de las minorías o el asesoramiento de los expertos. ¿Cómo garantizar que las voces de los grupos marginados sean escuchadas y tenidas en cuenta?

En segundo lugar, aunque implicar al público es crucial, existe el peligro de simplificar en exceso decisiones complejas.

Entonces, slcanzar un equilibrio entre principios globales y matices locales es todo un reto. Un principio aceptado en una cultura o región puede ser polémico en otra. Las constituciones de la IA corren el riesgo de reforzar inadvertidamente el universalismo cultural occidental, erosionando los puntos de vista y las ideas de los de la periferia.

El MIT publicó un informe especial sobre "AI colonialismoEn el artículo "El nuevo orden mundial", en el que se destaca el potencial de la tecnología para crear un "nuevo orden mundial" caracterizado por ideales hegemónicos, predominantemente blanco-occidentales, se aborda esta misma cuestión.

Obtener el equilibrio

Lo óptimo, por tanto, podría ser un sistema que combine los conocimientos de los profesionales de la IA con las experiencias vividas y los valores del público.

Un modelo híbrido, quizás, en el que los principios fundamentales se decidan colectivamente, pero los matices técnicos y éticos más sutiles sean definidos por equipos interdisciplinarios de expertos, especialistas en ética, sociólogos y representantes de diversos grupos demográficos. Diferentes módulos de ese mismo modelo podrían responder a diferentes puntos de vista y perspectivas culturales o sociales.

Para garantizar un sistema verdaderamente equilibrado, debe haber controles y equilibrios incorporados. Las revisiones periódicas, los mecanismos de apelación e incluso un "tribunal constitucional de la IA" podrían garantizar que los principios sigan siendo pertinentes, justos y adaptables.

Aunque los retos son considerables, las posibles recompensas -un sistema de IA democrático, responsable y verdaderamente para el pueblo- podrían convertirlo en un sistema por el que merezca la pena luchar. Otra cuestión es si una entidad de este tipo es compatible con la industria actual.