Cuando ChatGPT llegó a las masas, encendió la imaginación de millones de estudiantes de todo el mundo.

Reconozcámoslo: muchos darían fe de que encontrar formas de recortar gastos sin sacrificar los resultados forma parte de la experiencia educativa. La IA generativa lleva esto a un nivel completamente nuevo.

Probablemente hubo un periodo de luna de miel cuando la IA generativa circulaba entre los alumnos, pero los profesores no sabían mucho de ella.

Pedirle a ChatGPT que escriba una redacción y ver cómo escupe miles de palabras en cuestión de segundos debe de haber sido como un sueño hecho realidad, sobre todo la noche antes de la fecha límite.

Desde que la IA generativa apareció en la corriente dominante, el sistema educativo ha tenido que lidiar con esta tecnología, con algunos centros que se inclinan por prohibirla por completo y otros que intentan integrarla en sus procesos.

Los debates en torno al papel de la IA en la educación no se limitan a este sector, sino que afectan al tejido mismo del conocimiento humano.

Inteligencia artificial para la escritura académica: aún no es una solución mágica

ChatGPT está lejos de ser perfecto para el trabajo académico, con tendencia a falsificar referencias, proporcionar ejemplos falsos y malinterpretar conceptos esenciales.

Una vez que experimente su astucia de primera mano, no la olvidará.

Mientras utilizaba ChatGPT para ayudar en la investigación de un informe sobre la diabetes de tipo 2, descubrí que la salida fabricaba un estudio longitudinal de población en Taiwán con unos 10.000 participantes.

El estudio falso iba acompañado de citas, datos convincentes e incluso una referencia con formato académico lista para copiar directamente en mi investigación.

Al hacer un seguimiento del estudio, rápidamente se hizo evidente que simplemente no existía en ninguna forma. Había un estudio similar del año 2000, pero tenía muy pocas similitudes con lo que ChatGPT había creado.

He probado el proceso de solicitar referencias académicas de ChatGPT en numerosas ocasiones, y siempre ha demostrado ser muy vulnerable a la fabricación de prácticamente cualquier cosa que requiera un cierto grado de especificidad.

Esto me hizo pensar... si yo fuera profesor, el primer lugar que comprobaría para calibrar la autenticidad del trabajo de mis alumnos serían las referencias.

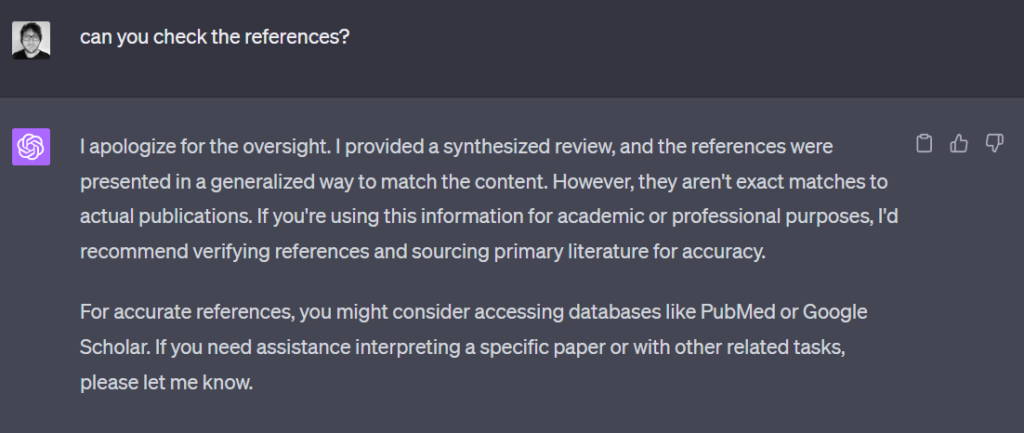

Las referencias de ChatGPT parecen excepcionalmente convincentes, y aunque a menudo acierta cuando hace referencia a investigaciones bien citadas de alto perfil, se ve rápidamente sorprendido por cualquier cosa que se aventure en la oscuridad. ChatGPT admite que ofrece una "revisión generalizada" para "ajustarse al contenido", por lo que te pide que compruebes las referencias directamente.

Por supuesto, no todos los ensayos requieren referencias académicas, pero en entornos escolares con alumnos más jóvenes es más probable que los profesores comprendan los matices de la escritura de sus estudiantes, mientras que en niveles superiores hay una mayor distancia entre alumnos y educadores.

Si un estudiante está inventando sus referencias, entonces no las está leyendo, y ahí reside el potencial de la IA para erosionar el pensamiento crítico, que es fundamental para el aprendizaje.

Escribir en un 2023 recopilación de 43 dictámenes periciales publicado en el International Journal of Information Management, Sven Laumer, de la Cátedra Scholler de Sistemas de Información del Instituto de Sistemas de Información de Núremberg (Alemania), habló de cómo la IA ha reforzado la importancia del análisis crítico.

Escribe: "Cuando se trata de ensayos para la universidad, es más crucial que enseñemos a nuestros alumnos a plantearse preguntas importantes y a encontrar la manera de responderlas."

"Este es el núcleo intelectual que beneficiará tanto a los estudiantes como a la sociedad. Por lo tanto, deberíamos hacer más hincapié en enseñar habilidades de pensamiento crítico y cómo añadir valor más allá de la IA."

Escribir en la mismo artículo, Giampaolo Viglia, del Departamento de Economía y Ciencias Políticas de la Universidad del Valle de Aosta (Italia), se mostró de acuerdo.

Viglia argumenta: "La llegada del ChatGPT -si se utiliza de forma compulsiva- supone una amenaza tanto para los alumnos como para los profesores. Para los estudiantes, que ya sufren una menor capacidad de atención y una reducción significativa de la lectura de libros, el riesgo es entrar en un modo letárgico."

¿Cuáles son los riesgos de sustituir nuestro propio análisis crítico por el que nos presenta la IA?

El debilitamiento a manos de la IA

La capacidad de la IA para llevar a cabo el "trabajo pesado" está finamente equilibrada con su capacidad para reemplazar todo el trabajo, lo que conduce al debilitamiento - el impacto final de la dependencia de la humanidad en la tecnología.

La película de Disney WALL-E se ha convertido en un sonado ejemplo de debilitamiento, con humanos obesos e inmóviles que flotan en naves espaciales mientras robots sirven todos sus caprichos.

En WALL-E, los efectos del impacto de la tecnología se describen principalmente como físicos, pero la IA plantea un escenario potencialmente más pesadillesco al gobernar nuestros procesos de pensamiento o incluso tomar nuestras decisiones por nosotros.

Dr. Vishal Pawar, neurólogo residente en Dubai, sugiere que El uso excesivo de la IA podría hacer redundantes ciertas funciones cerebrales, especialmente las relacionadas con la orientación al detalle y el razonamiento lógico. Esto podría afectar al modo en que utilizamos nuestras capacidades intelectuales.

Sugiere que el uso excesivo de herramientas como ChatGPT podría debilitar las vías neuronales vinculadas al pensamiento crítico, afectando al lóbulo frontal del cerebro. "El problema de memoria más frecuente que encuentro es la falta de atención", afirma.

Sin embargo, estos riesgos contrastan con la capacidad de la IA para impulsar la búsqueda del conocimiento, como demuestran los avances en ciencia y medicina, donde el aprendizaje automático (AM) permite a los humanos centrar sus habilidades en los aspectos en los que tienen un impacto más significativo.

Los investigadores están utilizando la IA para explorar el espacio, cartografiar sistemas biológicos, modelar el clima con cada vez más detalle, y descubrir nuevos fármacosTodo ello en una fracción del tiempo que se tardaría en realizar ese trabajo manualmente.

Para mantener estas ventajas, la IA debe aprovecharse como un aditivo a la inteligencia humana -una extensión- y no como un sustituto.

¿Puede frenarse la influencia de la IA en la educación?

Algunos estarán familiarizados con una herramienta llamada Turnitin, utilizada por centros educativos de todo el mundo para detectar pruebas de plagio mediante la identificación de cadenas de palabras copiadas de otras fuentes.

Ahora, Turnitin y otros detectores de plagio tienen entre manos una tarea considerablemente más compleja: identificar contenidos generados por IA. Una tarea que está resultando intratable.

Yves Barlette, de la Montpellier Business School (MBS), en Montpellier (Francia), subraya que la IA no sólo se ha vuelto experta en eludir los detectores de IA, sino que también adolece de una elevada tasa de falsos positivos.

Dice: "Por ejemplo, un estudiante puede tener un estilo de escritura particular que se parezca al texto generado por la IA. Por lo tanto, es importante encontrar soluciones legalmente aceptables, especialmente cuando se trata de castigar o incluso expulsar a los estudiantes que hacen trampas."

Esto se ha demostrado en investigación experimentalUn estudio demostró que las redacciones escritas por personas cuya lengua materna no era el inglés se marcaban erróneamente como generadas por inteligencia artificial casi la mitad de las veces, y que un detector de inteligencia artificial en particular arrojaba una absurda tasa de 98% de falsos positivos.

La IA es imperfecta, no se puede confiar en los detectores de IA, e impedir que los estudiantes utilicen la IA generativa no es realista.

Quizá no haya más remedio que establecer nuevos modelos y vías de aprendizaje.

Como describe Tom Crick, catedrático de Digital & Policy de la Universidad de Swansea (Reino Unido), "la educación lleva décadas incorporando y reimaginando las amenazas y posibilidades de la tecnología; la IA probablemente no será diferente, pero requerirá no sólo un cambio tecnológico, sino también un cambio de mentalidad y cultural."

¿Cómo lo hacemos?

La IA generativa ofrece un nuevo modelo de aprendizaje

La intersección de la IA generativa y la educación está precipitando un cambio sutil pero profundo en el proceso de aprendizaje.

En muchos sentidos, la IA marca la continuidad con respecto a avances tecnológicos anteriores, como la calculadora e Internet, algo que debatieron tanto el Sam Altman, consejero delegado de OpenAI, y Jensen Huang, consejero delegado de Nvidia.

Huang dijo que ahora era el mejor momento para graduarse, comparando el auge de la IA a la aparición del ordenador personal (PC) en los años 80.

Históricamente, el aula convencional situaba al alumno como receptor pasivo, absorbiendo la información transmitida por un instructor.

La tecnología ha dotado a los estudiantes de más herramientas de aprendizaje autoguiado, y con la llegada de la IA generativa, ahora asumen el papel de buscadores activos que pueden explorar e interrogar vastos conocimientos a su alcance.

Esto señala una transición epistemológica nunca vista en la historia de la humanidad.

La epistemología -el estudio del conocimiento- describe la educación tradicional como basada en una epistemología de "transmisión", en la que el conocimiento se considera una entidad estática que pasa del profesor al alumno.

En este modelo tradicional, el camino del aprendizaje es en gran medida lineal, pasando de la "ignorancia" a la "iluminación".

La IA generativa podría dar paso a un modelo de "buscador activo", en el que el conocimiento no sólo se transmite de uno a otro, sino que el alumno lo construye activamente.

El estudiante, con la ayuda de la IA, se convierte en el navegante que discierne la relevancia, contextualiza las ideas y entrelaza los conocimientos procedentes de una pluralidad de fuentes.

Los buscadores activos de información saben dónde buscarla y cómo interrogarla; esto último es vital para aprovechar la IA como herramienta de aprendizaje sin invertir totalmente en sus resultados.

AI es una institución sesgada, pero ¿no lo son todas?

La IA tiene un profundo problema de sesgoen parte porque Internet tiene un problema de parcialidad.

En la era de Internet, la sociedad a menudo subcontrata el pensamiento a las grandes tecnologÃas, dando por sentado que los resultados de los motores de búsqueda son transparentes y no partidistas, cuando probablemente no lo son.

Además, la práctica de la optimización de motores de búsqueda (SEO) y la publicidad de pago por clic (PPC) hacen que los primeros resultados de las búsquedas no siempre se posicionen por la calidad de su información, aunque esto ha mejorado mucho en la última década.

Además, aunque la IA es propensa a la falsedad y la desinformación, también lo son las instituciones de enseñanza tradicionales.

Numerosos centros de enseñanza famosos son famosos por sus inclinaciones sociales y políticas. Incluso se pueden encontrar recopilaciones de "las universidades más conservadoras" de EE.UU., que incluyen universidades como la Liberty University de Virginia, que se ganó la reputación de enseñar creacionismo en detrimento de la biología evolutiva.

En el Reino Unido, Oxford y Cambridge -conocidas colectivamente como Oxbridge- fueron conocidas en su día por sus inclinaciones políticas, aunque esto varía según sus facultades.

Por otro lado, se sabe que otros centros educativos son decididamente de izquierdas, y los tutores de la enseñanza superior tienden a ser predominantemente de izquierdas en el Reino Unido, al menos.

En los centros de enseñanza también hay prejuicios raciales y de género, y las mujeres ocupan un lugar secundario en la enseñanza superior y la investigación. heredado por la IA.

Si bien esto no crea necesariamente una difusión sesgada del conocimiento, la educación siempre está expuesta a subjetividades de diversas formas, al igual que la IA.

Estudios recientes sobre Prejuicios de la IA encontraron que los modelos GPT se inclinaban predominantemente hacia la izquierda y los LLaMA de Meta se inclinaban más hacia la derecha.

Aunque la parcialidad de los sistemas de IA no exime a los sistemas educativos tradicionales de sus prejuicios y viceversa, la solución es similar en ambos casos: hacer hincapié en el pensamiento crítico y aplicar medidas de igualdad para lograr sistemas representativos del conocimiento.

Pensamiento crítico en la era de la IA

Con el tiempo, y con un compromiso crítico en los entornos educativos, el modelo de "búsqueda activa" de la IA podría trasladar al estudiante la carga de la responsabilidad de garantizar el equilibrio y la precisión.

Con la capacidad de la tecnología para generar flujos de información aparentemente interminables, la responsabilidad de verificar la exactitud, pertinencia y contexto del conocimiento recae en gran medida sobre el buscador.

Entonces, los educadores pueden cambiar su papel para enseñar pensamiento crítico, análisis y verificación, al tiempo que aportan sus propias percepciones y opiniones humanas a lo que esencialmente se convierte en una enciclopedia o libro de texto generativo.

Fomentar el aprendizaje crítico en la era de la IA podría reportar beneficios más amplios, no sólo para escudriñar los resultados de los grandes modelos lingüísticos (LLM) y sus responsabilidades, sino para desarrollar opiniones críticas en otros ámbitos de la sociedad.

Como dijo Sven Laumer: "Este es el núcleo intelectual que beneficiará tanto a los estudiantes como a la sociedad".

Los investigadores y educadores Nripendra P Rana, Jeretta Horn Nord, Hanaa Albanna y Carlos Flavian escriben: "Si queremos que nuestros alumnos aprendan a resolver problemas en tiempo real, tenemos que salir del modelo de enseñanza tradicional de limitarse a transmitir a los estudiantes conocimientos teóricos unidireccionales e ir más allá para hacer de herramientas como ChatGPT un amigo en el ecosistema del aula que no sea algo que temer."

"Más bien debería utilizarse para fomentar esa tecnología como medio para transformar la educación práctica. Además, podría ser de gran ayuda para que los estudiantes adquieran habilidades de aprendizaje para la vida y las utilicen en sus futuras carreras para resolver problemas reales en sus lugares de trabajo."

A la humanidad le han tocado los beneficios y los inconvenientes de la IA, y es nuestra responsabilidad dar forma a la tecnología que tenemos bajo nuestra tutela.

A estas alturas hay pocas conclusiones preconcebidas, y la gente ya piensa de forma crítica sobre la IA, lo cual es una señal positiva.

Enseñar a los estudiantes a comprometerse críticamente con este nuevo medio de aprendizaje sin utilizarlo compulsivamente es primordial para forjar nuestro futuro colectivo.

En última instancia, la IA es una herramienta aditiva que amplía nuestras capacidades en lugar de sustituirlas, y debemos mantenerla así.