Google hat mit Gemini 1.5 Pro eine weitere Karte ausgespielt, ein Modell, das auf den Errungenschaften seines Vorgängers Gemini 1.0 aufbaut.

Da Google Bard tot und begraben ist, scheint sich die Gemini-Familie schneller zu vermehren, als die KI-Gemeinschaft den Überblick behalten kann.

Jetzt gibt es Gemini 1.5 Pro, das leistungsfähiger ist als das frühere Flaggschiff von Google, Gemini Ultra.

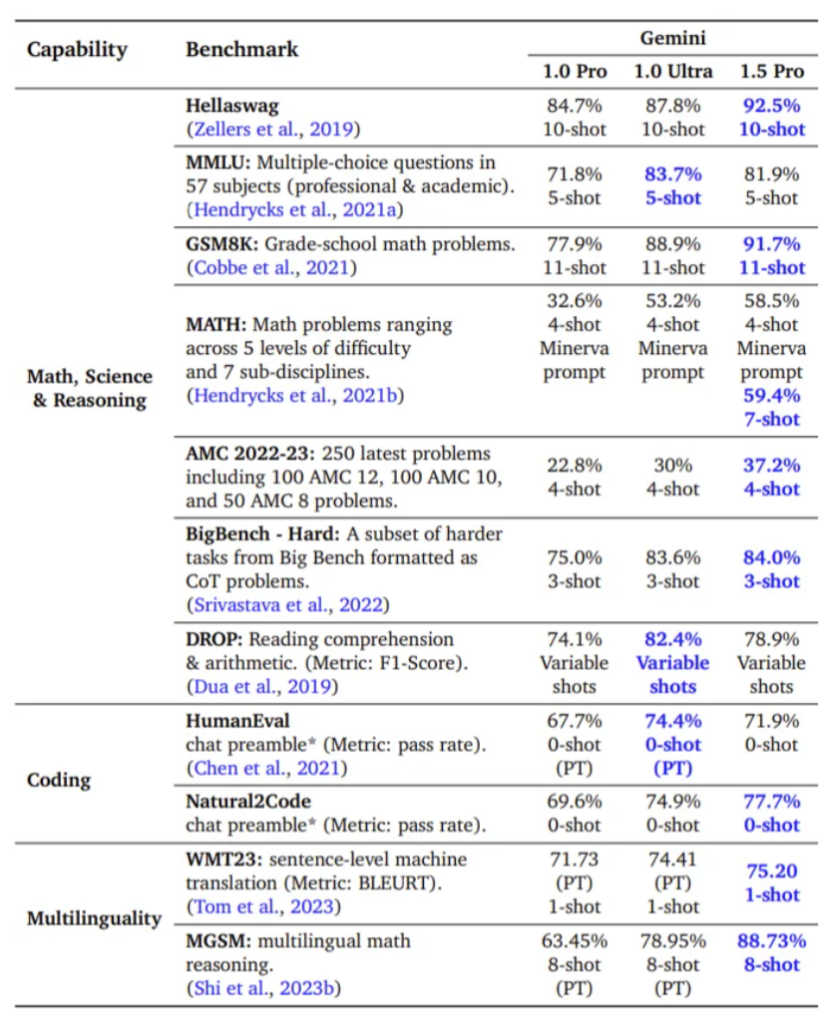

Tatsächlich liegt das Gemini 1.5 Pro in einer Handvoll Benchmark-Tests vor dem Ultra, aber für einen umfassenden Vergleich benötigen wir mehr Informationen.

Gemini 1.5 Pro bietet eine neue Mixture-of-Experts (MoE)-Architektur und übertrifft Gemini Pro (jetzt Gemini 1.0 Pro genannt) in 87% Benchmarks.

Es ist über Googles neue kostenpflichtige KI-Plattform namens Google One AI Premium erhältlich und verdrängt damit Gemini Pro, obwohl Google nur die vor ein paar Wochen aktualisiert wurde.

Wozu also ein Modell, das die 1.0 Pro übertrifft, aber ähnlich wie die Ultra ist?

Abgesehen von der höheren Rechenleistung im Vergleich zu Ultra und der überlegenen Leistung in einigen Bereichen, ist das Hauptmerkmal von Gemini 1.5 Pro seine 128.000 Token Kontextfenster, erweiterbar auf bis zu 1 Million Token. Dies übertrifft GPT-4 Turbo mit 128.000 und Claude 2.1 mit 200.000.

Ein 1-Millionen-Kontext-Fenster entspricht in etwa 700.000 Wörtern, 11 Stunden Audio oder 1 Stunde Video.

Dies ermöglicht die Verarbeitung und Interpretation riesiger Datenmengen, einschließlich ganzer Bücher. Google betont jedoch, dass Gemini 1.5 Pro nach wie vor ein "mittelgroßes" multimodales Modell ist, das skalierbar und vielseitig einsetzbar sein soll.

Ist Gemini 1.5 also ein GPT-4-Killer? Sicherlich not in der Brute-Force-Performance, aber es sollte es bei bestimmten Aufgaben mit sehr großen Informationsmengen überflügeln, wie Google gerne demonstrierte.

Geminis Anwendungen und Fähigkeiten

Wie seine Vorgänger umfasst Gemini 1.5 Pro mehrere Modalitäten, von Text bis hin zu Video und Audio.

Dank des erweiterten Kontextfensters ist das Modell in der Lage, große Mengen an Informationen zu verarbeiten und Schlussfolgerungen zu ziehen, z. B. lange Dokumente, umfangreiche Codebasen oder stundenlange Videoinhalte.

In einer Google-Demo kann Gemini 1.5 Pro Details in den 402-seitigen Protokollen der Mondmission von Apollo 11 verstehen und identifizieren.

Eine weitere Herausforderung bestand darin, bestimmte Szenen in Buster Keatons "Sherlock Jr." anhand von Beschreibungen und Skizzen zu finden, was 1,5 Pro gelang, obwohl es in einigen Fällen bis zu einer Minute dauerte.

In einer anderen Aufgabe wurde Gemini 1.5 Pro mit der Übersetzung von Englisch in die komplexe guineische Sprache Kalamang und umgekehrt konfrontiert.

Dies war besonders entmutigend, weil Kalamang in den Trainingsdaten des Modells nicht vertreten ist.

Google versorgte das Modell mit Lehrmaterial in seinem Eingabekontext, einschließlich etwa 500 Seiten Referenzgrammatik, einer zweisprachigen Wortliste (Wörterbuch) mit etwa 2.000 Einträgen und einem Satz von etwa 400 parallelen Sätzen.

Diese Materialien umfassten etwa 250 000 Token, die in das erweiterte Kontextfenster des Modells passten.

Allein mit dem zur Verfügung gestellten Lehrmaterial übersetzte Gemini 1.5 Pro erfolgreich Sätze zwischen Englisch und Kalamang. Dieses Experiment zeigte die Fähigkeit des Modells, neue sprachliche Regeln und Vokabeln aus dem Kontext zu übernehmen und anzuwenden und so effektiv eine neue Sprache im Handumdrehen zu lernen.

Die Qualität der von Gemini 1.5 Pro erstellten Übersetzungen wurde von menschlichen Experten bewertet, die die Leistung des Modells mit der eines menschlichen Sprachlerners verglichen, dem dieselben Materialien zur Verfügung standen.

In einer weiteren Demo wurde die Leistung des Modells bei der Analyse und Lösung von Problemen mit über 100.000 Codezeilen gemessen.

Einblicke in das Forschungspapier von Gemini 1.5 Pro

Google veröffentlichte ein begleitendes Forschungspapier zu Gemini 1.5 mit dem Titel "Gemini 1.5: Multimodales Verstehen über Millionen von Kontext-Token hinweg."

Es ist klar, dass Google beabsichtigt, das erweiterte Kontextfenster von Gemini 1.5 Pro zu fördern, das derzeit andere LLMs am oberen Ende der 1-Millionen-Marke dominiert.

Gemini 1.5 Pro erreicht einen nahezu perfekten Abruf bei Abrufaufgaben mit langem Kontext über verschiedene Modalitäten hinweg und setzt neue Maßstäbe bei der QA von langen Dokumenten, langen Videos und ASR mit langem Kontext.

Das Papier beschreibt die Leistung von Gemini 1.5 Pro in verschiedenen Kernfunktionen und vergleicht sie mit den Gemini 1.0 Modellen:

- Verbesserungen der Gewinnrate: Gemini 1.5 Pro zeigt eine Gewinnrate von 87,1% im Vergleich zu Gemini 1.0 Pro und eine Gewinnrate von 54,8% im Vergleich zu Gemini 1.0 Ultra über mehrere Benchmarks hinweg, was die Verbesserungen zeigt

- Leistung in bestimmten Bereichen: Bei textbezogenen Aufgaben erreicht das Modell eine Gewinnrate von 100% gegen Gemini 1.0 Pro und eine Gewinnrate von 77% gegen Gemini 1.0 Ultra. Bei bildverarbeitungsbezogenen Aufgaben liegen die Gewinnraten bei 77% und 46% gegenüber Gemini 1.0 Pro bzw. Ultra. Bei den Audioaufgaben beträgt die Gewinnrate 60% gegenüber Gemini 1.0 Pro und 20% gegenüber Gemini 1.0 Ultra.

Insgesamt ist Gemini 1.5 Pro eine gute GPT-3,5-Ebenen-Modell mit einem längeren Kontextfenster als die Konkurrenz.

Ist das genug, um Leute von ChatGPT wegzulocken? Die Wahrheit ist, dass der Nutzen gering bis nicht vorhanden ist, es sei denn, Sie haben ganze Bücher zu analysieren.

Wie man Gemini 1.5 Pro benutzt

Gemini 1.5 ist derzeit in einer begrenzten Vorschau für Entwickler und Unternehmenskunden verfügbar.

Fragen zur langfristigen Preisgestaltung und Zugänglichkeit wurden bisher nicht beantwortet. Google hat angedeutet, dass die Preise je nach Größe des Kontextfensters variieren werden, von den standardmäßigen 128.000 Token bis zur vollen 1 Million.

Die genauen Kosten bleiben unter Verschluss, was zu Spekulationen über die potenziellen Investitionen führt, die erforderlich sind, um dieses fortschrittliche Kontextfenster zu nutzen.

Einige haben hervorgehoben, dass bis zum Start von Gemini 1.5 Pro für die breite Masse die Konkurrenz weiterziehen wird.

Google unterscheidet sich durch ein Produkt, mit dem nur einige wenige Early Adopters experimentieren können. Das scheint ein wenig befremdlich zu sein.

Die Familie der Zwillinge: zugänglich oder esoterisch?

Innerhalb von etwa zwei bis drei Monaten hat Google Bard hochgezogen und getötet, Tausch mit Gemini Pro und die Veröffentlichung von Ultra, Nano und jetzt Gemini 1.5 Pro.

Dies beinhaltete die Umbenennung von Gemini Pro (das einfach nur Gemini?) in Gemini 1.0 Pro.

Das Ergebnis dieser KI-Spritztour, DeepMinds Landing Page für die Gemini-Familie ist offen gesagt unübersichtlich und überfüllt.

OpenAI hat in vielerlei Hinsicht einen geschickten Marketingtrick angewandt, indem sie ihre Modelle von Anfang an unter dem Namen "ChatGPT" geführt haben und den Zugang mehr oder weniger auf das kostenlose GPT-3.5 und das kostenpflichtige GPT-4 für Nicht-API-Nutzer beschränkt haben.

Mit Gemini setzt Google auf generative KI, aber das Unternehmen könnte sich in seinem zunehmend unklaren Produktangebot verzetteln.