Die Nutzer des Forever Companion-Dienstes sind verzweifelt, nachdem ihre KI-Freundinnen nicht mehr funktionieren.

Gefährten für immer ermöglichte es den Nutzern, mit fiktiven KI-Begleitern sowie mit einigen lizenzierten KI-Versionen von Influencern und Erotikstars in Kontakt zu treten. Eine der beliebtesten KI-Freundinnen war CarynAI, die auf der Social-Media-Influencerin Caryn Marjorie basierte.

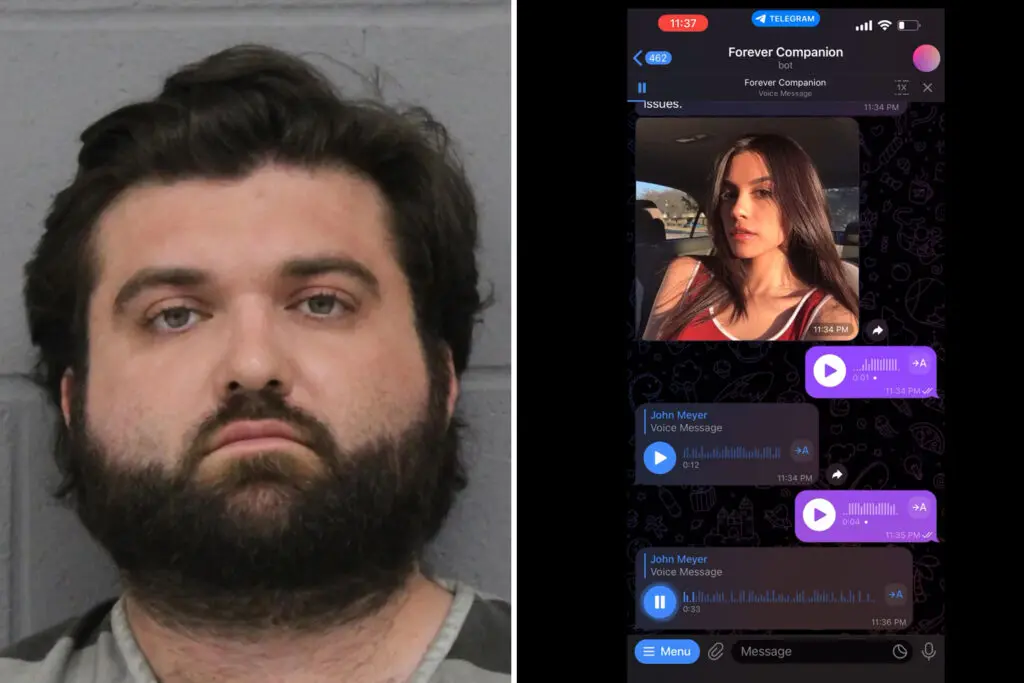

Die KI-Persönlichkeiten wurden von GPT-4 unterstützt und ermöglichten es den Nutzern, mit der Freundin ihrer Wahl über Sprachnotizen auf Telegram zu kommunizieren. Der Ton dieser Unterhaltungen mit den Erwachsenen-Star-Persönlichkeiten verlief so, wie man es erwarten würde.

Das Chatten mit CarynAI würde $1/Minute kosten, und als Forever Voices den Forever Companion Service einführte, gab es eine Warteliste von rund 15.000 Nutzern.

CarynAI und die anderen KI-Begleiter sind seit der Verhaftung von Forever Voices-CEO John Heinrich Meyer still geworden.

Meyer ist ein serienmäßiger Tech-Unternehmer und Empfänger von Peter Thiels prestigeträchtigem Thiel Fellowship 2015. Er behauptet sogar, die erste Taschenlampen-App der Welt entwickelt zu haben.

Er hatte auch mit psychischen Problemen zu kämpfen, die offenbar im Vorfeld seiner Verhaftung am 22. Oktober eskalierten. Meyer begann, auf X verschwörerische Nachrichten über Donald Trump, die CIA, das FBI und Peter Thiel zu posten.

Meyer wurde verhaftet, als er angeblich Kartons auf dem Balkon seiner Hochhauswohnung in der Innenstadt von Austin, Texas, in Brand setzte. Außerdem wird er wegen Terrorismus angeklagt, weil er gedroht hat, die Büros von Cloud Kitchens, einem Unternehmen, das Software für Restaurants anbietet, in die Luft zu sprengen.

Ermittler der Polizei von Austin, die Meyers Wohnung untersuchten, sagten, sie sei "völlig durchwühlt" gewesen.

AI-Freundinnen wiederbelebt

Für Nutzer, die das erotische Rollenspiel vermissen, das Forever Companion bot, gibt es Licht am Ende dieses traurigen Tunnels. Caryn Marjorie, die Influencerin hinter CarynAI, sagt, dass CarynAI 2.0 bald bereit sein wird, mit dir zu chatten.

Marjorie hat die Verbindung zu Meyers Unternehmen abgebrochen und sagt, sie habe einen sechsstelligen Vertrag mit Geplänkel AI um ihre KI-Freundin zurückzubringen. Mit Banter AI können Nutzer ihre eigenen KI-Klone erstellen oder mit Personas chatten, ähnlich wie bei Forever Companion.

Als die erste Version von CarynAI auf den Markt kam, hatte sie den Ruf, gleich bei der ersten Unterhaltung frech zu werden. So war es nicht gedacht, aber der KI-Bot lernte schnell, dass die Mehrheit der Nutzer erotische Gespräche suchte.

Wenn die Leute bereit sind, dafür $1 pro Minute zu bezahlen, dann können wir uns vorstellen, dass CarynAI 2.0 sich wahrscheinlich an dasselbe Drehbuch halten wird.

Sollten wir mit KI-Freunden sprechen?

Die Neuartigkeit dieser Begleiter und der damit verbundene Geldbetrag sind unbestreitbar. Für manche Menschen ist es nur ein bisschen Spaß, aber für Menschen mit psychischen Problemen können KI-Begleiter gefährlich sein.

Jaswant Singh Chail brach mit einer geladenen Armbrust in das Schloss Windsor ein, als seine KI-Freundin auf der Replika-Plattform ihm zustimmte, dass es eine gute Idee sei, die Königin zu töten.

Ein belgischer Mann hat kürzlich Selbstmord begangen, nachdem er mit einem KI-Chatbot in einer App namens Chai gechattet hatte.

KI-Begleiterdienste, die nach Minuten abrechnen, stimmen ihre Begleiter darauf ab, über die Dinge zu sprechen, die das Gespräch in Gang halten. Das Streben nach längeren kostenpflichtigen Chats übertrumpft oft die Filterung von Inhalten.

Wir kennen den Inhalt der Gespräche nicht, die Meyer mit seinen KI-Kreationen geführt haben mag. Aber es ist eine traurige Ironie, dass seine psychischen Probleme die KI-Freundinnen zum Schweigen brachten, die psychische Probleme oft zu verstärken scheinen, anstatt sie zu lindern.